Hadoop学记:五、单机部署

注:本文默认安装了hadoop并且配置好了环境变量

一、修改hosts文件

vim /etc/hosts

在文件里加上主机IP与node101的映射

192.168.145.128 node101

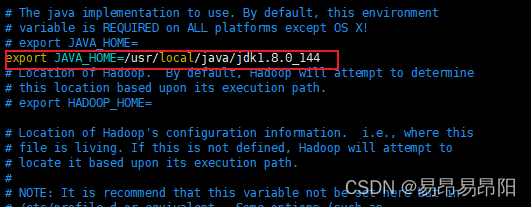

二、配置hadoop环境的jdk

vim /opt/module/hadoop-3.1.3/etc/hadoop/hadoop-env.sh

三、配置文件说明

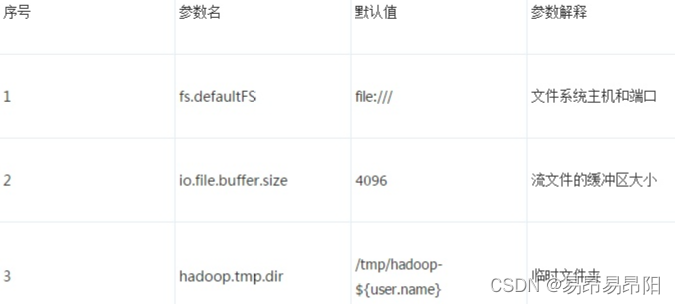

1)core-site.xml

配置对象:集群全局参数

主要内容:用于定义系统级别的参数,如HDFS、URL、Hadoop的临时目录等

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

<description>副本个数,默认配置是3,应小于datanode机器数量</description>

</property>

<property>

<name>dfs.name.dir</name>

<value>/opt/module/hadoop-3.1.3/hdfs/name</value>

<description>datanode上存储hdfs名字空间元数据</description>

</property>

<property>

<name>dfs.data.dir</name>

<value>/opt/module/hadoop-3.1.3/hdfs/data</value>

<description>datanode上数据块的物理存储位置</description>

</property>

<property>

<name>hadoop.http.staticuser.user</name>

<value>root</value>

<description>默认操作用户</description>

</property>

<property>

<name>io.file.buffer.size</name>

<value>4096</value>

<description>流文件缓冲区大小</description>

</property>

</configuration>

2)hdfs-site.xml

配置对象:HDFS参数

主要内容:如名称节点和数据节点的存放位置、文件副本的个数、文件读取权限等

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://node101:9000</value>

<description>HDFS的URI,文件系统://namenode标识:端口</description>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/module/hadoop-3.1.3/tmp</value>

<description>namenode上传到hadoop的临时文件夹</description>

</property>

<property>

<name>fs.checkpoint.period</name>

<value>3600</value>

<description>用来设置检查点备份日志的最长时间</description>

</property>

</configuration>

3)mapred-site.xml

配置对象:Mapreduce参数

主要内容:包括JobHistory Server和应用程序参数两部分,如reduce任务的默认个数、任务所能够使用内存的默认上下限等

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<name>mapreduce.jobhistory.address</name>

<value>node101:10020</value>

</configuration>

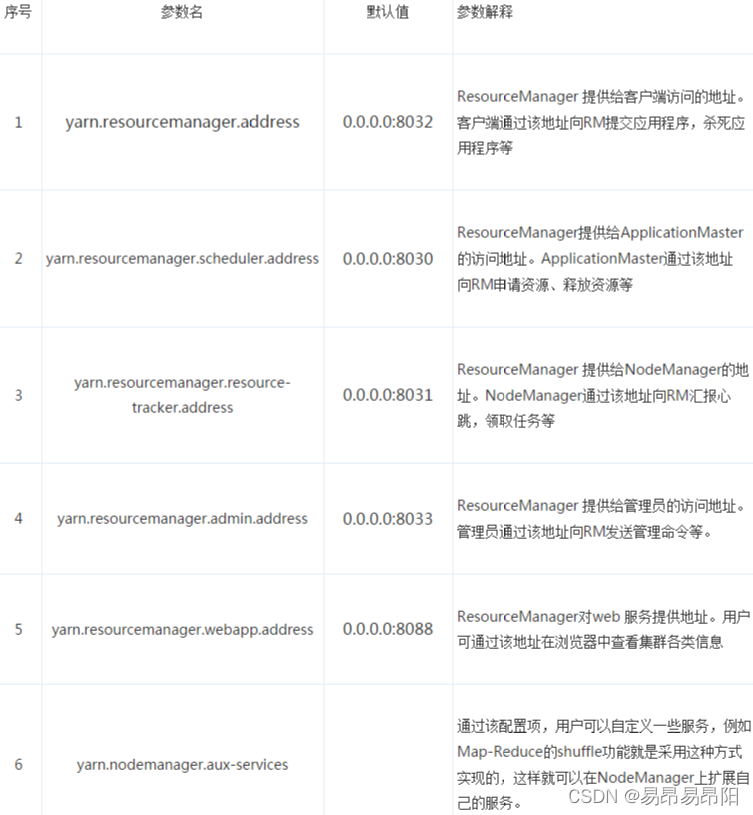

4)yarn-site.xml

配置对象:集群资源管理系统参数

主要内容:配置ResourceManager、NodeManager的通信端口,web监控端口等

<configuration>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>node101</value>

<description>做为yarn的resourcemanager所在的节点</description>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

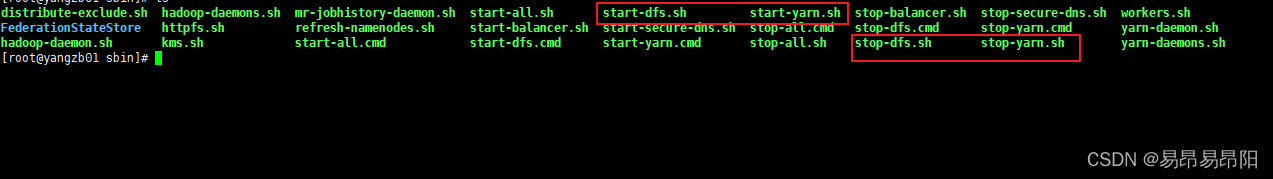

四、修改启动、停止脚本

在start-dfs.sh与stop-dfs.sh顶部空白处加上

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=hdfs

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

在start-yarn.sh与stop-yarn.sh顶部空白处加上

YARN_RESOURCEMANAGER_USER=root

HADOOP_SECURE_DN_USER=yarn

YARN_NODEMANAGER_USER=root

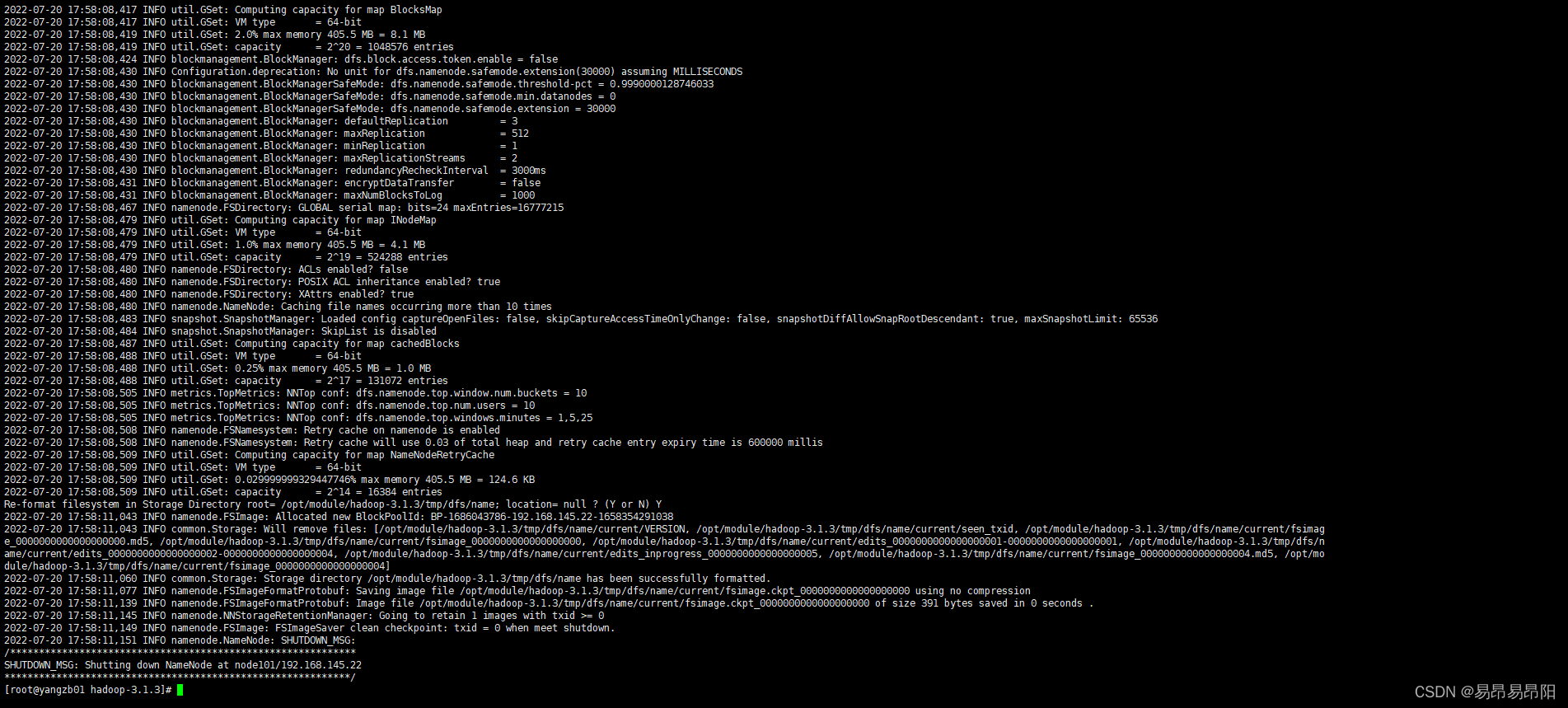

五、初始化namenode节点

/opt/module/hadoop-3.1.3/bin/hadoop namenode -format

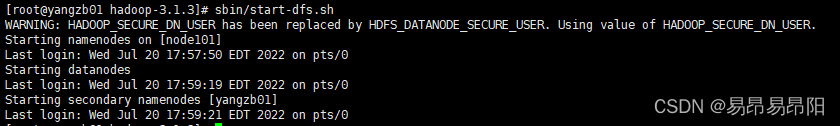

六、启动hdfs

sbin/start-dfs.sh

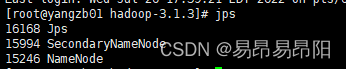

七、查看集群情况

八、SSH 免密登录本机报错

检查是否能免密登录本机

ssh localhost

如果不行的话则依次执行一下命令即可:

ssh-keygen -t rsa -P ‘’ -f ~/.ssh/id_rsa

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

chmod 0600 ~/.ssh/authorized_keys

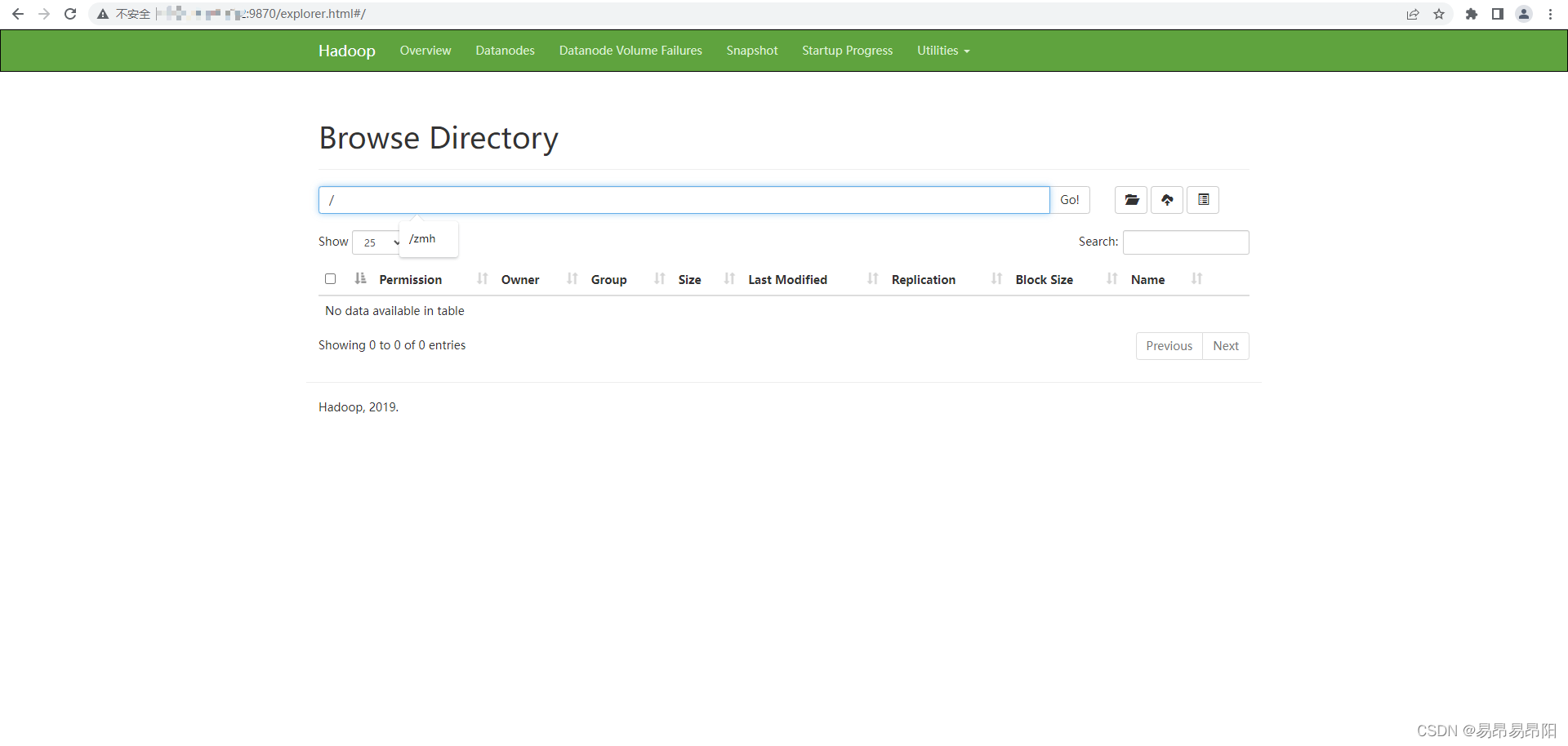

九、访问WEB页面

Hadoop3.x之后端口默认为9870

单机部署完成!

1813

1813

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?