今天电脑系统崩了,重做了系统,对于我这个非计算机专业的来说,记录一下问win10系统安装eclipse软件和JDK以及配置环境变量时遇到的问题也是好的,希望也可以帮助到刚入行的你。

jdk下载地址:

链接: https://pan.baidu.com/s/1mlUl9-jyjuS2GoSsIyMrvg 提取码: t7rv

eclipse下载地址:

链接: https://pan.baidu.com/s/1Gqlm3FZ5vQ8vgJzwOVD_Mw 提取码: j4pt

1.jdk安装

一路点击下一步就行,碰到安装路径,自己选择。

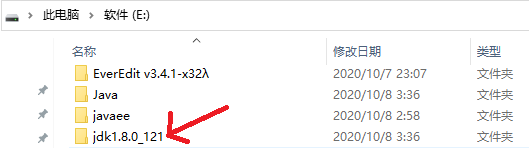

jdk下载完成之后,进行安装,建议不要安装在C盘。

我的电脑现在只有C盘和E盘。

2.配置环境变量

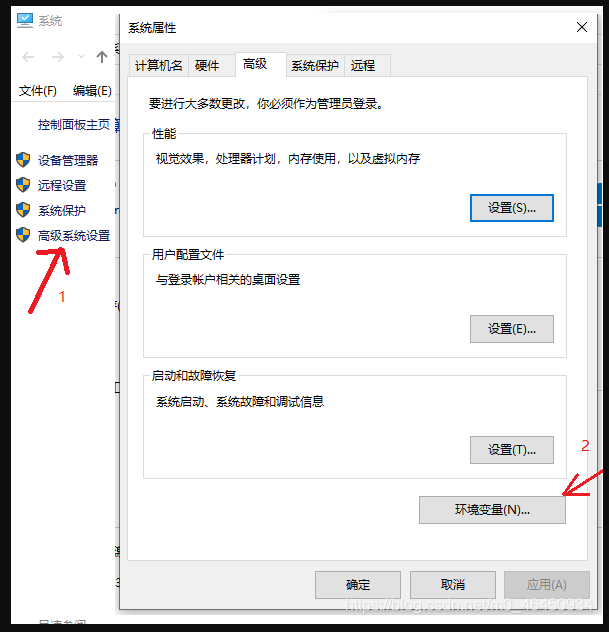

2.1 鼠标右键此电脑点击属性。

2.2 点击高级系统设置,会出现弹框,点击环境变量。

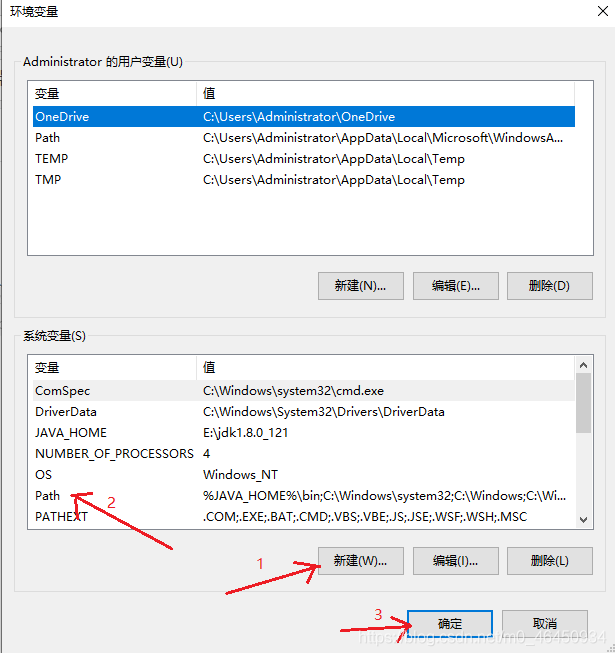

2.3 在系统变量下,点击新建。

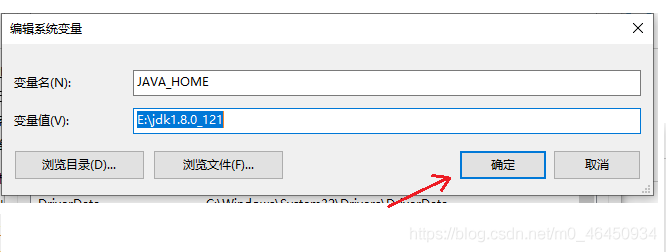

2.4 配置JAVA_HOME

变量名写"JAVA_HOME",变量值写jdk的路径。

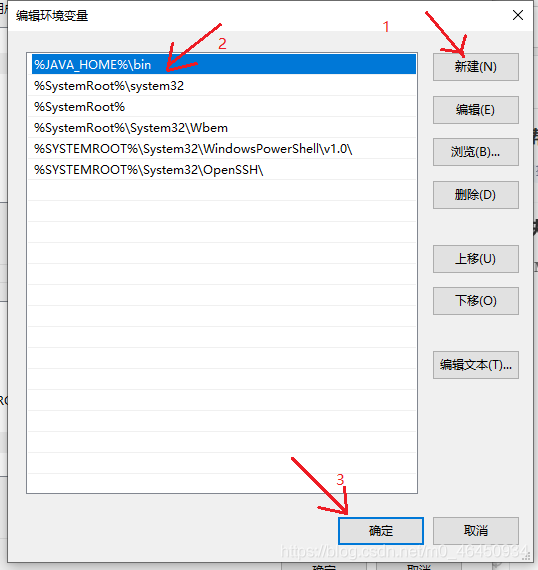

2.5配置Path

点击新建,输入"%JAVA_HOME%\bin"

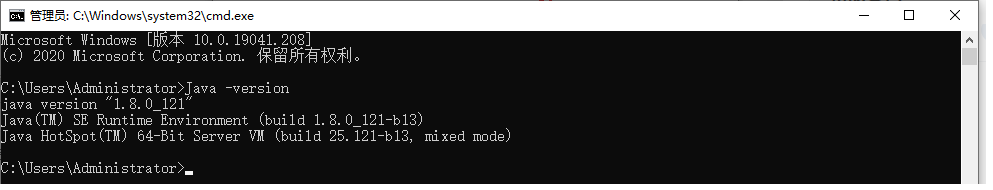

2.6 测试环境变量

2.6.1环境变量配置完成后,Windows+R出现弹框,输入cmd进入doc命令行,输入java -version,出现jdk的版本号,再输入java和javac,三个命令都测试成功,环境变量就配置好了。

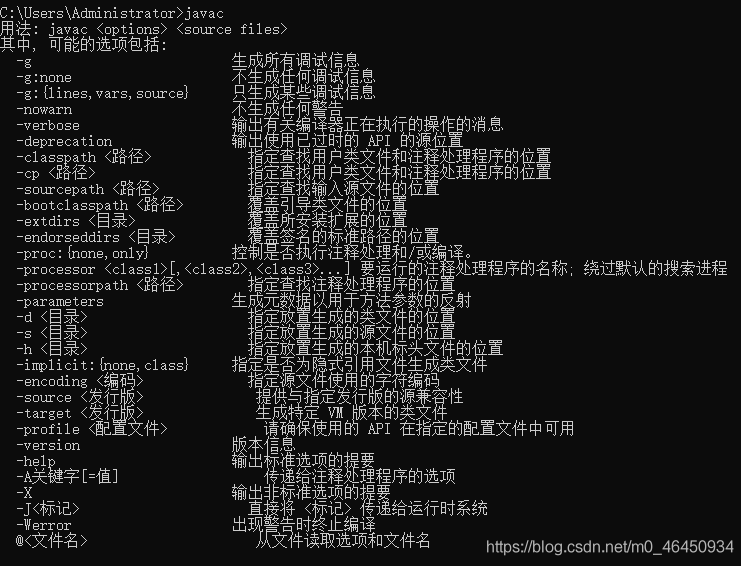

2.6.2输入javac

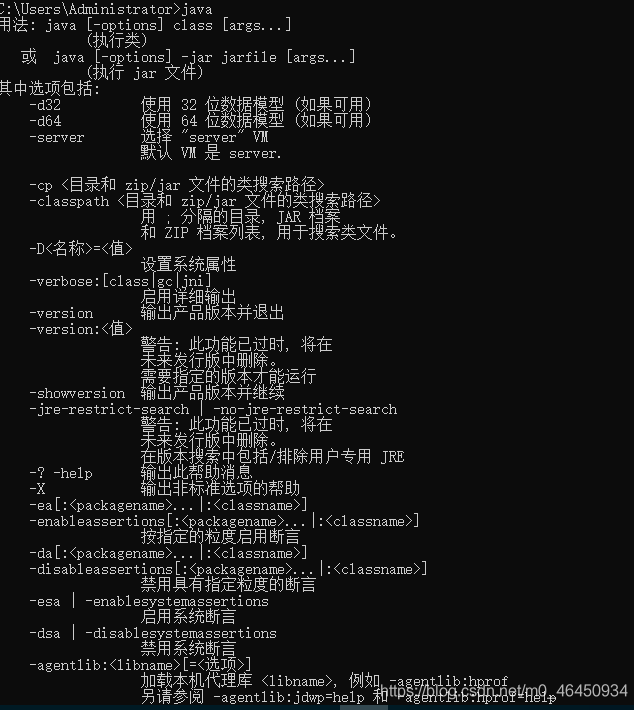

2.6.3 输入java

3.eclipse安装

eclipse解压直接双击运行

4.总结:

jdk我用的是jdk1.8.0_121,64位的,eclipse用的是eclipse-jee-2020-09-R-win32-x86_64。

4.1 Failed to load the JNI shared library。

这里要注意jdk的版本和eclipse的版本要一致,不然当你配置好环境变量,eclipse安装好却发现打不开,他会弹出Failed to load the JNI shared library:(这里是jvm的路径)。

解决办法:重新安装eclipse或者jdk

4.2 Failed to create jvm

如果java -version命令和java命令都测试成功,而javac测试失败,说明jdkl路径有问题,就会导致eclipse运行时打不开,弹框出现failed to create jvm

解决办法:在eclipse目录下找到eclipse.ini文件,双击打开,在开头添加jdk路径:-vm E:/jdk1.8.0_121/bin。这里的路径换成自己的jdk路径就行。

如果三个命令都测试成功,但还是会弹出failed to create jvm,就可能是内存不足。

解决方法:将.XXMaxPermSize参数改小,直到可以运行。

总结

到此这篇关于eclipse+jdk安装以及会遇到的问题+解决方法的文章就介绍到这了,更多相关eclipse+jdk安装内容请搜索脚本之家以前的文章或继续浏览下面的相关文章希望大家以后多多支持脚本之家!

615

615

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?