作者:Andrew Gaut.et al

编译:LZM

原文:Towards Understanding Gender Bias in Neural Relation Extraction

题图出处:pixabay

biendata 内容团队近期组织编译了一批机器阅读领域内的优秀论文,如感兴趣欢迎阅读菜单栏的机器阅读文章专辑。

关系抽取希望从无结构文本中提取三元组(头实体,关系,尾实体)以结构化地表达文本蕴含的关系信息 。近年来,神经关系抽取(Neural Relation Extraction, NRE)在自动化知识库构建上取得了显著进展 。然而这方面的工作大多集中于提高关系抽取的正确性,而很少有研究者关心 NRE 系统的社会偏见,例如性别偏见 、 ,当前流行的神经关系抽取模型是否存在性别偏见问题?如果存在,目前的偏见缓解方法是否能在保证性能和效率几乎不下降的前提下有效缓解偏见?

近日,来自加州大学圣塔芭芭拉分校、加州大学洛杉矶分校和佐治亚理工学院计算机系的一组研究人员在预印本平台 arXiv 上提交了题为 Towards Understanding Gender Bias in Neural Relation Extraction 的论文。文章中,作者创造了首个用于研究神经关系抽取任务中性别偏见问题的数据集 WikiGenderBias,并利用该数据集分析了主流关系抽取模型 OpenNRE 中性别偏见的存在性和三种基本偏见缓解方法的有效性。WikiGenderBias 数据集和相关实验代码可在 https://github.com/AndrewJGaut/Towards-Understanding-Gender-Bias-in-Neural-Relation-Extraction 免费获取。

关系抽取中的性别偏见问题

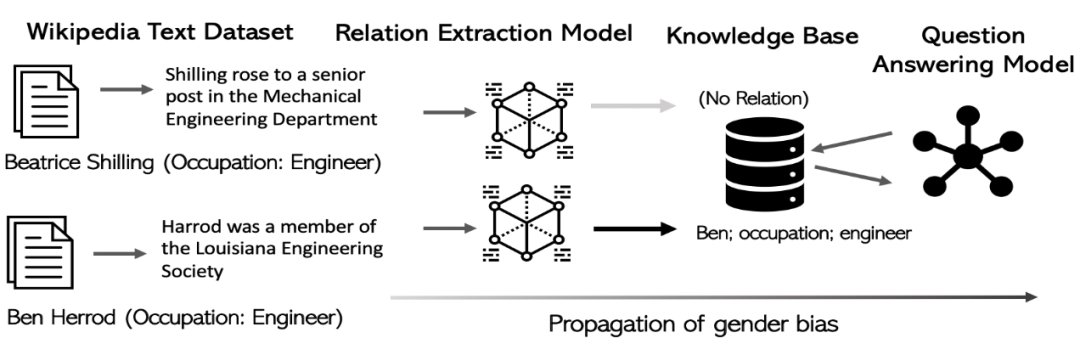

面对今天海量的文本数据,关系抽取技术日益重要。关系抽取的目的是从无结构的句子中抽取结构化的关系信息,并用精确的三元组形式进行描述,例如(巴拉克・奥巴马,配偶,米歇尔・奥巴马)。大量研究利用关系抽取技术从文本中提取准确的关系三元组,然后用于自动化地构建知识库(知识图谱),然后用于多个 NLP 下游任务,例如基于知识库的问答系统。

性别偏见是指在和性别无本质关联的任务上,算法明显利用性别信息对其他属性相似、但性别属性不同的样本给出不同预测。一些研究表明,在自然语言处理的多项任务上,主流算法都存在一些性别偏见。一些方法可以简单地检测模型是否存在性别偏见,例如计算模型在男性测试样本和女性测试样本上的性能指标之差。发现性别偏见后,一些研究提出缓解偏见的方法,例如数据增强、无偏见的词向量、平衡数据分布等等。

图 1. 关系抽取中的性别偏见如何影响下游任务

关系抽取作为众多自然语言任务的上游任务,一旦具有性别偏见,将干扰一众下游 NLP 任务,使它们都受到性别偏见的影响,进而影响模型在某些性别人群

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?