1 选错索引的现象

在MySQL中一张表可以支持多个索引。但是,写SQL语句的时候并没有主动指定使用哪个索引,使用哪个索引是由MySQL来确定的。

一条本来可以执行得很快的语句,却可能由于MySQL选错了索引会导致执行速度变得很慢。

创建一个简单的表,表里有a、b两个字段,并分别建上索引:

CREATE TABLE `t` (

`id` int(11) NOT NULL,

`a` int(11) DEFAULT NULL,

`b` int(11) DEFAULT NULL,

PRIMARY KEY (`id`),

KEY `a` (`a`),

KEY `b` (`b`)

) ENGINE=InnoDB;

然后往表t中插入10万行记录,取值按整数递增,即:(1,1,1),(2,2,2),(3,3,3) …

delimiter ;;

create procedure idata()

begin

declare i int;

set i=1;

while(i<=100000)do

insert into t values(i, i, i);

set i=i+1;

end while;

end;;

delimiter ;

call idata();

接下来,分析一条SQL语句:

select * from t where a between 10000 and 20000;

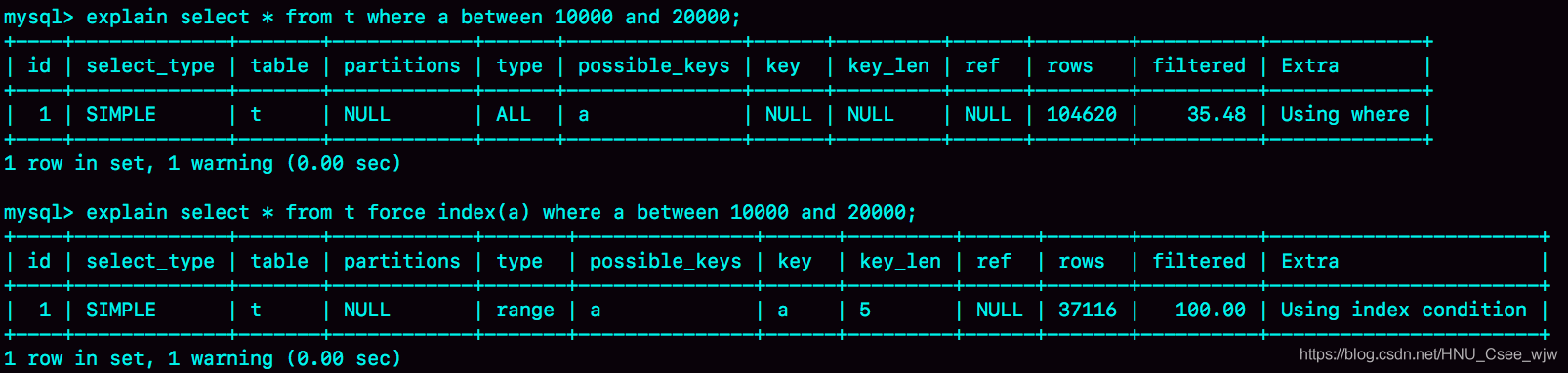

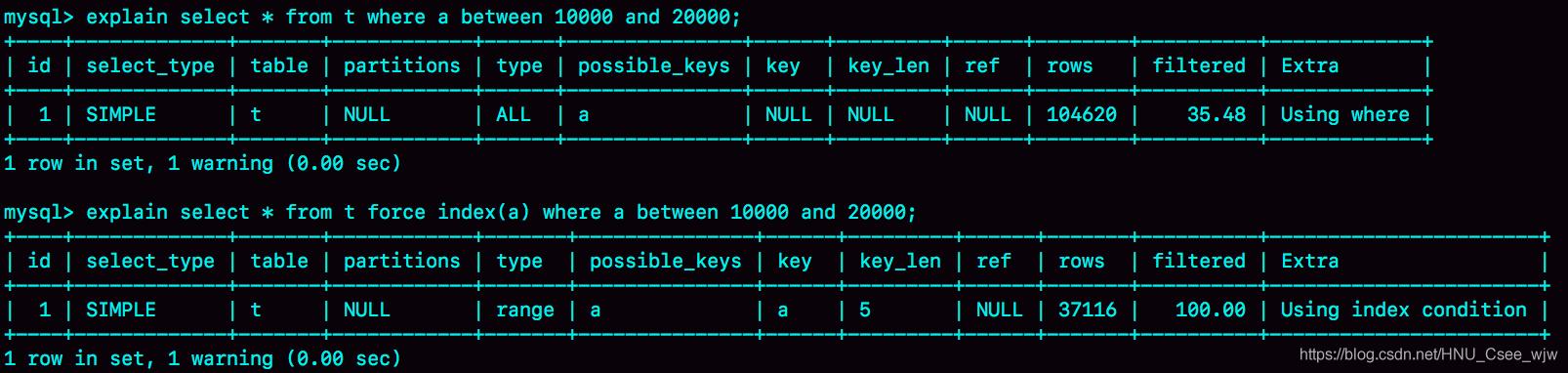

下图显示用explain命令看到的这条语句的执行情况。

key这个字段值是’a’,表示优化器选择了索引a。

在已经准备好的包含了10万行数据的表上,再做如下操作。

session A开启了一个事务。随后,session B把数据都删除后,又调用了 idata这个存储过程,插入了10万行数据。

这时session B的查询语句select * from t where a between 10000 and 20000就不会再选择索引a了。可以通过慢查询日志(slow log)来查看一下具体的执行情况。

为了对比可以使用force index(a)来让优化器强制使用索引a。

set long_query_time=0;

select * from t where a between 10000 and 20000; /*Q1*/

select * from t force index(a) where a between 10000 and 20000;/*Q2*/

第一句,将慢查询日志的阈值设置为0,表示这个线程接下来的语句都会被记录入慢查询日志中;

第二句,Q1是session B原来的查询;

第三句,Q2是加了force index(a)来和session B原来的查询语句执行情况对比。

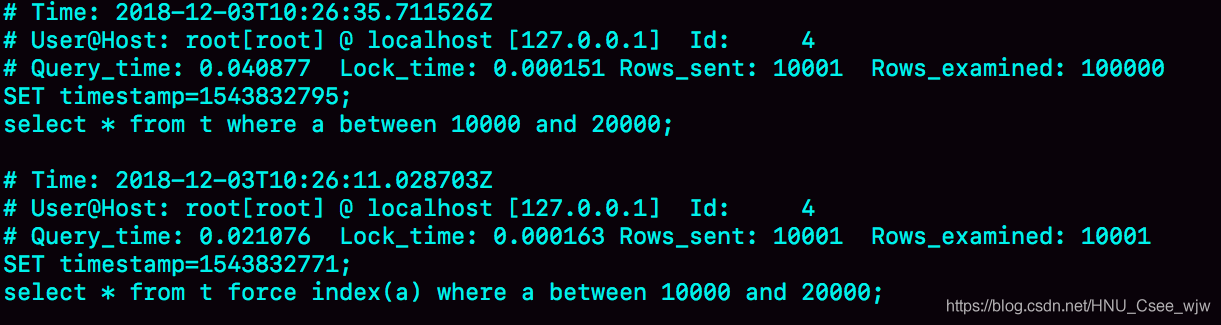

慢查询日志如下:

slow log结果

可以看到,Q1扫描了10万行,显然是走了全表扫描,执行时间是40毫秒。Q2扫描了10001行,执行了21毫秒。在没有使用force index的时候,MySQL用错了索引,导致了更长的执行时间。

2 优化器的逻辑

选择索引是优化器的工作。

优化器选择索引的目的,是找到一个最优的执行方案,并用最小的代价去执行语句。在数据库里面,扫描行数是影响执行代价的因素之一。扫描的行数越少,意味着访问磁盘数据的次数越少,消耗的CPU资源越少。

扫描行数是怎么判断的?

MySQL在真正开始执行语句之前,并不能精确地知道满足这个条件的记录有多少条,而只能根据统计信息来估算记录数。

这个统计信息就是索引的“区分度”。一个索引上不同的值越多(重复值越少),这个索引的区分度就越好。一个索引上不同的值的个数称为“基数”(cardinality)。这个基数越大,索引的区分度越好。

可以使用show index方法,看到一个索引的基数。虽然这个表的每一行的三个字段值都是一样的,但是在统计信息中,这三个索引的基数值并不同,而且其实都不准确。

MySQL得到索引基数的方法:

把整张表取出来一行行统计,虽然可以得到精确的结果,但是代价太高了,所以只能选择“采样统计”。

采样统计的时候,InnoDB默认会选择N个数据页,统计这些页面上的不同值,得到一个平均值,然后乘以这个索引的页面数,得到索引的基数。

数据表是会持续更新的,索引统计信息也不会固定不变。所以,当变更的数据行数超过N/M的时候,会自动触发重新做一次索引统计。

在MySQL中,有两种存储索引统计的方式,可以通过设置参数innodb_stats_persistent的值来选择:

设置为on:表示统计信息会持久化存储。这时,默认的N是20,M是10。

设置为off:表示统计信息只存储在内存中。这时,默认的N是8,M是16。

从图中看到,这次的索引统计值(cardinality列)虽然不够精确,但大体上还是差不多的,选错索引一定还有别的原因。

其实索引统计只是一个输入,对于一个具体的语句来说,优化器还要判断,执行这个语句本身要扫描多少行。

再看一下优化器预估的,这两个语句的扫描行数是多少。

rows这个字段表示的是预计扫描行数。

其中,Q1的结果还是符合预期的,key为NULL的时候,rows的值是104620;但Q2的rows值是37116,偏差就大了。而用explain命令看到的rows是只有10001行,是这个偏差误导了优化器的判断。

优化器为什么放着扫描37000行的执行计划不用,却选择了扫描行数是100000的执行计划?

如果使用索引a,每次从索引a上拿到一个值,都要回到主键索引上查出整行数据,这个代价优化器也要算进去的。如果选择扫描10万行,是直接在主键索引上扫描的,没有额外的代价。优化器会估算这两个选择的代价,从结果看来,优化器认为直接扫描主键索引更快。

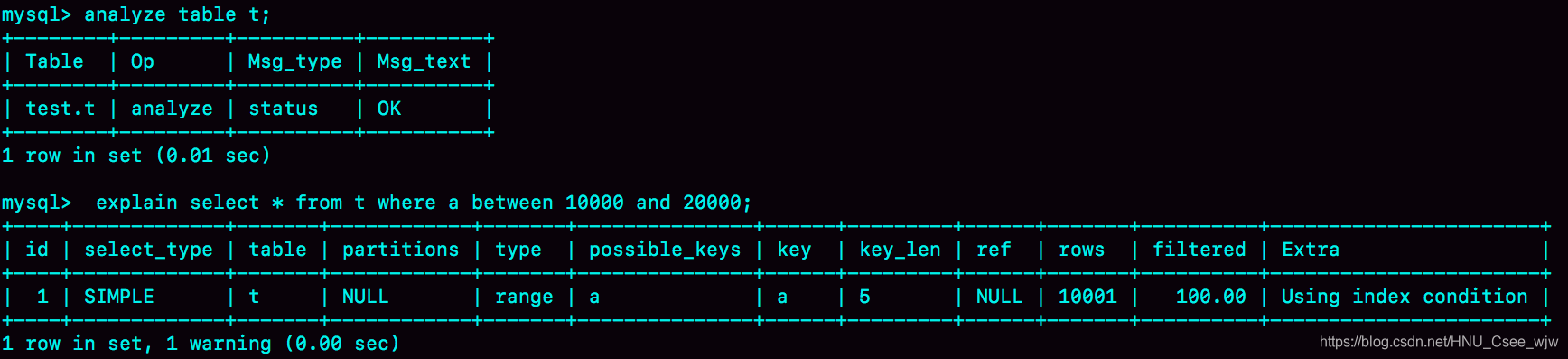

MySQL选错索引,主要原因还是没能准确地判断出扫描行数。analyze table t 命令,可以用来重新统计索引信息。

所以在实践中,如果发现explain的结果预估的rows值跟实际情况差距比较大,可以采用这个方法来处理。

其实,如果只是索引统计不准确,通过analyze命令可以解决很多问题,但优化器不止是看扫描行数。

依然是基于这个表t,另外一个语句:

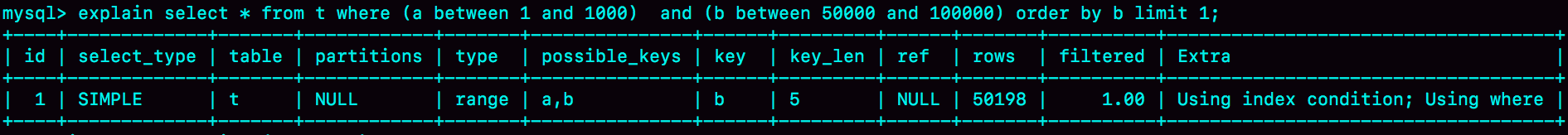

select * from t where (a between 1 and 1000) and (b between 50000 and 100000) order by b limit 1;

从条件上看,这个查询没有符合条件的记录,因此会返回空集合。

在开始执行这条语句之前,应选择哪一个索引?

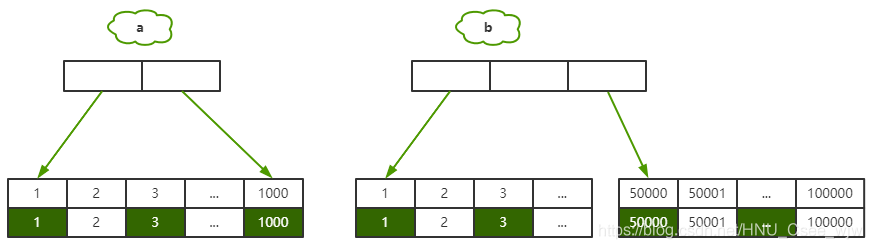

先看一下a、b这两个索引的结构图。

如果使用索引a进行查询,那么就是扫描索引a的前1000个值,然后取到对应的id,再到主键索引上去查出每一行,然后根据字段b来过滤。显然这样需要扫描1000行。

如果使用索引b进行查询,那么就是扫描索引b的最后50001个值,与上面的执行过程相同,也是需要回到主键索引上取值再判断,所以需要扫描50001行。

直观上的想法是:如果使用索引a的话,执行速度明显会快很多

explain select * from t where (a between 1 and 1000) and (b between 50000 and 100000) order by b limit 1;

可以看到,返回结果中key字段显示,这次优化器选择了索引b,而rows字段显示需要扫描的行数是50198。

从这个结果中,可以得到两个结论:

扫描行数的估计值依然不准确;

这个例子里MySQL又选错了索引。

3 索引选择异常和处理

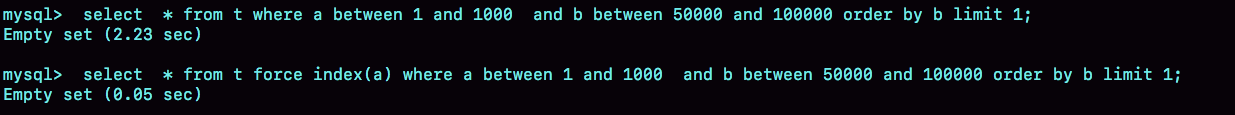

3.1 采用force index强行选择一个索引

MySQL会根据词法解析的结果分析出可能使用的索引作为候选项,然后在候选列表中依次判断每个索引需要扫描多少行。如果force index指定的索引在候选索引列表中,就直接选择这个索引。

可以看到,原本语句需要执行2.23秒,当使用force index(a)的时候,只用了0.05秒,比优化器的选择快了40多倍。

优化器没有选择正确的索引,force index起到了“矫正”的作用。

不过,数据库的问题最好还是在数据库内部来解决。

既然优化器放弃了使用索引a,说明a还不够合适,所以考虑修改语句,引导MySQL使用我们期望的索引。比如把order by b limit 1改成 order by b,a limit 1 ,语义的逻辑是相同的。

之前优化器选择使用索引b,是因为它认为使用索引b可以避免排序(b本身是索引,已经是有序的了),所以即使扫描行数多,也判定为代价更小。

现在order by b,a 这种写法,要求按照b,a排序,就意味着使用这两个索引都需要排序。因此,扫描行数成了影响决策的主要条件,于是此时优化器选了只需要扫描1000行的索引a。

当然,这种修改并不是通用的优化手段,只是刚好在这个语句里面有limit 1,所以,如果有满足条件的记录, order by b limit 1和order by b,a limit 1 都会返回b是最小的那一行,逻辑上一致,才可以这么做。

3.2 第二种方法

select * from (select * from t where (a between 1 and 1000) and (b between 50000 and 100000) order by b limit 100)alias limit 1;

用limit 100让优化器意识到,使用b索引代价是很高的。其实是根据数据特征诱导了一下优化器,也不具备通用性。

3.3 第三种方法

新建一个更合适的索引,来提供给优化器做选择,或删掉误用的索引。

这种情况其实比较少,尤其是经过DBA索引优化过的库,再碰到这个bug,找到一个更合适的索引一般比较难。

3.4 第四种方法

删掉索引b

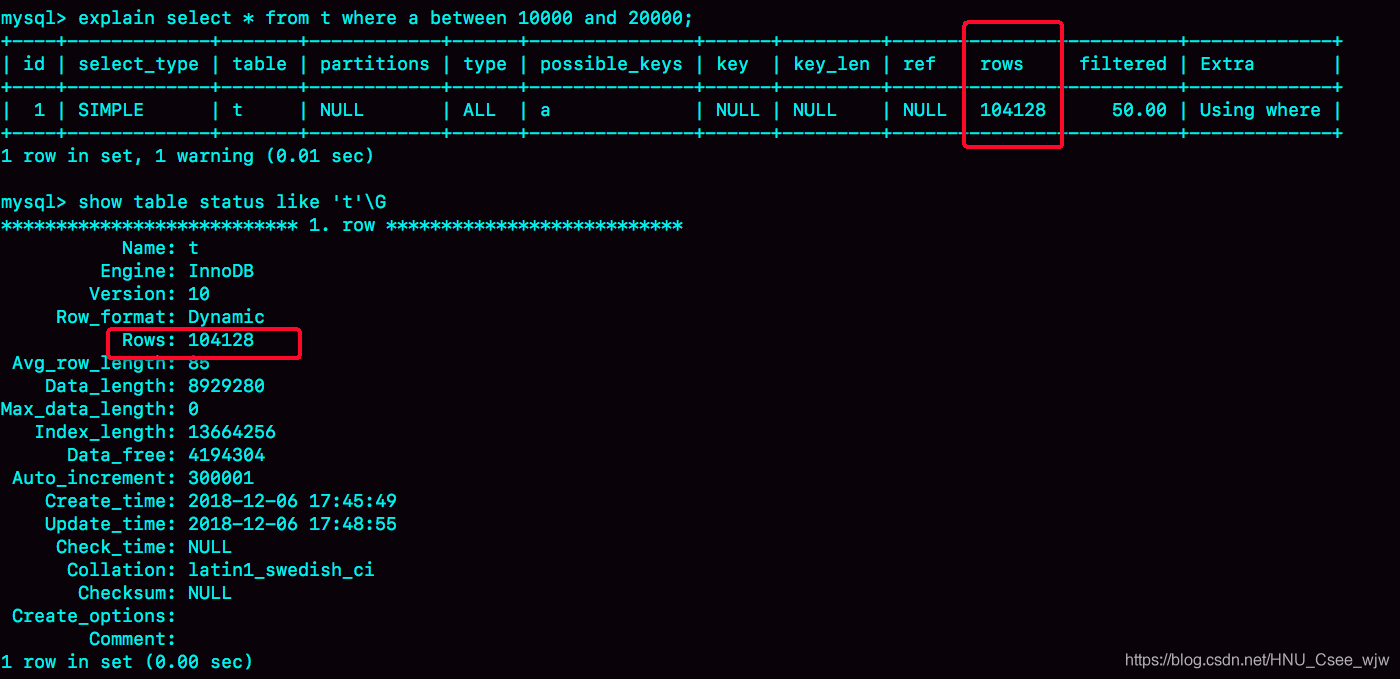

4 例子中force index(a)的扫描行数为什么是37000

在构造第一个例子的过程中,通过session A的配合,让session B删除数据后又重新插入了一遍数据,然后就发现explain结果中,rows字段从10001变成37000多。

delete 语句删掉了所有的数据,然后再通过call idata()插入了10万行数据,看上去是覆盖了原来的10万行。

但是,session A开启了事务并没有提交,所以之前插入的10万行数据是不能删除的。这样,之前的数据每一行数据都有两个版本,旧版本是delete之前的数据,新版本是标记为deleted的数据。

这样,索引a上的数据其实就有两份。

另外一个疑问:主键上的数据也没删,没有使用force index的语句,使用explain命令看到的扫描行数还是100000?

主键是直接按照表的行数来估计的。而表的行数,优化器直接用的是show table status的值。

本文同步分享在 博客“小王曾是少年”(CSDN)。

如有侵权,请联系 support@oschina.cn 删除。

本文参与“OSC源创计划”,欢迎正在阅读的你也加入,一起分享。

7021

7021

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?