报错情况

java.io.FileNotFoundException: /developer/apache-kylin-2.3.0-bin/tomcat/conf/.keystore (No such file or directory)

解决办法

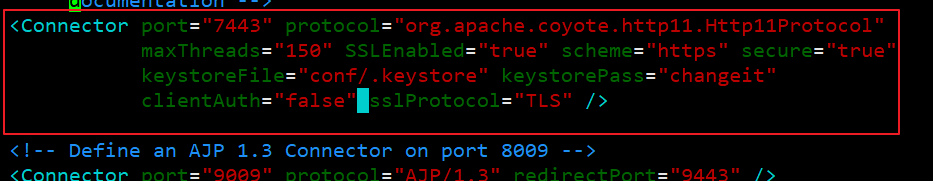

进入到 Kylin 目录下的 tomact 下 的conf , 然后打开 server.xml 文件

cd /opt/apache-kylin-2.6.4-bin/tomcat/conf

vim server.xml

将下图红框部分注释掉即可

推荐 :

1.Kylin踩坑笔记 - 启动Kylin出现Could not find or load main class org.apache.hadoop.hbase.util.GetJavaProperty

2.Kylin踩坑笔记 - 启动 Kylin 报错 org/apache/commons/configuration/ConfigurationException

3.Kylin踩坑笔记 - /developer/apache-kylin-2.6.2-bin/tomcat/conf/.keystore (No such file)

1559

1559

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?