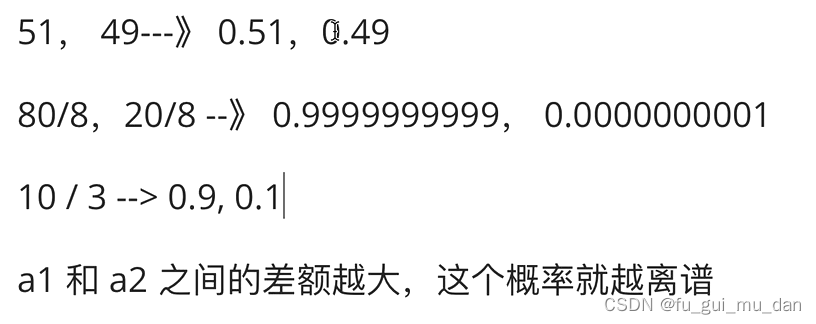

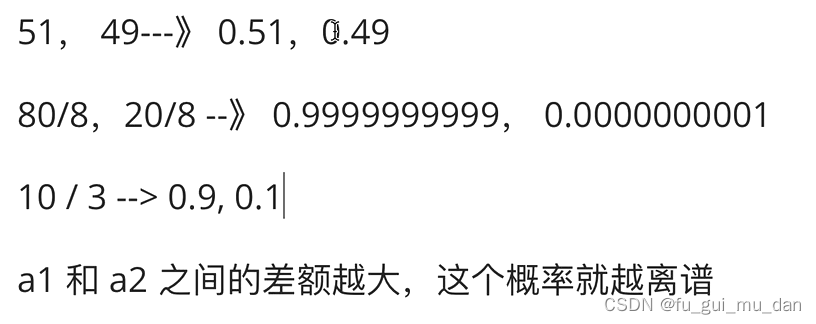

归一化就是除以key的维度的开根,防止q、k经过softmax后值无限接近1

dk = d_model / head

归一化就是除以key的维度的开根,防止q、k经过softmax后值无限接近1

dk = d_model / head

1万+

1万+

2633

2633

790

790

895

895

9347

9347

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?