最近一直在看虚拟人像.

最关键的论文就是wav2lip. 目前项目中也是用的这个. 一个视频加一个语音, 就可以生成用视频里面的头,加语音的新视频.

现在看这篇论文Seeing What You Said: Talking Face Generation Guided by a Lip Reading Expert.

主要是搜了没有相关论文, 所以就自己写一下笔记作为记录学习.

还是惯例,直接第三章走起.

3.1

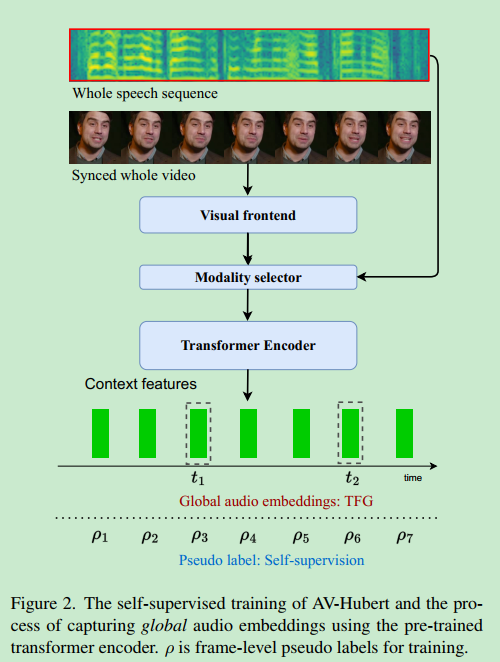

做一个lip reading expert. 使用AV-Hubert提供一个唇语阅读器. (也就是输入视频,返回里面说的文字)

看图的意思是这个模型输入video,输出音频.

3.2

音频编码器使用cnn和transfomer.

3.3

视频编码编码个人信息和姿态信息.

姿态信息是人脸下半部分挡住,不学嘴唇运动信息.

个人信息是视频里面随机片段.

3.4

第一个损失函数:

![]() 其中Ni是多少个

其中Ni是多少个

订阅专栏 解锁全文

订阅专栏 解锁全文

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?