这是多模态头发编辑工作。该工作以代理特征混合的方式将各种输入模态统一在了一个框架内,支持各种交互模态(如:文本、参考图像、遮罩、草图、RGB值等)来完成相应的头发编辑任务。 AI Tony老师来了!中科大&微软提出HairCLIPv2:大一统多模态头发编辑

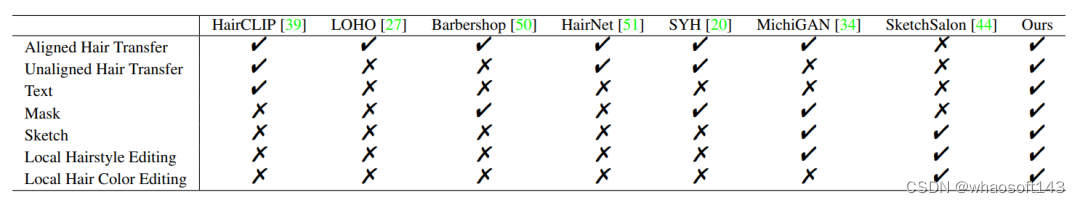

图1 HairCLIPv2以空前的交互模态支持发型、发色单独地或联合地编辑。

用自己的照片定制适合自己的专属发型!

论文标题: HairCLIPv2: Unifying Hair Editing via Proxy Feature Blending

作者单位: 中国科学技术大学,微软云AI,香港城市大学, 西安交通大学

录用信息: ICCV 2023

代码链接: https://github.com/wty-ustc/HairCLIPv2

论文链接: https://openaccess.thecvf.com/content/ICCV2023/papers/Wei_HairCLIPv2_Unifying_Hair_Editing_via_Proxy_Feature_Blending_ICCV_2023_paper.pdf

一、针对问题

在介绍HairCLIPv2之前首先来回顾下该团队的前作HairCLIP。HairCLIP首次将文本和参考图像统一在一个框架内完成头发编辑任务。尽管提出了第一个跨膜态头发编辑方法,HairCLIP依然存在一些不足,比如:

1)它不支持细粒度编辑交互方式,如:草图、遮罩等

2)在执行头发编辑的时候,因为潜空间(latent space)不完美的解耦,它不可避免地会修改其他无关属性

3)对于远离训练集分布的测试文本表现不佳,比如训练集中使用的文本是爆炸头,当测试文本是卷发的时候它表现还可以,但当测试文本换为完全不相关的文本比如锅盖头,它的表现就不能使人满意了

因此,该团队向前更进一步,提出了一个统一的头发编辑框架HairCLIPv2,解决了前面提到的所有问题,空前地支持任意交互模态,包括文本、参考图像、草图、遮罩、RGB值等,以及它们之间的组合。

二、核心思想

本方法依然使用在大规模人脸数据集上预训练的StyleGAN作为生成器。StyleGAN的合成过程涉及多个潜空间,每个潜空间都有很好的性质。而本文主要关注于F空间以及W+空间。

lF空间:StyleGAN的第7层空域特征组成的空间。它为了增加嵌入空间对于细节的表征能力以及允许图像特征的空域控制而提出。F空间有完美的重构能力同时支持真实的特征融合,也就是说我们在F空间把一个图像的脸与另一张图像的头发以mask blending的方式进行特征融合最后合成的结果是非常自然的,这也成为了目前头发转移(Hair Transfer)任务的主流范式。

lW+空间:W+空间是被GAN inversion方法从W空间扩展出来的一个空间。W+空间编码了丰富的解耦语义,适合编辑。

因此本方法思考能不能同时享受这两个空间最优秀的性质来为头发编辑任务所用呢?

因此,本方法为头发编辑任务提出了一个全新的视角和头发编辑范式。该方法核心的想法是将所有的头发编辑任务转化为头发转移任务,将输入图像转化为秃头代理从而去遮挡方便特征混合,将不同的编辑条件转化为相应的转移代理。即:先合成满足编辑条件的头发代理特征,然后将相应的头发编辑效果通过在发型或发色特征空间执行代理特征混合的方式转移到输入图像上完成头发编辑。这样不同的代理只需要负责自己那部分的任务,从而大大减轻了各自的压力,带来了更好的编辑效果和无关属性保留。

三、代理设计

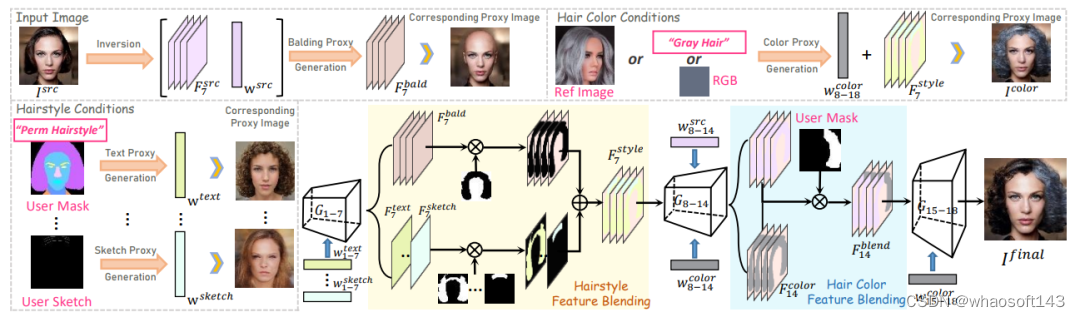

图2 HairCLIPv2概述图。

该例子以发型文本描述、草图、遮罩以及发色RGB值作为条件输入完成头发编辑。相应的代理图像只是为了方便理解。本方法通过将不同条件输入转化为不同的代理,通过在StyleGAN的特征空间以代理特征混合的方式完成头发编辑。

介绍完本方法的核心思想,下面的问题就是如何设计不同的代理。本方法为不同的代理根据它们自己独特的性质和负责的任务针对性的定制了生成方式。

- 秃头代理:它是为了去除头发区域的遮挡,完美保留非头发区域,从而方便后续与各种头发编辑代理进行特征混合。

- 文本代理:本方法把文本编辑代理的生成形式化为在W+空间中执行的基于CLIP损失指导的编辑任务。没有了无关属性保持的压力,该方法可以自由地选择更适合编辑的优化起点,从而带来了更好的编辑效果。

- 参考图像代理:通过完成非对齐的头发转移任务来生成该代理。

- 草图代理:本方法形式化它的生成为基于StyleGAN的图像翻译任务。另外,通过结合StyleGAN语义分层的机制,该方法首次在基于StyleGAN的框架内实现了局部头发编辑。

- 色彩代理:以优化的方式支持多种发色条件输入,比如文本、参考图像、RGB值等。

四、实验结果

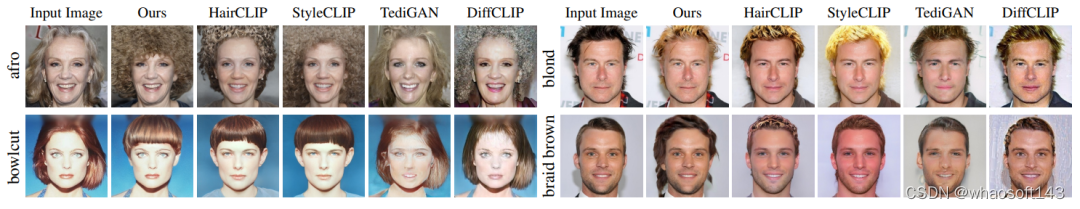

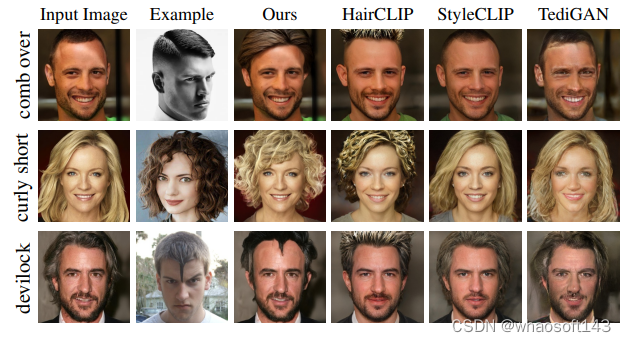

与相关工作的定性对比见图3-图7。本方法高质量地完成了相应的头发编辑任务。

图3 在HairCLIP训练集内,基于文本描述的头发编辑的定性对比

图4 在HairCLIP训练集外,基于文本描述的头发编辑的定性对比

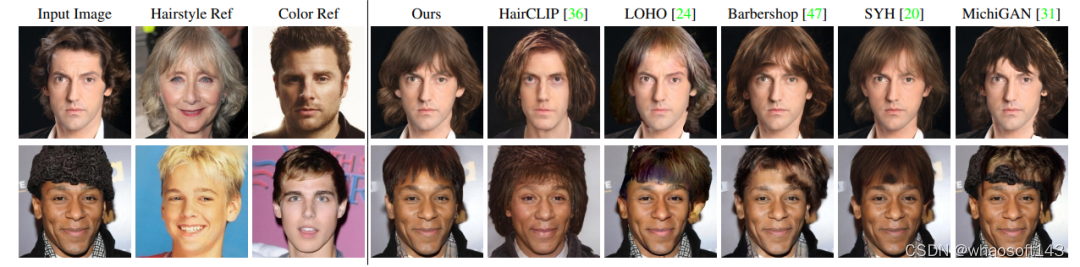

图5 基于参考图像的头发编辑的定性对比

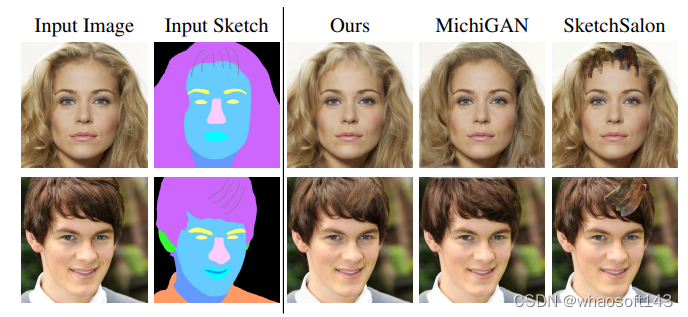

图6 基于草图的局部头发编辑的定性对比

图7 跨模态头发编辑的定性对比

五、总结

本工作提出了一个统一的头发编辑系统,它首次尝试同时支持简洁的交互方式(如文本、参考图像)以及细粒度的局部交互方式。该方法创新地将所有的头发编辑任务转化为头发转移任务,将相应的编辑条件转化为转移代理。在这种范式下,它不仅可以取得高质量的头发编辑效果,同时很好的保持了无关属性免受影响。未来,该团队希望以纯前传的方式来产生所有代理,从而实现实时的高质量头发编辑。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?