一、环境准备:

1、Linux+hadoop3.1+jdk1.8+xshell

2、虚拟机四台:

我的是:

Node02:192.168.191.152 主节点

Node03:192.168.191.153 从节点和SECONDARYNAMENODE

Node04:192.168.191.154 从节点

Node05:192.168.191.155 从节点

拓扑图如下:

二、创建虚拟机:

具体做法我的博客:

https://blog.csdn.net/weixin_41557853/article/details/86097196

三、免秘钥登录设置我的博客:

https://blog.csdn.net/weixin_41557853/article/details/86539417

记住,这里的免秘钥登录一定要做

1、你的主节点(namenode)需要免秘钥登录你的从节点,而且你的主节点也要免秘钥登录,因为你的主节点也要登录你的主节点。具体做法我博客里面有。

四、jdk环境变量配置,我的博客,伪分布式里面有

https://blog.csdn.net/weixin_41557853/article/details/86525542

五、hadoop配置

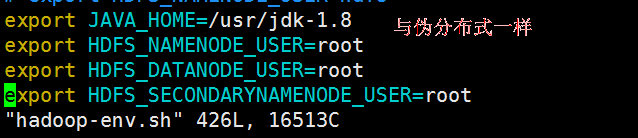

1、完全分布式与伪分布式配置的区别就是hadoop环境配置的不同

2、伪分布式:

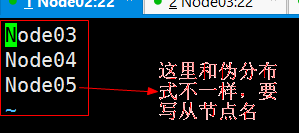

3、完全分布式,就是上面的完全分布式拓扑图

3、完全分布式,就是上面的完全分布式拓扑图

4、配置文件的配置

vim /opt/hadoop/etc/hadoop/hadoop-env.sh

vim /opt/hadoop/etc/hadoop/core-site.xml

vim /opt/hadoop/etc/hadoop/hdfs-site.xml

vim /opt/hadoop/etc/hadoop/workers

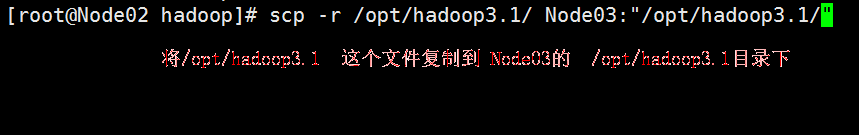

六、主节点hadoop配置完后,就开始分发复制(就是将Node02主节点里面的hadoop文件复制到各个从节点中),由于已经免秘钥登录了,所以直接进行命令copy就行了;

其他几个节点,一次这样做

七、启动测试:

1、初始化(只针对首次搭建好hadoop集群)

2、启动主节点

2、启动主节点

3、火狐客户端登录测试:

3、火狐客户端登录测试:

感觉满意,加个关注吧!!!!!!!!!!!!

786

786

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?