1. JDK介绍

1.1 什么是JDK?

SUN公司提供了一套Java开发环境,简称JDK(JavaDevelopmentKit),它是整个Java的核心,其中包括Java编译器、Java运行工具、Java文档生成工具、Java打包工具等。

SUN公司除了提供JDK,还提供了一种JRE(JavaRuntimeEnvironment)工具,它是Java运行环境,是提供给普通用户使用的。由于用户只需要运行事先编写好的程序,不需要自己动手编写程序,因此JRE工具中只包含Java运行工具,不包含Java编译工具。值得一提的是,为了方便使用,SUN公司在其JDK工具中自带了一个JRE工具,也就是说开发环境中包含运行环境,这样一来,开发人员只需要在计算机上安装JDK即可,不需要专门安装JRE工具了。

1.2 JDK版本介绍

SE(JavaSE),standard edition,标准版,是我们通常用的一个版本,从JDK 5.0开始,改名为Java SE。

EE(JavaEE),enterprise edition,企业版,使用这种JDK开发J2EE应用程序,从JDK 5.0开始,改名为Java EE。从2018年2月26日开始,J2EE改名为Jakarta EE [1-2]。

ME(J2ME),micro edition,主要用于移动设备、嵌入式设备上的java应用程序,从JDK 5.0开始,改名为Java ME。

2.1 官方下载JDK

https://www.oracle.com/technetwork/java/javase/overview/index.html打开JDK官网版本选择页面。我下载的版本是JDK8。

2.配置JAVA环境

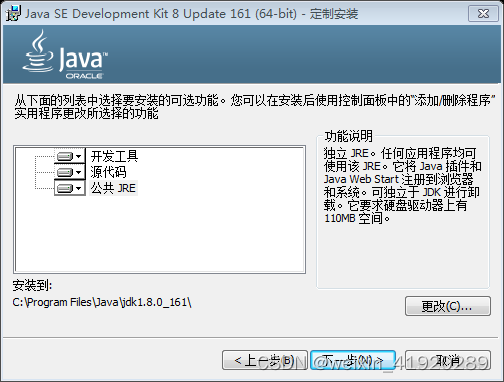

下面进入具体安装步骤(注意记录下JDK和JRE的安装路径)

2.1 系统环境变量新建JAVA_HOME环境变量

变量值为之前自己jdk的安装路径,如下:C:\Program Files\Java\jdk1.8.0_161

2.2 系统环境变量新建CLASSPATH环境变量

变量名 CLASSPATH ,变量值为:

.;%JAVA_HOME%\lib;%JAVA_HOME%\lib\tools.jar2.3 系统变量里变量为Path的行

找到,选中,并点击编辑,追加如下:

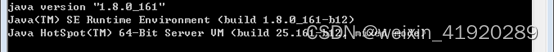

.;%JAVA_HOME%\lib;%JAVA_HOME%\lib\tools.jarCMD中运行java -version确认安装版本成功

3 安装编译软件eclipse

安装结束后确认下各个参数的版本相同

3.1 查看eclipse的jdk编译版本

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?