笼统地说特征值分解只能对应于方阵,而奇异值分解可以对应于任何的矩阵,奇异值分解的目的是用来做数据的降维处理,应用于推荐系统中时,由于用户和商品之间形成的矩阵时稀疏矩阵,可以降维之后得到商品的表达式, 我们有比较快的例子,奇异值分解习题

我们有比较快的例子,奇异值分解习题

但是呢,

有两种推断奇异值分解的方法:我更加i青睐于第一种,

[机器学习笔记]奇异值分解SVD简介及其在推荐系统中的简单应用

以下是第二种:

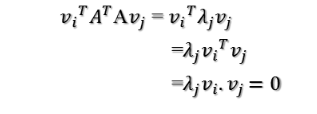

是先用特征值分解,用对称矩阵进行变换,

奇异值分解(SVD)原理详解及推导

其中有涉及到旋转矩阵

矩阵乘法:

只是对vi的由来没有描述很清楚,为什么会有

我始终没有弄得很清楚,

但是在第一篇文章中的:

才让我知道了vi的由来。

PCA

见马同学高等数学中的专栏,

2262

2262

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?