真是…太难了………………

————————————————————————————

直接安装

步骤: cmd ----->pip install scrapy

等一段时间后……

安装失败了

二次安装

步骤: 先安装scrapy依赖的库twisted,再安装scrapy

执行:

- 在此可下载https://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted 。注选取和自己所安装的python版本等同的文件

- 以管理员身份运行cmd

- 安装wheel库,为后面安装whl文件做准备,执行命令:pip install wheel

- 安装twisted,执行命令:pip install + twisted文件位置

- 最后按章scrapy,执行命令: pip install scrapy

- 安装成功

注:在安装过程中会遇到一些小问题

问题一: pip命令执行成功后出现 WARNING,如:

WARNING: You are using pip version 19.3.1, however version 20.0.2 is available. You should conside

原因: 这是由于pip版本太低的缘故

解决: 升级pip版本

命令一:python -m pip install --upgrade pip

命令二:python -m pip install -U pip

命令三:python -m pip install -U --force-reinstall pip

以上命令使用其中一个即可,我使用的命令二,问题解决

问题二: 使用上述方法后仍安装不成功

原因: 仍需要其他库

lxml下载地址

pywin32下载地址

按照上述方法安装与自己python相对应版本的库

然后就安装成功了

接下来信心满满的打开vscode,写一个爬虫试试……

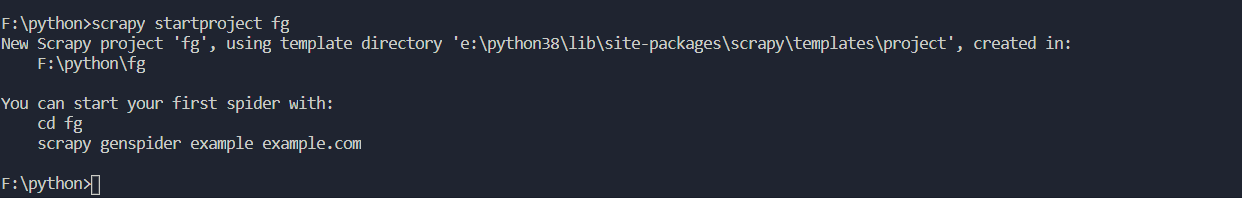

ctrl + ~ 打开终端,输入:scrapy startproject + 项目名字 回车

Fatal error in launcher: 启动程序中的致命错误

查了一部份资料后也没有解决

终于: 既然是启动程序的错误,那一般都是全限问题

查看vs Code的终端调用

正是cmd,应该是VS code未有管理员全限,所以启动不了文件,故以管理员身份启动VS code,再次运行……

创建成功

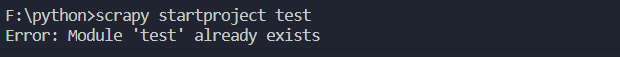

注:使用文件名未test创建不会成功:

创建成功后,写好自己的代码

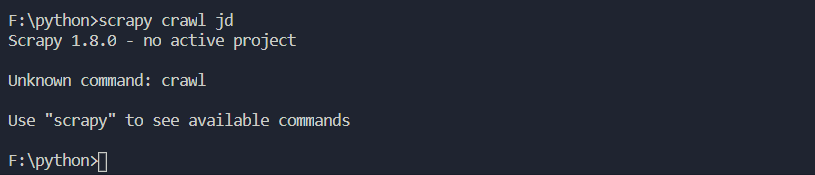

启动爬虫scrapy crawl + 项目名:

启动失败,百度中都说 缺少scrapy.cfg 文件

但我文件中有,那就有可能是文件找不到 scrapy.cfg

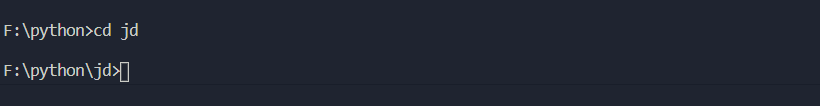

然后执行启动命令:

运行成功!!!!!!!

最后感谢大佬们的分享

2449

2449

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?