目录

1. 背景知识:LR/GLM应用场景及原理

1.1 LR/GLM 应用场景

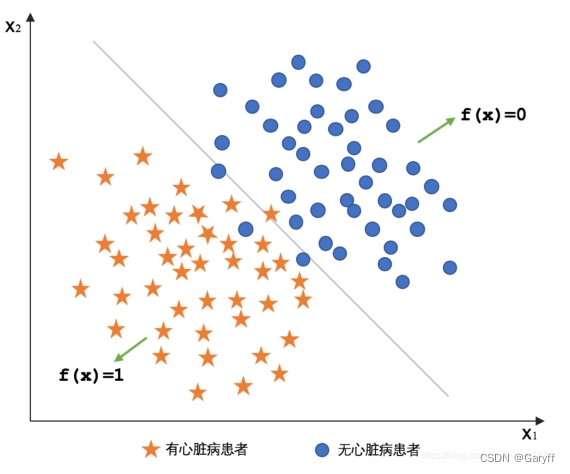

- 二分类问题:逻辑回归

对数据进行二元分类,如对病人是否患病进行诊断。

预测某件事情发生的概率,如预测一个网站的用户变为付费用户的概率。

- 广义线性模型(GLM):风险保费预测,根据需要提供的保障责任,计算预期总索赔额。有两种方式:

- 直接对纯保费建模,服从tweedie分布(1,2)

- 通过两步建模间接近似:纯保费 = 索赔次数 * 平均索赔金额 (其中,索赔次数服从泊松分布、负二项分布,平均索赔金额服从伽马分布、逆高斯分布)

1.2 LR/GLM 原理

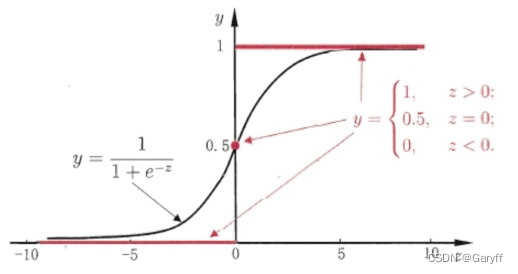

- LR(GLM的一种基本形式)

其假设响应变量Y的真实值由系统组件(system component)和误差组件(error component)组成。其中系统组件为一个线性预测器(数值项,可拟合),误差组件为白噪声,服从高斯随机分布

。故响应变量Y的条件分布为高斯分布:

- GLM

GLM允许误差项的概率分布扩展为指数分布族:伯努利分布(逻辑回归)、泊松分布、Gamma分布、复合泊松Gamma分布、Tweedie分布等。

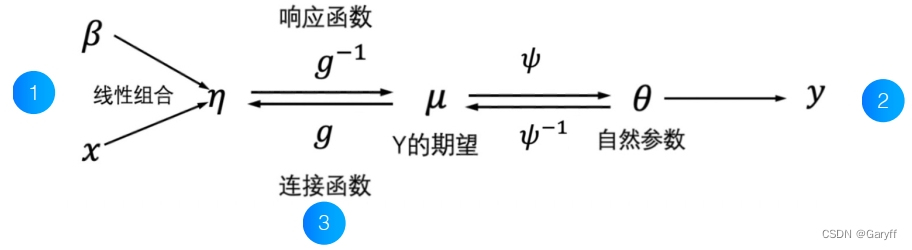

一个广义线性模型有三个关键组件:

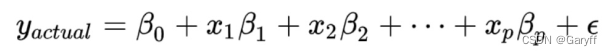

- 系统组件:一个线性预测器

,x为自变量,

是定义的未知参数。

- 随机组件:一个指数族分布作为响应变量Y的概率分布

,

是分布的自然参数,

和

存在一一映射关系,用函数

表示关系。

- 连接函数:使得

,描述系统组件和随机组件之间的关系

2. 密态SSLR/SSGLM

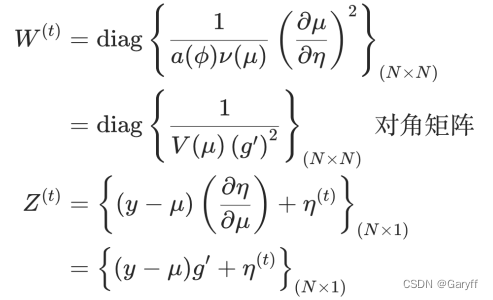

- 广义线性模型参数估计

一阶优化器:SGD参数估计方法

二阶优化器:迭代重加权最小二乘法(IRLS)

参数的迭代公式:

![]()

其中,

较一阶优化器而言, 二阶优化器初始化准确、收敛速度快但计算、通信复杂度较高。

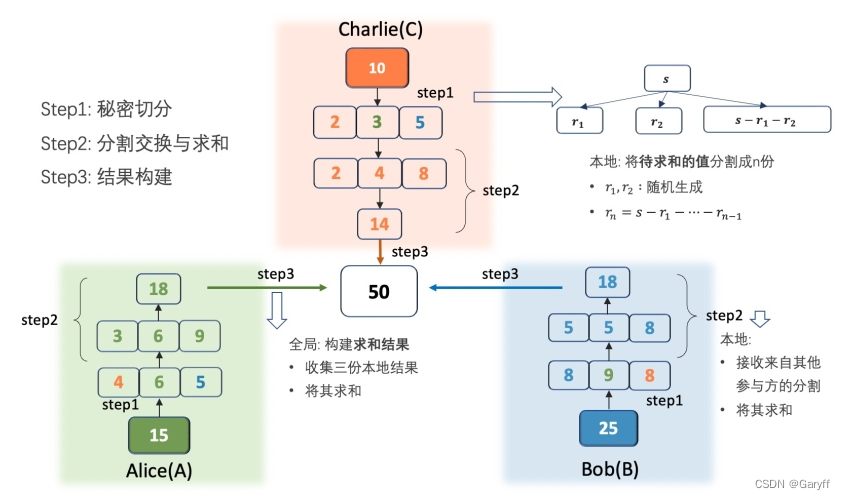

- 秘密分享加法

各参与方不知道其他参与方的秘密数值,也不需要第三方机构作为中立参与方参与。

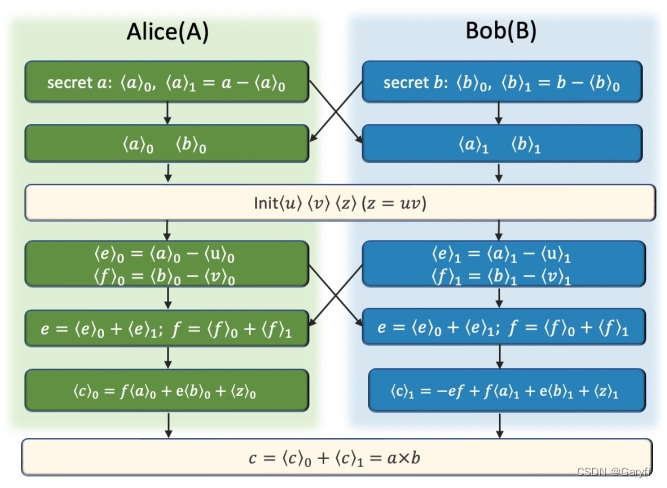

- 秘密分享乘法

3. 从理论到隐语应用

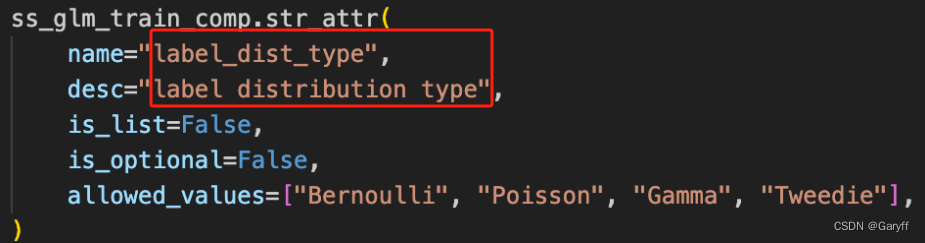

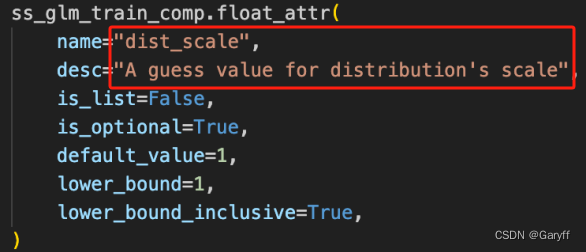

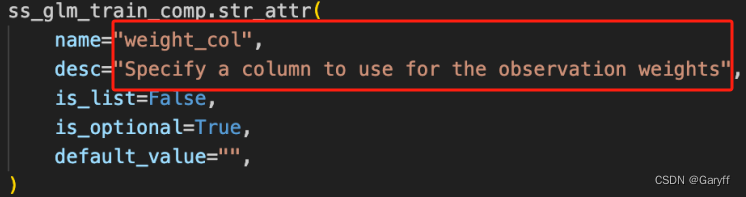

3.1 SSGLM参数解析

- 选择建模标签分布类型

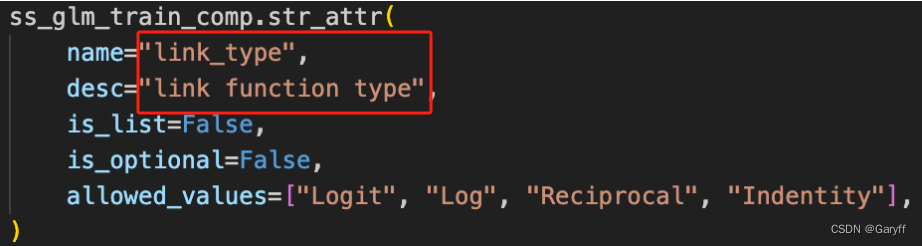

- 选择连接函数

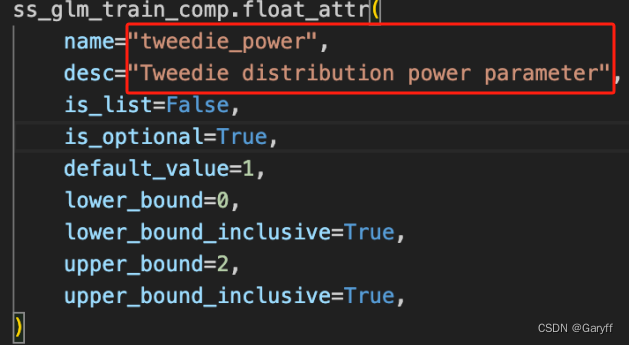

- 若选择Tweedie分布,对p调参

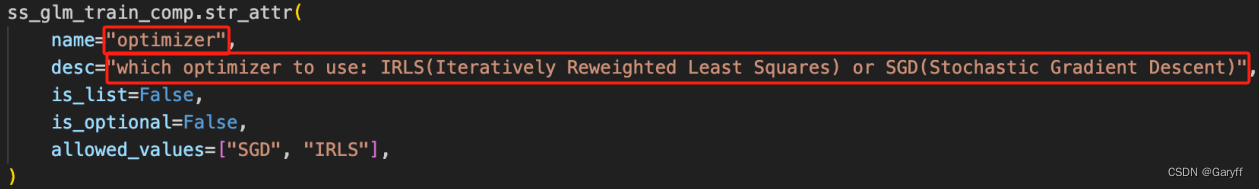

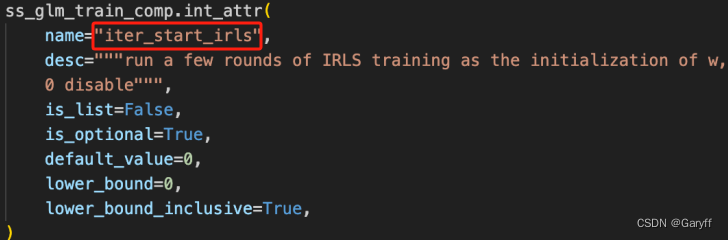

- 优化器

- 偏置

- 描述方差(默认值为1,根据不同数据不同)

- 对数据加权

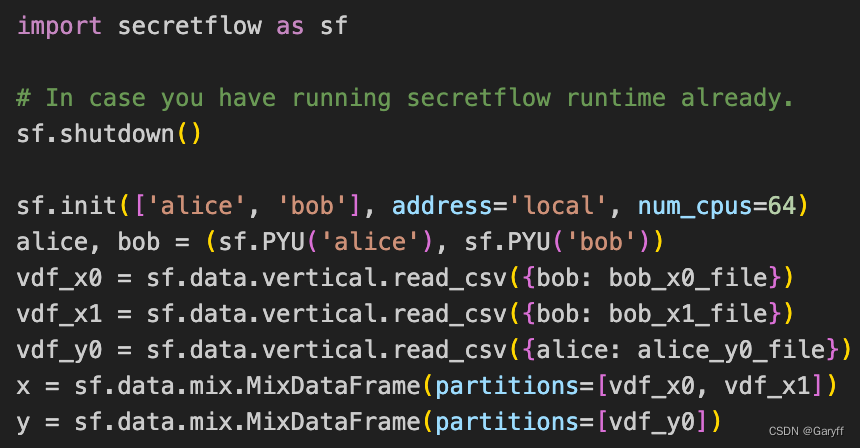

3.2 使用SSLR

Step1:准备SPU和归一化数据

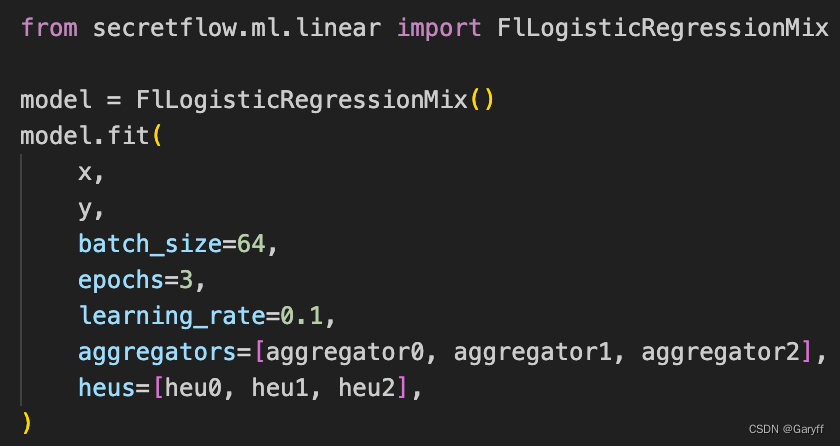

Step2: 模型训练

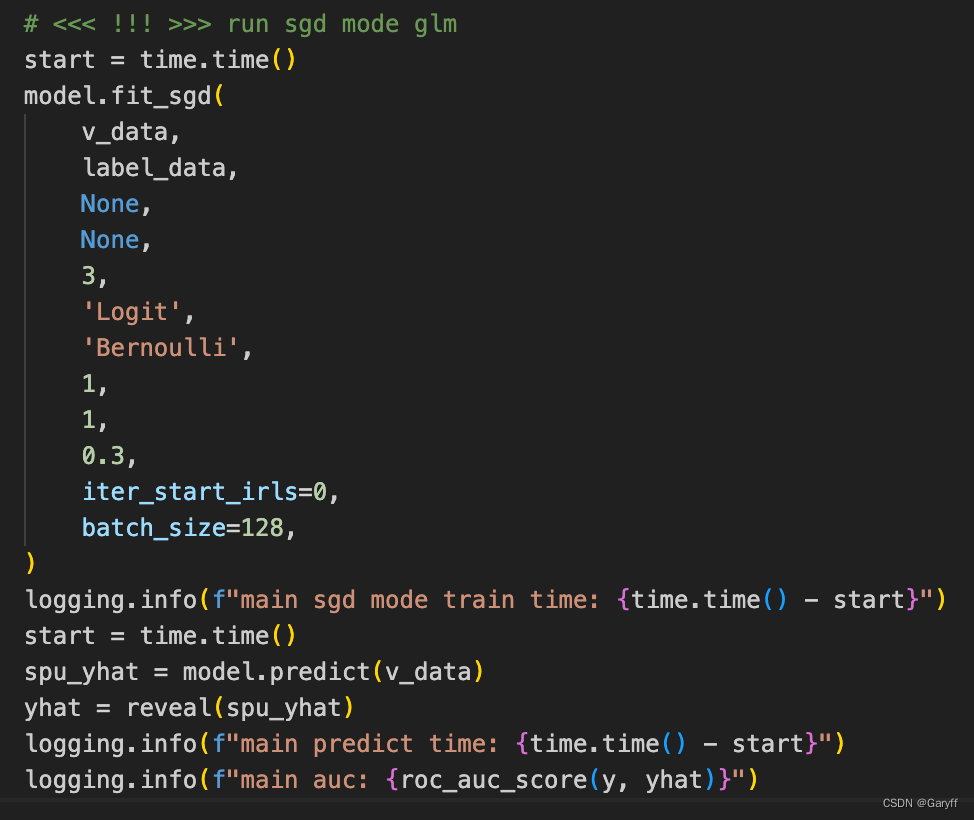

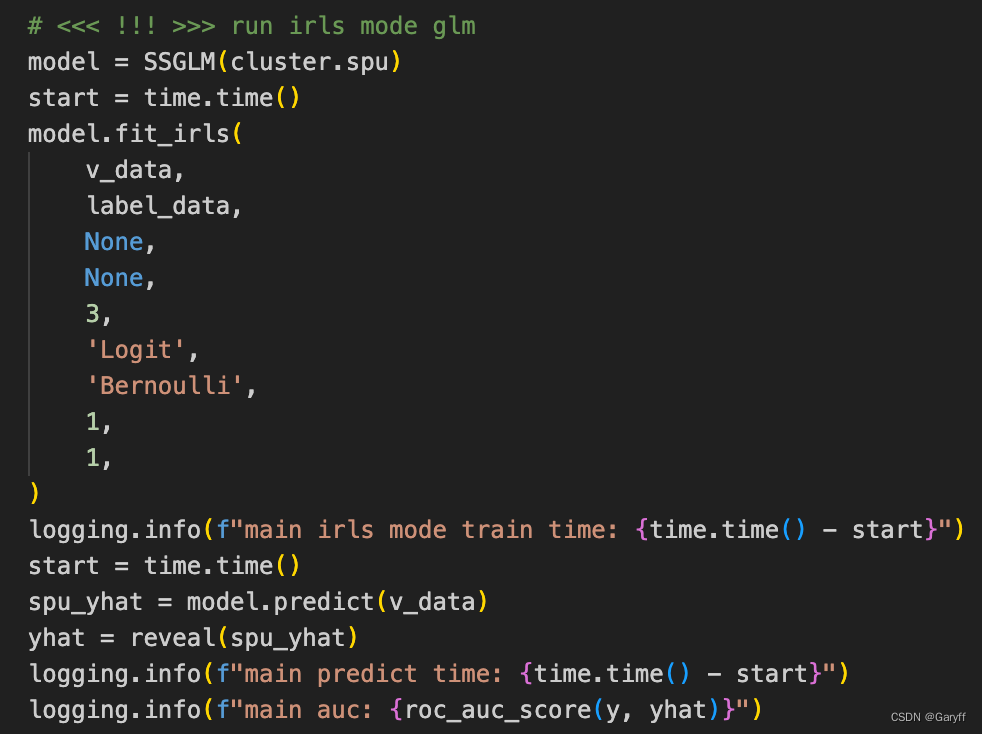

(可选)SGD/IRLS优化器进行模型训练

Step3:模型评估

4. 小结

本篇文章介绍了LR和GLM的原理以及实际应用,介绍了广义线性模型的参数估计方法以及秘密乘加的原理。介绍了隐语中使用SSGLM模型的相关参数定义以及SSLR的使用方法。

(PS:感谢您看到这里,坚持不易,谢谢您的支持鼓励!!!)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?