1. 下载spark安装包

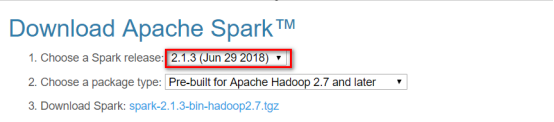

下载地址Spark官网:Spark官网安装包,这里我们使用 spark-2.1.3-bin-hadoop2.7版本。

2. 规划安装目录

/export/servers

3. 解压安装包

tar -zxvf spark-2.1.3-bin-hadoop2.7.tgz

4. 重命名解压后的目录

mv spark-2.1.3-bin-hadoop2.7 spark

5. 修改配置文件

配置文件目录在 /export/servers/spark/conf

vi spark-env.sh修改文件(先把spark-env.sh.template重命名为spark-env.sh)

#配置java环境变量

export JAVA_HOME=/opt/bigdata/jdk1.7.0_67

#指定spark老大Master的IP

export SPARK_MASTER_HOST=node1

#指定spark老大Master的端口

export SPARK_MASTER_PORT=7077

vi slaves修改配置文件(先把slaves.template重命名为slaves)

node02

node03

6. 拷贝配置到其他主机

通过scp命令将spark的安装目录拷贝到其他机器上

scp -r /export/servers/spark node02:/export/servers

scp -r /export/servers/spark node03:/export/servers

7. 配合spark环境变量

将spark添加到环境变量,添加以下内容到/etc/profile

export SPARK_HOME=/export/servers/spark

export PATH=$PATH:$SPARK_HOME/bin

8. 启动spark

- 在主节点上启动spark

/export/servers/spark/sbin/start-all.sh

9. 停止spark

- 在主节点上停止spark机器

/export/servers/spark/sbin/stop-all.sh

10. spark的web界面

正常启动spark集群后,可以通过访问spark的web界面,查看相关信息。

972

972

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?