1、修改mapred-site.xml

这里的mapred-site的路径要注意自己hadoop安装的路径

vim /usr/local/src/hadoop/hadoop-2.10.2/etc/hadoop/mapred-site.xml

<!-- 历史服务器端地址 -->

<property>

<name>mapreduce.jobhistory.address</name>

<value>hadoop100:10020</value>

</property>

<!-- 历史服务器 web 端地址 -->

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>hadoop100:19888</value>

</property>

2、分发给其他两台服务器

scp /usr/local/src/hadoop/hadoop-2.10.2/etc/hadoop/mapred-site.xml root@hadoop101:/usr/local/src/hadoop/hadoop-2.10.2/etc/hadoop

scp /usr/local/src/hadoop/hadoop-2.10.2/etc/hadoop/mapred-site.xml root@hadoop102:/usr/local/src/hadoop/hadoop-2.10.2/etc/hadoop

3、重启dfs

启动文件可以看具体根据自己安装路径

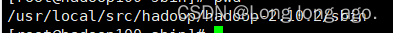

/usr/local/src/hadoop/hadoop-2.10.2/sbin

stop-dfs.sh

start-dfs.sh

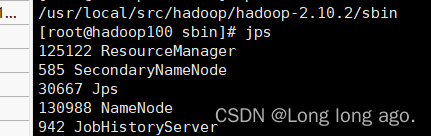

4、启动histroyserver

mr-jobhistory-daemon.sh start historyserver

创建hadoop /input和cls.txt文件

hadoop fs -mkdir /input

/root/cls.txt是linux服务器的路径

hadoop fs -put /root/cls.txt /input

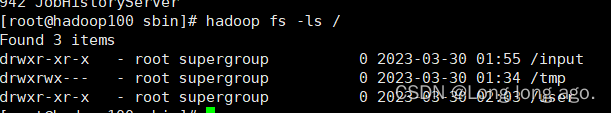

查看hdfs路径

hadoop fs -ls /

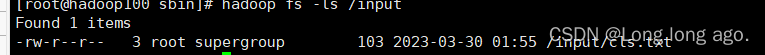

查看hdfs路径

hadoop fs -ls /input

cls.txt内容

sprak sprak hive hadoop netty sprak sprak hive hadoop netty sprak hive hadoop netty hive hadoop netty

运行例子,要注意jar包名称和路径

hadoop jar /usr/local/src/hadoop/hadoop-2.10.2/share/hadoop/mapreduce/hadoop-mapreduce-examples-2.10.2.jar wordcount /input/cls.txt output

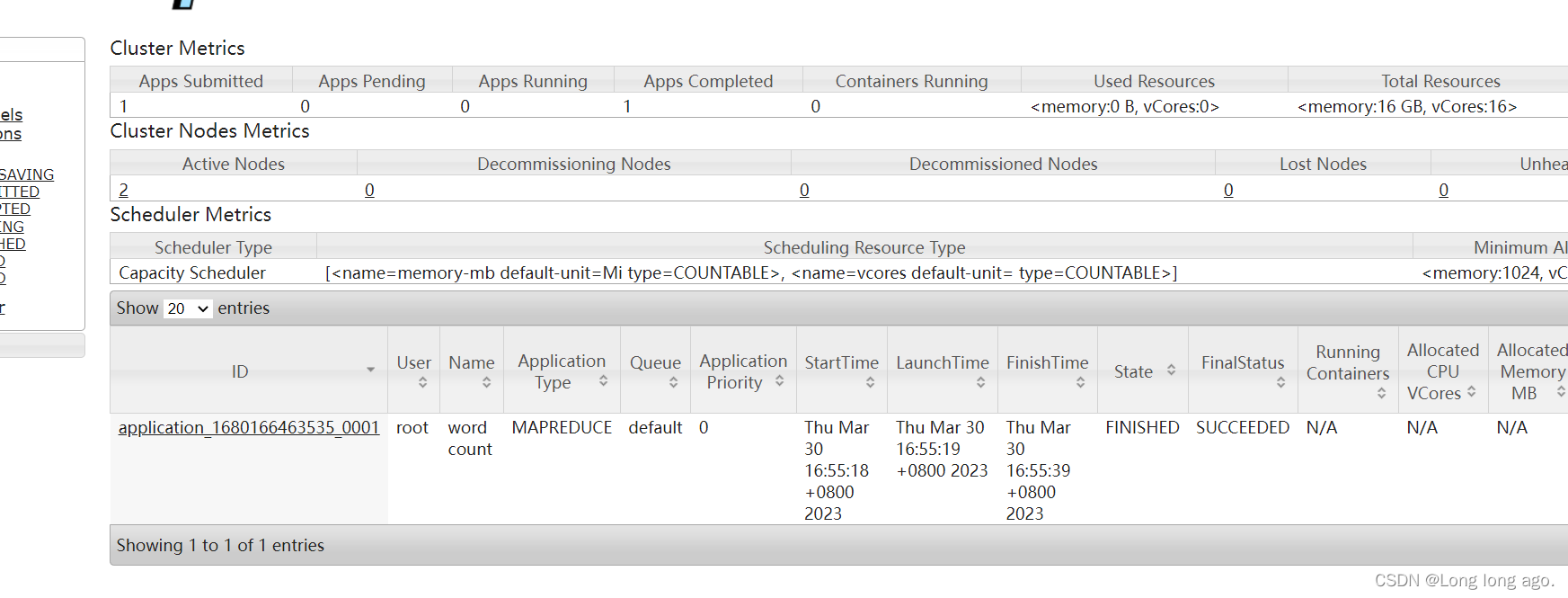

已成功

1693

1693

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?