1.为啥什么要使用WorkFlow?

生产中ETL、以及HIve sql等作业都是通过shell命令触发运行的,我们知道Linux有自带的Crontab调度器,通过它可以进行简单作业的调度,但是对于一些依赖的作业,比如作业B依赖于作业A完成后才能开始,这是Crontab很难去配置了,因为配置Crontab人根本不知道作业具体是何时完成的,全凭经验感觉,这是不可取的。此时我们需要Work Flow来规划好作业的执行调度。

市场主流的工作流有两种:Oozie以及Azkzban。

2.常用工作流对比

- Oozie:重量级的,不推荐使用,开发需要写一堆XML配置,非常的麻烦,生产上面如果用CM的话,Oozie可以直接配的(在HUE里)

- Azkzban:轻量级的,推荐使用,具有很好的WEBUI交互设计,但是也是比较难用,部分功能需要自定义开发,如无短信通知功能。

3.Azkaban简介

Scheduler调度框架

- 首先它不是apache项目,但属于开源项目,官网地址:https://azkaban.github.io/

- 它是用于运行hadoop生态圈相关作业的批量工作流调度器,主要用于解决作业间的依赖关系来解决顺序问题,它提供了- 一个良好的Web操作界面。

- 两种部署模式:无论哪一种部署模式都会包含所有的特性

solo-server mode :单机模式,内置了H2数据库,web和executor服务运行在一个进程上,可用于测试,本次测试部署的是单机模式,

multiple-executor mode:集群模式,DB使用的是有主备的mysql,升级维护不影响使用,用于生产

这里引申出来一个问题:生产上web server and executor server需不需要HA

executor server是可以配多个

- 具体特性可参考官网

4.安装Azkabab

安装以3.81.0版本的Azkabab需要有jdk1.8、gradle、git环境,gradle是类似于maven一样的jar依赖管理工具。

4.1下在安装包

-

下载Azkabab:前往github,注意不要选择pre-XXX开头的版本包,这里我选的是最新的3.81.0

-

下载gradle:官网地址,我这里下载的是4.6版本

4.2配置gradle安装包

#解压

[hadoop@hadoop001 ~]$ tar -zxvf ~/soft/azkaban-3.81.0.tar.gz -C ~/source/

#使用gradlew编译时会自动下载的gradle,但是太慢了,我们选择手动下载然后拷贝到wrapper目录

[hadoop@hadoop001 source]$ cp ~/soft/gradle-4.6-all.zip ~/source/azkaban-3.81.0/gradle/wrapper/

[hadoop@hadoop001 ~]$ cd ~/source/azkaban-3.81.0/gradle/wrapper/

[hadoop@hadoop001 wrapper]$ ll

total 104284

-rw-r--r-- 1 hadoop hadoop 106724289 Apr 16 07:52 gradle-4.6-all.zip

-rw-rw-r-- 1 hadoop hadoop 54708 Dec 5 20:06 gradle-wrapper.jar

-rw-rw-r-- 1 hadoop hadoop 779 Dec 5 20:06 gradle-wrapper.properties

#修改distributionUrl配置

[hadoop@hadoop001 wrapper]$ vi gradle-wrapper.properties

distributionUrl=gradle-4.6-all.zip

4.3安装git

#注意使用root

[root@hadoop001 ~]$ yum install -y git

[root@hadoop001 ~]# git --version

git version 1.7.1

4.4编译以及安装

编译命令:./gradlew build installDist -x test,-x test表示跳过测试,跳过测试可大大降低编译所需要的时间。

#编译,编译需要下载依赖的包,故需要等待会儿,首先要装gradlew

[hadoop@hadoop001 ~]$ cd /home/hadoop/source/azkaban-3.81.0/

[hadoop@hadoop001 azkaban-3.81.0]$ ./gradlew build installDist -x test

#若遇到如下异常

FAILURE: Build failed with an exception.

What went wrong:

Execution failed for task ':az-crypto:test'.

> There were failing tests. See the report at: file:///home/hadoop/source/azkaban-3.57.0/az-crypto/build/reports/tests/test/index.html

#通过查阅子资料分析得知,缺少了jce,下载地址:https://www.oracle.com/technetwork/cn/java/javase/downloads/jce8-download-2133166-zhs.html ,解压并放在jre相关目录

[root@hadoop001 soft]# unzip jce_policy-8.zip

[root@hadoop001 soft]# cd UnlimitedJCEPolicyJDK8/

[root@hadoop001 UnlimitedJCEPolicyJDK8]# ll

total 16

-rw-rw-r--. 1 root root 3035 Dec 21 2013 local_policy.jar

-rw-r--r--. 1 root root 7323 Dec 21 2013 README.txt

-rw-rw-r--. 1 root root 3023 Dec 21 2013 US_export_policy.jar

[root@hadoop001 soft]# cp UnlimitedJCEPolicyJDK8/* /usr/java/jdk1.8.0_45/jre/lib/security/

还有报错的话可以使用以下方法:

安装 ca-certificates :yum install ca-certificates

更新本地证书库: update-ca-trust -h

update-ca-trust check

update-ca-trust enable

//以上的问题都是服务器配置混乱,网络不通畅导致

#重新编译

[hadoop@hadoop001 azkaban-3.57.0]# ./gradlew build installDist -x test

BUILD SUCCESSFUL in 49m 42s

105 actionable tasks: 105 executed

[hadoop@hadoop001 azkaban-3.81.0]$

#查看部署包,azkaban-solo-server-0.1.0-SNAPSHOT.tar.gz为单机部署的包

[hadoop@hadoop001 azkaban-3.81.0]$ cd azkaban-solo-server/build/distributions/

[hadoop@hadoop001 distributions]$ ll

total 71060

-rw-rw-r-- 1 hadoop hadoop 36313361 Apr 16 09:17 azkaban-solo-server-0.1.0-SNAPSHOT.tar.gz

-rw-rw-r-- 1 hadoop hadoop 36449964 Apr

#解压

[hadoop@hadoop001 distributions]$ mv azkaban-solo-server-0.1.0-SNAPSHOT.tar.gz ~/soft/

[hadoop@hadoop001 distributions]$ cd ~/soft/

[hadoop@hadoop001 soft]$ tar -zxvf azkaban-solo-server-0.1.0-SNAPSHOT.tar.gz -C ~/app/

#启动,注意要在安装目录启动,踩坑

[hadoop@hadoop001 azkaban-solo-server-0.1.0-SNAPSHOT]$ bin/start-solo.sh

[hadoop@hadoop001 azkaban-solo-server-0.1.0-SNAPSHOT]$ jps

7882 AzkabanSingleServer

7899 Jps

#关闭命令

[hadoop@hadoop001 azkaban-solo-server-0.1.0-SNAPSHOT]$ bin/shutdown-solo.sh

#(可选操作)修改配置文件,修改首页显示信息

azkaban.name=FWZ Test

azkaban.label=FWZ study Azkaban

#(可选操作)修改配置文件,添加登录的用户fwz

[hadoop@hadoop001 conf]$ vi azkaban-users.xml

<user password="123456" roles="admin" username="fwz"/>

5.简单使用Azkabab

Azkabab的主页地址:http://hadoop001:8081/

5.1创建项目

创建了一个personal类型项目,名称为fwztestProject

5.2创建一个简单flow

一个flow是由.project以及.flow两个文件构成

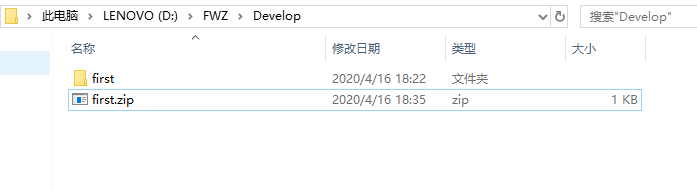

创建一个first目录,下面存放两个两个文件,也是Azkaban需要的两个文件:basic.flow和flow20.project

flow20.project的文件内容:

azkaban-flow-version: 2.0

- 编辑basic.flow,basic则是flow的名称配置具体作业信息,作业名jobA,作业的类型命令,作业配置,执行的命令

basic.flow的文件内容:

name:作业名

type:命令类型,比如comand

commond:这里输出了一句话This is an echoed text

nodes:

- name: jobA

type: command

config:

command: echo "This is an echoed text." >> /home/hadoop/data/azkabantest/job1.txt

- 将first目录打成zip包上传到Azkaban

- 运行flow,succeeded表示运行成功

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-zmvGF1Mn-1587023110562)(https://s2.ax1x.com/2019/05/14/EomPFs.md.png)]](https://img-blog.csdnimg.cn/20200416183710351.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80MzIxMjM2NQ==,size_16,color_FFFFFF,t_70)

比较奇怪,我的文件并没有输出到文本中,但是我换了一个其它命令是可以运行的。

5.2创建一个多job的flow

新建一个dependency目录,下面两个文件,主要编辑basic.flow文件

- 编辑flow文件

nodes:

- name: jobC

type: noop

# jobC depends on jobA and jobB

dependsOn:

- jobA

- jobB

- name: jobA

type: command

config:

command: echo "This is an echoed text."

- name: jobB

type: command

config:

command: pwd

type:noop表示无操作,dependson表示作业的依赖关系

- 编辑project文件

azkaban-flow-version: 2.0

- 运行flow,succeeded表示运行成功,下图是作业间的依赖关系

5.3创建一个wc的MR任务的flow

wc使用的是hadoop自带的example的jar包

- 编辑flow文件

nodes:

- name: jobA

type: command

config:

command: /home/hadoop/app/hadoop-2.6.0-cdh5.7.0/bin/hadoop jar /home/hadoop/app/hadoop-2.6.0-cdh5.7.0/share/hadoop/mapreduce/hadoop-mapreduce-examples-2.6.0-cdh5.7.0.jar wordcount file:///home/hadoop/data/azkabantest/word.txt file:///home/hadoop/data/azkabantest/output1

type:noop表示无操作,dependson表示作业的依赖关系

- 编辑project文件

azkaban-flow-version: 2.0

- 将文件夹打zip包上传运行。WC是MR任务,运行时启动是需要一定时间的

- 查看结果

[hadoop@hadoop001 azkabantest]$ ll output1/

total 4

-rw-r--r--. 1 hadoop hadoop 65 May 3 00:27 part-r-00000.bz2

-rw-r--r--. 1 hadoop hadoop 0 May 3 00:27 _SUCCESS

[hadoop@hadoop001 azkabantest]$ vim output1/part-r-00000.bz2

hao 2

he 1

hello 1

hellow 1

ni 1

word 3 、

5.4 如何修改已经上传的flow?

5.5 如何给flow添加调度?

如下图,可非常方便的为flow添加相应的调度

5.6 如何给调度配置邮箱告警?

如下图,可以根据不同的规则配置告警信息.

5.7 如何只跑flow中的某个作业?

如下图,下来列表中的job点击相应的run即可,在某个作业跑挂了,修复数据是方便。

5.8关于flow执行的一些有用的配置

- Page View:(重要)作业的执行视图,可知设置哪些作业执行哪些不执行

- Notification:设置邮件通知,在workfow执行成功或者失败时都可以设置邮件通知

- Failure Option:(重要)某个作业执行失败时操作,生产上选择Cancel - - All,kill所有的作业不管跑没跑

- concurrent:设置工作流的并发

- Flow Parameters:设置工作流的参数,覆盖是全局的setting

总结:

- 以上是Azkaban的安装以及简单使用的过程,无论是学习还是生产使用都是有很大的帮助,

- 对于生产上Oozie与Azkaban的选择,个人倾向于更加轻量简单的后者

- 两种工作流框架都是有个致命的缺点,不能完全的面向用户,用户是不知道hadoop.jar那些东西的,若用户能够在页面拖拽拉实现flow的配置那就更加的完美了,而且还要集成短信,故大公司都是自研工作流框架。

1082

1082

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?