在上一篇文章中,我搭建好了mysql80数据库,而在这篇文章中,我们会使用到mysql搭建hive。

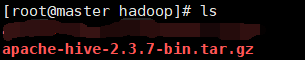

对于Hive的搭建,我们需要准备的材料有:hive包:apache-hive-2.3.7-bin.tar.gz,Java包:mysql-connector-java-5.1.49.jar,传输工具:XFTP6。获取地址:链接:https://pan.baidu.com/s/1iZXWx7d5jqgLuvWW_VNfug

提取码:csdn

复制这段内容后打开百度网盘手机App,操作更方便哦

首先,我们用XFTP6传输文件到hadoop目录下,如下图:

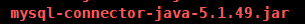

接着,我们解压hive包,命令:tar -zxvf apache-hive-2.3.7-bin.tar.gz。然后,将解压后的hive包重命名为hive,命令:mv apache-hive-2.3.7-bin hive,结果如下:

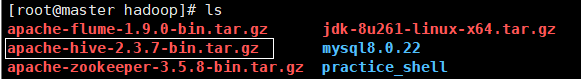

然后,我们配置hive的环境变量,命令:vi /etc/profile如下图:

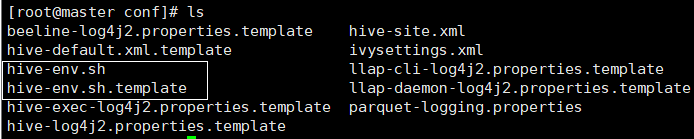

进入hive目录里面的conf目录,然后使用命令:cp hive-env.sh.template hive-env.sh,结果如下:

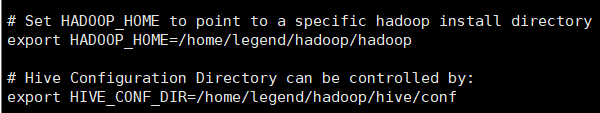

接着,编辑hive-env.sh文件,如下图:

保存退出后,再编辑hive-site.xml,把自己master对应的IP地址修改,以及自己创建mysql数据库的root用户密码设置成value,如下图:

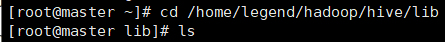

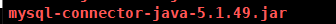

保存退出后,将jar包移动到lib目录下,如下图:

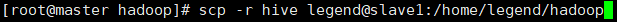

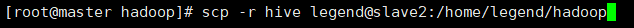

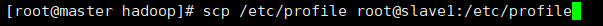

将配置完成的hive文件夹和环境变量传输到slave1和slave2上。

这里要退回到hive文件夹的上一级目录,执行命令如下:

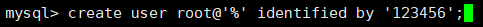

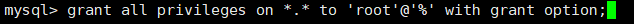

配置mysql的远程连接,如下图:

然后,在master,slave1,slave2上面分别激活环境变量,source /etc/profile。

接着,在master上执行schematool -dbType mysql -initSchema格式化数据库。

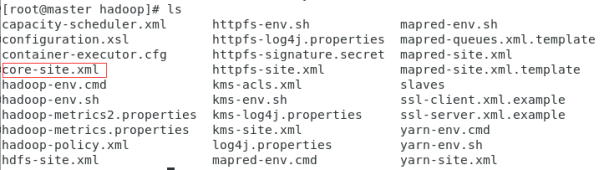

进入/home/legend/hadoop/hadoop/etc/hadoop下配置core-site.xml文件。如下图:

保存并退出(:wq),在master启动集群,命令:start-all.sh。打开slave1进入hive的bin目录下面,启动beeline,如下图:

在master中hive的bin目录下启动hive和hiveserver2,如下图:

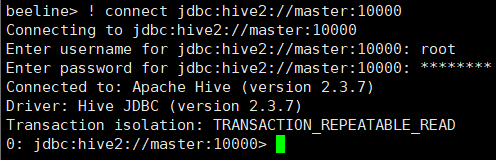

slave1的beeline连接hive数据库,如下图:

可以用beeline操作hive数据库,如下图:

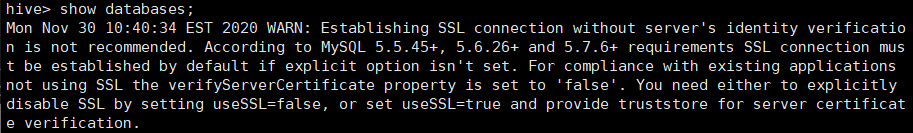

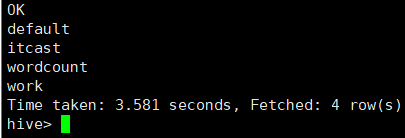

直接用hive操作,如下图:

操作成功时,hiveserver2中会显示,如下图:

在操作的时候注意,hiveserver2是hive的服务,不要停止或者是关闭,否则可能会出错。

最后,感谢大家前来观看鄙人的文章,文中或有诸多不妥之处,还望指出和海涵。

1393

1393

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?