目录

1.网页

1.1自己的流处理程序

import org.apache.flink.api.java.utils.ParameterTool

import org.apache.flink.streaming.api.scala.{StreamExecutionEnvironment, createTypeInformation}

object StreamWordCount {

def main(args: Array[String]): Unit = {

//1.创建执行环境

val env = StreamExecutionEnvironment.getExecutionEnvironment

//从外部命令提交参数:“主机名,端口号”

val paramTool = ParameterTool.fromArgs(args)

val host = paramTool.get("host")

val port = paramTool.getInt("port")

//2.接受socket文本流

val inputdatastream = env.socketTextStream(host,port)

//3.对数据进行转换处理

val resultdatastream = inputdatastream

.flatMap(_.split(" "))

.filter(_.nonEmpty)

.map((_,1))

.keyBy(0)

.sum(1)

//4.打印输出

resultdatastream.print()

//5.触发程序,启动任务执行程序

env.execute()

}

}

1.2将自己的程序打包

直接点package即可

如果还不行的话,

1.3开启虚拟机,启动flink

启动flink:./bin/start-cluster.sh 注:在flink的目录下执行 /home/hadoop/softs/flink-1.10.1

启动后可以jps查看,会出现TaskManagerRunter和StandaloneSessionClusterEntrypoint

注:关闭flink的命令:./bin/stop-cluster.sh

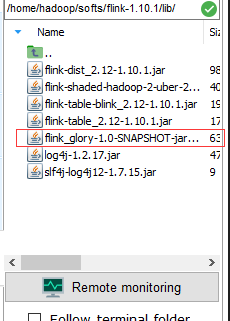

flink安装过程简单:将压缩包移到虚拟机里解压,然后将flink-shaded-hadoop-2-uber-2.7.5-10.0.jar复制到flink的lib文件夹下即可

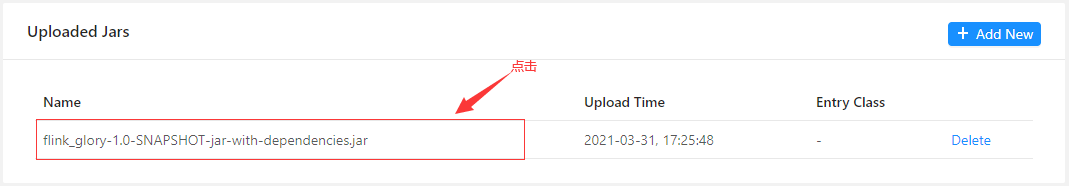

1.4网页提交jar

(1)在网页中打开ip:8081

(2)右击target文件夹->copy path...->点击Absolute Path

(3)网页点击submit new job -> +add new

(4)添加名字长的那个jar文件

(5)点击添加参数,提交job

enter class:填上面复制的例如org.tysy.aurora.example

可show plan查看

最后点击submit即可

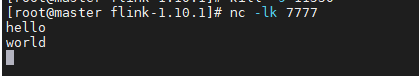

(6)输入数据查看结果(在flink-1.10.1下输入)

如果有错误Ncat: bind to :::7777: Address already in use. QUITTING.

可以先查看端口状态 netstat -nap

kill -9 9238(这个数是你的pid)

2.命令行

2.1启动flink 同上

命令:./bin/start-cluster.sh

2.2提交job

如果没有安装netcat 则需要安装

命令:yum install -y nc

1.将idea打包好的jar包通过moba复制到flink的lib文件夹里

2.提交

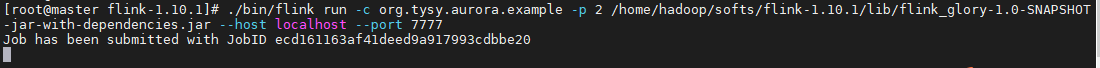

./bin/flink run -c org.tysy.aurora.example -p 2 /home/hadoop/softs/flink-1.10.1/lib/flink_glory-1.0-SNAPSHOT-jar-with-dependencies.jar --host localhost --port 7777

-c 指定main方法的全类名

org.tysy.aurora.example 在下图查看复制或者直接输入

-p 2 设置并行度为2

--host localhost --port 7777 是外部设置的参数

3.moba里应该再建一个窗口(在flink-1.10.1下输入) nc -lk 7777

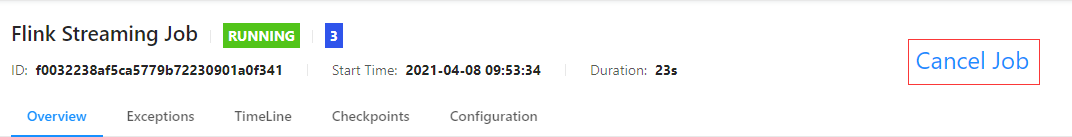

4.在网页中即可看到正在运行的job

2.3取消job(如果需要的话)

1.网页里取消

2.命令取消

.bin/flink cancel 你的jobid你的jobid在提交的命令行或者网页均可查看 或者./bin/flink list -a可查看当前所有的job

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?