scrapyd

是运行scrapy爬虫的服务程序,它支持以http命令方式发布、删除、启动、停止爬虫程序。而且scrapyd可以同时管理多个爬虫,每个爬虫还可以有多个版本

pip3 install scrapyd

第一部分:环境安装

第二部分:上传项目

上传爬虫项目到linux。

第三部分:scrapyd部署

2.安装scrapyd和scrapd-client

pip install scrapyd

pip install scrapyd-client

3. 修改scrapyd配置文件default_scrapyd.conf,确保能够远程访问。

4. 修改scrapy项目目录下的scrapy.cfg配置文件首先需要修改scrapyd.egg (项目的配置文件)

[deploy]

url=http://localhost:6800

project=项目名称

**本地部署

项目部署相关命令: 注意这里是项目的名称而不是工程的名称

scrapyd-deploy -p <项目名称> 也可以指定版本号

scrapyd-deploy -p <项目名称> --version <版本号>

本地部署不需要配置文件

远程连接需要配置default_scrapyd.conf

修改scrapyd的配置文件,允许外网访问

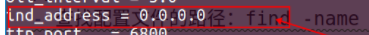

* 查找配置文件的路径:find -name default_scrapyd.conf

* 修改配置文件: sudo vim 路径

要去服务器安全组配置

* 进入服务安全组选项添加安全组

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?