CVPR' 2022

摘要:

近年来,随着图像编辑技术的飞速发展,图像篡改所带来的安全风险越来越大,图像篡改检测受到了广泛的关注。为了解决这些问题,提出了一种新型的多尺度多粒度深度网络(MSMG-Net)来自动识别被操纵区域。在我们的MSMG-Net中,采用并行的多尺度特征提取结构来提取多尺度特征。然后通过引入分流自注意,利用多粒度特征学习来感知多尺度特征的对象级语义关系;为了融合多尺度多粒度特征,采用自底向上的方法设计了全局和局部特征融合块用于操作区域分割,采用自顶向下的方法设计了多级特征聚合块用于边缘部分检测。

因此,MSMG-Net可以有效地感知对象级语义,并对边缘部分进行编码。在五个基准数据集上的实验结果证明了所提方法的优越性能,优于最先进的操作检测和定位方法。大量的消融实验和特征可视化表明,多尺度多粒度学习可以有效地呈现被操作区域的视觉表示。此外,MSMG-Net在各种后处理方法对图像进行进一步处理时表现出更好的鲁棒性。

索引术语-图像处理检测,多任务学习,多尺度监督,多粒度学习。

介绍:

随着图像处理技术的进步和用户友好型图像编辑软件的融合,普通人以相对较低的成本制作逼真的伪造图像变得简单有效。然而,除了被用于摄影、视频游戏和虚拟现实等法律应用[1]外,越来越多的人担心操纵技术被滥用于各种恶意目的,如假新闻、网络谣言、保险欺诈和勒索[2]。因此,开发有效的图像篡改检测方法来检测图像是否被篡改,并进一步定位篡改区域是至关重要的。

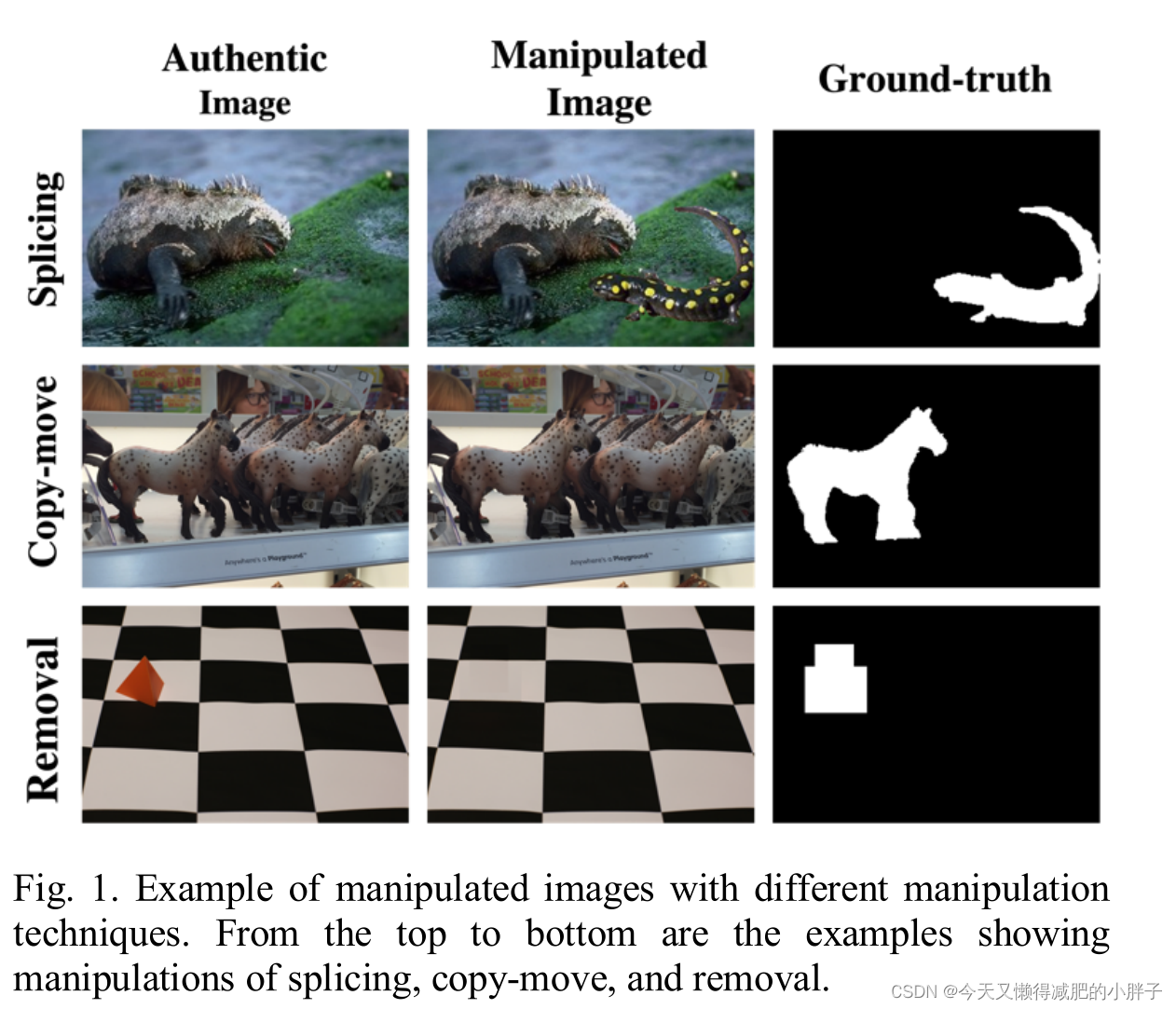

最广泛和最有前途的图像处理技术可以分为三种类型:复制-移动(在给定图像中将对象从一个区域复制并移动到另一个区域),拼接(从一个图像复制对象并粘贴到另一个图像上)和删除(删除不需要的对象)。如图1所示,为了产生语义上有意义和感知上有说服力的图像,这些方法通常会在图像中引入或移除特殊的语义对象。这些对象通常具有完整的实体意义和更高层次的语义信息。从这个角度来看,我们认为图像操作检测和定位就像游戏“spot the difference”一样,我们必须找到两张几乎相同的图片之间的细微差异。通常根据经验,我们先找到两幅图中没有同时出现的物体,然后通过观察边界信息找到其他细微的变形区域。受“spot the difference”游戏的启发,我们认为图像处理检测和定位的一个基本任务是感知图像中不同的物体,并进一步学习物体级语义的一致性和不一致性。另一项任务是寻找被篡改区域周围的边缘构件,这有助于识别被篡改对象并进行重建被篡改的区域。而最近的方法大多是使用现成的语义分割网络或设计带有编/解码器架构的ConvNets来识别被操纵的区域[3-7]。然而,这些方法只是缓解了泛化能力不足的问题,仍然受到特征表示不足的根本限制。这自然提出了一个问题,如何设计有效的网络来有效地感知物体并编码边缘构件?视觉转换器(ViTs)[8]的成功标志着视觉识别领域的最新进展。与ConvNets不同的是,ViTs结合了使用自我注意来产生图像表示的远程全局上下文信息的建模。此外,shunt Transformer[9]通过学习多粒度信息对多尺度对象进行建模。

考虑到对非局部对象关系建模的能力,注意机制是帮助我们捕捉单个对象的有效工具,它很有可能作为操作区域的一部分。然而,注意力机制倾向于捕捉那些突出的物体并了解它们的相关性,从而忽略了被操纵区域中更微妙的细节。例如,被篡改的位置是天空、草地、河流等背景的部分,这意味着模型更倾向于将前景中的物体视为被篡改的目标。由于操纵给定图像中的特定区域不可避免地会留下边缘伪影,因此必须利用被篡改区域与其周围环境之间的微妙差异。卷积网络倾向于从边缘伪影的篡改区域捕获局部模式,可用于解决边缘伪影检测问题。然而,另一个问题是如何将卷积固有的局部处理与多头自注意的全局处理结合起来?

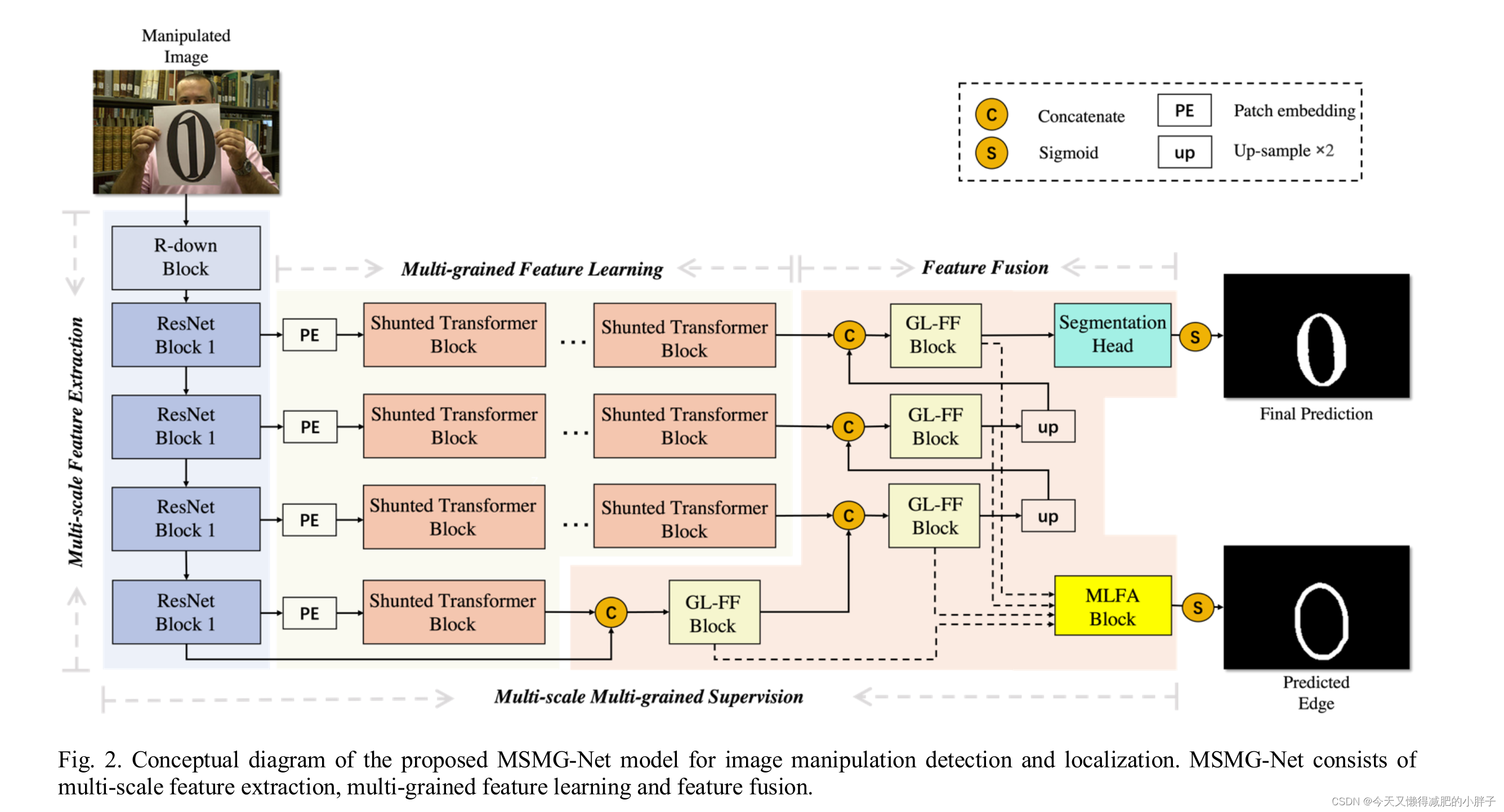

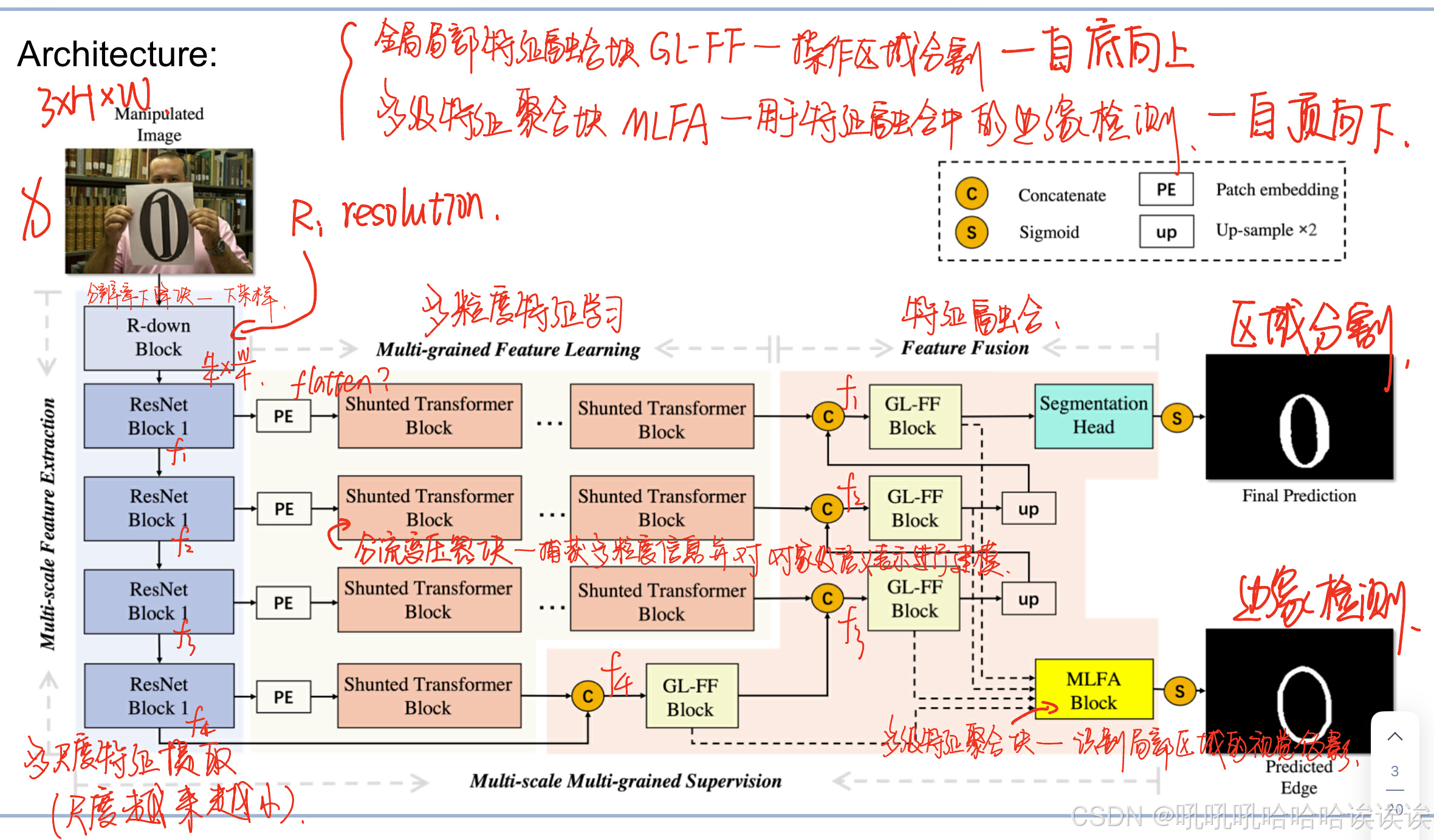

在本文中,我们设计了一个端到端的多尺度多粒度监督框架MSMG-Net,用于图像处理检测和定位。MSMG-Net可分为多尺度特征提取、多粒度特征学习和特征融合三个部分,重点从低层次的细微视觉构件和高层次的语义对象中获取信息。在多尺度特征提取中,MSMG-Net首先通过resolution down (R-down)块和ResNet块堆栈学习从粗到细的多尺度特征。为了在更细粒度的层次上挖掘多尺度潜能,在多粒度特征学习中,我们使用带有多头分流自注意的分流transformer块学习细粒度特征、粗粒度特征以及不同大小的篡改图像对象之间的关系。最后,考虑到操作区域分割和边缘构件检测本质上是两个不同的任务,我们定义了自下而上的全局局部特征融合(GL-FF)块用于操作区域分割,自顶向下多级特征聚合(MLFA)块用于特征融合中的边缘构件检测。注意到,边缘伪迹检测被视为一项辅助任务,以学习局部区域的细粒度线索,以改善主任务操作分割的结果。该框架可以通过同时处理这些任务的多任务监督策略以端到端方式进行训练。为了得到一个公平的和端到端的比较,我们根据之前的研究来衡量模型的性能[10-12]。我们对常用的公共图像篡改数据集CASIA [13], NIST16 [14], Columbia [15], COVERAGE[16]和IMD2020[17]进行实验。结果表明,MSMG-Net优于最先进的篡改检测和定位方法。综上所述,我们的主要贡献如下。

•我们提出了一种用于图像处理检测和定位的新型网络MSMG-Net。如图2所示,MSMG-Net包含多尺度多粒度监督架构,用于学习操作图像中的局部视觉构件和全局对象级语义相关信息,从而获得更健壮和可泛化的特征。

•我们用多任务监督学习训练MSMG-Net,允许模型从操作图像中的语义内容和边缘构件中学习信息,从而大幅提高模型性能。

•在五个基准数据集上进行的大量实验表明,MSMG-Net优于最先进的方法。

相关工作:

A. 图像处理检测与定位

大多数相关研究都集中在特定类型的操作上,例如复制-移动、拼接和删除。为了检测被操纵的区域,早期的工作主要是利用手工或预定的特征,如频域特征[18],彩色滤波器阵列(CFA)模式[19]和离散余弦变换(DCT)系数[20]来检测被操纵的图像。然而,这些方法不能应用于真正的取证,因为特征总是为一种操作技术特定定义的。为了获得更广义的特征,将深度学习方法应用于图像处理检测和定位。

ManTra-Net[3]使用预定义的过滤器来捕获操作痕迹,并使用本地异常检测网络来定位被操作的区域。CAT-Net[7]构建了两流全卷积神经网络,学习RGB和DCT域上压缩伪影的取证特征。

DenseFCN[4]设计了一种由密集连接和扩张卷积组成的全卷积编码器-解码器架构,以提高操作定位性能。为了学习经过调整的图像的语义内容,SPAN[21]利用金字塔结构,通过自注意机制对图像补丁的依赖关系进行建模。SATFL[5]提出了一种可靠的粗-细网络,利用自注意机制来定位伪造区域。此外,为了提高特异性和泛化性,GSR-Net[22]将边缘检测作为辅助任务,并设计了一个细化分支来鼓励对被操作区域的边界伪迹进行学习。此外,MVSS-Net[6]通过多尺度监督,明确地从边界伪影和真实图像中提取更可靠的信息。但是,这些方法只使用ConvNets来学习局部噪声特征,而不考虑对象级语义信息,因此对被处理图像的虚警率较高。相比之下,该方法将卷积固有的局部处理与头部自注意的全局处理相结合,充分探索被篡改区域与未被篡改区域之间的相关性,从而实现更精确的图像处理检测和定位。

B. Visual Transformer

Vision Transformer (ViT)[8]是第一个证明纯Transformer可以在各种计算机视觉任务中实现最先进性能的工作。ViT将图像分割为不重叠的补丁(令牌),并在令牌内执行局部自注意。为了通过自我关注来建模全局依赖关系,Swin Transformer将窗口移到图像上以获得令牌,并堆叠许多层以获得全局接受字段。金字塔视觉转换器(PVT)设计了一种空间约简注意来合并键和查询的标记。

此外,为了捕获多粒度信息并更好地对不同大小的对象建模,Shunted-Transformer选择性地合并令牌以表示更大的对象特征,同时保留某些令牌以保留细粒度的特征。

随后,为了证明在语义分割中使用transformer的可行性,SETR[23]设计了transformer解码器来提取优越的特征表示,取得了令人印象深刻的性能。之后,Segformer[24]引入了分层Transformer编码器和轻量级Transformer解码器进行进一步改进。

受此启发,我们提出了一种多尺度多粒度学习方法,该方法引入视觉转换器学习不同尺度的语义信息,用于视觉感知,并进一步结合边缘信息捕获微妙的视觉伪影,用于图像操作检测和定位。

方法:

A.MSMG-Net概述

在这项工作中,我们提出了一种新的模型MSMG-Net来预测图像中被操纵区域的二进制掩码。我们提出的模型的总体框架如图2所示。给定一个RGB图像x(3*h*w), MSMG-Net不仅可以判断图像是否被篡改,还可以通过多尺度多粒度监督学习来识别篡改区域周围的边缘伪迹。MSMG-Net首先使用分辨率下降(R-down)块对输入图像进行下采样,使其达到适当的分辨率大小。然后MSMG-Net通过一堆ResNet块积极地学习从粗到细的多尺度特征。为了在更细粒度的水平上挖掘多尺度的潜力,我们构建了定制的具有多头分流自注意的分流transformer块,有效地捕获多粒度信息并隐式地对对象级语义表示进行建模。通过迭代,MSMG-Net可以学习涉及不同大小物体的野外场景的全局多尺度多粒度的非局部相关特征。最后,考虑到操作区域分割和边缘伪迹检测是两个不同的任务,我们采用了一种同时处理这些任务的多任务监督策略。

因此,我们定义了一种自底向上的方法用于操作区域分割,并定义了一种自顶向下的方法用于边缘构件检测。自底向上的方法通过提出的全局和局部特征融合(GL-FF)块显式地融合多尺度多粒度特征,然后实现分割头来分类图像和每个像素是否被篡改。在自顶向下边缘伪影检测中,引入多级特征聚合块(multi-Level feature aggregation, MLA)来识别局部区域的视觉伪影,从而进行进一步的判断。下面我们将详细描述MSMG-Net。

B. 多尺度特征提取

为了为图像操作检测和定位提供更好的特征表示,我们采用多尺度特征提取来学习被操作图像的特征映射。多尺度特征为后续特征融合提供了充足的语义信息和空间信息。为了降低计算成本,我们首先使用分辨率下降(R-down)块,将原始图像经过3 × 3卷积,stride为2,max-pool为2 × 2,转换成大小(h/4 * w/4)的特征图,记作Rdown(x)。

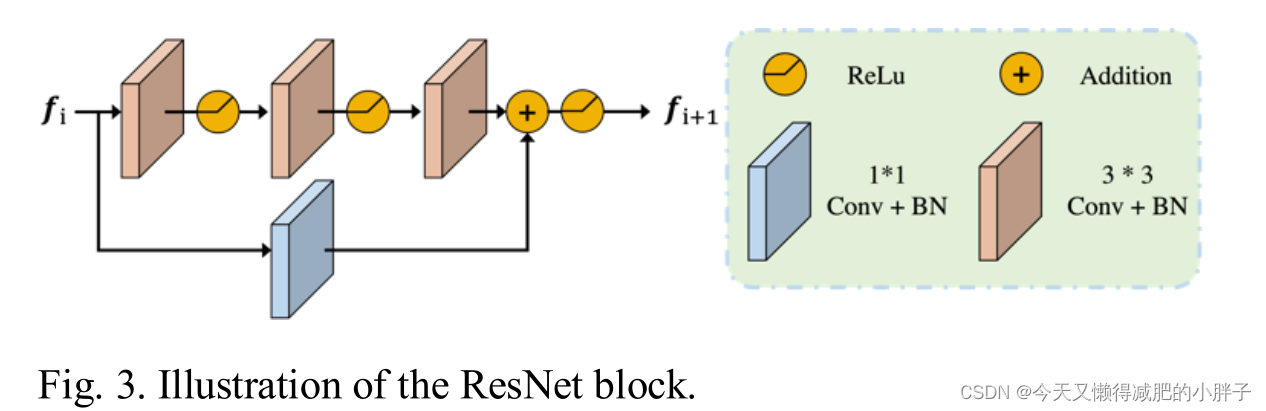

ResNet Block:现有的一些图像分割网络[25,26]将所有的高、低级别特征都作为编码器中的多尺度特征,其中包括局部线索和全局上下文信息,使最终的预测更加可靠。受此启发,如图2所示。从ResNet[27]的连续四个堆叠ResNet块中提取多尺度特征集{fi,i = 1,2,3,4}。ResNet块结构如图3所示,由1 × 1卷积和3 × 3卷积组成。多尺度特征提取的输出可以用下式表示。

C. 多粒度特征学习

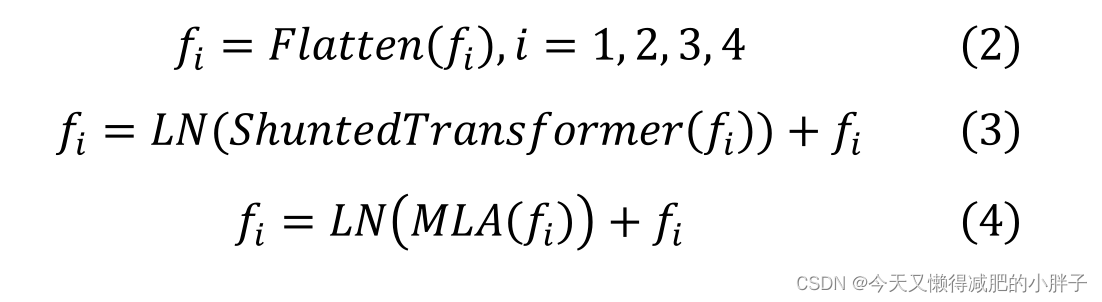

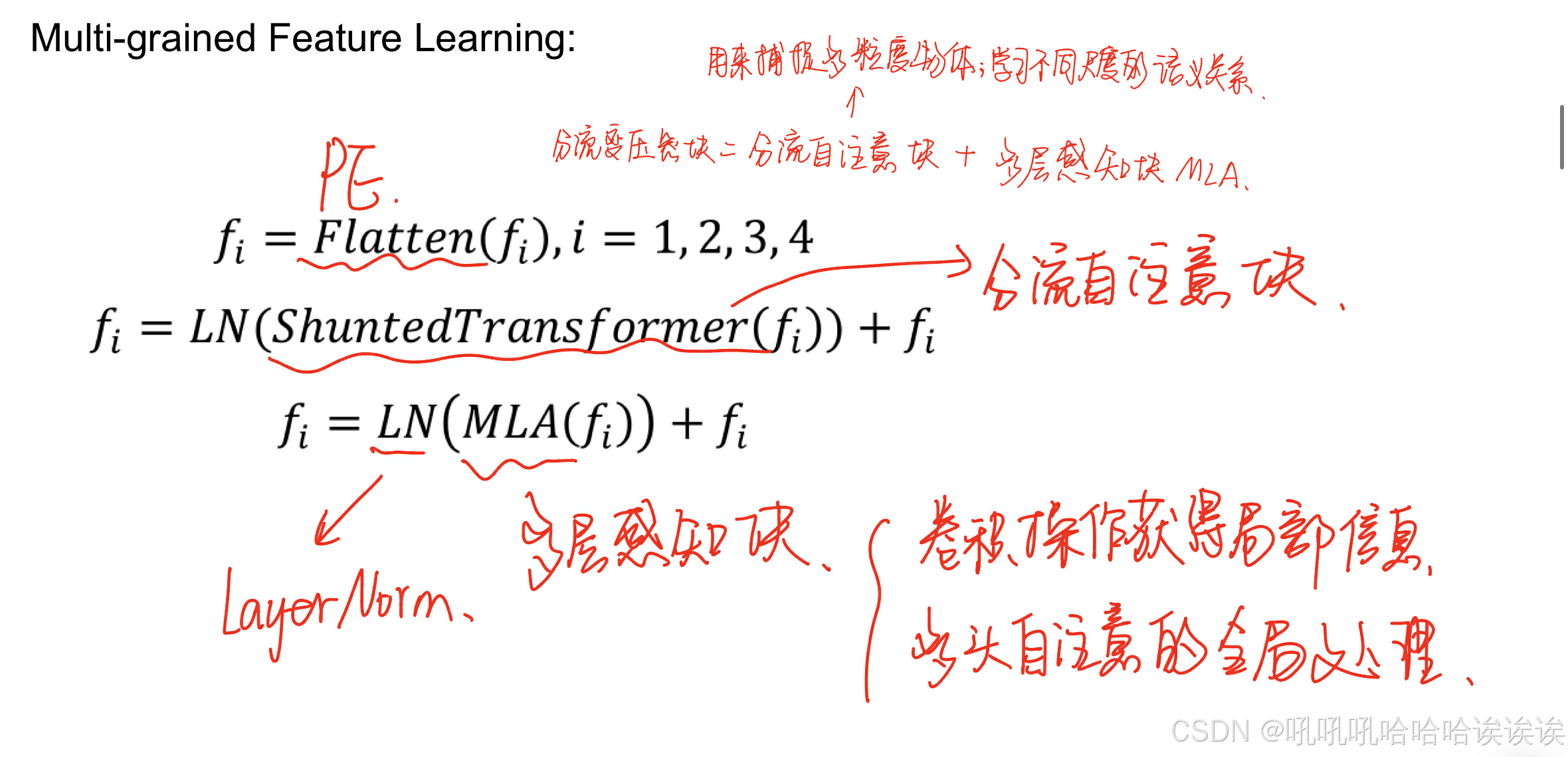

考虑到图像处理技术所带来的视觉伪影和内容不一致,分流自注意[9]可以很好地学习经过篡改的图像的细粒度特征、粗粒度特征以及不同大小的对象之间的关系。这些多粒度特性学习不同尺度下不同大小的对象之间的关系。注意到如何将特征映射映射到序列令牌上影响操作检测的性能。vanilla ViT[8]将图像分割成补丁,并线性嵌入每个补丁。最近的研究[9,28]表明,在斑块嵌入中使用卷积比传统的大跨距非重叠斑块嵌入提供了更高质量的令牌序列。因此,我们通过1 × 1卷积和3 × 3卷积的patch embedding (PE)直接进一步提取多尺度特征fi,映射到合理的特征通道维数。然后将这些特征输入到并联transformer块中,得到多尺度多粒度特征。

分流transformer块:分流transformer块由分流自注意块和多层感知(MLA)块组成。需要注意的是,在每个块之前应用LayerNorm (LN),在每个块之后应用剩余连接。分流式自注意是用来捕捉多粒度物体,特别是小尺寸物体[9]的。为了提取被篡改图像的局部线索特征和全局上下文信息,我们使用分流自注意学习不同尺度的语义关系。我们首先将多尺度特征平化为二维矢量序列,并添加额外的位置嵌入作为输入嵌入。然后利用并联transformer获取多尺度特征的不同粒度信息。完整的过程可以表述为:

最后,我们将原始特征图的嵌入恢复到分辨率大小,作为MSMG-Net特征融合的输入。

D. 特征融合

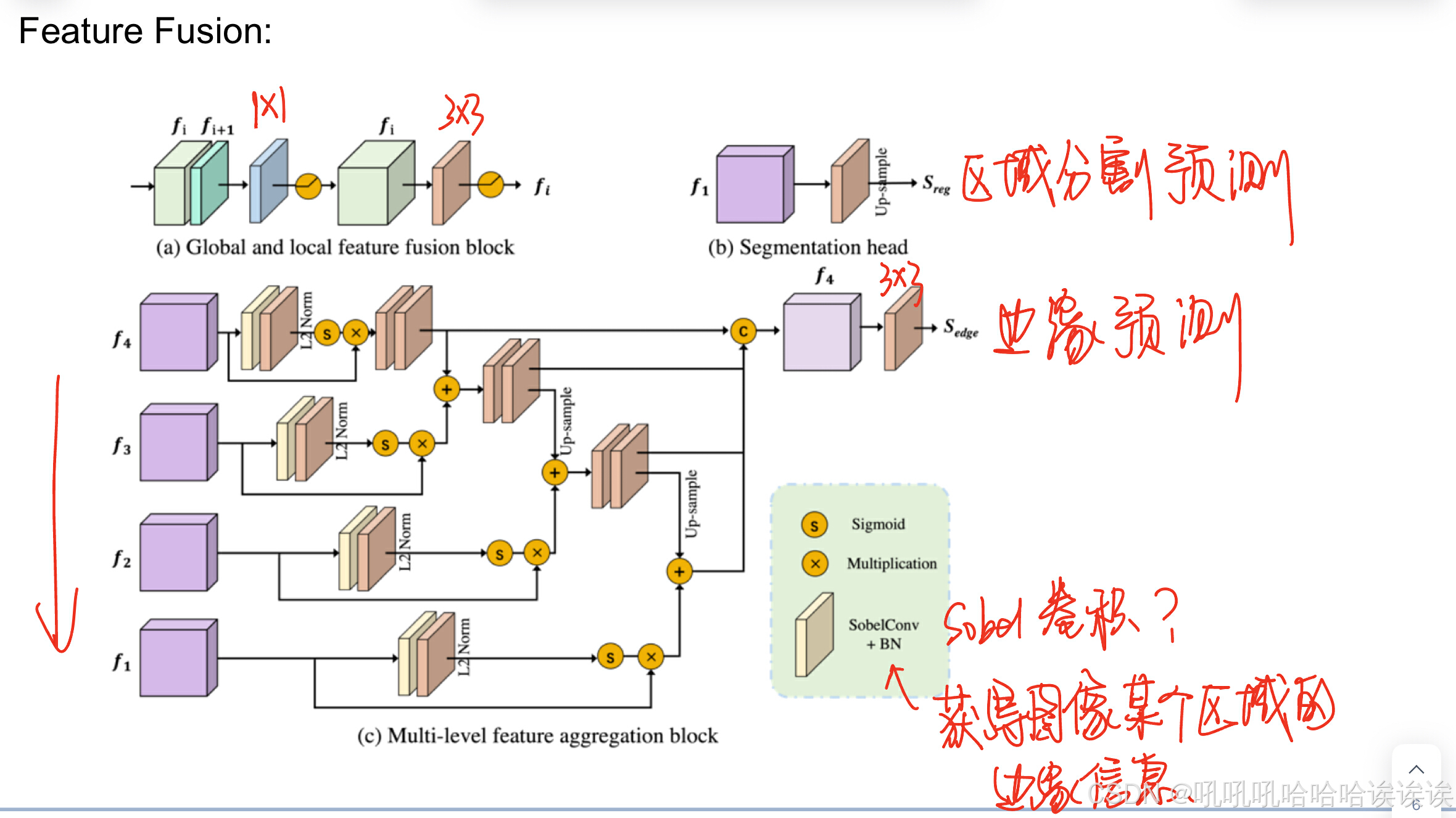

为了更好地输出被操作区域和相应边缘构件的最终统一特征表示,设计了全局、局部特征融合块和多层次特征聚合块来融合不同尺度的特征。

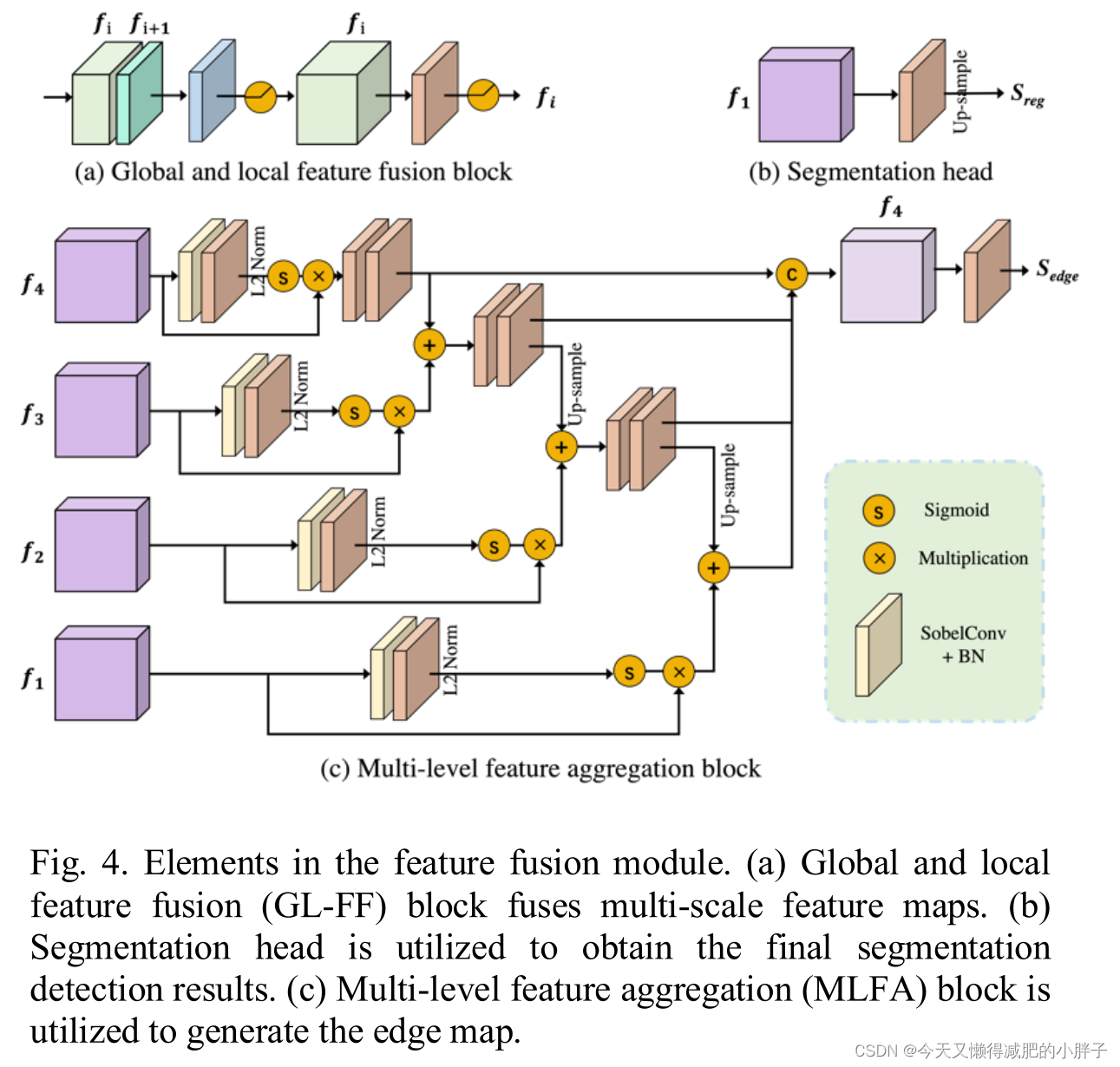

全局和局部特征融合(GL-FF)块:受U-Net架构[29]的启发,我们使用一种简单的方法来集成来自多粒度特征学习的全局和局部特征。如图4(a)所示,将特征fi和f(i+1)直接拼接,并通过1 × 1卷积和3 × 3卷积进一步融合。我们通过自底向上的方法逐步融合这些特性。然后我们将特征f1输入到分割头中,生成响应图Sseg作为图2中的最终预测。

多级特征聚合(MLFA)块:多项研究表明,边缘构件信息可以为图像处理检测和定位的特征提取提供有用的约束条件[6,22]。因此,考虑到多尺度多粒度特征保留多级充分边缘信息,我们引入了自顶向下多级特征聚合块(MLFA)来显式学习边缘构件表示,如图4(c)所示。

特征集{fi,i = 1,2,3,4}经过Sobel卷积来识别边缘区域[6]。为了增强这些特性之间的交互,我们通过按元素添加来聚合它们。并且在元素相加之后应用一个额外的3 × 3卷积。重复此操作三次后,通过通道级联得到融合特征。然后我们对结果进行双线性上采样4 ×,生成边缘响应图Sedge作为图2中的预测边缘。

E. 多任务监督策略

我们定义了对应于特殊多任务目标的两种损失,即用于提高模型灵敏度的被操纵区域分割损失和用于学习细微边缘伪迹的边缘损失,以提高模型对操作检测和定位的鲁棒性。

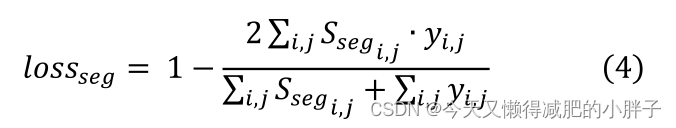

操纵区域分割损失: 在给定的图像中,由于操作区域通常是少数的,操作检测和定位可以看作是一个极端的数据不平衡问题。因此,我们使用Dice损失作为操纵分割损失,可以记为

y(i,j)∈(0,1)表示真实的二进制表示像素(x,y)是否被操作。

边缘伪影检测丢失:对于被篡改区域周围的边缘构件,我们再次使用Dice损失进行检测,记为loss(edge)。由于边缘伪影检测是一项辅助任务,在前人研究[6]的基础上,我们采用自顶向下方法直接计算得到的损失边缘,保留了原始图像4 ×下采样的分辨率大小,减少了训练时的计算量,提高了检测性能。

组合的损失: 我们使用这两个损耗的凸组合作为MSMG-Net的总损耗,其公式如下。

其中和

为人为区域分割损失和边缘伪迹检测损失的权重。

实验

A.实验设置

数据集。根据之前的研究[6,10 -12],我们将我们的方法与Nist Nimble 2016 [14] (NIST16), CASIA [13], COVERAGE [16], Columbia[15]和IMD2020[17]数据集上的当前最先进的方法进行了比较和评估。这些数据集广泛应用于图像处理、检测和定位中。

•NIST16[14]是一个具有挑战性的数据集,包含所有三种篡改技术。此数据集中的操作经过后处理以隐藏可见痕迹。它们还提供了用于评估的地面真相篡改掩码。

•CASIA[13]提供各种对象的拼接和复制移动图像。对被篡改的区域进行了仔细的选择,并应用了一些后处理技术,如滤波和模糊处理。CASIA由CASIAv1和CASIAv2片段组成。来自两个子集的样本都提供了二元地真掩码。

•Coverage[16]数据集包含由复制移动技术生成的相对较小的数据集,ground-truth mask也可用。

•Columbia[15]数据集专注于基于未压缩图像的拼接。提供地面真相面具。

•IMD2020[17]包括现实生活中的操纵图像以及手动创建的地面真相面具,其中包含最多样化的量化表。

为了与当前最先进的方法进行公平和直接的比较,我们在CASIA, NIST16, COVER和Columbia数据集上按照[10-12]中最流行的训练-测试拆分配置重新训练和评估这些模型。对于IMD2020,我们选择大约4:1的训练-测试比例。这些数据集的详细信息如表1所示。

评估标准。根据之前的工作[3-6],我们计算像素级F1分数(F1)和ROC曲线下面积(AUC)作为我们的操作检测和定位性能比较的评估指标。请注意,以前的工作通常报告性能与决策阈值选择每个测试集,允许一个比较模型在其最佳条件下。然而,这种设置会导致过度乐观的性能估计,因为在实践中,模型的决策阈值(或其工作点)必须预先指定和固定。由于在没有GT的数据中,无法预测最合适的阈值,因此我们使用中位数0.5作为阈值来确定总体方法的正类和负类。

基线模型。我们评估并比较MSMG-Net与目前发表的五种SoTA方法,即ManTraNet 1 [3], CAT-Net 2 [7], DenseFCN 3 [4], SATFL 4[5]和MVSS5[6]。这些比较的方法都有公开的源代码。为了进行公平和可重复的比较,我们重新训练了上述模型,并使用参考论文中描述的优化分配或自动选择的相关参数对它们进行评估。

实现。所提出的网络在PyTorch中实现,并在NVIDIA Tesla V100 GPU上进行训练。输入大小为512×512。用于多尺度特征提取的Resnet块使用imagenet预训练的对应对象进行初始化。我们使用Adam优化器,其学习率周期性地从10−4衰减到10−6。我们应用常规数据增强进行训练,包括翻转、模糊和压缩。

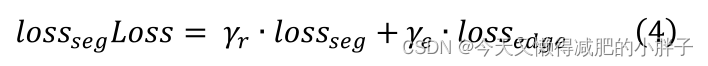

B.与先进水平的分割比较结果

1)定量结果:为了比较操作检测和定位,我们考虑了五种最先进的方法Mantra-Net, CAT-Net, DenseFCN, SATFL和MVSS-Net。量化结果见表2。可以看出,本文提出的MSMG-Net在AUC和F1方面明显优于Mantra-Net、CAT-Net、DenseFCN、SATFL和MVSS-Net。我们将这种改进归因于我们的多尺度多粒度监督学习从低级视觉工件和高级语义对象中捕获信息的能力。具体来说,SoTA方法忽略了图像中的空间关系,保证了MSMG-Net的泛化能力。此外,模糊边缘伪影的约束明显地增强了边界信息,保证了预测分割结果的精细度,而其他方法无法充分利用被篡改区域周围的边缘信息细节。

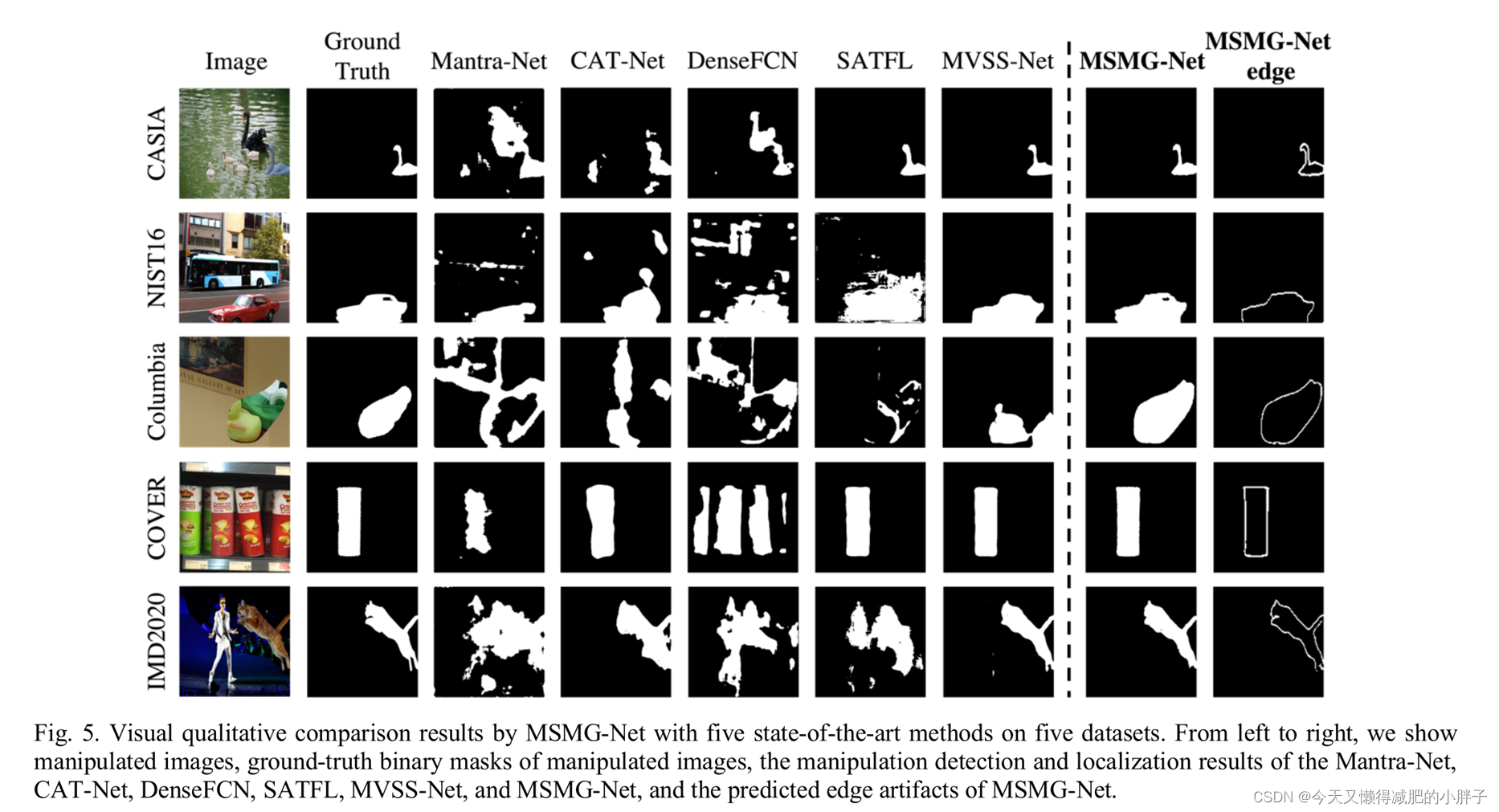

2)定量结果:如图5所示,操作检测和定位结果表明,我们的MSMGNet显著优于基线方法。

具体来说,MSMG-Net产生的分割结果接近于真实情况,错误分割的组织要少得多。

相比之下,Mantra-Net、CAT-Net和DenseFCN的结果并不理想,存在大量分割错误的区域。SATFL改善了结果,但性能仍不理想。ManTra-Net、Cat-Net、DenseFCN和SATFL的边界检测结果由于忽略了边缘伪影信息,精度远远低于MSMG-Net。相比之下,MVSS-Net和MSMG-Net采用边缘监督分支学习边缘特征,以提高操作和定位的性能。然而,从图5的第8栏可以看出(特别是第二行图像),MSMG-Net得到更精确的预测结果。MSMG-Net的准确分割得益于我们的多尺度多粒度监督策略,可以更好地学习图像的语义一致性和不一致性。该策略引入了分流自我注意机制来感知图像中的物体并学习它们之间的关系。通过对不同尺寸物体的感知和边缘伪影的识别,MSMG-Net最终获得了满意的结果。

C.消融研究

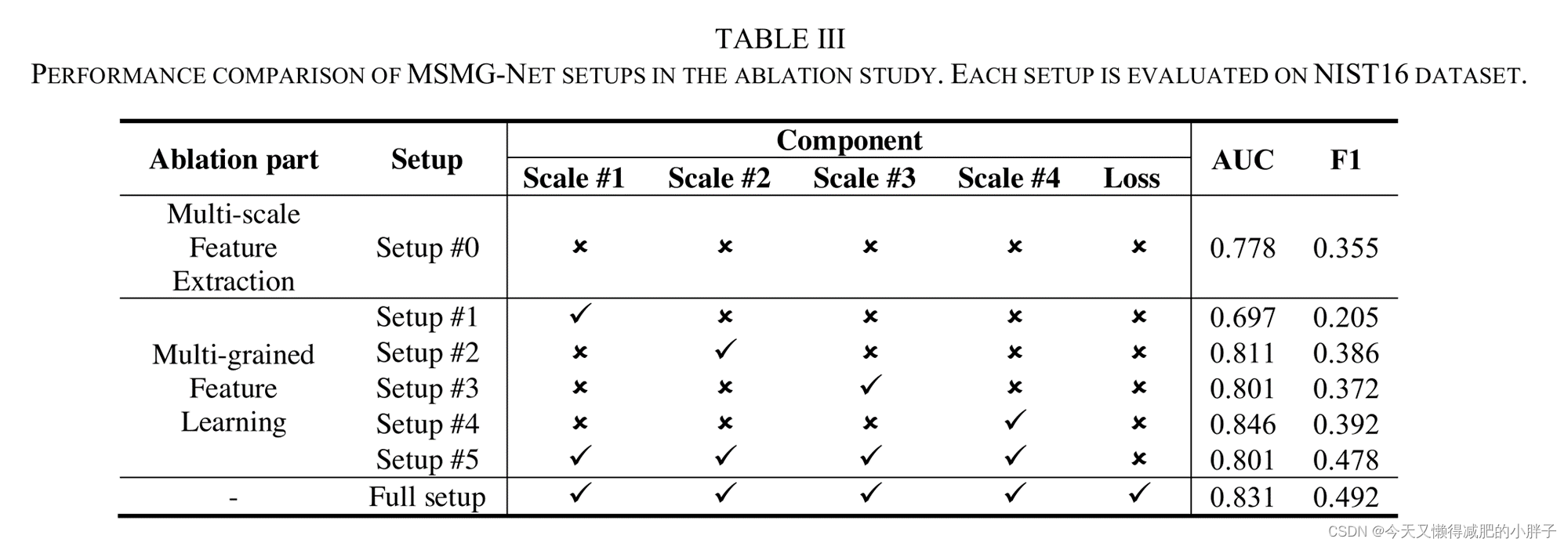

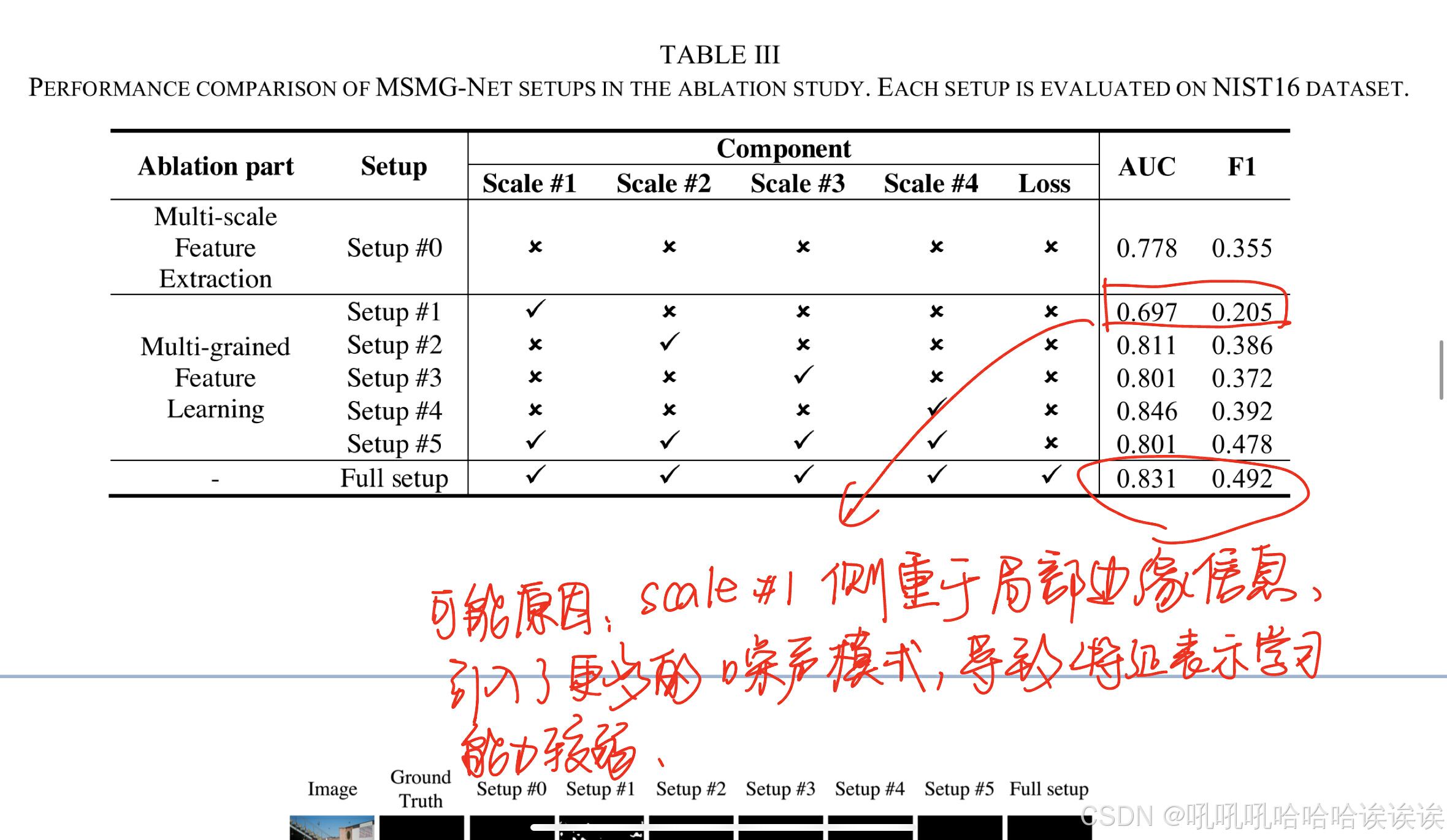

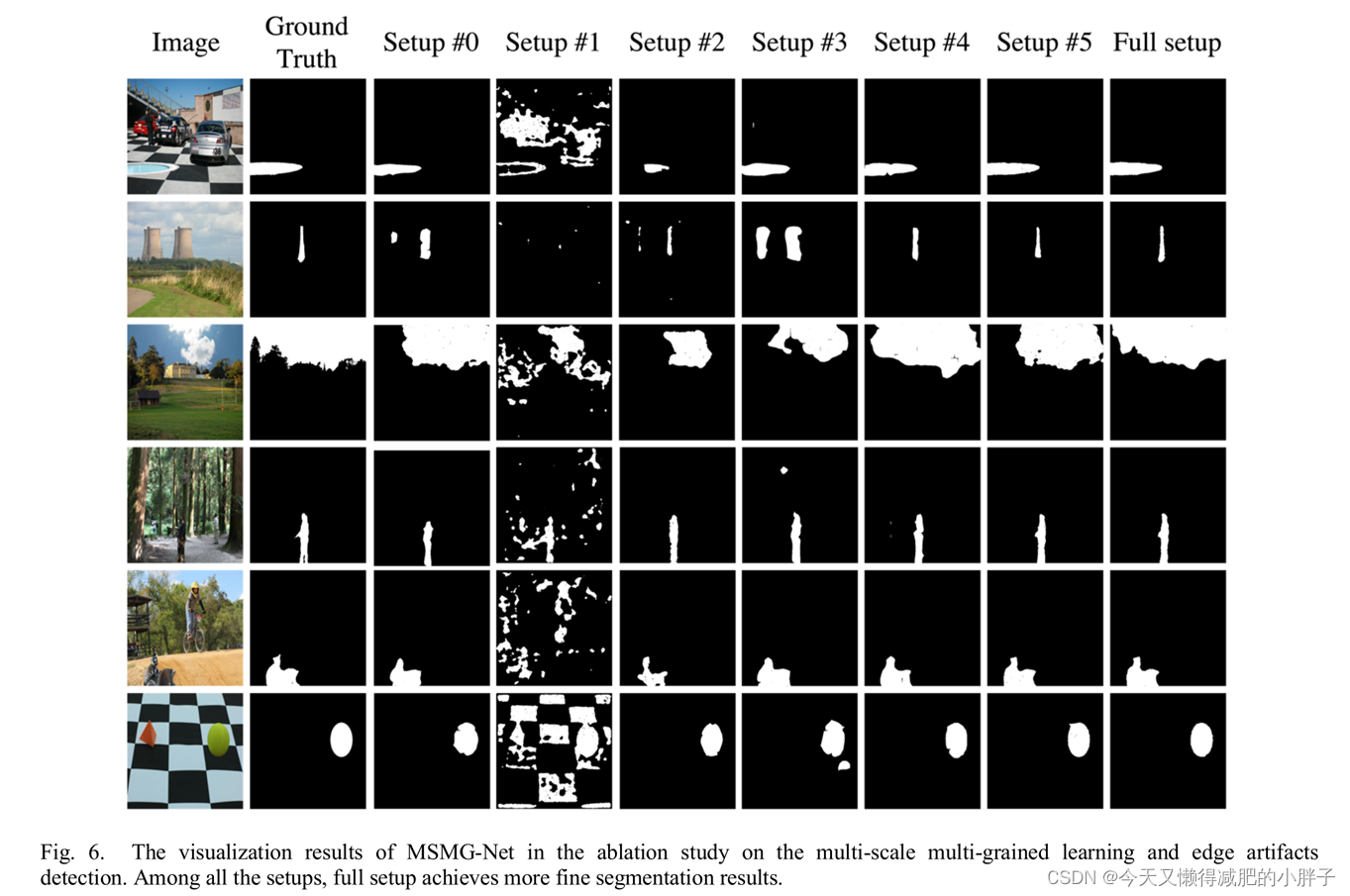

为了揭示多尺度多粒度监管的影响,我们进行了消融研究,以评估在不同设置下逐步添加组件的MSMG-Net。定量结果见表3,定性可视化见图6。

scale #1, scale #2, scale #3 , scale #4 分别对应于setup #1, setup #2, setup #3 , setup #4,按照从浅到深的尺度表示多粒度学习的特征。setup #5融合了多尺度多粒度特性。此外,损耗作为一种替代策略被用于学习边缘伪影。本节中报告的所有结果均使用NIST16数据集获得。

多尺度特征提取的影响。setup#0直接采用多尺度特征提取的最终Resnet块输出来预测最终的操作区域。setup#0的总体性能低于表3中的segg -all,结果清楚地展示了多尺度多粒度特性的优势。seg-all与表3和图6中的setup#1、setup#2、setup#3和setup#4相比表现最好,显示了单个组件在不同尺度下的显著性。

多粒度特征学习的影响。为了进一步说明多粒度特征学习的必要性,我们将每个单独的组件在不同尺度下进行差异比较,如图6所示。特别是在面对复杂的第三行背景时,结果差异很大。值得一提的是,seg #1在AUC和F1方面表现不佳。可能的原因是scale#1侧重于局部边缘信息,引入了更多的噪声模式,导致特征表示学习能力较弱。这是一个并行验证,多粒度特征可以集中在图像的不同方面。

边缘伪影检测损失的影响。比较Segall和full setup,我们可以看到AUC和F1有明显的轻微改善,这表明添加边缘工件检测损失使模型对操作检测有效。这一变化不仅被更高的AUC和F1所证实,而且在图6的第九列中也得到了证实。相比之下,完全设置的边界相对清晰,特别是在微妙的感染区域。从左到右,结果表明,提出的模型在不同的设置下获得了更准确的结果。综上所述,MSMG-Net的优异性能得益于多尺度多粒度监测策略,该策略利用平行并联transformer块学习多尺度多粒度特征来定位被操纵区域,然后利用边缘伪影进行进一步的精细分割,从而学习到足够的被操纵图像信息。

D.特征可视化

为了进一步呈现多尺度多粒度特征的信息,我们提供了全面的特征图可视化结果,分析图7中视觉表征的差异。这些特征图包括多粒度学习中并联结构的最后四个并联transformer块的分流自注意特征图和特征融合中分割头的响应图。我们观察到,特征图捕捉了所需的信息,包括局部结构(边、线、纹理等)和从scale#1到scale#4逐步增加的全局抽象语义。我们清楚地看到了从scale#1和scale#2中提取的低水平空间特征图突出了一般区域边界和局部细节,逐渐被scale#3和scale#4所示的全局对象级语义特征所取代。结果表明,MSMG-Net不仅学习全局依赖关系,而且在多尺度多粒度学习中更加关注重要的局部模式。MSMGNet通过对网络的深入观察,识别出近似被篡改区域,并进一步引入GL-FF块和MLA块,通过更多的局部边缘构件细节来增强从被篡改图像中学习到的边缘表示。我们可以直观地感受到篡改区域和未篡改区域之间的明显差异,这反映了我们的模型学习对象级语义一致性和不一致性的事实。结果表明,在MSMG-Net中,从多尺度多粒度学习的并行结构中提取特征图更为有效。

E. Robustness Analysis

在之前的研究[3,6,11]的基础上,我们在NIST数据集上对四种图像后处理方法(高斯模糊、高斯噪声、JPEG压缩和ISO噪声)评估模型的鲁棒性,以验证MSMGNet的鲁棒性。鲁棒性分析的详细结果如图8所示。对于每种后处理方法,我们改变高斯模糊中的内核大小(从3到9),高斯噪声的方差(从3到9),JPEG压缩中的质量(从50%到100%),以及ISO噪声的方差(从0.05到0.2),以进行综合评估。可以观察到,高斯模糊对检测性能的影响更严重,特别是当9×9的内核大小更大时,它会模糊图像并擦除篡改区域周围的操作痕迹。此外,与其他基线相比,MSMG-Net对ISO噪声具有最一般的鲁棒性能。MSMG-Net的结果归功于我们的多尺度多粒度学习,其中一个并行部分分流transformer块旨在学习粗到细的操作分割特征。综上所述,我们的模型MSMG-Net一直是所有方法中表现最好的,可以有效应对各种后处理方法带来的挑战。

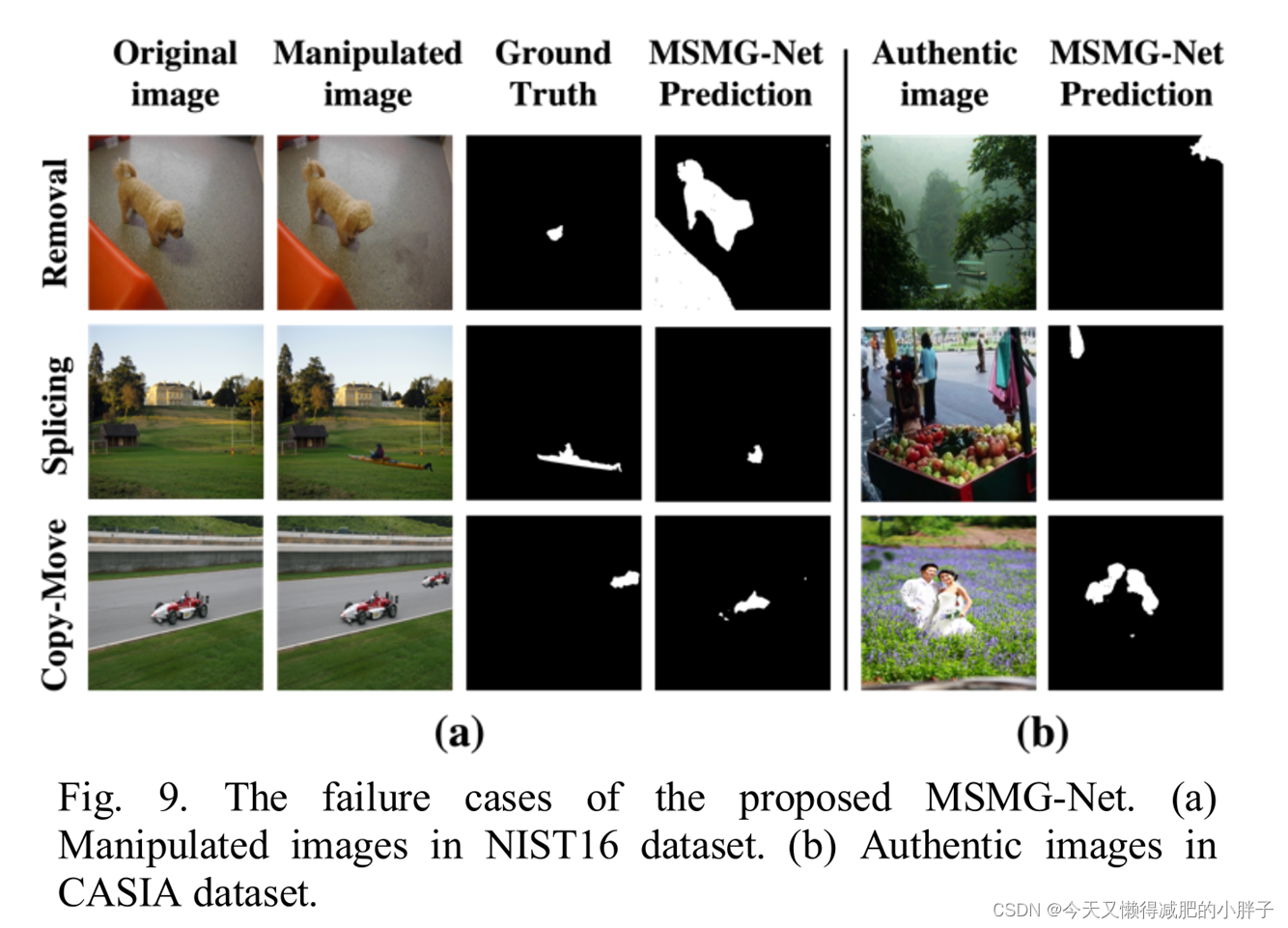

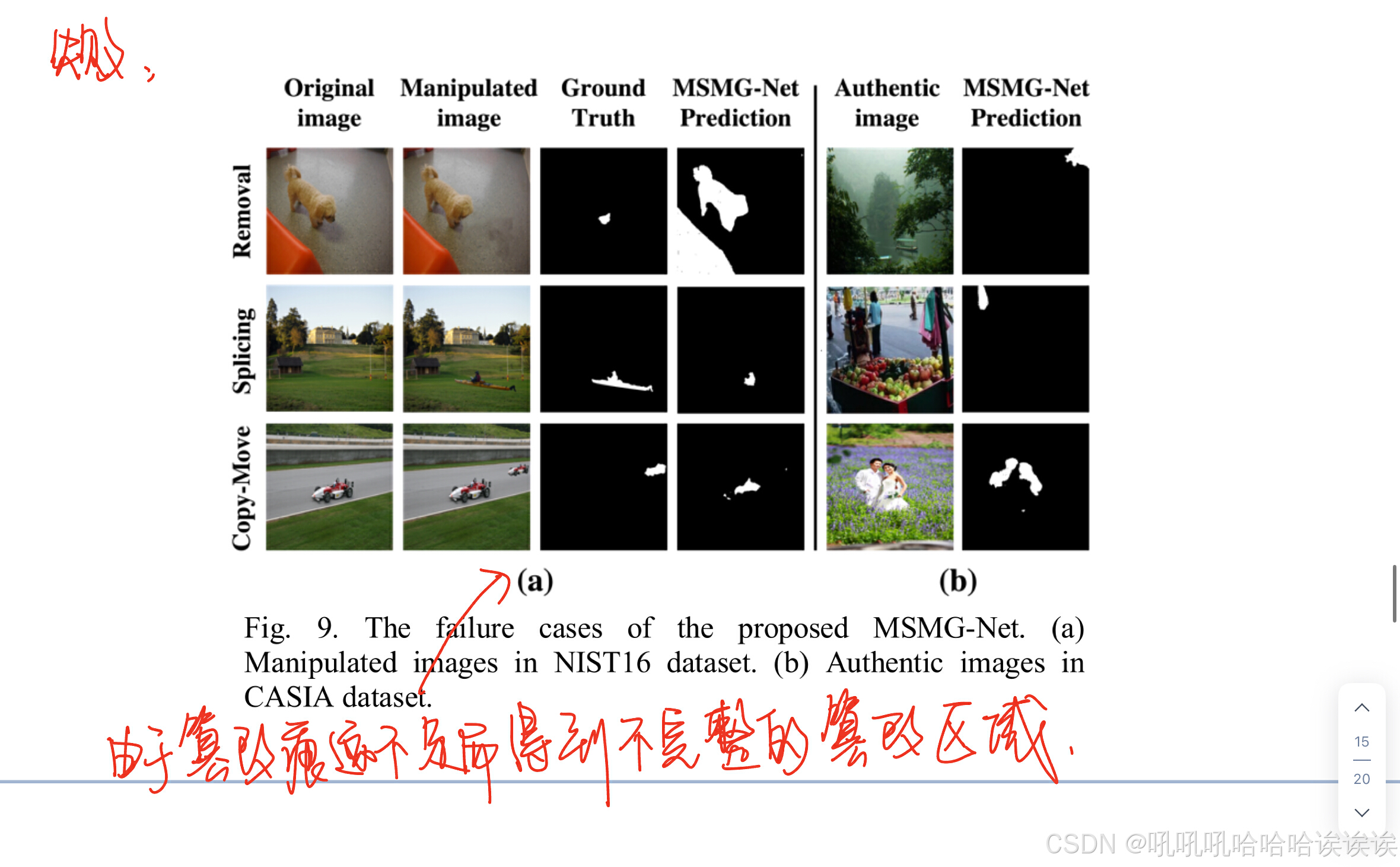

E. Limitation analysis

考虑到任务的挑战性,当MSMG-Net应用于实际场景时,失败是不可避免的。如图9(a)所示,MSMG-Net在面对移除、拼接、复制-移动三种操作技术时,效果不尽人意。当被篡改区域的伪影是附加后处理方法[30]的细微之处时,MSMG-Net由于篡改痕迹不足而得到的是不完整的被篡改区域,这一直是各种被篡改检测方法[1]的难点。另外,图9(b)为CASIA数据集真实图像的预测结果。提议的MSMGNet识别了与周围环境明显不同的区域。特别是第三行,在图像的上部使用艺术效果Bokeh,通过模糊所有离焦区域[31]来突出照片上主要感兴趣的对象,导致虚警。综上所述,本文提出的方法MSMG-Net在提取精确的物体边界和视觉显著边缘,以及感知图像中不同物体和背景之间的语义一致性和不一致性方面表现良好。此外,MSMG-Net还能准确识别出被篡改图像中的完整物体,可作为图像处理检测和定位的辅助工具。

结论

在本文中,我们提出了一种新的图像处理检测和定位深度网络,称为MSMG-Net,它利用多尺度多粒度监督来提高篡改区域的识别。MSMG-Net设计了一个并行结构来精益多尺度多粒度特征,并通过自底向上的方法进行区域分割和自顶向下的方法进行边缘工件检测来融合这些特征。在五个基准数据集上的大量实验证明了该方法在图像处理检测和定位方面的有效性,优于现有方法。大量的烧蚀实验和特征可视化证明了多尺度多粒度特征的优越性。此外,该方法对高斯模糊、高斯噪声、JPEG压缩和ISO噪声也有较好的鲁棒性。基于MSMG-Net的良好性能,我们相信它可以成为图像处理检测和定位的有效工具。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?