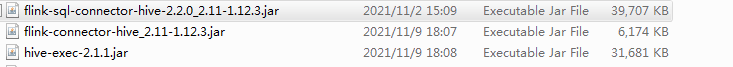

flink sql中持久化hivecatalog 的依赖项

下载maven地址 以及官网地址依赖配置 https://nightlies.apache.org/flink/flink-docs-release-1.12/zh/dev/table/connectors/hive/

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-connector-hive_2.11</artifactId>

<version>1.12.3</version>

<scope>provided</scope>

</dependency>

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-table-api-java-bridge_2.11</artifactId>

<version>1.12.3</version>

<scope>provided</scope>

</dependency>

<!-- Hive Dependency -->

<dependency>

<groupId>org.apache.hive</groupId>

<artifactId>hive-exec</artifactId>

<version>${hive.version}</version>

<scope>provided</scope>

</dependency>

flink-sql-connector-hive

将以上依赖添加到你的项目中

代码如下

1: 如果报错HADOOP_HOME不存在,在HADOOP官网下载对应的HADOOP 到开发环境,配置HADOOP_HOME环境变量

2: HADOOP下载地址:https://archive.apache.org/dist/hadoop/common/

3: 如果报winutils.exe 不存在 在https://github.com/vhma/winutils下载对应的 winutils.exe 放到hadoop的bin目录下

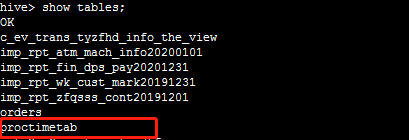

以上设置完 运行完程序你就可以在hive的对应数据库看到你的表了

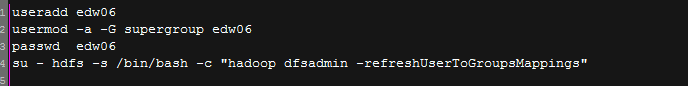

备注:如果遇到hive创建表的权限问题 如下处理

2153

2153

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?