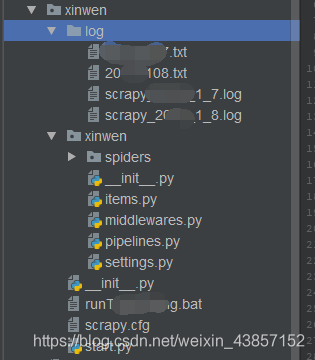

爬取每天更新的新闻,使用scrapy框架,Python2.7,存入MySQL数据库,将每次的爬虫日志和爬取过程中的bug信息存为log文件下。定义bat批处理文件,添加到计划任务程序中,自动爬取。

额…

1.在items文件中,定义需要爬取的类

2.在settings文件中设置默认项,设置日志输出格式,打开pipeline文件,设置delay时间,设置数据库信息,设置请求头等信息

3.编写自己的spider文件

class TouchuangSpider(scrapy.Spider):

name = 'touchuang'

allowed_domains = ['xunjk.com']

url = {

"1": "http://www.xunjk.com/xinwen/rongzi/", # 融资

"2": "http://www.xunjk.com/shangye/", # 商业

"3": "http://www.xunjk.com/xinwen/yanjiu/", # 研究

"4": "http://www.xunjk.com/xinwen/keji/", # 科技

"5": "http://www.xunjk.com/xinwen/jinrong/", # 金融

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2960

2960

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?