首先,在安排前要确保已经安装了java和Scala,因为spark对scala有依赖,而scala对java有依赖。

如果没有安装java,直接去官网下载,然后解压安装,在/etc/profile中添加环境变量。

如果已经安装了java,没有安装scala,则去scala官网下载一份压缩包,把压缩包解压到指定的目录下,然后在etc/profile中添加环境变量。

怎么添加环境变量?随便百度一下就好,答案很多。

java和scala都安装好以后,注意,就可以安装spark了。

这里放一个spark2.4.X的镜像地址:

http://monitor-hdp-bjyf-61-60:50070/explorer.html#/monitor/spark/antispam_sass_log_graph/node/

把对应的安装包下载下来以后,先解压到指定目录。

接下来,重点来了。

切到spark当前的解压目录下,进入conf目录,将spark-env.sh.template重新复制一份,命名成spark-env.sh,然后编辑spark-env.sh,输入以下内容:

export SCALA_HOME= "" # 引号里是你的scala安装路径

export SPARK_MASTER_IP=localhost

export SPARK_WORKER_MEMORY=4g最后,把spark的环境变量加到/etc/profile中。

环境变量加好以后,别忘了执行一下:

source /etc/profile

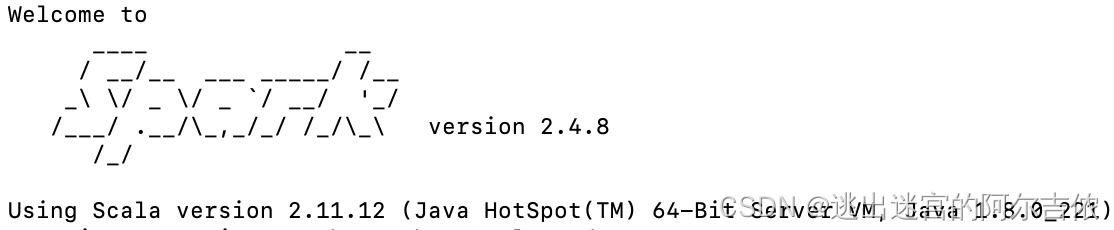

然后执行命令 spark-shell,如果出现以下界面,就安装成功啦。

如果没出现这个界面,报错了,那就……继续百度咯,多查查其他博客。

加油加油~

1040

1040

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?