文章目录

在实际的企业当中,各种服务有对应集群,存储有存储的集群(数据有数据的集群),这里我们使用数据库。 共享服务+共享存储=一个强壮的集群管理。 迁移服务集群的时候,数据的同步是非常重要的。

实验背景 :

实验是在做完RHCS高可用HA集群的基础上做的 高可用RHCS集群的搭建

| 主机名 | IP | 服务 |

|---|---|---|

| server1 | 172.25.7.1 | ricci,luci, iscsi,httpd |

| server2 | 172.25.7.2 | ricci,iscsi,httpd |

| server3 | 172.25.7.3 | iscsi |

| foundation7 | 172.25.7.250 | fence |

一、RHCS高可用集群下iscsi共享存储

1.为什么要实现高可用集群下的iscsi磁盘共享

在我们之前做的实验中,把测试页分别写在了两个节点server1和server2上(由于要观察实验效果所以内容不一样),而在企业中要反馈给用户的页面不会只有server1、server2这么简单,更不可能把那些数据放在每一个节点的主机里。此时就需要存储分离,所以就有了高可用集群下的iscsi磁盘共享。

2.部署实验环境

此实验需要3台虚拟机,server1和server2已经配置好了。只需要关闭上一实验中配置的apache

clusvcadm -d apache

clusvcadm -d apache (-d表示disabled)

clusvcadm -e apache (-e表示enable)

clusvcadm -r 重新定位 (加入现在服务在server1上,执行clusvcadm -r apache之后服务就会被定位到srever2上 )

在server3上 ,搭建共享磁盘设备的服务端

1)打开虚拟机管理器 virt-manager,给server3添加一个硬盘

2)cat /proc/partitions 可以发现多了一个/dev/vda

开启虚拟机server3并在server3中添加一个硬盘:

3.配置共享磁盘设备

yum install scsi-* -y #安装服务

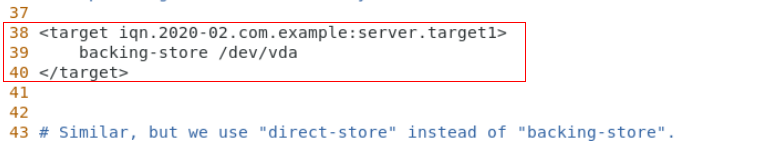

vim /etc/tgt/targets.conf #修改配置文件

/etc/init.d/tgtd start #开启服务

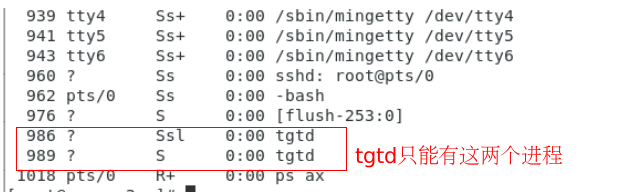

ps ax #查看进程

38 <target iqn.2019-02.com.example:server.target1>

39 backing-store /dev/vdb

##此处的设备名是通过fdisk -l看到的,每人可能都不一样

40 </target>

- 重启服务 :/etc/init.d/tgtd start

tgt-admin -s查看tgt的信息

ps ax发现应该有两个进程,查看进程,只有两个为正确。 如果大于2个就是错误的,删除重做 ,或者kill掉

tgt-admin 0s(错误的),tgt-admin -s查看共享出来磁盘

4.配置客户端server1&2

在server1和server2中(两个都要做):

yum install iscsi-* -y

iscsiadm -m discovery -t st -p 172.25.254.3

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

576

576

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?