这里因为是个人的学习记录,而不是详细的教程。所以很多具体的过程我就不多赘述了。

要学习hadoop,那么大家要有基础的多机器+linux环境。

所以需要准备的是:

-

安装VM虚拟机,设置好本机的虚拟网卡 便于和虚拟机进行网络通信

-

安装三个linux系统 在虚拟机上面来模仿集群的三台机器(这里大家可以搜索百度自己学着装,也可以去搜免费教程里面的现场的虚拟机vmx直接导入现成的linux系统)

-

在之前的环境上面 安装hadoop(集群安装)

这里有几个踩过的坑需要提醒大家

-

强烈建议大家安装finalshell远程连接操作虚拟机里的linux系统 这样会方便很多

-

win11的虚拟网卡刚开始是空的 在VM里面安装有时候也会失败,解决方法是这一篇https://blog.csdn.net/Young_Harry/article/details/123252641

-

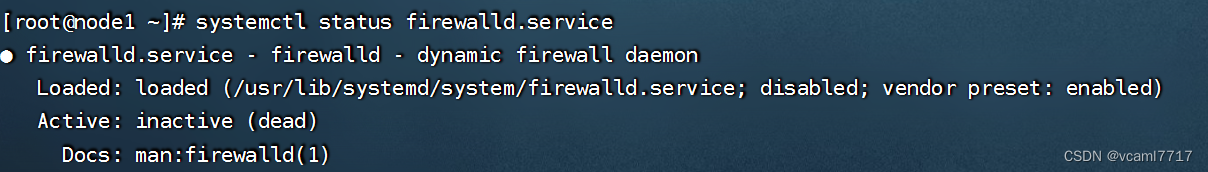

linux基础环境安装的时候记得屏蔽防火墙。有时候屏蔽没成功记得输入命令确认一下:

-

机器之间的ssh免密登录和时间同步 按照百度教程搞就好了 很简单

-

很多初学者接触hadoop之前是没学过java的,因为hadoop是java写的所以搭建环境的时候 linux上面记得先装jdk 然后配好环境变量

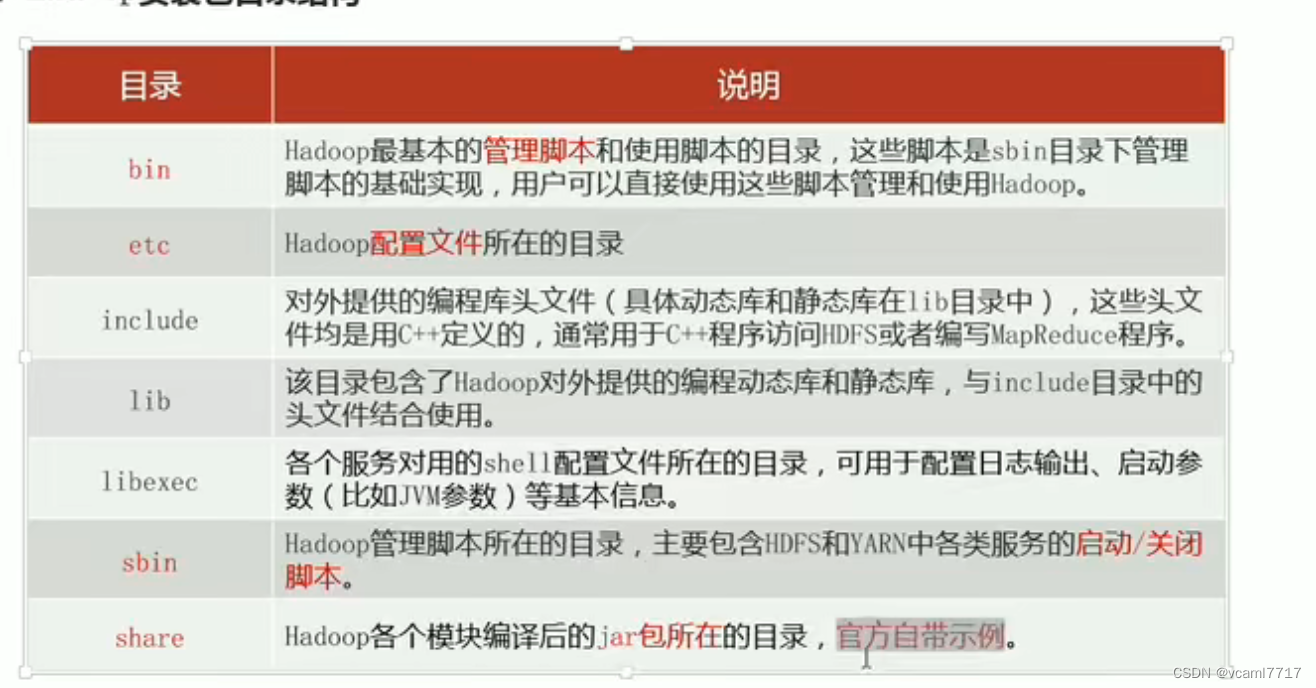

这里记录一个细节 就是大概了解一下hadoop安装包的目录结构,心里大概知道那一片是干什么的:

具体的安装过程 网上详细的教程很多我这里就不赘述了。总之推荐大家手把手自己搭一编hadoop框架,在工作中都是运维搭好的 我们最基本没有这种亲自动手的机会

747

747

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?