内容是根据中国大学嵩天老师的python网络爬虫与信息提取进行的

Requests库 是⽤Python语⾔编写,基于urllib,采⽤Apache2 Licensed开源协议的 HTTP 库。它⽐ urllib 更加⽅便,可以节约我们⼤量的⼯作,完全满⾜HTTP测试需求 。 ⼀句话——Python实现的简单易⽤的HTTP库 。

主要作用:自动爬取HTML页面,自动网络请求提交

Requests库的安装

使用的win系统,下载后以管理员身份运行,cmd,执行 pip install requsets,

项目导入:import requests

环境装好后,用IDLE(python)就可以开始学习啦。

Requests的2个主要对象

当使用 r = requests.get(url)返回的是response的对象,他包含服务器返回的所有信息,也包含请求的request的信息

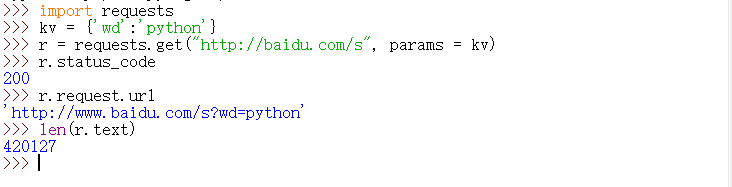

如例子

Response对象的属性

| 属性 | 说明 |

|---|---|

| r.status_code | HTTP请求的返回状态,200表示连接成功,404表示失败 |

| r.text | HTTP响应内容的字符串形式,即,url对应的页面内容 |

| r.encoding | 从HTTP,header中猜测响应方式内容编码方式,如果header中不存在charset,则认为编码为ISO‐8859‐1 r.text根据r.encoding显示网页内容 |

| r.apparent_encoding | 从内容中分析出响应内容编码方式,可以看成是r.encoding的备选 |

| r.content | HTTP响应内容的二进制 |

网络连接有风险,异常处理很重要

requests库的异常#### requests库的异常

| 异常 | 说明 |

|---|---|

| requests.ConnectionError | 网络连接错误异常,如DNS查询失败、拒绝连接等 |

| requests.HTTPError | HTTP错误异常 |

| requests.URLRequiredURL | URL缺失异常 |

| requests.TooManyRedirects | 超过最大重定向次数,产生重定向异常 |

| requests.ConnectTimeout | 连接远程服务器超时异常 |

| requests.Timeout | 请求URL超时,产生超时异常 |

Response的异常

r.raise_for_status()在方法内部判断r.status_code是否等于200,不需要 增加额外的if语句,该语句便于利用try‐except进行异常处理

通用代码框架

需要注意出错的原因:

HTTP协议和Requests的7个主要方法

HTTP,Hypertext Transfer Protocol,超文本传输协议

HTTP是一个基于“请求与响应”模式的、无状态的应用层协议 HTTP协议采用URL作为定位网络资源的标识,URL格式如下:http://host[:port][path]

host: 合法的Internet主机域名或IP地址

port: 端口号,缺省端口为80

path: 请求资源的路径

HTTP URL实例

http://www.baidu.com

https://baike.baidu.com/item/华晨宇/6064097?fr=aladdin

HTTP URL的理解:

URL是通过HTTP协议存取资源的Internet路径,一个URL对应一个数据资源

HTTP协议方法与Requests的7个方法

| HTTP协议方法 | Requests库方法 | 功能性 |

|---|---|---|

| requests.get():构造一个请求,支撑以下各方法的基础方法 | ||

| GET:请求获取URL位置的资源 | requests.get():获取HTML网页的主要方法,对应于HTTP的GET | 一致 |

| HEAD:请求获取URL位置资源的响应消息报告,即获得该资源的头部信息 | requests.head():获取HTML网页头信息的方法,对应于HTTP的HEAD | 一致 |

| POST:请求向URL位置的资源后附加新的数据 | requests.post():向HTML网页提交POST请求的方法,对应于HTTP的POST | 一致 |

| PUT:请求向URL位置存储一个资源,覆盖原URL位置的资源 | requests.put():向HTML网页提交PUT请求的方法,对应于HTTP的PUT | 一致 |

| PATCH:请求局部更新URL位置的资源,即改变该处资源的部分内容 | requests.patch():向HTML网页提交局部修改请求,对应于HTTP的PATCH | 一致 |

| DELET:请求删除URL位置存储的资源 | requests.deleter():向HTML页面提交删除请求,对应于HTTP的DELETE | 一致 |

数据推送(push model)一般指将数据发送出去的行为。在Requests库中,post()、put()、patch()都体现这种行为模式。

get()方法最常用的原因在于服务器端对push()、post()、patch()等数据推送的限制,试想,如果允许大家向服务器提交数据,将带来无穷无尽的安全隐患。因此,通过get()获取数据,服务器作为数据提供方而不是接收方,更为安全

Requests库的主要方法解析

1. requests.request()方法

requests.request(method,url,**kwargs)

method:请求方式,对应get/put/post等7种

url:拟获取页面的ur链接

**kwargs:控制访问的参数,共12种

比如:params:字典或字节序列,作为参数增加到url种

data : 字典、字节序列或文件对象,作为Request的内容

json : JSON格式的数据,作为Request的内容

headers : 字典,HTTP定制头

cookies : 字典或CookieJar,Request中的cookie

auth : 元组,支持HTTP认证功能

files:字典类型,传输文件

time:设定超时时间,秒为单位

proxies : 字典类型,设定访问代理服务器,可以增加登录认证

allow_redirects : True/False,默认为True,重定向开关

verify : True/False,默认为True,认证SSL证书开关

cert : 本地SSL证书路径

2. requests.get()方法

requests.get(url,params=None, **kwargs)

url: 拟获取页面的url链接 ∙

params: url中的额外参数,字典或字节流格式,可选 ∙

**kwargs: 12个控制访问的参数

3. request.head()方法

requests.head(url,**kwargs)

url: 拟获取页面的url链接

**kwargs: 12个控制访问的参数

4.requests.post()方法

requests.post(url,data=None, json=None, **kwargs)

∙ url: 拟更新页面的url链接 ∙

data : 字典、字节序列或文件,Request的内容 ∙ j

son: JSON格式的数据,Request的内容 ∙

**kwargs: 12个控制访问的参数

5. requests.put()方法

requests.put(url,data=None, **kwargs

url: 拟更新页面的url链接 ∙

data : 字典、字节序列或文件,Request的内容 ∙ *

*kwargs: 12个控制访问的参数

6.requests.patch()方法

requests.patch(url,data=None, **kwargs)

url: 拟更新页面的url链接 ∙

data : 字典、字节序列或文件,Request的内容 ∙

**kwargs: 12个控制访问的参数

7 request.delete(ur1,**kwargs)

requests.delete(url,**kwargs)

url: 拟删除页面的url链接 ∙

**kwargs: 12个控制访问的参

实例1 京东页面爬取

爬取 https://item.jd.com/100008643328.html

import requests

url = " https://item.jd.com/100008643328.html "

try:

r = requests.get(url)

r.raise_for_status()

r.encoding = r.apparent.encoding

print(r.text[-500:])

except:

print("爬取失败")

实例2 百度/360搜索关键字提交

搜索引擎关键词提交接口

百度的关键词接口: http://www.baidu.com/s?wd=keyword

360的关键词接口: http://www.so.com/s?q=keyword

# 全代码

import requests

keyword = "python"

try:

kv = {'wd':keyword}

r = requests.get("http://www.baidu.com/s", params=kv)

print(r.requests.url)

r.raise_for_status()

print(len(r.text))

except:

print("爬取失败")

实例3 网络图片的爬取和存储

网络图片的爬取

网络图片链接的格式 http://example.com/picture.jpg

例如:华晨宇百度百科中烟火里的尘埃: https://gss1.bdstatic.com/9vo3dSag_xI4khGkpoWK1HF6hhy/baike/w%3D268%3Bg%3D0/sign=c5b6019fc8ef76093c0b9e9916e6c4f1/78310a55b319ebc47e07739b8126cffc1e1716b0.jpg

# 全代码

import requests

import os

url = "##### https://gss1.bdstatic.com/9vo3dSag_xI4khGkpoWK1HF6hhy/baike/w%3D268%3Bg%3D0/sign=c5b6019fc8ef76093c0b9e9916e6c4f1/78310a55b319ebc47e07739b8126cffc1e1716b0.jpg"

root = "D:/pics//"

path = root + url.split('/')[-1]

try:

if not os.path.exists(root):

os.mkdir(root)

if not os.path.exists(path):

r = requests.get(url)

with open(path, 'wb') as f:

f.write(r.content)

f.close()

print("文件保存成功")

else:

print("文件已保存")

except:

print("爬取失败")

实例4 IP地址归属地的自动查询

www.ip138.com 网站提供IP查询

# 全代码

import requests

url = "http://m.138.com/ip.asp?ip="

try:

r = requests.get(url + '14.215.177.39')

r.raise_for_status()

r.encoding = r.apparent.encoding

print(r.text[-500:])

except:

print("爬取失败")

7691

7691

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?