1. pom文件中加入依赖

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-connector-kafka_2.11</artifactId>

<version>1.9.1</version>

</dependency>

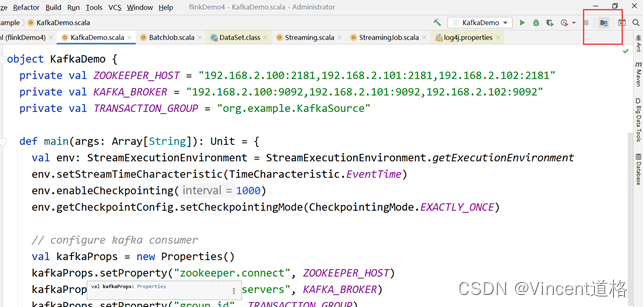

2 .编写KafkaDemo.scala程序

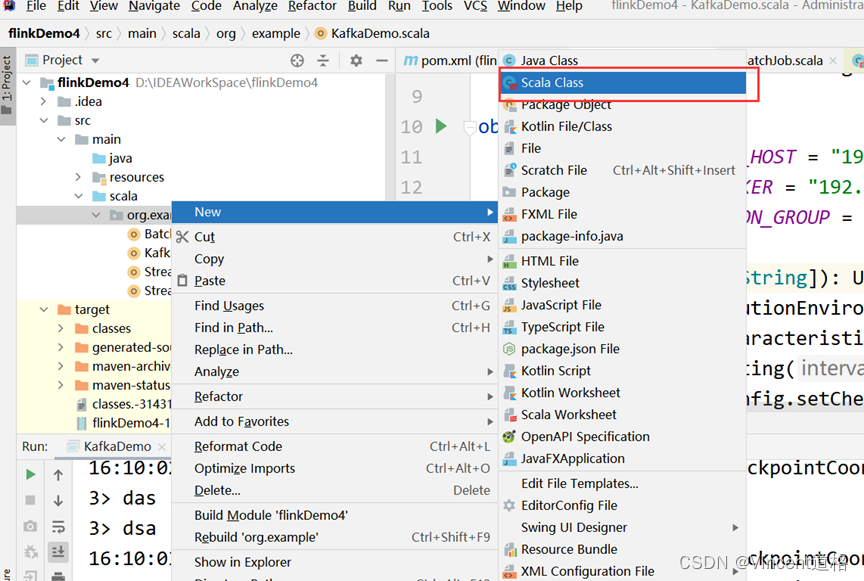

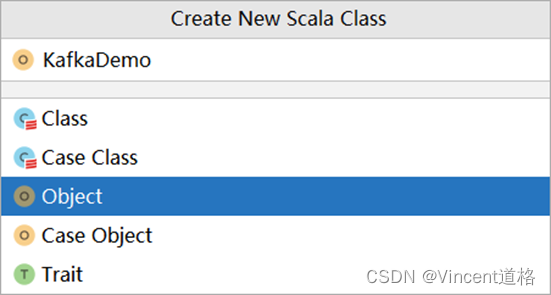

先创建一个scala类

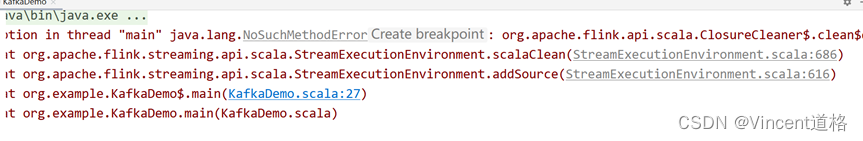

此处要注意很多API导入的包是否正确,若导错包会导致报错。此外,在写完程序后的第一次运行中,遇到了报错,大意是缺少某个依赖:

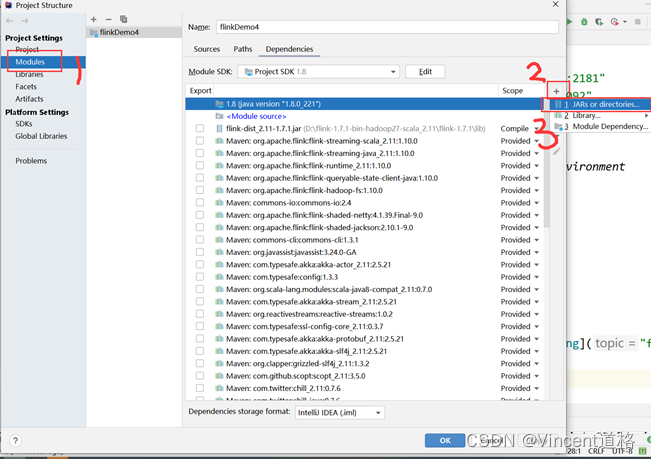

百度后成功解决:

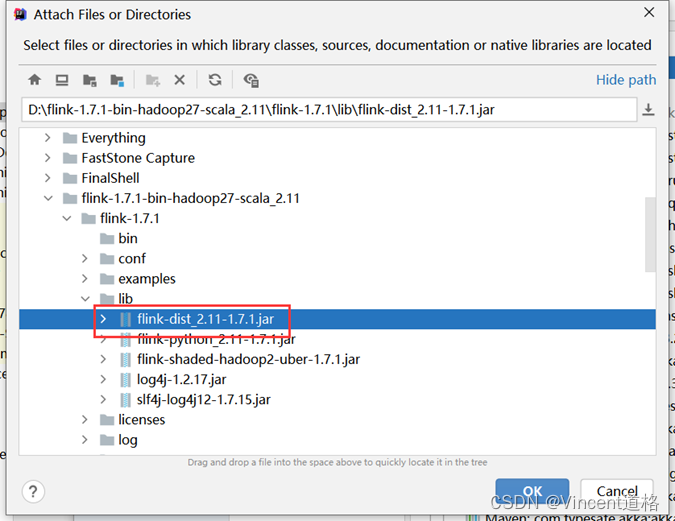

加入该jar包

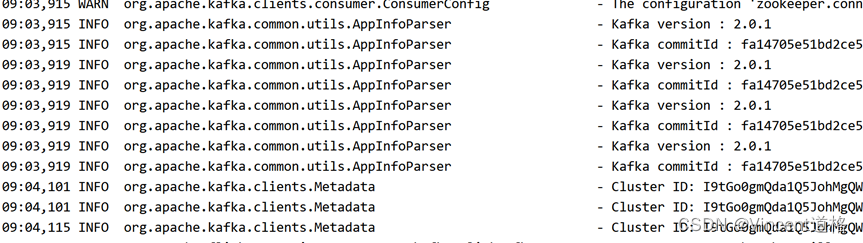

加入后程序正常运行,控制台中没有出现报错信息

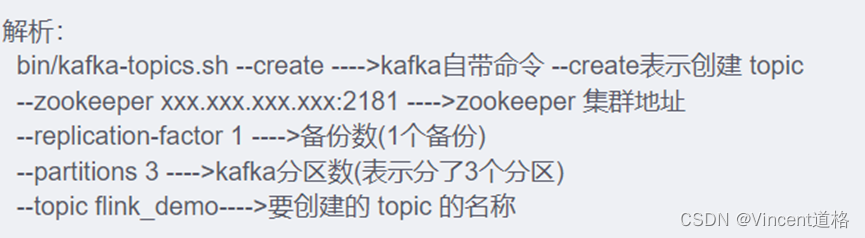

3 .创建Topic

来到Linux端,输入命令打开至kafka/bin下,先创建一个Topic:

Bin/kafka-topic.sh --create --zookeeper

192.168.2.100:2181,192.168.2.101:2181,192.168.2.102:2181

–replication-factor 1 --partition 3 – topic flink_demo

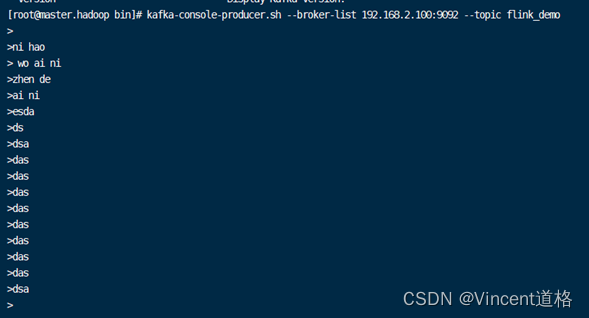

4 写入数据到kafka

bin/kafka-console-producer.sh --broker-list 192.168.2.100:9092 --topic flink_demo

因为此时是写入,所以用的是生产者

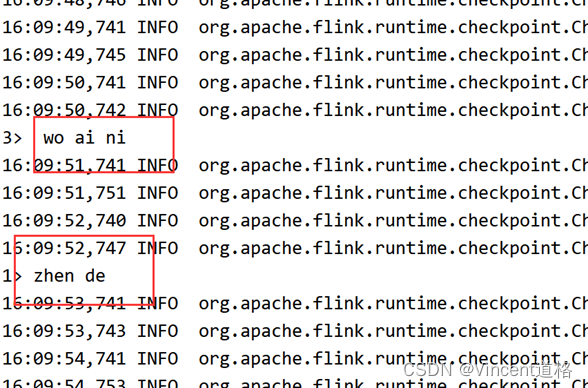

5 .结果演示

消费成功!

1635

1635

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?