以下小结为本人结合实验后得出的结论,如有错误或补充欢迎指正交流。(持续更新)

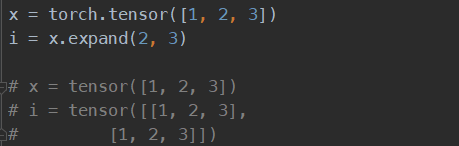

tensor.expand()

这个方法可以扩张维度,返回当前张量在某维扩展更大后的张量,但是被扩张的维度里的元素只能唯一。

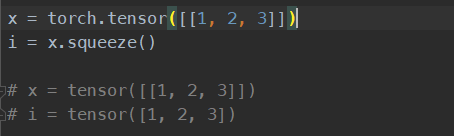

tensor.squeeze()

将维度压缩到最紧凑的状态

至于为啥要压缩,也不是很清楚

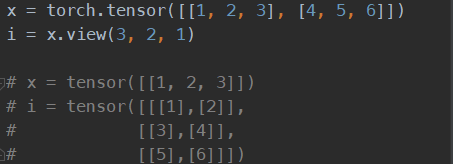

tensor.view()

将矩阵变成想要的形状

参数为该维度中元素个数,如图dim=0的元素个数为3,dim=1的元素个数为2,dim=2的元素个数为1。(图中x = tensor([[1, 2, 3]]请忽略)

torch.contiguous()

view只能用在contiguous的variable上。

如果在view之前用了transpose, permute等,需要用contiguous()来返回一个contiguous copy。

torch.permute()

进行维度交换,permute(1, 0, 2)代表原来的第0维与第1维交换,第2维不变。

这个很玄学,至今没搞太懂,只知道它是交换维度,具体交换的原理没懂。

torch.unsqueeze(i)

这个函数可以在i维度添加1个维度。为什么需要?

这个功能用view()函数也可以实现。这一功能尤其在神经网络输入单个样本时很有用,由于pytorch神经网络要求的输入都是mini-batch型的,维度为[batch_size, channels, w, h],而一个样本的维度为[c, w, h],此时用unsqueeze()增加一个维度变为[1, c, w, h]就很方便了。

反正就是补充一个维度使输入满足pytorch需要。

tensor.zero_like(tensor)

创建一个形状一样的全零tensor

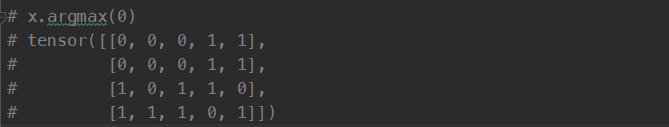

tensor.argmax(dim=)

比较大小,找出最大元素下标

dim=0时我们注意到,矩阵第0维为2,那么比较就是两个两个比,怎么比?

这样比,怎么理解,就是在第0维度上,有2个元素,这两个元素做比较,比他们的第0维大小,而他们的第0维又是tensor也就是黄色框,那就比这个tensor的第0维也就是红色框,所以结果就是[0, 0, 0, 1, 1]。这是两个黄色框的比较结果,将所有一一比完就得到图中的结果。

同理dim=1时的比较结果就如图

torch.clamp

torch.clamp(input, min, max, out=None) → Tensor

将tensor的值夹紧到区间

945

945

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?