Boosting包括:

- Adaboost

- XGboost

- GBDT

- LigntGBM

个体学习器之间串行存在

Boosting的算法原理

1.Boosting算法的工作机制是首先从训练集用初始权重训练出十个弱学习器1,

2.根据弱学习的学习误差率表现来更新训练样本的权重,使之前弱学习器1学习误差率高

的训练样本点的权重变高而这些误差率高的点在后面的弱学习器2中得到更多的重视。

3.然后基于调整权重后的训练集来训练弱学习器2

4. .如此重复进行,直到弱学习器数达到事先指定的数目工,最终将这工个弱学习器通过集

合策略进行整合,得到最终的强学习器

Bagging包括:

- RandomForest

个体学习器之间并行存在

Bagging的算法原理

Bagging的个体弱学习器的训练集是通过随机采样得到的。通过T次的随机采样我们就可以得到T个采样集,对于这T个采样集,我们可以分别独立的训练出T个弱学习器,再对这T个弱学习器通过集合策略来得到最终的强学习器。

随机采样一般采用的是有放回地采集T次,最终可以得到T个样本的采样集,由于是随机采样,这样每次的采样集是和原始训练集不同的,和其他采样集也是不同的,这样得到多个不同的弱学习器。

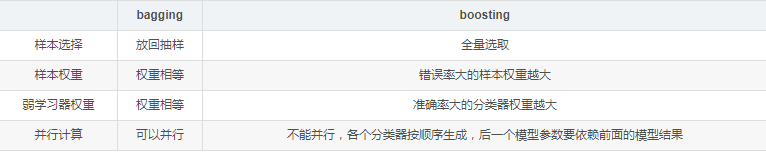

bagging和boosting的区别

1963

1963

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?