hadoop+zookeeper+kafka集群搭建

创建四台虚拟机

192.168.199.161 pass1

192.168.199.162 pass2

192.168.199.163 pass3

192.168.199.164 pass4

分别在四台虚拟机中编辑ip地址

[root@pass1 ~]# cat /etc/sysconfig/network-scripts/ifcfg-ens33

ONBOOT="yes"

IPADDR=192.168.199.161(虚拟机ip)

GATEWAY=192.168.199.2

NETMASK=255.255.255.0

DNS1=8.8.8.8

重启网络并ping通www.baidu.com、关闭防火墙

systemctl restart network.service

systemctl stop firewalld

systemctl disable firewalld

ping www.baidu.com

四台虚拟机分别修改hostname

hostnamectl set-hostname pass1

hostnamectl set-hostname pass2

hostnamectl set-hostname pass3

hostnamectl set-hostname pass4

编辑/etc/hosts

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4

::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

192.168.199.161 pass1

192.168.199.162 pass2

192.168.199.163 pass3

192.168.199.164 pass4

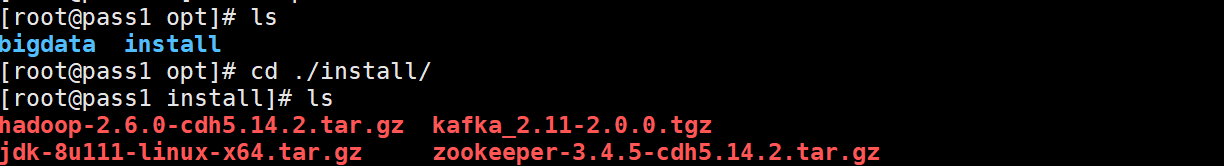

创建文件夹,并导入安装包

密钥pass1(234),pass2(134),pass3(124)

[root@pass1 ~]# ssh-keygen -t rsa

[root@pass1 .ssh]# ssh-copy-id pass1

[root@pass1 .ssh]# ssh-copy-id pass2

[root@pass1 .ssh]# ssh-copy-id pass3

[root@pass1 .ssh]# ssh-copy-id pass4

[root@pass2 opt]# ssh-keygen -t rsa

[root@pass2 .ssh]# ssh-copy-id pass1

[root@pass2 .ssh]# ssh-copy-id pass2

[root@pass2 .ssh]# ssh-copy-id pass3

[root@pass2 .ssh]# ssh-copy-id pass4

[root@pass3 opt]# ssh-keygen -t rsa

[root@pass3 .ssh]# ssh-copy-id pass1

[root@pass3 .ssh]# ssh-copy-id pass2

[root@pass3 .ssh]# ssh-copy-id pass3

[root@pass3 .ssh]# ssh-copy-id pass4

集群环境

编辑脚本,在root目录下创建bin文件夹

touch xrsync

vi xrsync

虚拟机之间传文件

#!/bin/bash

#1 获取输入参数个数,如果参数个数没有,退出

pcount=$#

if((pcount==0));then

echo no args;

exit;

fi

#2 获取文件名

p1=$1

fname=`basename $p1`

echo fname=$fname

#3 获取上级目录的绝对路径

pdir=`cd -P $(dirname $p1);pwd`

echo pdir=$pdir

#4 获取当前用户名字

user=`whoami`

#5 将文件拷贝到目标机器

for host in master slave01 slave02

do

echo ------------- $host ---------------

rsync -av $pdir/$fname $user@$host:$pdir

done

touch showjps.sh

vi showjps.sh

在一台机器上查看所有机器进程

#!/bin/bash

for host in master

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

145

145

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?