机器学习是什么?

定义:利用经验改善系统性能

流程:

学习过程,就是从假设空间进行“搜索”的过程

不同的模型方案,可以“搜索”到不同的假设,这个假设的集合叫做版本空间

免费午餐定理:没有最好的算法,只有最合适的算法。

模型评估

误差

训练数据分层:训练集,验证集,测试集

经验误差vs泛化误差:

经验误差-在训练集上的误差,对应训练集数据

泛化误差:在“未来”样本上的误差,对应测试集数据

验证集用来调整模型的超参数

评价指标

混淆矩阵:真实正(TP)、真实负(TN)、预测正(FP)、预测负(FN)交叉

Recall = 真实预测相交数量(正或负)/真实总数(正或负)

Precision = 真实预测相交数量(正或负)/预测总数(正或负)

Accuracy = 预测成功数量/总数

F1 = 2RecallPrecision/(Recall+Precision)

偏差 Bias = |期望值-实际值|

方差 Variance 模型预测值的方差(代表散度,散度越大方差越大)

Err(x) = Bias² + Variance + Irreducible Error(不可预测的错误)

模型越复杂,模型拟合能力越强,偏差逐渐变小,容易过拟合;模型越复杂,可能性就会越多,方差越大

ROC曲线将每个个体抽象为以真正率为横轴、假正率为竖轴的点,这些点连成的曲线是ROC曲线,两端点连成的直线为AUC

线性模型

线性回归

定义:使用线性模型拟合数据的方法

形式:f(x) = wx + b

最小二乘法

原理:当预测值和实际值距离的平方和最小时,就选定模型中的两个参数

逻辑回归(Logistic Regression)

又叫对数几率回归,表达某种事件发生的可能性。

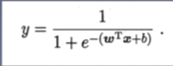

逻辑回归 = 线性回归+Sigmoid函数(将线性回归的结果作为Sigmoid函数的输入,得到上述公式)

Sigmoid函数:

逻辑回归损失函数

损失函数越小,模型越好。

最大似然估计

每次猜对的可能性的乘积最大值。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?