GPU为NVIDIA GeForce RTX 2060 with Max-Q Design,内存6G

系统为windows11

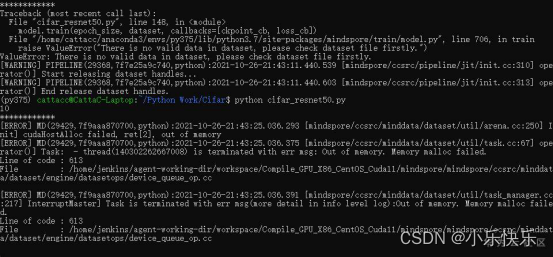

【操作步骤&问题现象】

1、安装wsl2,anaconda3,在python3.7.5环境下运行mindspore1.5.0-rc1

2、对CIFAR-10数据集尝试使用ResNet-50实现图像分类

3、可调用CPU进行分类,但调用GPU时提示cudaHostAlloc failed, ret[2], out of memory

4、可以调用GPU完成对MNIST数据集实现图像分类

【截图信息】

解答:

可以做如下尝试:

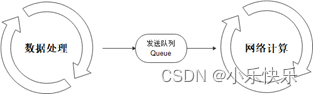

1. 把batch_size调小一些,看是不是还有这样的问题。 // 让发送队列小一些

2. 把 model.train(..., dataset_sink_mode=False) 试下。 // 不使用“发送队列”模式

你的报错,我又看了下,是因为数据处理流程和计算流程之间有个队列(dataset_sink_mode=True时),这个队列会申请一些GPU显存来维护这个队列,而在申请空间时,报了Out of memory。

在Windows 11环境中,遇到使用MindSpore在NVIDIA GeForce RTX 2060 Max-Q上运行ResNet-50处理CIFAR-10数据集时的CUDA内存溢出问题。通过调整batch_size和dataset_sink_mode设置,解决GPU内存不足的问题,同时对比MNIST案例的顺利运行。

在Windows 11环境中,遇到使用MindSpore在NVIDIA GeForce RTX 2060 Max-Q上运行ResNet-50处理CIFAR-10数据集时的CUDA内存溢出问题。通过调整batch_size和dataset_sink_mode设置,解决GPU内存不足的问题,同时对比MNIST案例的顺利运行。

5058

5058

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?