这里写目录标题

一、Sqoop简介

1.Sqoop概述

传统的应用程序管理系统,即应用程序与使用RDBMS的关系数据库的交互,是产生大数据的来源之一。由RDBMS生成的这种大数据存储在关系数据库结构中的关系数据库服务器中。

当大数据存储和Hadoop生态系统的MapReduce,Hive,HBase,Cassandra,Pig等分析器出现时,他们需要一种工具来与关系数据库服务器进行交互,以导入和导出驻留在其中的大数据。在这里,Sqoop在Hadoop生态系统中占据一席之地,以便在关系数据库服务器和Hadoop的HDFS之间提供可行的交互。

Sqoop - “SQL到Hadoop和Hadoop到SQL”

Sqoop是一个用于在Hadoop和关系数据库服务器之间传输数据的工具。它用于从关系数据库(如MySQL,Oracle)导入数据到Hadoop HDFS,并从Hadoop文件系统导出到关系数据库。它由Apache软件基金会提供。

2、Sqoop如何工作?

下图描述了Sqoop的工作流程。

3、Sqoop导入

导入工具从RDBMS向HDFS导入单独的表。表中的每一行都被视为HDFS中的记录。所有记录都以文本文件的形式存储在文本文件中或作为Avro和Sequence文件中的二进制数据存储。

4、Sqoop导出

导出工具将一组文件从HDFS导出回RDBMS。给Sqoop输入的文件包含记录,这些记录在表中被称为行。这些被读取并解析成一组记录并用用户指定的分隔符分隔。

二、安装sqoop

1.4.7好多东西需要修改不兼容,最好下载1.4 .6 的

http://archive.apache.org/dist/sqoop/1.4.6/

1.下载sqoop

wget http://archive.apache.org/dist/sqoop/1.4.6/sqoop-1.4.6.bin__hadoop-2.0.4-alpha.tar.gz

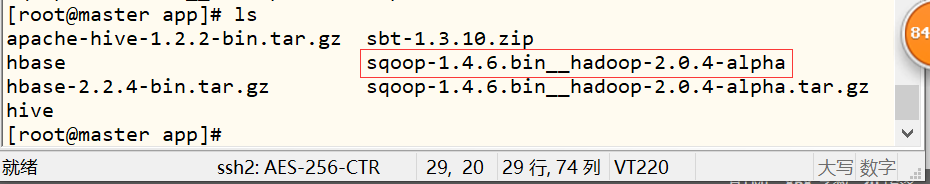

2.解压并改名为sqoop ,移出usr

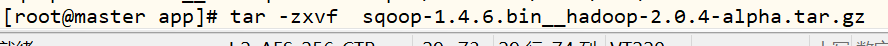

tar -zxvf sqoop-1.4.6.bin__hadoop-2.0.4-alpha.tar.gz

改名

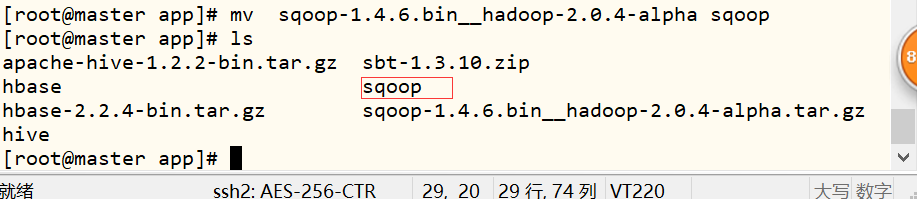

mv sqoop-1.4.6.bin__hadoop-2.0.4-alpha sqoop

将移到/usr

将移到/usr

mv sqoop /usr

3.修改sqoop/conf里面的文件

cd /usr/sqoop/conf

(1)修改sqoop-env.sh

复制sqoop-env-template.sh 为sqoop-env.sh

cp sqoop-env-template.sh sqoop-env.sh

修改

修改

vi sqoop-env.sh

添加

export HADOOP_COMMON_HOME=/usr/hadoop

export HADOOP_MAPRED_HOME=/usr/hadoop

export HIVE_HOME=/usr/hive

export ZOOKEEPER_HOME=/usr/zookeeper

export ZOOCFGDIR=/usr/zookeeper

export HBASE_HOME=/usr/hbase

4.拷贝JDBC驱动

cd /usr/sqoop/lib

rz

5、验证sqoop

bin/sqoop help

6.测试Sqoop是否能成功连接数据库

[root@master sqoop]# bin/sqoop list-databases --connect jdbc:mysql://master:3306 --username root --password 123456

三、 Sqoop的简单使用案例

1、导入数据

在Sqoop中,“导入”概念指:从非大数据集群(RDBMS)向大数据集群(HDFS,HIVE,HBASE)中传输数据,叫做:导入,即使用import关键字。

1、RDBMS到HDFS

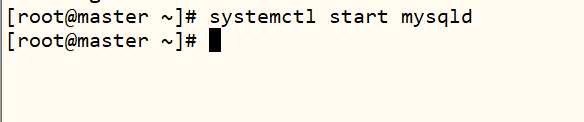

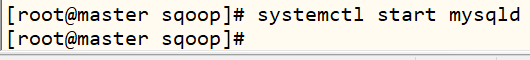

1)确定Mysql服务开启正常

systemctl start mysqld

2) 登录Mysql,新建一张表并插入一些数据

mysql -uroot -p

mysql> create database company;

mysql> create table company.staff(id int(4) primary key not null auto_increment, name varchar(255), sex varchar(255));

mysql> insert into company.staff(name, sex) values('Thomas', 'Male');

mysql> insert into company.staff(name, sex) values('Catalina', 'FeMale');

3)导入数据

3)导入数据

(1)全部导入

bin/sqoop import \

--connect jdbc:mysql://192.168.100.101:3306/company \

--username root \

--password 123456 \

--table staff \

--target-dir /user/company \

--delete-target-dir \

--num-mappers 1 \

--fields-terminated-by "\t"

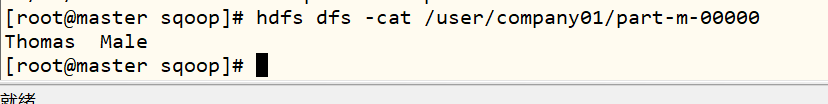

(2)查询导入

bin/sqoop import \

--connect jdbc:mysql://192.168.100.101:3306/company \

--username root \

--password 123456 \

--target-dir /user/company01 \

--delete-target-dir \

--num-mappers 1 \

--fields-terminated-by "\t" \

--query 'select name,sex from staff where id <=1 and $CONDITIONS;'

提示:must contain '

C

O

N

D

I

T

I

O

N

S

′

i

n

W

H

E

R

E

c

l

a

u

s

e

.

如

果

q

u

e

r

y

后

使

用

的

是

双

引

号

,

则

CONDITIONS' in WHERE clause. 如果query后使用的是双引号,则

CONDITIONS′inWHEREclause.如果query后使用的是双引号,则CONDITIONS前必须加转移符,防止shell识别为自己的变量,即"$CONDITIONS"

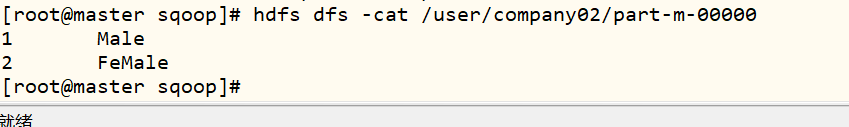

(3)导入指定列

(3)导入指定列

bin/sqoop import \

--connect jdbc:mysql://192.168.100.101:3306/company \

--username root \

--password 123456 \

--target-dir /user/company02 \

--delete-target-dir \

--num-mappers 1 \

--fields-terminated-by "\t" \

--columns id,sex \

--table staff

提示:columns中如果涉及到多列,用逗号分隔,分隔时不要添加空格

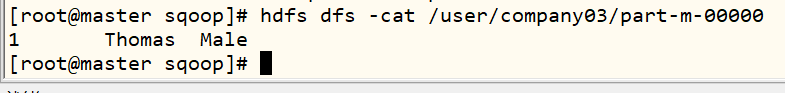

(4)使用sqoop关键字筛选查询导入数据

(4)使用sqoop关键字筛选查询导入数据

bin/sqoop import \

--connect jdbc:mysql://192.168.100.101:3306/company \

--username root \

--password 123456 \

--target-dir /user/company03 \

--delete-target-dir \

--num-mappers 1 \

--fields-terminated-by "\t" \

--table staff \

--where "id=1"

2、 RDBMS到Hive

bin/sqoop import \

--connect jdbc:mysql://192.168.100.101:3306/company \

--username root \

--password 123456 \

--table staff \

--num-mappers 1 \

--hive-import \

--fields-terminated-by "\t" \

--hive-overwrite \

--hive-table staff_hive

提示:该过程分为两步,第一步将数据导入到HDFS,第二步将导入到HDFS的数据迁移到Hive仓库,第一步默认的临时目录是/user/atguigu/表名

自动创建staff_hive

3 、RDBMS到Hbase

bin/sqoop import \

--connect jdbc:mysql://192.168.100.101:3306/company \

--username root \

--password 123456 \

--table staff \

--columns "id,name,sex" \

--column-family "info" \

--hbase-create-table \

--hbase-row-key "id" \

--hbase-table "hbase_company" \

--num-mappers 1 \

--split-by id

提示:sqoop1.4.6只支持HBase1.0.1之前的版本的自动创建HBase表的功能

解决方案:启动,手动创建HBase表

[root@master hbase]# bin/hbase shell

hbase> create 'hbase_company','info'

运行:

运行:

在HBase中scan这张表得到如下内容

hbase> scan 'hbase_company'

这里版本不兼容,实现不了,后续找到方法再改

2、导出数据

在Sqoop中,“导出”概念指:从大数据集群(HDFS,HIVE,HBASE)向非大数据集群(RDBMS)中传输数据,叫做:导出,即使用export关键字。

HIVE/HDFS到RDBMS

创建 export_staff表

mysql> create table export_staff like staff;

HIVE/HDFS到RDBMS

HIVE/HDFS到RDBMS

bin/sqoop export \

--connect jdbc:mysql://192.168.100.101:3306/company \

--username root \

--password 123456 \

--table export_staff \

--num-mappers 1 \

--export-dir /user/hive/warehouse/staff_hive \

--input-fields-terminated-by "\t"

提示:Mysql中如果表不存在,不会自动创建

脚本打包

使用opt格式的文件打包sqoop命令,然后执行

1) 创建一个job文件

mkdir job

2) 编写sqoop脚本

vi job/sqp.opt

export

--connect

jdbc:mysql://192.168.100.101:3306/company

--username

root

--password

123456

--table

staff

--num-mappers

1

--export-dir

/user/hive/warehouse/staff_hive_opt

--input-fields-terminated-by

"\t"

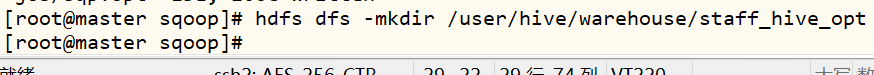

3)创建staff_hive_opt

hdfs dfs -mkdir /user/hive/warehouse/staff_hive_opt

4) 执行该脚本

bin/sqoop --options-file job/sqp.opt

3、 中途遇到的坑

**1.**20/06/07 00:12:06 INFO sqoop.Sqoop: Running Sqoop version: 1.4.6

20/06/07 00:12:06 ERROR tool.BaseSqoopTool: Error parsing arguments for list-databases:

20/06/07 00:12:06 ERROR tool.BaseSqoopTool: Unrecognized argument: username

20/06/07 00:12:06 ERROR tool.BaseSqoopTool: Unrecognized argument: root

20/06/07 00:12:06 ERROR tool.BaseSqoopTool: Unrecognized argument: --password

20/06/07 00:12:06 ERROR tool.BaseSqoopTool: Unrecognized argument: 123456

Try --help for usage instructions.

原因:忘记打开数据库

原因:忘记打开数据库

解决:

[root@master sqoop]# systemctl start mysqld

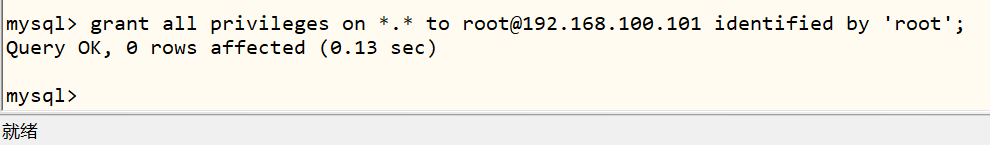

2.ERROR manager.SqlManager: Error executing statement: java.sql.SQLException: No database selected

2.ERROR manager.SqlManager: Error executing statement: java.sql.SQLException: No database selected

java.sql.SQLException: No database selected 原因:MySQL权限不够,解决如下:

原因:MySQL权限不够,解决如下:

mysql> grant all privileges on . to root@192.168.100.101 identified by ‘123456’;

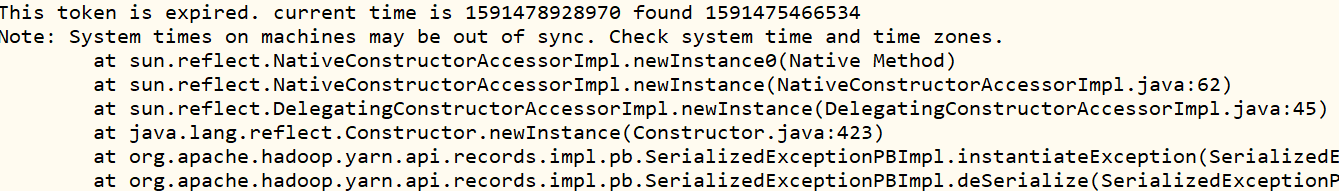

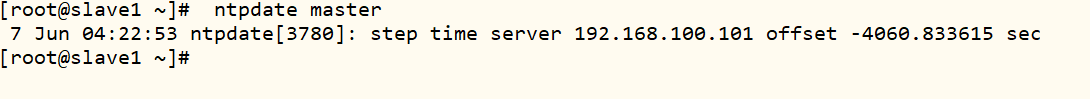

4、Note: System times on machines may be out of sync. Check system time and time zones. 原因:master和slave1,2 不同步

原因:master和slave1,2 不同步

解决:

ntpdate master

5、NoSuchMethodError: org.apache.hadoop.hbase.client.HBaseAdmin.(Lorg/apache/hadoop/conf/Configuration;)V

5、NoSuchMethodError: org.apache.hadoop.hbase.client.HBaseAdmin.(Lorg/apache/hadoop/conf/Configuration;)V

原因:版本不兼容,不能自动创建hbase_company

原因:版本不兼容,不能自动创建hbase_company

解决方案:启动,手动创建HBase表

[root@master hbase]# bin/hbase shell

hbase> create 'hbase_company','info'

2033

2033

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?