项目场景:

提示:这里简述项目相关背景:

- 了解下ChatGLM

问题描述

提示:这里描述项目中遇到的问题:

- 安装ChatGLM

解决方案:

提示:这里填写该问题的具体解决方案:

参考资料:

- 视频:

https://www.bilibili.com/video/BV1t8411y7fp/?spm_id_from=333.337.search-card.all.click&vd_source=829e480439ce92aa9bca7c1dc54a64c0

github:

https://github.com/THUDM/ChatGLM-6B

环境搭建:

-

安装anaconda

https://www.anaconda.com/download/ -

安装pycharm

https://www.jetbrains.com/pycharm/download/?section=windows -

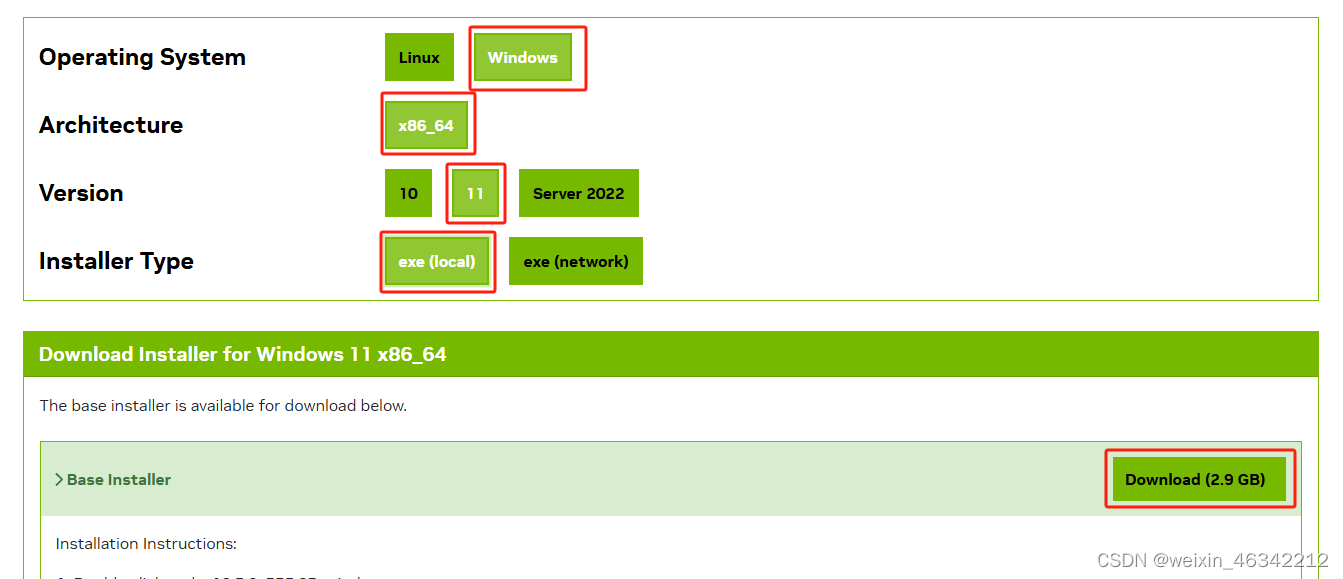

安装cuda,我装的12.5

https://developer.nvidia.com/cuda-downloads?target_os=Windows

-

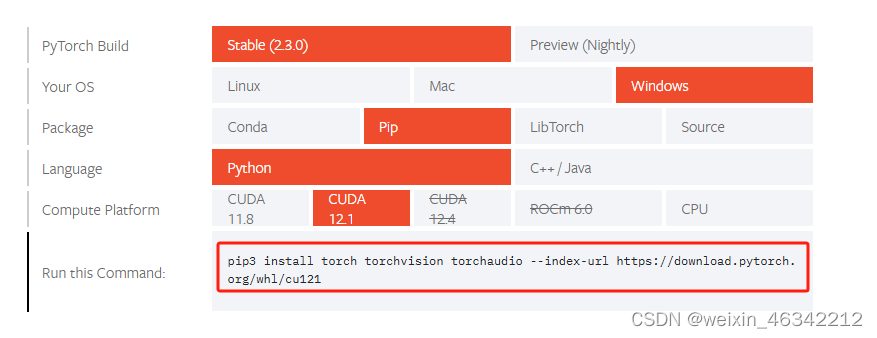

安装pytorch,我装的2.3.0+cu121

https://pytorch.org/get-started/locally/

-

用anaconda创建虚拟环境,python版本我选的3.8

-

进入conda环境

-

下github项目

https://github.com/THUDM/ChatGLM-6B -

安装依赖

pip install -r requirements.txt -

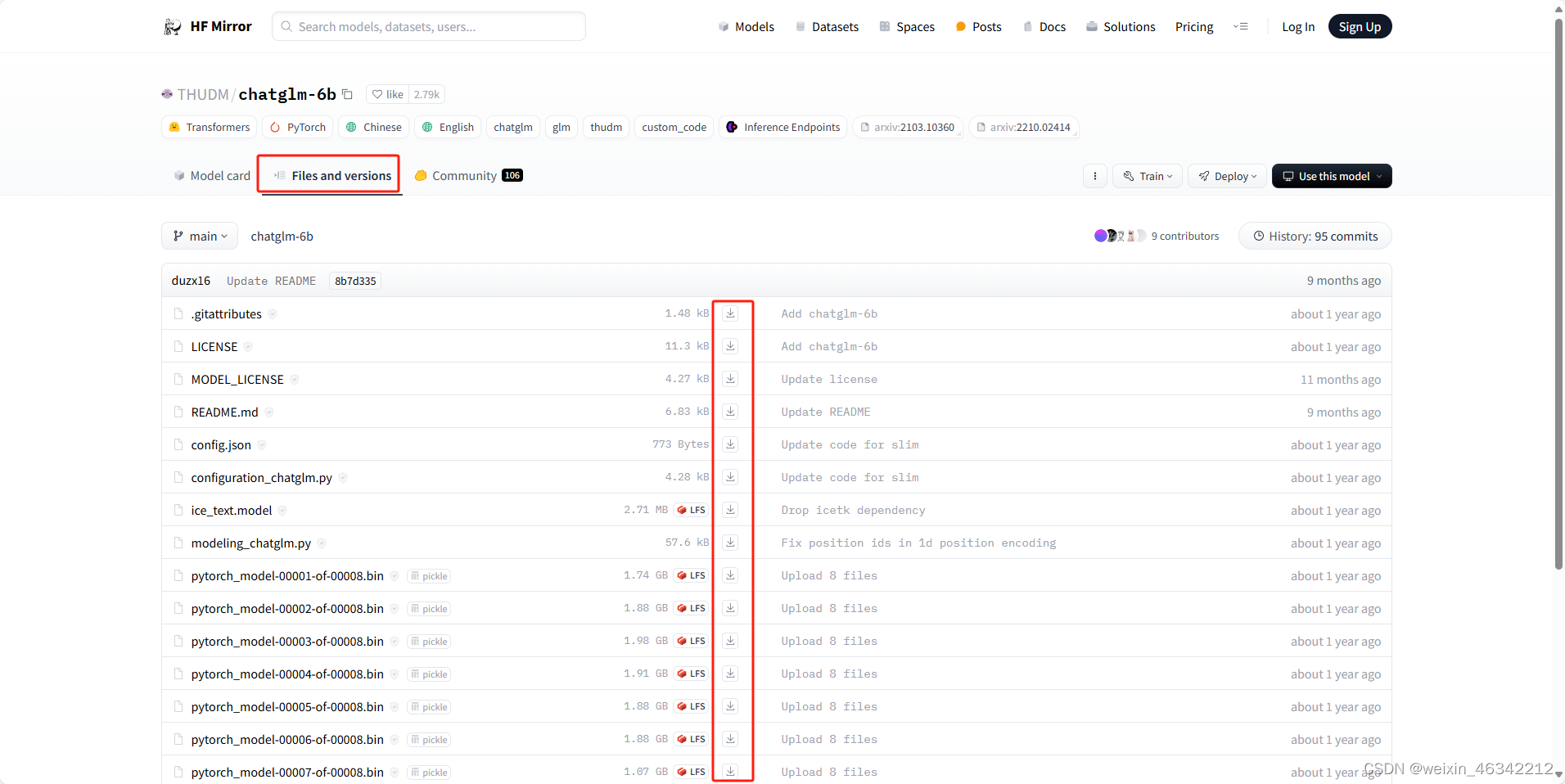

下载模型

https://huggingface.co/THUDM/chatglm-6b

https://hf-mirror.com/THUDM/chatglm-6b -

下载模型的时候在调用的代码上面添加下面的代码,就可以使用国内的镜像来下载,或者直接访问镜像的地址手动来下载到一个目录中

import os os.environ['HF_ENDPOINT'] = 'https://hf-mirror.com'

-

拷贝测试代码

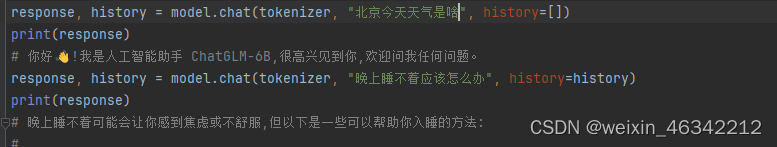

import os os.environ['HF_ENDPOINT'] = 'https://hf-mirror.com' from transformers import AutoTokenizer, AutoModel #tokenizer = AutoTokenizer.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True) #model = AutoModel.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True).half().cuda() tokenizer = AutoTokenizer.from_pretrained(r"填写自己下载好的模型的目录路径", trust_remote_code=True) model = AutoModel.from_pretrained(r"填写自己下载好的模型的目录路径", trust_remote_code=True).half().cuda() model = model.eval() response, history = model.chat(tokenizer, "你好", history=[]) print(response) # 你好👋!我是人工智能助手 ChatGLM-6B,很高兴见到你,欢迎问我任何问题。 response, history = model.chat(tokenizer, "晚上睡不着应该怎么办", history=history) print(response) -

都装完了之后,启动,测试成功

386

386

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?