错误代码:

CRSError: Invalid projection: epsg:4326: (Internal Proj Error: proj_create: SQLite error on SELECT name, type, coordinate_system_auth_name, coordinate_system_code, datum_auth_name, datum_code, area_of_use_auth_name, area_of_use_code, text_definition, deprecated FROM geodetic_crs WHERE auth_name = ? AND code = ?: no such column: area_of_use_auth_name)

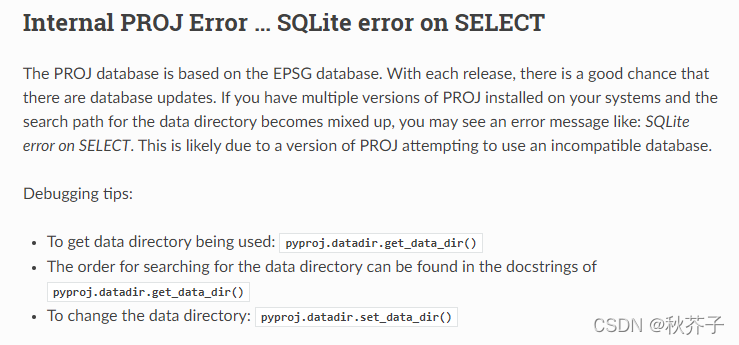

关于这个error的官方文档:https://pyproj4.github.io/pyproj/stable/gotchas.html#internal-proj-error-sqlite-error-on-select

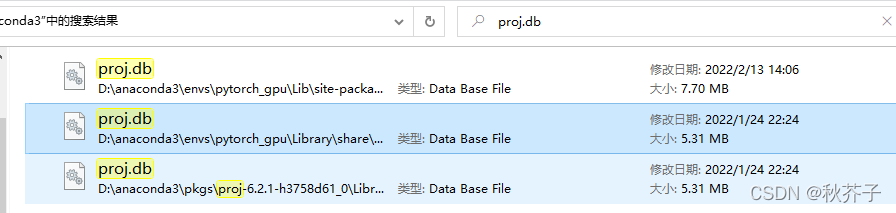

使用pyproj.datadir.get_data_dir()检查一下现在的路径,然后在anaconda的目录下搜一下其他的proj.db文件的路径:

复制路径在所装的环境文件夹下的Library文件夹下的那个路径,使用pyproj.datadir.set_data_dir()来更新目录。更新完了之后再用pyproj.datadir.get_data_dir()检查一下,如果没有更新成功记得看看是不是输入路径的时候打的\而不是\\!!(被这个坑了好久TAT一直没发现路径没更新成功)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?