关注上方“深度学习技术前沿”,选择“星标公众号”,

资源干货,第一时间送达!

即使有可靠的OCR模型,要回答需要在图片中阅读文字的问题,也对现有模型构成了一个挑战。其中最困难的是图片中经常有罕见字,多义字,比如地名,产品名,球队名。

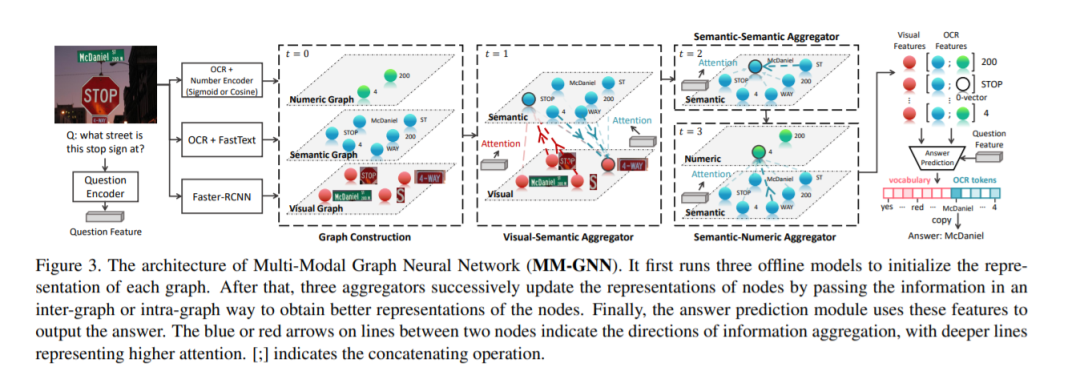

为了克服这个困难,我们的模型利用了图片中多个模态的丰富信息来推测图片中文字的语义,例如酒瓶上显眼位置的字样很可能是酒名。

有了这样的直观感受,我们设计了一个新的VQA模型---多模态图神经网络(MM-GNN)。它会首先构建一个具有三个子图的特征节点图,分别描述视觉,文字,和数字模态。此后,我们设计了三个融合子,在子图间或子图内进行信息传递。增强过后的节点特征被证明可以很好地帮助下游任务,我们在ST-VQA和Facebook的Text-VQA上都取得了SOTA的成绩。

论文速递

便捷下载,请关注深度学习技术前沿公众号

后台回复“MGNN” 就可以获取《【CVPR2020-中科院计算所】多模态GNN:在视觉信息和场景文字上联合推理》下载链接

推荐阅读:

重磅!自然语言处理技术交流群已成立!

欢迎各位NLPer加入自然语言处理技术交流群,本群旨在交流文本分类、语音识别、阅读理解、机器翻译、情感分析、信息检索、问答系统等自然语言处理领域内容。自然语言处理领域前沿信息将会第一时间在群里发布!欢迎大家进群一起交流学习!

麻烦大家进群后请备注:研究方向+地点+学校/公司+昵称(如文本分类+杭州+浙大+小民)

广告商、博主请绕道!

???? 长按识别,即可进群!

本文介绍了一种新型VQA模型——多模态图神经网络(MM-GNN),该模型通过构建视觉、文字和数字三个子图,并设计融合子在子图间传递信息,有效解决了图片中罕见字和多义字识别难题,在ST-VQA和Text-VQA数据集上取得SOTA成绩。

本文介绍了一种新型VQA模型——多模态图神经网络(MM-GNN),该模型通过构建视觉、文字和数字三个子图,并设计融合子在子图间传递信息,有效解决了图片中罕见字和多义字识别难题,在ST-VQA和Text-VQA数据集上取得SOTA成绩。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?