RDD 依赖关系和血缘关系

说明:

调用 toDebugString 方法可以查看 RDD 保存的血缘关系

RDD 窄依赖

新的 RDD 的一个分区的数据依赖于旧的 RDD 一个分区的数据,这个依赖称之为 OneToOne 依赖(窄依赖)

窄依赖表示每一个父(上游)RDD 的 Partition 最多被子(下游)RDD 的一个 Partition 使用,窄依赖我们形象的比喻为独生子女

RDD 宽依赖

新的 RDD 的一个分区的数据依赖于旧的 RDD 多个分区的数据,这个依赖称之为 shuffle 依赖(宽依赖)

宽依赖表示同一个父(上游)RDD 的 Partition 被多个子(下游)RDD 的 Partition 依赖,会引起 Shuffle,总结:宽依赖我们形象的比喻为多生

说明:

调用 dependencies 方法可以查看 RDD 之间的依赖关系

RDD 的 阶段划分 和 任务划分

窄依赖不涉及 shuffle,数据在同一分区,因此同一个 Task 可以完成

宽依赖涉及 shuffle,数据被打乱重新组合,因此要划分为不同阶段,由不同的 Task 完成

RDD 阶段划分

当 RDD 调用行动算子(collect)时,沿着RDD的依赖关系往前进行深度优先遍历,若遇到一个 Shuffle 依赖,依赖的每一个父 RDD 所有分区数据都计算完毕可以分别对应一个阶段,且都是当前阶段的父阶段,继续沿着父RDD往前遍历,若遇到一个窄依赖,则直接往前遍历,直到当前所有的依赖关系都被遍历才返回上一层,通过这个过程,最后会得到一张 DAG 。DAG 的最终阶段称之为结果阶段 (Result Stage),其余的阶段称为ShuffleMap阶段。

一个 shuffle 依赖会创建一个 shuffle 阶段,即阶段数 +1

阶段总数量 = shuffle 依赖(宽依赖)数量 + 1(ResultStage)

ResultStage 是整个流程的最后一个阶段

阶段划分的 Spark 核心源码

①createResultStage() 方法中,先调用 getOrCreateParentStages(),获得或创建父阶段

因为只有父阶段先执行完,才会执行当前的阶段;然后再创建 ResultStage,是最后要执行的阶段

②核心代码:

1)进入 getOrCreateParentStages(),调用 getShuffleDependencies() 返回值是 HashSet,存放是的依赖关系,再对每一个 shuffleDependence,调用 getOrCreateShuffleMapStage() 创建 shuffle 阶段,即一个shuffle依赖就会创建一个阶段

2)进入 getShuffleDependencies()

3)进入 getOrCreateShuffleMapStage(),调用 createShuffleMapStage(),创建 shuffle 阶段 new ShuffleMapStage

RDD 任务划分

RDD 任务切分中间分为:Application,Job,Stage 和 Task

①Application:初始化一个 SparkContext,即生成一个 Application

②Job:一个 Action (行动)算子就会生成一个 Job

③Stage:Stage 等于宽依赖(ShuffleDependency)的个数 +1

④Task:一个 Stage 阶段中,最后一个 RDD 的分区个数就是 Task 的个数

注意:Application->Job->Stage->Task 每一层都是 1 对 n 的关系

任务划分的 Spark 核心源码

1)进入 submitStage(finalStage),也就是 ResultStage,由于其中包含了所有阶段,相当于把整体提交

①getMissingParentStages(),查看当前阶段有没有上一级

如果有,提交上一级,重复 submitStage() 的逻辑

如果没有,执行 submitMissingTasks

2)submitMissingTasks(),与任务Task划分有关

①匹配阶段 shuffleMapStage or ResultStage

②每个case中的 new Task 的个数,即为任务的个数

③Task 个数与map映射的 size 有关

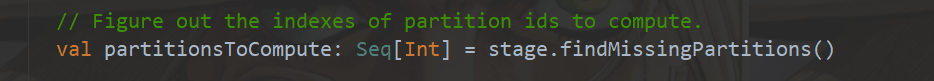

④map 的 size 取决于 partitionsToCompute 的结果

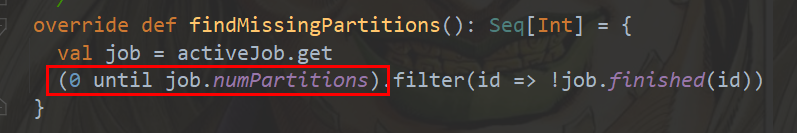

3)partitionsToCompute 返回的结果 stage.findMissingPartitions

由下面源码可知,返回的 map 的 size 为 numPartitions,即分区的数量

总结:

①任务的数量 = 当前阶段中最后一个 RDD 的分区数量

② ShuffleMapStage → ShuffleMapTask

ResultStage → ResultTask

285

285

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?