文章链接:ImageNet Classification with Deep Convolutional Neural Networks

Abstract

网络有6千万个参数和65万神经元,在ImageNet的比赛数据集上效果比其他方法好很多。

1 Introduction

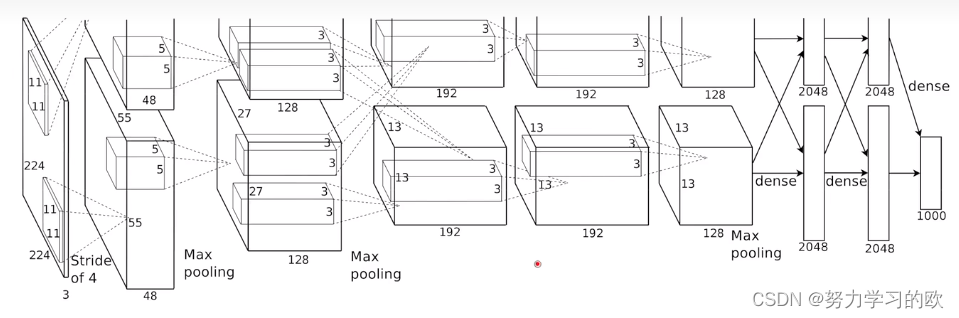

吹一波ImageNet数据集;为了识别成千上万的类别,需要很大的神经网络;要用CNN来做这个事情,同时怎么样把CNN做大;目前GPU的条件能够实现;网络有五个卷积层三个全连接层。

2 The Dataset

ImageNet数据集,每张图片裁到256*256,没有其他预处理,直接端到端。

3 The Architecture

3.1 使用ReLU非线性函数,效果比tanh好很多。

3.2 使用两个GPU训练,将网络切开成两半。

3.3 归一化技术,不重要。

3.4 改进了一下传统池化。

3.5 介绍网络模型。

4 Reducing Overfitting

4.1 数据增强:a将256*256抠成很多224*224图;b在RGB通道使用PCA。

4.2 Dropout随机把一些(50%)隐藏层输出设为0,用在其两个全连接层上,没有Dropout过拟合很严重,有的话训练速度慢两倍。

5 Details of learning

用SGD方法进行训练,其噪声对于避免过拟合有不错效果。盯着网络当其不动了就将学习率乘以十分之一。在GTX 580 3GB GPUs训练需要5到6天。

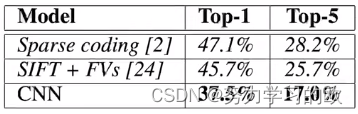

6 Results

结论,效果比其他的好很多。

6.1 奇怪现象,第一个GPU学到的内容与颜色有关,另一个则无关。

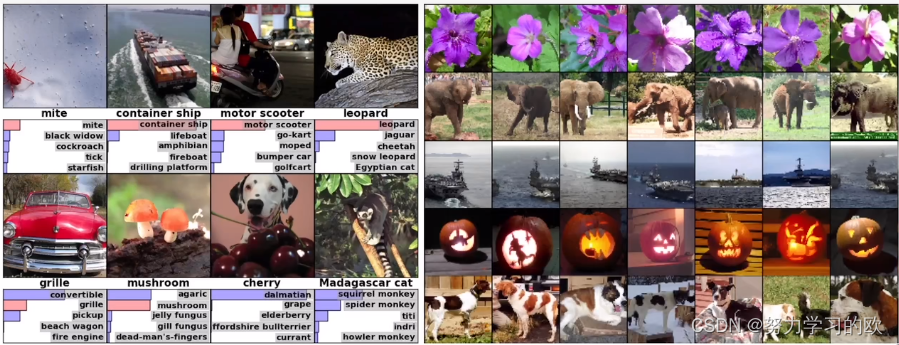

展示一些难的图片分类效果,以及倒数第二层输出4096维向量可以找到相似的图片。

7 Conclusion /Discussion

结果显示大且深的神经网络可以在一个很大很难的数据集上取得好的效果,深度很重要。同时日后有条件希望能够对视频数据进行研究。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?