线性回归算法

想象一下,你是个超级侦探🕵️♂️,而你面前的任务是解开生活中一个迷人的谜团:预测未来!🔮 假设你想要预测的是你的宠物小狗🐶每天需要多少运动时间,以保持它快乐而且健康。你注意到,小狗的快乐程度(让我们把这个称为“笑容数”😄)似乎和它每天玩耍的时间有关。这就是你的线索!

线性回归,就是这个谜题的解法之一。它是一种数学工具,可以帮助你找到两件事情之间的关系。在我们的例子中,就是“玩耍时间”和“笑容数”之间的关系。如果我们把这关系画出来,可能就是一条直线——这就是为什么它叫做“线性”回归的原因。这条直线就像是一条魔法线,可以告诉你:“如果你的小狗玩耍这么多时间,它会有这么多的笑容。”

但生活不总是那么简单,对吧?🤷♂️ 也许小狗的笑容不仅仅由玩耍时间决定,还可能受到其他因素的影响,比如它今天吃了什么(比如说,鸡肉🍗比干狗粮更让它开心),或者今天的天气怎么样(晴天☀️可能比雨天☔️更适合玩耍)。当有很多这样的因素需要考虑时,我们就会使用“多元线性回归”,它可以同时考虑多个因素,帮你画出一个更复杂的“魔法图”,而不仅仅是一条直线了。

为了找到这条魔法线,你需要做的是收集数据,然后用一种叫做“最小二乘法”的超级技巧来计算。这听起来可能很复杂,但其实就像是找到一种方法,让你的预测(即魔法线上的点)尽可能接近你观察到的真实情况(即实际的笑容数)。通过这种方法,你就能找到最能代表你收集到的数据的那条直线或那个图形。

总而言之,线性回归就像是你的超级工具箱🧰里的一个工具,帮助你揭示不同事物之间的神秘联系,并用一条优雅的直线(或者在更复杂的情况下是一个形状)来描述它们之间的关系。这样,下次当你需要做出预测时,无论是关于小狗的笑容,还是其他任何事情,你都有了一个强大的方法来帮助你看到未来。🌈✨

Logistic回归

Logistic回归是一种用来处理分类问题的统计方法,特别擅长处理“是或否”这样的二分类问题。想象一下,你正在玩一个游戏,游戏里有两个大门,一个是“胜利之门”,另一个是“失败之门”。Logistic回归就像是你手中的一个神奇的小工具,能帮助你判断应该选择哪个门。

假设你手里有一堆卡片,每张卡片上都写着一些提示信息,比如“门后有怪兽的吼叫声”或“门后传来胜利的音乐”。Logistic回归会分析这些提示信息,然后告诉你:“基于这些提示,你有80%的可能性走向胜利之门”。

Logistic回归工作的方式有点像在做概率的天平:一边放置着所有指向“是”的证据,另一边放置着所有指向“否”的证据。然后,它会看哪边的天平更重,从而做出预测。

🎲 投掷骰子:想象一下,Logistic回归就像是在投掷一枚特殊的骰子,这枚骰子不是告诉你具体的数字,而是告诉你某件事发生的几率有多大。

🔍 放大镜和侦探:使用Logistic回归就像是一个侦探在用放大镜仔细检查线索,然后根据这些线索来判断嫌疑人是不是罪犯。

🎭 戏剧面具:你可以将Logistic回归比作戏剧中的两个面具,一个笑脸和一个哭脸,分别代表“是”和“否”的结果。Logistic回归就是在帮你判断,在当前的场景下,哪个面具更合适。

总的来说,Logistic回归是一种既强大又实用的工具,可以帮我们从一堆复杂的信息中找出简单的答案:“是”还是“否”。而且,它的计算过程就像是在做魔术一样,只不过这种魔术是有科学依据的!

决策树

想象一下,决策树就像是一场冒险游戏中的那些“选择你自己的冒险”故事书📚。在这本书里,每当你到达故事的一个关键点,你都要做出选择,比如“如果你决定进入神秘洞穴🕳️,翻到第36页;如果你决定回村庄🏡,翻到第59页”。每一个决策都会带你走向不同的故事线路,直到你达到一个结局。

在机器学习的世界里,决策树做的事情非常类似。它是一个巨大的“如果……那么……”决策图。从顶部的“根”节点开始,这就像是故事的开头,然后根据数据中的特征做出一系列决策,直到达到“叶子”节点,也就是最终的预测或结论。

打个比方,假设你有一个智能机器人🤖,它用决策树来决定午餐吃什么。机器人会问一系列问题:“外面是晴天吗☀️?我今天心情好吗😊?钱包里还有钱吗💰?”根据每个问题的答案,机器人会沿着树往下走,直到它得到一个最终的决定——比如“去吃汉堡🍔”或者“吃沙拉🥗”。

这棵树是怎么长出来的呢?想象一下你有一个超级聪明的朋友,他可以回顾过去所有的午餐,并找出影响你决定吃什么的因素。然后,他用这些信息构建了一棵树,从最重要的问题开始,一直到最不重要的问题。这个过程就像是在一大堆乱七八糟的线索中找出最有帮助的那个,然后用这个线索来指导你的下一步决策。

但这里有个小插曲——有时候,这棵树可能会长得太疯狂了,以至于它开始在一些奇怪的小细节上纠结,比如“上次我在穿蓝色袜子的时候吃了什么🧦?”这时候,就需要有人来“修剪”这棵树,去掉那些不太有用的分支,确保它不会因为一些无关紧要的细节而做出奇怪的决策。

总之,决策树就像是一张巨大的冒险地图,它通过一系列的“如果……那么……”决策,带你走向你的最终目标——无论是决定午餐吃什么,还是预测明天的天气。它既有趣又实用,而且,谁不喜欢玩“选择你自己的冒险”游戏呢?🌳🚀🎲

朴素贝叶斯算法

朴素贝叶斯算法是一种基于贝叶斯定理的简单却强大的预测技术,经常被用在机器学习领域的分类任务上。想象一下,你有一个超级英雄团队🦸♂️🦸♀️,每个人都有自己的特殊能力,而朴素贝叶斯算法就像是团队中的一个成员,他的超能力是超级直觉——能够迅速判断事物属于哪个类别。

这个算法被称为“朴素”是因为它假设所有的特征(比如超级英雄的各种能力)都是相互独立的,就好比说,能够飞行的能力不会影响射击精度,或者隐身技能不会影响超级速度。在现实世界中,这种假设往往不成立,因为事物之间往往是相互关联的,但令人惊讶的是,即使这个假设很“朴素”,这个算法在很多情况下还是能够工作得很好。

让我用一个例子来解释:假设你正在开发一个垃圾邮件过滤器📧。朴素贝叶斯算法会检查成千上万封电子邮件,并学习哪些词汇经常出现在垃圾邮件中。例如,“免费”、“特惠”和“点击”这样的词可能会使一封邮件被归类为垃圾邮件的概率增加。

当一封新邮件到来时,朴素贝叶斯算法就会动用它的超级直觉,检查邮件中的每个词汇,然后基于它学到的知识,迅速判断这封邮件是不是垃圾邮件。每个词汇都像是一个线索,朴素贝叶斯算法会把这些线索组合起来,给出一个总的判断。

贝叶斯定理是这个算法超能力的来源,它是一个数学公式,可以让我们根据已知条件来计算某件事发生的概率。在我的例子中,就是根据邮件内容计算邮件为垃圾邮件的概率。

尽管朴素贝叶斯算法很简单,但它在处理一些特定类型的任务时非常有效,比如文本分类、垃圾邮件检测和情感分析等。就像是那位直觉超群的超级英雄,它能够迅速地做出判断,帮助我们在信息的海洋中导航。🚀🔮

支持向量机

支持向量机(SVM)是一种强大的机器学习模型,它擅长进行分类任务,也可以用于回归。想象一下,你是一位艺术大师🎨,手里有两种不同颜色的油漆——红色和蓝色。你的任务是在一张巨大的白色画布上画点,红色点代表一类事物,蓝色点代表另一类事物,而且你希望用一条线(在二维空间里)或者一个平面(在更高维度的空间里)将这两种颜色的点分开。这就是SVM要做的事情!

在最简单的情况下,假设你只能画直线,并且你希望找到一条最好的直线,让所有的红点都在直线的一边,所有的蓝点都在直线的另一边。这条直线就像是一条边界,将两种颜色的点分隔开。但在所有可能的直线中,哪一条是最好的呢?SVM的答案是:找到那条不仅能正确分隔两组点,而且还能最大化两边空间的直线。这样,即使新的点(新的数据)出现在画布上,这条直线也有很大的概率正确地将它们分类。

现在,把咱们的想象飞得更高一些。如果这些点不能被一条直线简单地分开怎么办?这就像是咱们的画布上的红点和蓝点混在一起,没有明显的界限。SVM有一个非常聪明的技巧,叫做“核技巧”,它能将这些点投影到一个更高维度的空间中。在这个新空间里,你可能就能找到一个平面来分隔这些点了。这就好比是把一张纸从桌子上拿起来弯曲,突然之间,原本重叠的点就分开了。

当SVM处理真实世界的数据时,它就像一个精密的仪器,能够处理非常复杂和微妙的数据模式。它特别适合于那些特征数量比样本数量多的情况,也就是说,即使在你只有少量信息的情况下,SVM也能够做出非常好的决策。

总的来说,支持向量机是一种非常强大的工具,它能够找到数据中的复杂模式,并做出精确的分类决策。就像一位能够在混乱中找到秩序的艺术大师,SVM在数据的海洋中为我们提供了明确的指导。🌟📈

聚合算法

聚类算法是一种探索性数据分析工具,它的目的是将数据集中的对象或点分成若干个组(即“聚类”),使得同一个聚类中的对象相互之间更相似,而不同聚类中的对象则相互不那么相似。想象一下你在举办一场派对🎉,你需要决定如何安排座位以便让彼此兴趣相投的人坐在一起——这基本上就是聚类算法在做的事情!

聚类算法的魔力在于,它们不需要事先被告知每个组应该包含哪些对象(这是与监督学习算法如分类和回归不同的地方)。相反,聚类算法通过分析数据本身来发现这些组。它们是通过寻找数据中的模式和关系自动进行分组的。

让我们用一个更具体的例子来说明:假设你有一堆不同种类的水果🍎🍌🍇,你的任务是把它们根据某些特征(比如大小、颜色、味道)分类。聚类算法就像是一个超级智能的机器人🤖,它会观察这些水果,然后根据它们的相似性把它们分成几堆——比如,所有的苹果在一堆,所有的香蕉在另一堆,等等。

有许多不同类型的聚类算法,每种都有自己独特的方式来创建聚类。其中一些最流行的算法包括:

- K-均值聚类(K-Means Clustering):这是最简单和最广泛使用的聚类方法之一。它的工作原理是先随机选定K个点作为聚类中心,然后把每个对象分配给最近的中心,接着更新每个聚类的中心,重复这个过程直到满足某个终止条件。

- 层次聚类(Hierarchical Clustering):这种方法不是把数据一次性分成多个聚类,而是创建一个聚类层次,从单个对象开始,逐步合并成更大的聚类。

- DBSCAN(Density-Based Spatial Clustering of Applications with Noise):这种算法基于密度,它会将密集的区域合并成聚类,并能处理噪声(即不属于任何聚类的点)。

聚类算法可以用在许多不同的领域,比如市场细分、社交网络分析、城市规划、图像分割,以及任何需要将类似对象分组的场合。

想象聚类算法就像是拥有高级图案识别能力的超级侦探🕵️♂️,它能在看似杂乱无章的数据中发现隐藏的结构和模式,揭示出我们肉眼无法直接看到的洞察力。这就是聚类算法的魔力所在!✨📊

网格搜索和交叉验证

想象你在一个巨大的超市里,手里拿着一张购物清单📜。这张清单上列出了你需要买的所有食材,以便回家后能做出美味的晚餐🍽️。网格搜索(Grid Search)就像是你计划好的购物路线,它帮你决定在超市的哪个区域找哪些食材,以确保你买到的食材组合能让你做出最棒的晚餐。而交叉验证(Cross-Validation)则像是你的朋友们在你做晚餐之前给你的建议,确保你的食材组合不仅今天晚上有效,而且在未来的许多晚上也同样能做出美味的晚餐。

更具体地说:

网格搜索

网格搜索是一种通过遍历给定的参数设置来寻找最佳模型参数的方法。假设你在调整一台机器🤖,这台机器需要设置几个不同的旋钮来最佳化其性能。网格搜索就像是你制定了一个计划,列出了所有旋钮的不同位置组合,然后一一尝试这些组合,以找到让机器运行效果最佳的那一组设置。在机器学习中,这些“旋钮”就是模型的参数,而你尝试找到的最佳组合,就是使模型表现(比如准确率)最好的参数设置。

交叉验证

交叉验证是一种评估模型性能的方法,特别是在你不仅仅想要在一个数据集上做得好,而且希望模型能够推广到未知数据上时。想象你在准备一个大型晚宴,你需要确保菜肴不仅仅在今天晚上受到欢迎,而且在未来的每一次宴会中都能受到欢迎。交叉验证就是把你的数据分成几部分,比如说5部分。然后,它会用其中的4部分来训练模型(就像是用这些数据来准备菜肴),然后用剩下的那一部分来测试模型(就像是请一小部分客人来尝试这些菜肴,并给出他们的反馈)。这个过程会重复多次,每次都更换不同的部分用于测试,最后把所有的反馈汇总起来,以获取关于模型性能的综合视图。

将网格搜索和交叉验证结合起来使用时,你就能在尝试各种不同的参数设置的同时,确保你评估模型性能的方式是稳健和可靠的。这就像是找到了一本包含不同食材组合的食谱书,并通过多次尝试和朋友的反馈来确定哪本食谱书中的哪些食谱能够一次又一次地制作出美味的晚餐。这样,你就能建立一个既能满足当前需求又能适应未来变化的强大模型了!🚀🔍📊

ROC曲线

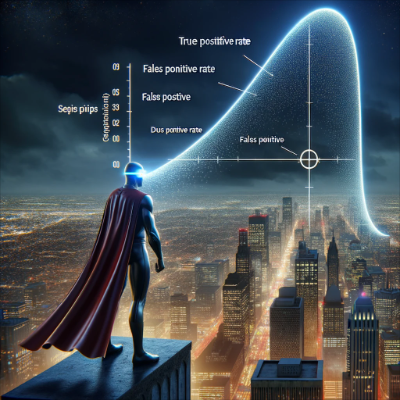

想象一下你是一个超级英雄,你的任务是守护城市,分辨出好人和坏人。你有一副特殊的眼镜🕶️,它可以帮你看出每个人的真实面目,但这副眼镜并不完美,有时也会出错。ROC曲线(Receiver Operating Characteristic Curve)就像是一张图表,记录了你在不同情况下识别好人和坏人能力的强弱。

在更技术性的语言中,ROC曲线是一种图形化的工具,用于展示分类模型在所有分类阈值下的表现。这条曲线画出了两个重要指标的关系:真正率(True Positive Rate, TPR)和假正率(False Positive Rate, FPR)。

- 真正率是你正确识别出坏人的能力,也就是在所有真正的坏人中,你成功识别出了多少。

- 假正率是当好人被错误地识别为坏人时发生的频率,也就是在所有真正的好人中,有多少被误认为是坏人。

ROC曲线的横轴是假正率(FPR),纵轴是真正率(TPR)。理想情况下,我们希望真正率高(靠近1),而假正率低(靠近0),这意味着曲线会弯曲到左上角。曲线下的面积(AUC,Area Under the Curve)可以用来量化模型的总体性能。AUC值越接近1,模型的性能就越好,因为这意味着模型能够很好地区分好人和坏人。

用我们的超级英雄比喻来说,一个理想的英雄(或模型)能够完美区分好人和坏人,这就像是ROC曲线紧贴左上角,AUC接近1。但在现实中,可能需要在将一些好人误认为坏人(增加假正率)和错过一些真正的坏人(降低真正率)之间找到平衡。

总的来说,ROC曲线是评估你的“超级英雄眼镜”在不同情境下表现如何的一种方式,帮助你理解如何最好地调整你的策略来保护城市,而不会误伤无辜。🦸♂️🌃📈

KNN算法

KNN算法,就像是你去一个陌生的聚会,想知道自己应该融入哪个小圈子。你会怎么做?可能会找离你最近的几个人,看看他们在聊什么,然后决定自己应该加入哪个小组。这里,你就是那个"待分类的数据点",周围的人就是"已知分类的数据",而你决定加入的小组,就是KNN帮你找到的"类别"。

🕵️♂️ 工作原理简化版:

- 看看周围:首先,你得看看自己周围有哪些人,也就是测量一下你和每个人的"距离"。

- 找最近的几个朋友:然后,你选出离你最近的几个人,这个"几个"就是KNN里的"K"。

- 看多数人在干嘛:

- 如果是找朋友(分类):你会看这几个人中,哪个小组的人最多,然后就判定自己应该属于那个小组。

- 如果是决定心情(回归):你可能会看这几个人的心情平均值是开心还是郁闷,然后决定自己是应该高兴还是悲伤。

🎉 为什么大家喜欢:

- 真的很简单,基本就是"找朋友"的游戏。

- 不管是啥聚会(多分类问题),都能玩。

- 只要朋友够多,通常都能找到自己的小圈子。

😓 但有时候也挺头疼:

- 如果聚会人太多,你得花好多时间去认识每个人(计算成本高)。

- 如果聚会地点很大(高维数据),你会发现很难判断谁离你近。

- 如果这个聚会人数很不平衡,可能会不小心加入人最多的那个不适合自己的小组。

- 如果聚会里有些奇怪的人(噪音和异常值),也会影响你找到正确的小组。

🚀 哪里会见到它:

无论是在网上冲浪找搞笑视频,还是在社交媒体上找跟你兴趣相投的小组,KNN算法都在默默地帮助着你,就像一个在背后默默支持你的老友。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?