系列文章目录

Hive3第一章:环境安装

Hive3第二章:简单交互

Hive3第三章:DML数据操作

Hive3第三章:DML数据操作(二)

Hive3第四章:分区表和分桶表

Hive3第五章:函数

文章目录

前言

这一次博客我们记录一下hive的内置函数,有点多,不知道能不能一次写完。

上次恢复快照,我把本地和集群的数据都删除了,所有要先新添加一下。

Hive3第三章:DML数据操作(二)

添加emp,dept。

一、内置函数

1.内置函数查询

show functions;

函数很多,了解即可。

2. 空字段赋值

1)函数说明

NVL:给值为 NULL 的数据赋值,它的格式是 NVL( value,default_value)。它的功能是如

果 value 为 NULL,则 NVL 函数返回 default_value 的值,否则返回 value 的值,如果两个参数

都为 NULL ,则返回 NULL。

2)数据准备:采用员工表

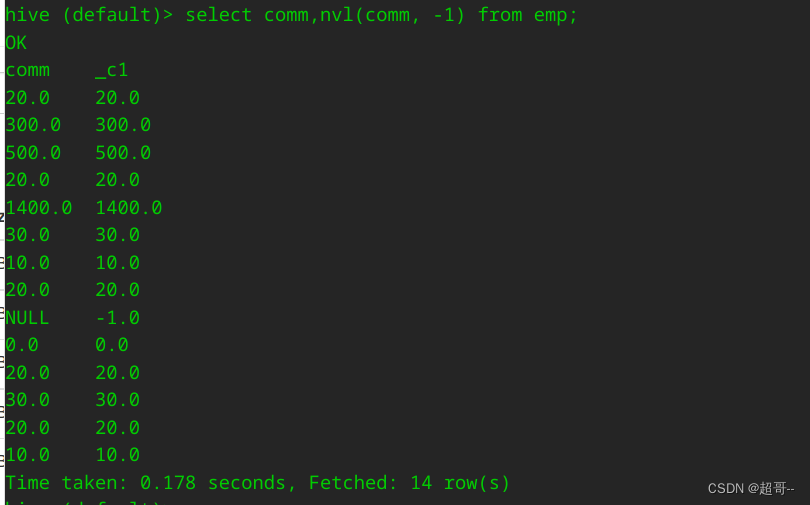

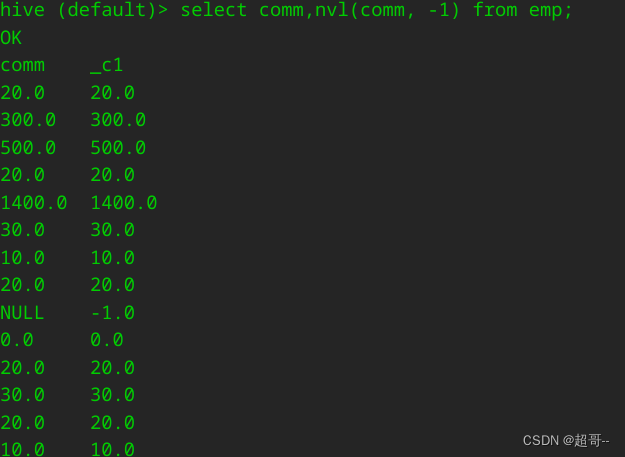

3)查询:如果员工的 comm 为 NULL,则用-1 代替

select comm,nvl(comm, -1) from emp;

4) 查询:如果员工的 comm 为 NULL,则用领导 id 代替

select comm,nvl(comm, -1) from emp;

二、 CASE WHEN THEN ELSE END

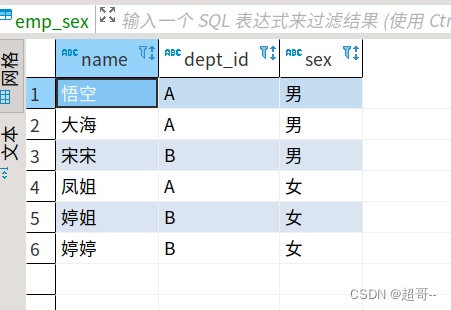

1.数据准备

悟空 A 男

大海 A 男

宋宋 B 男

凤姐 A 女

婷姐 B 女

婷婷 B 女

2.创建 hive 表并导入数据

create table emp_sex(

name string,

dept_id string,

sex string)

row format delimited fields terminated by " ";

load data local inpath '/opt/module/hive/datas/emp_sex.txt' into table emp_sex;

3.需求

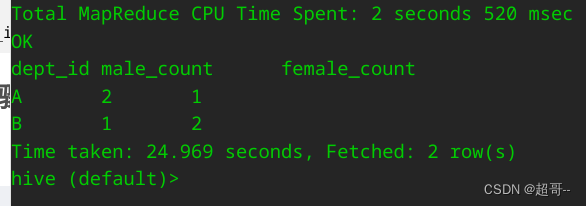

求出不同部门男女各多少人。结果如下:

dept_Id 男 女

A 2 1

B 1 2

4.查询

select

dept_id,

sum(case sex when '男' then 1 else 0 end) male_count,

sum(case sex when '女' then 1 else 0 end) female_count

from emp_sex

group by dept_id;

三、 行转列

相关函数说明

CONCAT(string A/col, string B/col…):返回输入字符串连接后的结果,支持任意个输入字

符串;

CONCAT_WS(separator, str1, str2,…):它是一个特殊形式的 CONCAT()。第一个参数剩余参

数间的分隔符。分隔符可以是与剩余参数一样的字符串。如果分隔符是 NULL,返回值也将

为 NULL。这个函数会跳过分隔符参数后的任何 NULL 和空字符串。分隔符将被加到被连接

的字符串之间;

注意: CONCAT_WS must be "string or array

COLLECT_SET(col):函数只接受基本数据类型,它的主要作用是将某字段的值进行去重

汇总,产生 Array 类型字段。

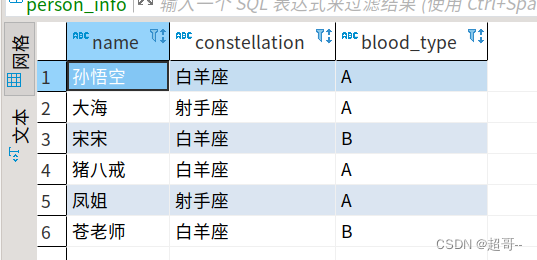

1.数据准备

孙悟空 白羊座 A

大海 射手座 A

宋宋 白羊座 B

猪八戒 白羊座 A

凤姐 射手座 A

苍老师 白羊座 B

2.创建表并导入数据

create table person_info(

name string,

constellation string,

blood_type string)

row format delimited fields terminated by " ";

load data local inpath "/opt/module/hive/datas/person_info.txt" into table

person_info;

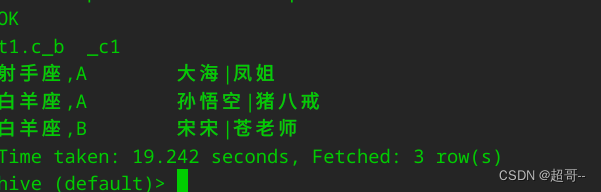

3.需求

把星座和血型一样的人归类到一起。结果如下:

射手座,A 大海|凤姐

白羊座,A 孙悟空|猪八戒

白羊座,B 宋宋|苍老师

4.查询

SELECT

t1.c_b,

CONCAT_WS("|",collect_set(t1.name))

FROM (

SELECT

NAME,

CONCAT_WS(',',constellation,blood_type) c_b

FROM person_info

)t1

GROUP BY t1.c_b;

四、 列转行

函数说明

EXPLODE(col):将 hive 一列中复杂的 Array 或者 Map 结构拆分成多行。

LATERAL VIEW

用法:LATERAL VIEW udtf(expression) tableAlias AS columnAlias

解释:用于和 split, explode 等 UDTF 一起使用,它能够将一列数据拆成多行数据,在此

基础上可以对拆分后的数据进行聚合。

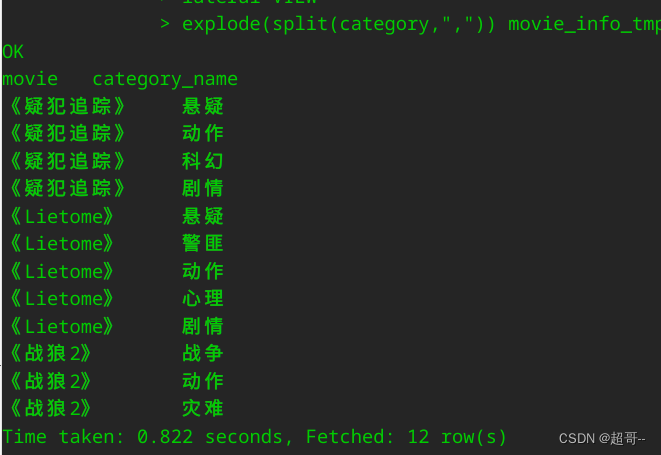

1.数据准备

《疑犯追踪》 悬疑,动作,科幻,剧情

《Lietome》 悬疑,警匪,动作,心理,剧情

《战狼2》 战争,动作,灾难

2.创建表并导入数据

create table movie_info(

movie string,

category string)

row format delimited fields terminated by " ";

load data local inpath "/opt/module/hive/datas/movie.txt" into table movie_info;

3.需求

将电影分类中的数组数据展开。结果如下:

《疑犯追踪》 悬疑

《疑犯追踪》 动作

《疑犯追踪》 科幻

《疑犯追踪》 剧情

《Lietome》 悬疑

《Lietome》 警匪

《Lietome》 动作

《Lietome》 心理

《Lietome》 剧情

《战狼2》 战争

《战狼2》 动作

《战狼2》 灾难

4.按需求查询

SELECT

movie,

category_name

FROM

movie_info

lateral VIEW

explode(split(category,",")) movie_info_tmp AS category_name;

五、 窗口函数(开窗函数)

相关函数说明

OVER():指定分析函数工作的数据窗口大小,这个数据窗口大小可能会随着行的变而变化。

CURRENT ROW:当前行

n PRECEDING:往前 n 行数据

n FOLLOWING:往后 n 行数据

UNBOUNDED:起点,

UNBOUNDED PRECEDING 表示从前面的起点,

UNBOUNDED FOLLOWING 表示到后面的终点

LAG(col,n,default_val):往前第 n 行数据

LEAD(col,n, default_val):往后第 n 行数据

NTILE(n):把有序窗口的行分发到指定数据的组中,各个组有编号,编号从 1 开始,对

于每一行,NTILE 返回此行所属的组的编号。注意:n 必须为 int 类型。

1.数据准备

jack,2017-01-01,10

tony,2017-01-02,15

jack,2017-02-03,23

tony,2017-01-04,29

jack,2017-01-05,46

jack,2017-04-06,42

tony,2017-01-07,50

jack,2017-01-08,55

mart,2017-04-08,62

mart,2017-04-09,68

neil,2017-05-10,12

mart,2017-04-11,75

neil,2017-06-12,80

mart,2017-04-13,94

2.创建表并导入数据

create table business(

name string,

orderdate string,

cost int

) ROW FORMAT DELIMITED FIELDS TERMINATED BY ',';

load data local inpath "/opt/module/hive/datas/business.txt" into table business;

3.需求

(1)查询在 2017 年 4 月份购买过的顾客及总人数

(2)查询顾客的购买明细及月购买总额

(3)查询每个顾客上次的购买时间

(4)查询前 20%时间的订单信息

4.按需求查询

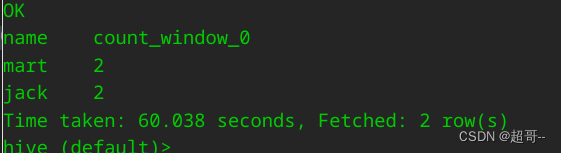

- 查询在 2017 年 4 月份购买过的顾客及总人数

select name,count(*) over ()

from business

where substring(orderdate,1,7) = '2017-04'

group by name;

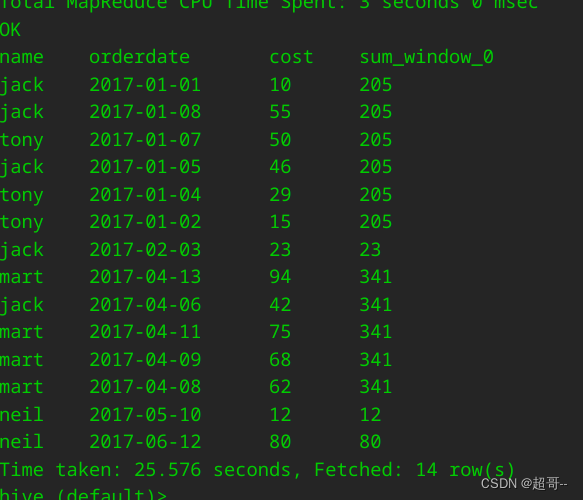

2. 查询顾客的购买明细及月购买总额

select name,orderdate,cost,sum(cost) over(partition by month(orderdate))

from business;

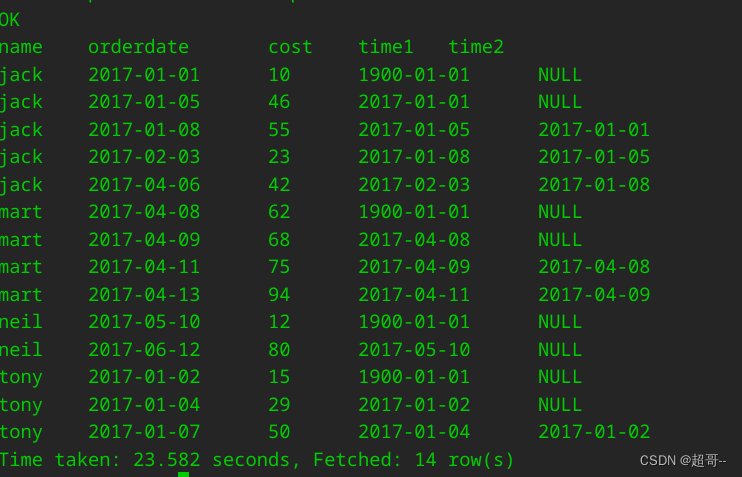

3. 查询每个顾客上次的购买时间

select name,orderdate,cost,

lag(orderdate,1,'1900-01-01') over(partition by name order by orderdate )

as time1, lag(orderdate,2) over (partition by name order by orderdate) as

time2

from business;

4. 查询前 20%时间的订单信息

select * from (

select name,orderdate,cost, ntile(5) over(order by orderdate) sorted

from business

) t

where sorted = 1;

六、 Rank

函数说明

RANK() 排序相同时会重复,总数不会变

DENSE_RANK() 排序相同时会重复,总数会减少

ROW_NUMBER() 会根据顺序计算

1.数据准备

孙悟空 语文 87

孙悟空 数学 95

孙悟空 英语 68

大海 语文 94

大海 数学 56

大海 英语 84

宋宋 语文 64

宋宋 数学 86

宋宋 英语 84

婷婷 语文 65

婷婷 数学 85

婷婷 英语 78

2.创建表并导入

create table score(

name string,

subject string,

score int)

row format delimited fields terminated by " ";

load data local inpath '/opt/module/hive/datas/score.txt' into table score;

3.需求

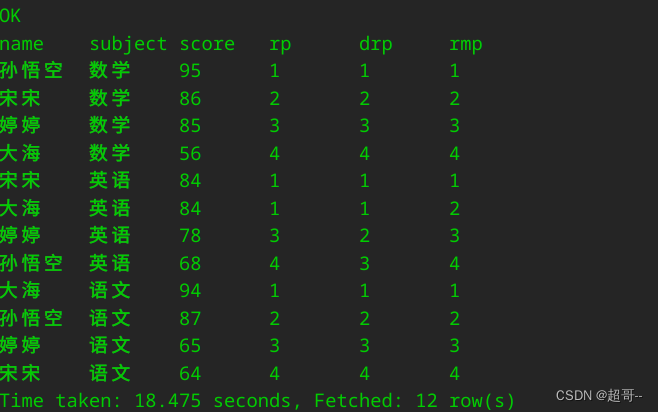

计算每门学科成绩排名。

4.按需求查询

select name,

subject,

score,

rank() over(partition by subject order by score desc) rp,

dense_rank() over(partition by subject order by score desc) drp,

row_number() over(partition by subject order by score desc) rmp

from score;

总结

这次博客就打这里吧,其实hive还有一些自定义函数,但是我觉得不太常用,毕竟咱只是入门阶段,不用学得太深入。

1071

1071

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?