目录

一、需求

1.获取文本总行数

2.获取单词总数

二、具体代码

1.driver端程序编写

- 因为在mapper端即可完成计数任务,所以不需要reducer端 numreducetasks默认值是1,因此应在代码中设置为0

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.io.IOException;

public class MyCounterDemo {

/*

*定义枚举常量 LINE_COUNT :用于统计文件的总行数

* WORD_COUNT :用于统计单词总数

*/

public enum COUNTER_WORD_COUNT{

LINE_COUNT,WORD_COUNT

}

public static void main(String[] args)throws IOException,ClassNotFoundException,InterruptedException{

Configuration conf = new Configuration();

conf.set("fs.defaultFS","hdfs://192.168.230.13:9000");

Job job= Job.getInstance(conf);

job.setJarByClass(MyCounterDemo.class);

job.setMapperClass(MyCounterMapper.class);

//设置ReduceTask的个数,默认为1个

//当前的题目下,不需要reduce,直接在map端输出,所以设置为0

job.setNumReduceTasks(0);

job.setMapOutputKeyClass(NullWritable.class);

job.setMapOutputValueClass(NullWritable.class);

Path inPath = new Path("/mapreduce/9.1/counter/input");

Path outpath = new Path("/mapreduce/9.1/counter/output");

FileSystem fs = FileSystem.get(conf);

if (fs.exists(outpath)){

fs.delete(outpath,true);

}

FileInputFormat.setInputPaths(job,inPath);

FileOutputFormat.setOutputPath(job,outpath);

boolean waitForCompletion = job.waitForCompletion(true);

System.exit(waitForCompletion ? 0:1);

}

}

2.map端程序编写

有两种方法进行计算:①枚举计数器 ②自定义计数器(组名,计数器名字)

最后结果可以看到两种方法统计出的结果是一样的

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import java.io.IOException;

// 字节偏移量 --- 每一行的内容 --- 空值 --- 空值

public class MyCounterMapper extends Mapper<LongWritable,Text,NullWritable,NullWritable > {

@Override

protected void map(LongWritable key,Text value,

Mapper<LongWritable,Text,NullWritable,NullWritable>.Context context)throws IOException,InterruptedException{

//需求1:获取文件总行数

//因为是逐行读取,所以有多少行----代表调用多少次map()方法

//方法1:枚举计数器

context.getCounter(

MyCounterDemo.COUNTER_WORD_COUNT.LINE_COUNT).increment(1L);

//方法2:自定义计数器(组名,计数器名字)

context.getCounter("counter_word_count","line_count").increment(1L);

//需求2:获取单词个数

//获取一行文本内容,按照分隔符进行切分

String[] splits = value.toString().split(",");

//遍历数组

for(String word:splits){

//统计单词总数,遇见一个单词就加1

//方法1:枚举计数器

context.getCounter(MyCounterDemo.COUNTER_WORD_COUNT.WORD_COUNT

).increment(1L);

//方法2:自定义计数器(组名,计数器名字)

context.getCounter("counter_word_count",

"word_count").increment(1L);

}

}

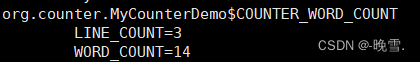

}结果:

方法1:

方法2:

888

888

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?