ELK平台是一套完整的日志集中处理解决方案,将ElasticSearch、Logstash和Kiabana三个开源工具配合使用,完成更强大的用户对日志的查询、排序、统计需求。

一、ELK日志分析系统简介

1、ElasticSearch

ElasticSearch:是基于Lucene(一个全文检索引擎的架构)开发的分布式存储检索引擎,用来存储各类日志。 Elasticsearch 是用 Java 开发的,可通过 RESTful Web 接口,让用户可以通过浏览器与 Elasticsearch 通信。

2、Logstash

Logstash:主要用于日志收集,同时可以对数据处理,并输出给 Elasticsearch。 Logstash 由JRuby 语言编写,运行在Java虚拟机(JVM)上,是一款强大的数据处理工具,可以实现=数据传输、格式处理、格式化输出。 Logstash 具有强大的插件功能,常用于日志处理。

3、Kibana

Kibana:是基于Node.js开发的展示工具,可以为Logstash和ElasticSearch提供图形化的日志分析Web界面,可以汇总、分析和搜索重要数据日志。

二、ELK 的工作原理

(1)在所有需要收集日志的服务器上部署Logstash;或者先将日志进行集中化管理在日志服务器上,在日志服务器上部署 Logstash。

(2)Logstash 收集日志,将日志格式化并输出到 Elasticsearch 群集中。

(3)Elasticsearch 对格式化后的数据进行索引和存储。

(4)Kibana 从 ES 群集中查询数据生成图表,并进行前端数据的展示。

三、ELK部署

实验环境:

主机 操作系统 主机名 IP地址 主要软件

服务器 Centos7 node1 192.168.100.10 Elasticsearch Kibana

服务器 Centos7 node2 192.168.100.40 Elasticsearch

服务器 Centos7 apache 192.168.100.20 Logstash Apache1)关闭防火墙

systemctl stop firewalld

setenforce 02)ELK部署(在Node1、Node2节点上操作)

#更改主机名、配置域名解析、查看Java环境

Node1节点:hostnamectl set-hostname node1

Node2节点:hostnamectl set-hostname node2echo "192.168.100.10 node1" >> /etc/hosts

echo "192.168.100.40 node2" >> /etc/hosts

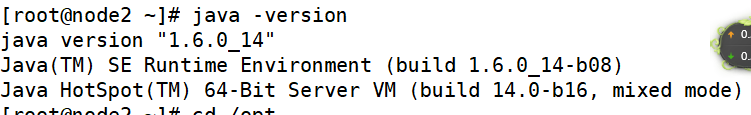

java -version #如果没有安装,yum -y install java

3)安装elasticsearch—rpm包

#上传elasticsearch-5.5.0.rpm到/opt目录下

cd /opt

rpm -ivh elasticsearch-5.5.0.rpm #加载系统服务

systemctl daemon-reload

systemctl enable elasticsearch.service

#修改elasticsearch主配置文件

cp /etc/elasticsearch/elasticsearch.yml /etc/elasticsearch/elasticsearch.yml.bak

vim /etc/elasticsearch/elasticsearch.yml

17/ cluster.name: my-elk-cluster ####集群名字

23/ node.name: node1 ####节点名字,Node2节点为node2

33/ path.data: /data/elk_data ####数据存放路径

37/ path.logs: /var/log/elasticsearch/ ####日志存放路径

43/ bootstrap.memory_lock: false ####不在启动的时候锁定内存(前端缓存。与IOPS-性能测试方式,每秒读写次数相关)

55/ network.host: 0.0.0.0 ####提供服务绑定的IP地址,0.0.0.0代表所有地址

59/ http.port: 9200 ####侦听端口为9200

68/ discovery.zen.ping.unicast.hosts: ["node1", "node2"] ####集群发现通过单播实现

grep -v "^#" /etc/elasticsearch/elasticsearch.yml

#创建数据存放路径并授权

mkdir -p /data/elk_data

chown elasticsearch:elasticsearch /data/elk_data/#启动elasticsearch是否成功开启

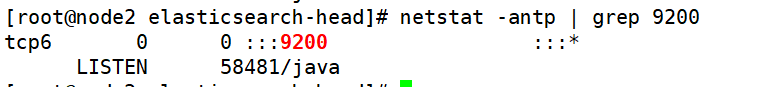

systemctl start elasticsearch.service

netstat -antp | grep 9200

#查看节点信息

浏览器访问 http://192.168.100.10:9200 、 http://192.168.100.40:9200 查看节点 Node1、Node2 的信息。

浏览器访问 http://192.168.100.10:9200/_cluster/state?pretty 检查群集状态信息。

#使用上述方式查看群集的状态对用户并不友好,可以通过安装 Elasticsearch-head 插件,可以更方便地管理群集

4)安装 Elasticsearch-head 插件

(1)编译安装 node

#上传软件包 node-v8.2.1.tar.gz 到/opt

yum install gcc gcc-c++ make -y

cd /opt

tar zxvf node-v8.2.1.tar.gz

cd node-v8.2.1/

./configure

make -j 2 && make install(2)安装 phantomjs(前端框架在这里插入代码片)

#上传软件包 phantomjs-2.1.1-linux-x86_64.tar.bz2 到

cd /opt

tar jxvf phantomjs-2.1.1-linux-x86_64.tar.bz2 -C /usr/local/src/

cd /usr/local/src/phantomjs-2.1.1-linux-x86_64/bin

cp phantomjs /usr/local/bin(3)安装 Elasticsearch-head 数据可视化工具

#上传软件包 elasticsearch-head.tar.gz 到/opt

cd /opt

tar zxvf elasticsearch-head.tar.gz -C /usr/local/src/

cd /usr/local/src/elasticsearch-head/

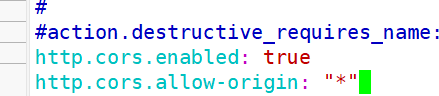

npm install(4)修改 Elasticsearch 主配置文件

vim /etc/elasticsearch/elasticsearch.yml

......

--末尾添加以下内容--

http.cors.enabled: true #开启跨域访问支持,默认为 false

http.cors.allow-origin: "*" #指定跨域访问允许的域名地址为所有

systemctl restart elasticsearch

(5)启动 elasticsearch-head 服务

#必须在解压后的 elasticsearch-head 目录下启动服务,进程会读取该目录下的 gruntfile.js 文件,否则可能启动失败。

cd /usr/local/src/elasticsearch-head/

npm run start &

> elasticsearch-head@0.0.0 start /usr/local/src/elasticsearch-head

> grunt server

Running "connect:server" (connect) task

Waiting forever...

Started connect web server on http://localhost:9100

#elasticsearch-head 监听的端口是 9100

netstat -natp |grep 9100

(6)通过 Elasticsearch-head 查看 Elasticsearch 信息

通过浏览器访问 http://192.168.100.10:9100/ 地址并连接群集。如果看到群集健康值为 green 绿色,代表群集很健康。

在Elasticsearch 后面的栏目中输入http://192.168.100.10:9200

然后点连接 会发现:集群健康值: green (0 of 0)

●node1信息动作

★node2信息动作

(7)插入索引(node1上操作)

通过命令插入一个测试索引,索引为 index-demo,类型为 test。

curl -X PUT 'localhost:9200/index-demo/test/1?pretty&pretty' -H 'content-Type: application/json' -d '{"user":"zhangsan","mesg":"hello world"}'浏览器访问 http://192.168.100.10:9100/ 查看索引信息,可以看见索引默认被分片5个,并且有一个副本

点击数据浏览–会发现在node1上创建的索引为index-demo,类型为test, 相关的信息

5)ELK部署 Logstash(在apache节点上操作)

Logstash 一般部署在需要监控其日志的服务器。在本案例中,Logstash 部署在 Apache服务器上,用于收集 Apache 服务器的日志信息并发送到 Elasticsearch。

(1)更改主机名

hostnamectl set-hostname apache

su(2)安装Apahce服务(httpd)

yum -y install httpd

systemctl start httpd(3)安装Java环境

java -version #如果没有安装,yum -y install java

openjdk version "1.8.0_131"

OpenJDK Runtime Environment (build 1.8.0_131-b12)

OpenJDK 64-Bit Server VM (build 25.131-b12, mixed mode)(4)安装logstash

#上传软件包 logstash-5.5.1.rpm 到/opt目录下

cd /opt

rpm -ivh logstash-5.5.1.rpm

systemctl start logstash.service

systemctl enable logstash.service

ln -s /usr/share/logstash/bin/logstash /usr/local/bin/(5)logstash(Apache)与elasticsearch(node)功能是否正常,做对接测试

Logstash 命令常用选项:

-f:通过这个选项可以指定 Logstash 的配置文件,根据配置文件配置 Logstash 的输入和输出流。

-e:从命令行中获取,输入、输出后面跟着字符串,该字符串可以被当作 Logstash 的配置(如果是空,则默认使用 stdin 作为输入,stdout 作为输出)。

-t:测试配置文件是否正确,然后退出。6)输入采用标准输入 输出采用标准输出—登录192.168.100.20 在Apache服务器上

logstash -e 'input { stdin{} } output { stdout{} }'

——————————————————————

logstash.agent - Successfully started Logstash API endpoint {:port=>9600}

www.baidu.com

2021-03-10T14:23:56.548Z apache www.baidu.com

www.sina.com.cn

2021-03-10T14:24:09.951Z apache www.sina.com.cn

(7)使用rubydebug显示详细输出,codec为一种编解码器

logstash -e 'input { stdin{} } output { stdout{ codec=>rubydebug } }'

——————————————————

[Api Webserver] INFO logstash.agent - Successfully started Logstash API endpoint {:port=>9600}

www.baidu.com

{

"@timestamp" => 2021-03-10T14:27:19.304Z,

"@version" => "1",

"host" => "apache",

"message" => "www.baidu.com"

}

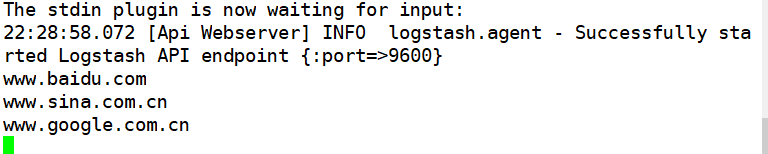

####使用logstash将信息写入elasticsearch中#### 输入 输出 对接

logstash -e 'input { stdin{} } output { elasticsearch { hosts=>["192.168.100.10:9200"] } }'

[Api Webserver] INFO logstash.agent - Successfully started Logstash API endpoint {:port=>9600}

www.baidu.com

www.sina.com.cn

www.google.com.cn

(8)打开浏览器 输入http://192.168.100.10:9100/ 查看索引信息###

点击数浏览查看响应的内容

(9)logstash配置文件(Apache主机 做对接配置)

Logstash配置文件主要由三部分组成:input、output、filter(根据需要)

chmod +r /var/log/messages

vim /etc/logstash/conf.d/system.conf

input {

file{

path =>"/var/log/messages" #指定要收集的日志的位置

type =>"system" #自定义日志类型标识

start_position =>"beginning" #表示从开始处收集

}

}

output {

elasticsearch { #输出到 elasticsearch

hosts => ["192.168.241.3:9200"] #指定 elasticsearch 服务器的地址和端口

index =>"system-%{+YYYY.MM.dd}" #指定输出的索引格式

}

}

systemctl restart logstash

浏览器访问 http://192.168.100.10:9100/ 查看索引信息

6)ELK Kiabana 部署(在 Node1 节点上操作)

1、安装 Kiabana

#上传软件包 kibana-5.5.1-x86_64.rpm 到/usr/local/src目录

cd /usr/local/src

rpm -ivh kibana-5.5.1-x86_64.rpm2.设置 Kibana 的主配置文件

cd /etc/kibana/

cp kibana.yml kibana.yml.bak

vim kibana.yml

2/ server.port: 5601 #### kibana打开的端口

7/ server.host: "0.0.0.0" ####kibana侦听的地址

21/ elasticsearch.url: "http://192.168.100.10:9200" ###和elasticsearch建立联系

30/ kibana.index: ".kibana" ####在elasticsearch中添加.kibana索引

systemctl start kibana.service

systemctl enable kibana.service

3、使用浏览器输入192.168.100.10:5601

首次登录创建一个索引 名字:system-* ##这是对接系统日志文件

Index name or pattern ###下面输入system-*

然后点最下面的出面的create 按钮创建

然后点最左上角的Discover按钮 会发现system-*信息

然后点下面的host旁边的add 会发现右面的图只有 Time 和host 选项了 这个比较友好

4、将 Apache 服务器的日志(访问的、错误的)添加到 Elasticsearch 并通过 Kibana 显示

vim /etc/logstash/conf.d/apache_log.conf

input {

file{

path => "/etc/httpd/logs/access_log"

type => "access"

start_position => "beginning"

}

file{

path => "/etc/httpd/logs/error_log"

type => "error"

start_position => "beginning"

}

}

output {

if [type] == "access" {

elasticsearch {

hosts => ["192.168.100.10:9200"]

index => "apache_access-%{+YYYY.MM.dd}"

}

}

if [type] == "error" {

elasticsearch {

hosts => ["192.168.100.10:9200"]

index => "apache_error-%{+YYYY.MM.dd}"

}

}

}

cd /etc/logstash/conf.d/

/usr/share/logstash/bin/logstash -f apache_log.conf5、打开浏览器 输入http://192.168.100.10:9100/ 查看索引信息

打开浏览器 输入http://192.168.100.10:5601 点击左下角有个management选项—index patterns—create index pattern ----分别创建apache_error-* 和 apache_access-* 的索引

2178

2178

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?