CDH5.16.1版本

spark2.4.0版本

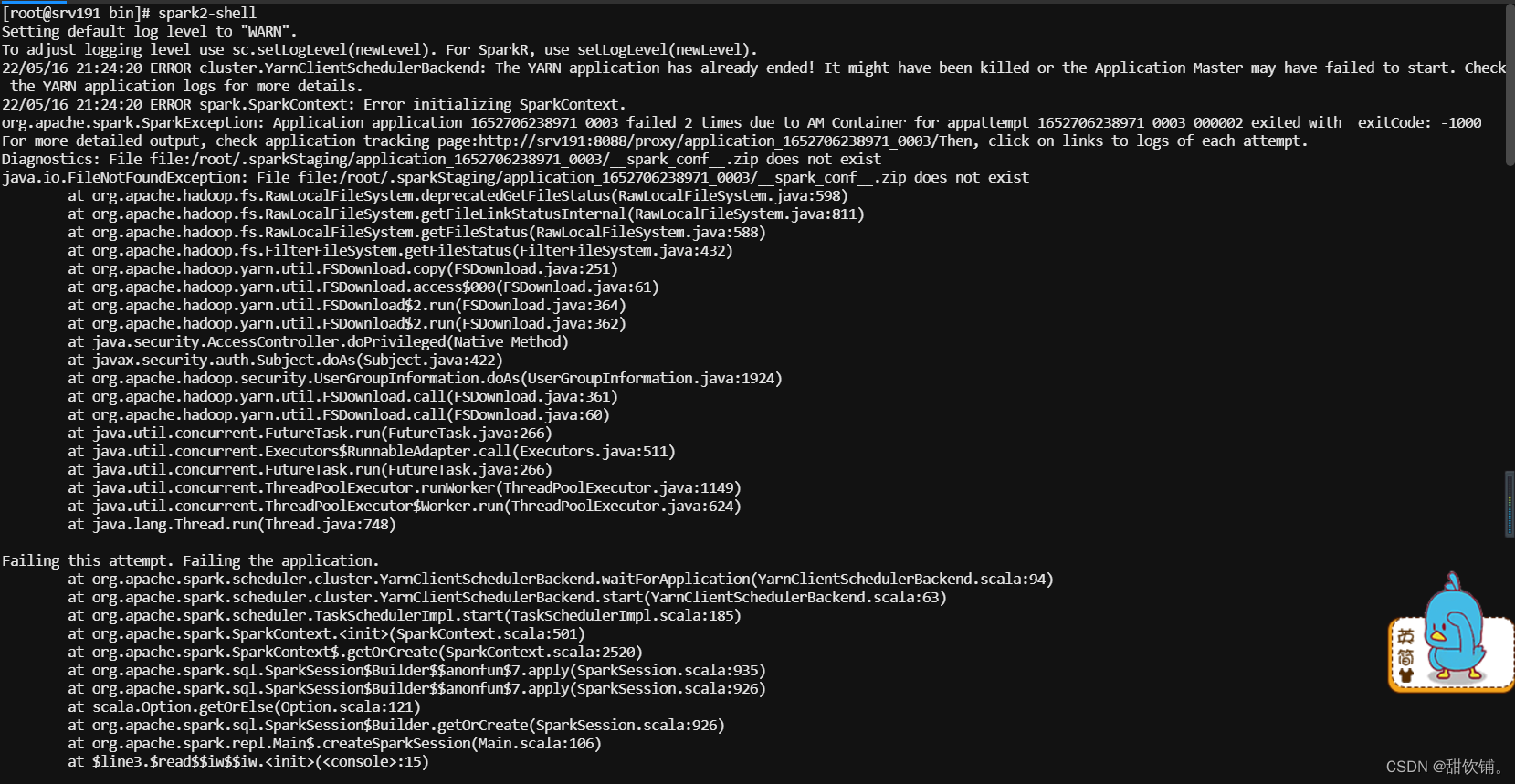

报错信息如下图所示

报错原因分析:Spark1.4以后,所有spark的编译都是没有将hadoop的classpath编译进去的。所以必须在spark-env.sh中指定hadoop中的所有jar包。

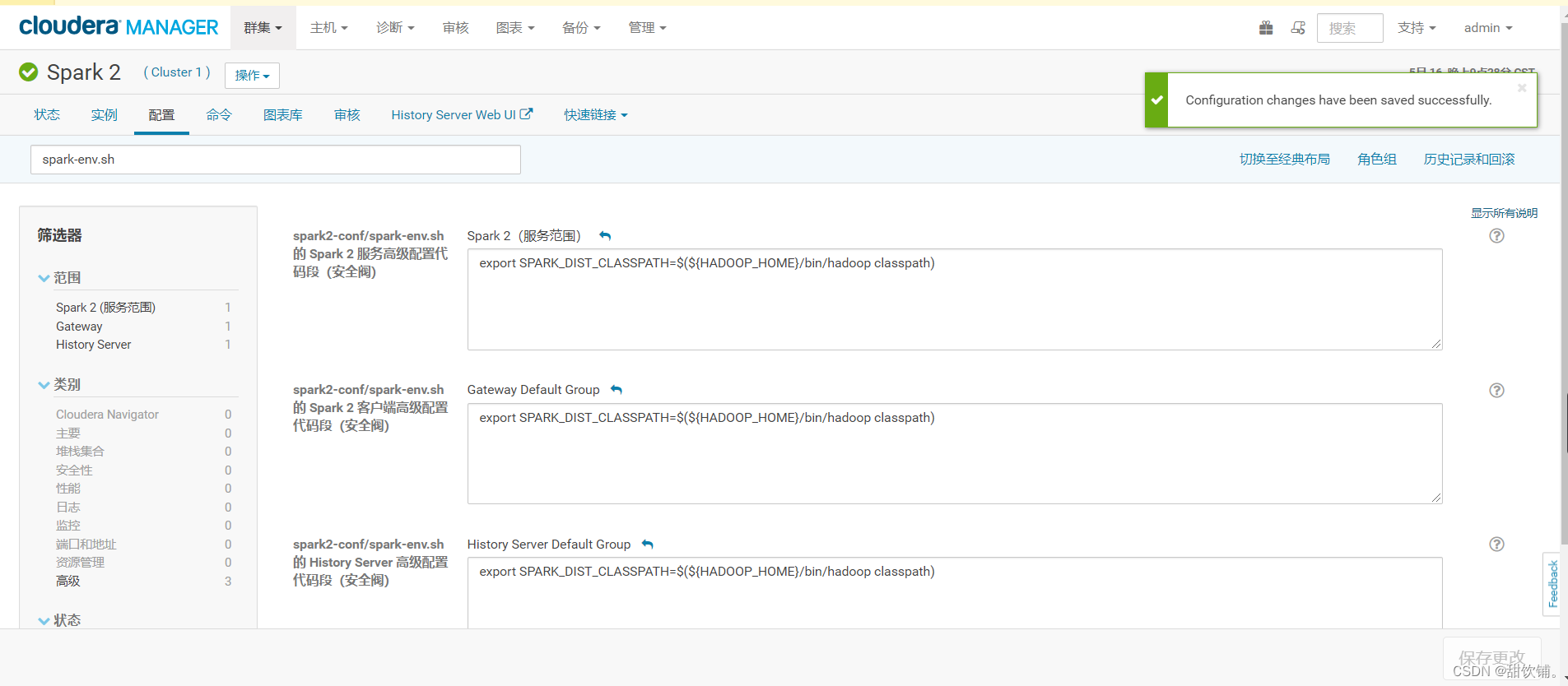

进入Spark2组件,点击配置选项,搜索如下:

spark-env.sh

配置如下

export SPARK_DIST_CLASSPATH=$(${HADOOP_HOME}/bin/hadoop classpath)

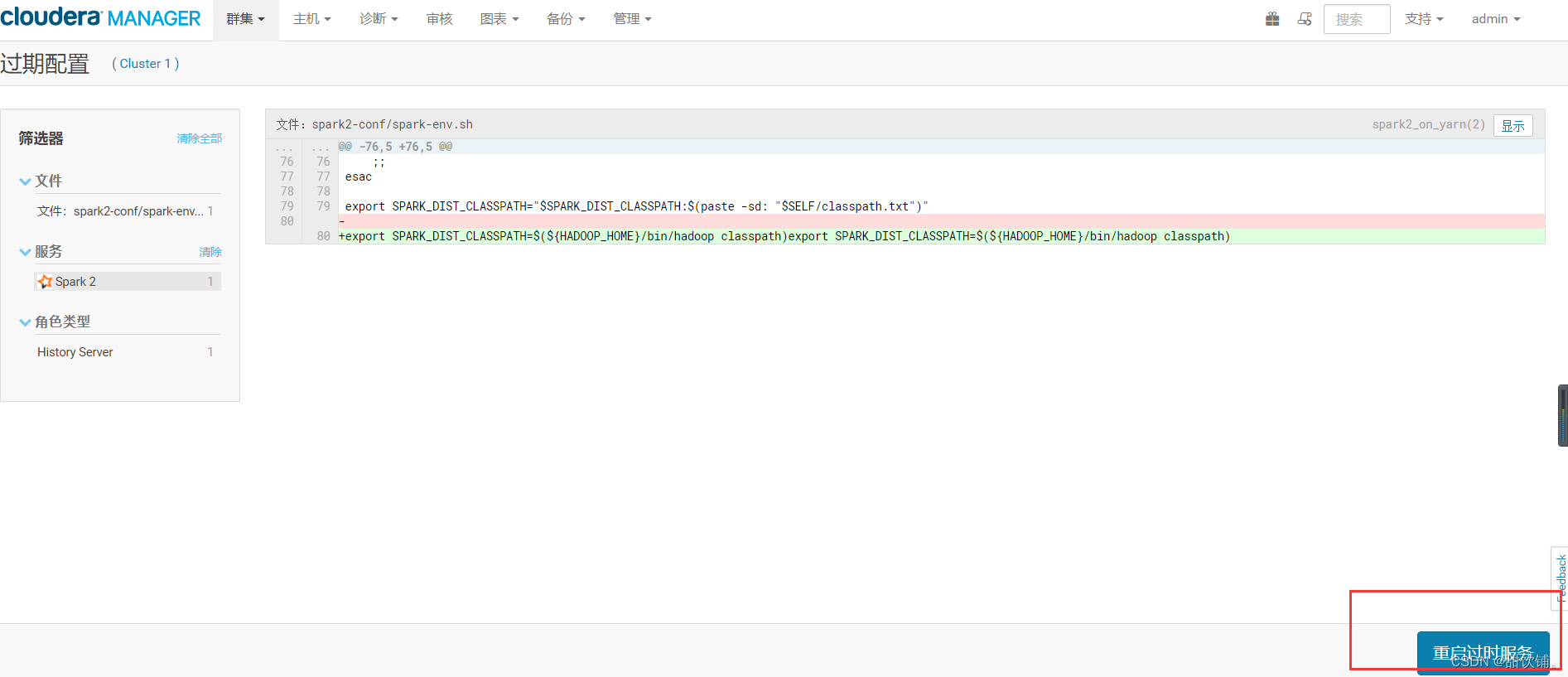

之后重新部署客户端配置

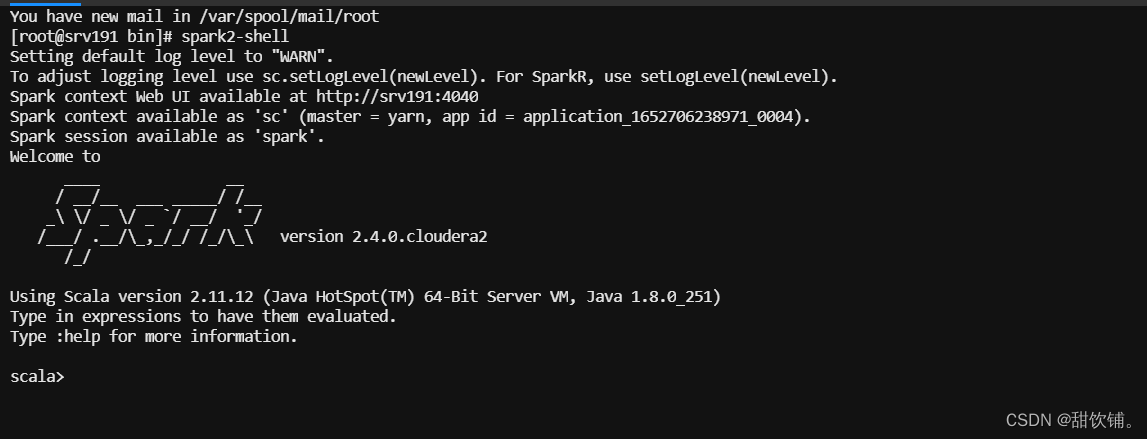

再次启动spark2-shell

3804

3804

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?