文章目录

一、sparkRDD进行词频统计

(1)准备工作

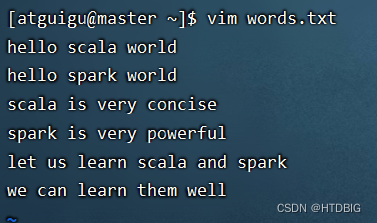

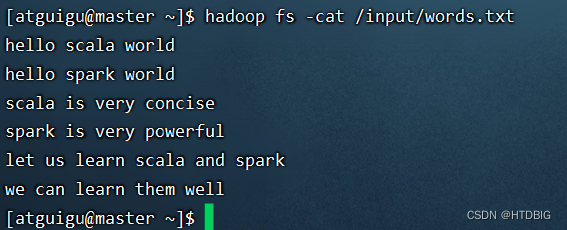

- 在虚拟机创建words.txt文本

[atguigu@master ~]$ vim words.txt

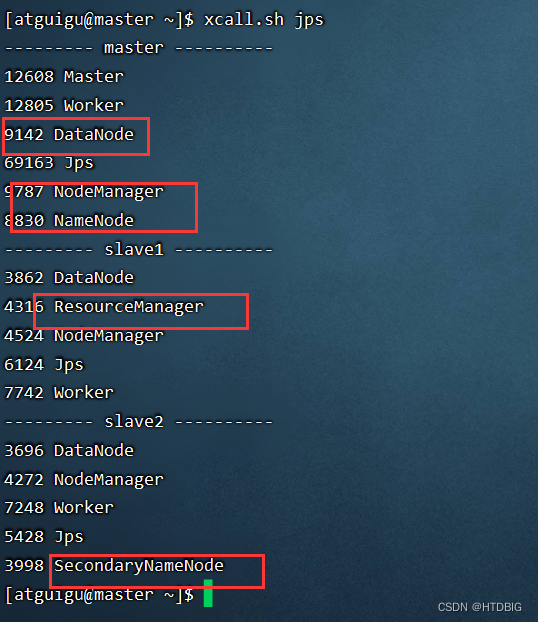

- 上传到hdfs上(在上传前查看hadoop集群启动没有)

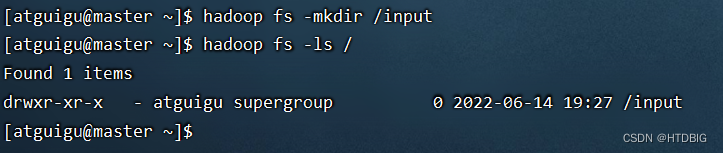

- 在hdfs上创建input目录

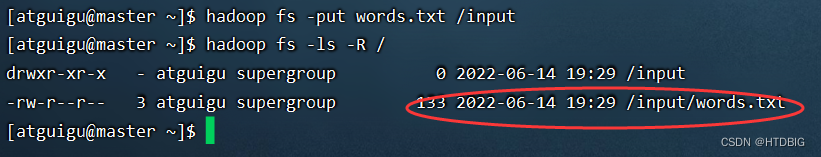

- 上传文件到hdfs

[atguigu@master ~]$ hadoop fs -put words.txt /input

- 查看hdfs input目录下的words.txt的内容

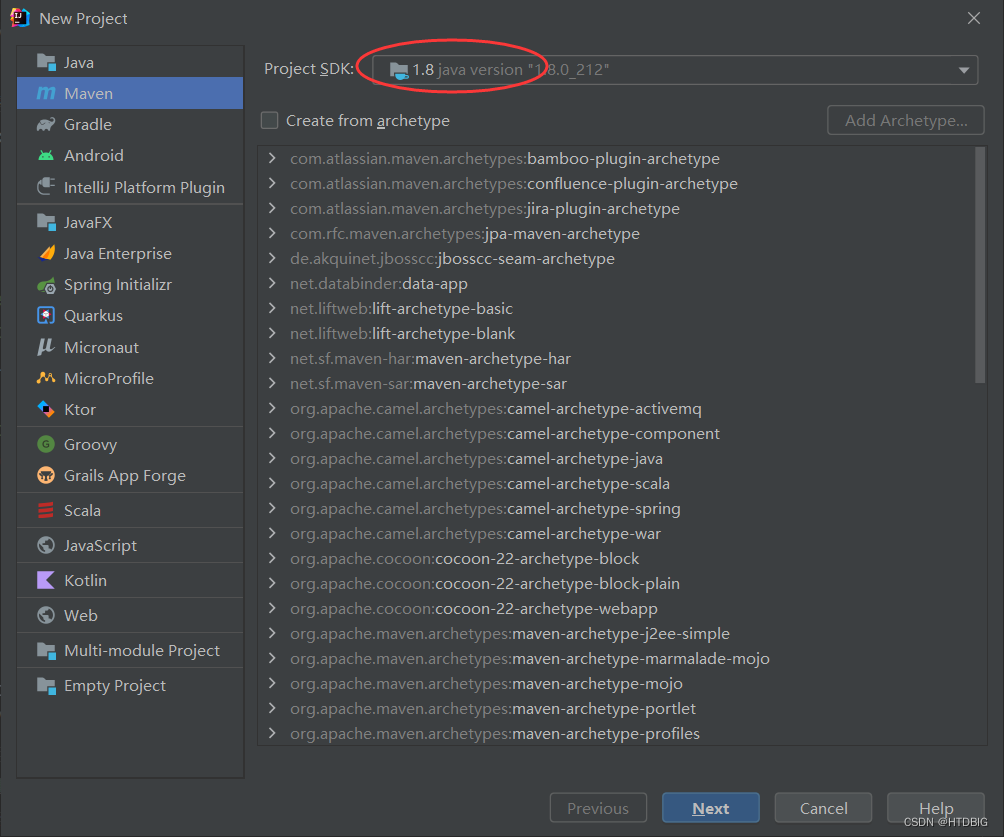

(2)新建Maven项目

- 新建Maven项目,基于JDK1.8

- 点击Next

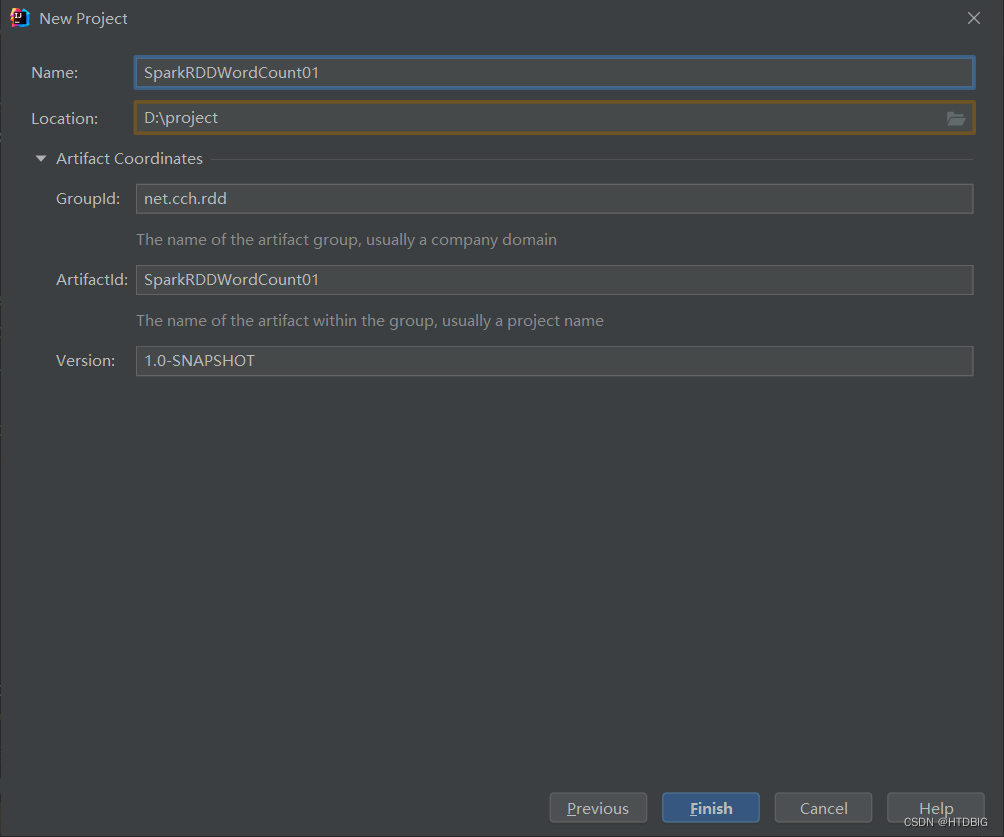

- 点击Finish

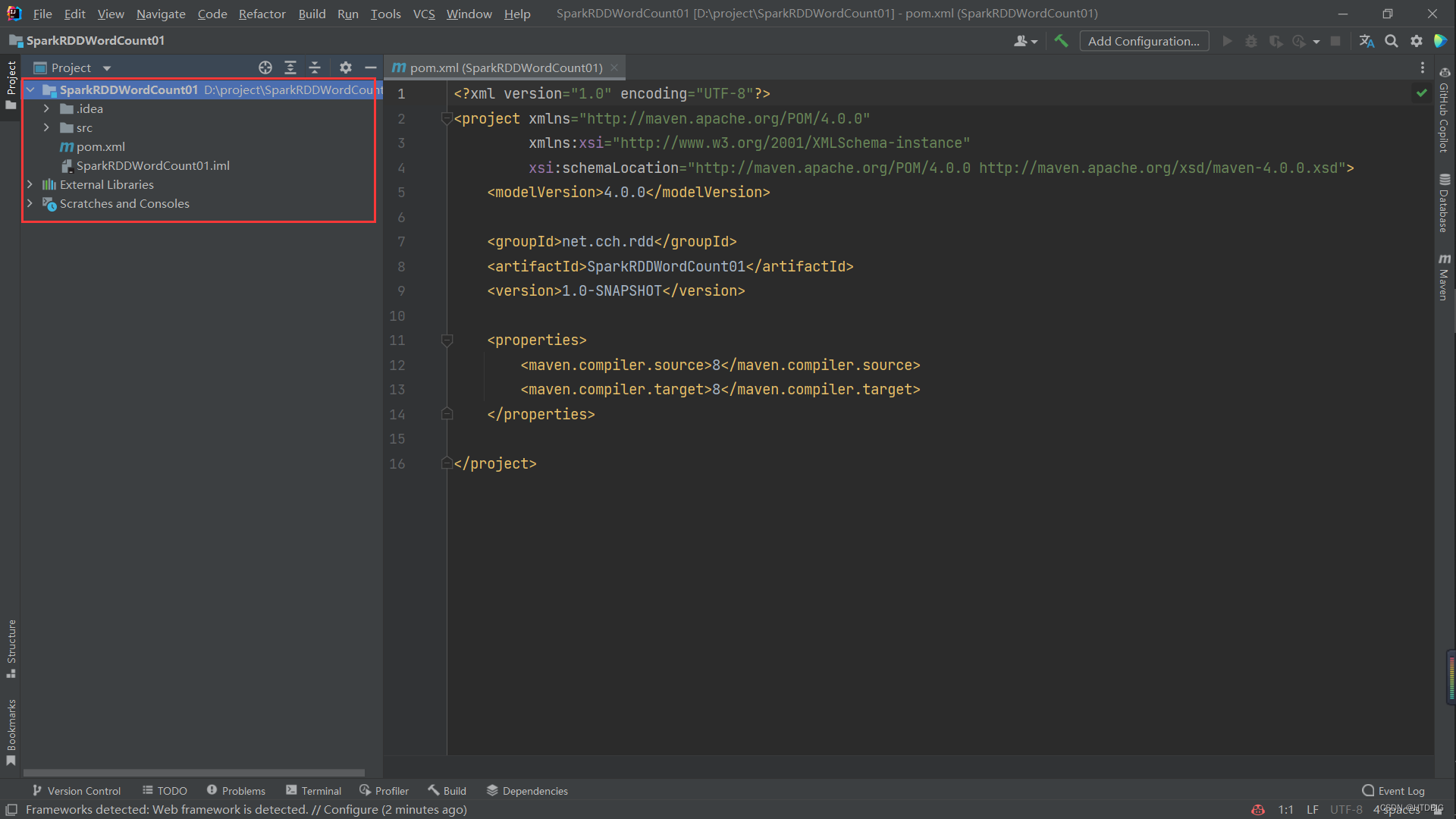

- 增加目录scala

(3)添加相关依赖

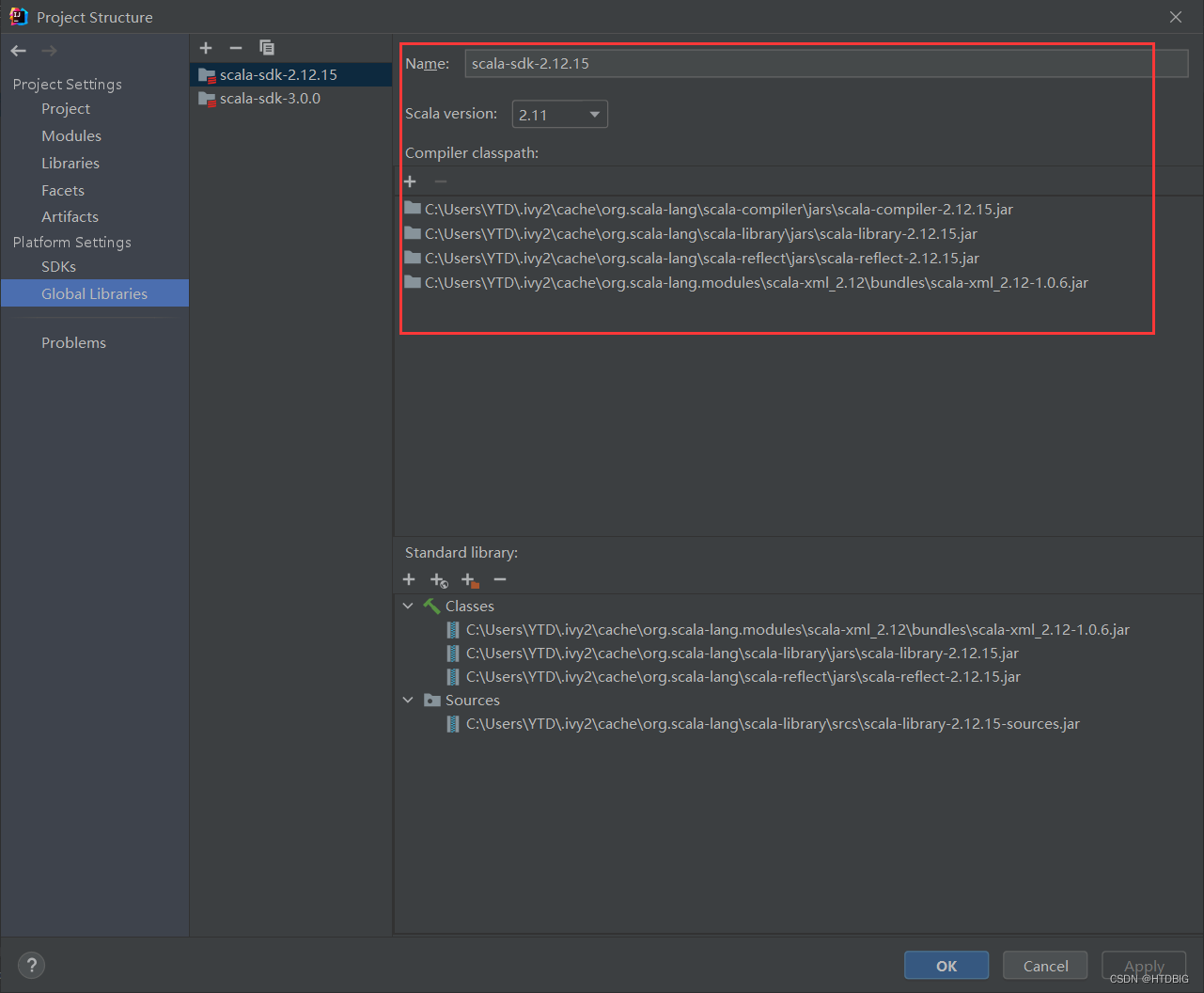

- 查看scala版本

- 添加依赖

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>net.cch.rdd</groupId>

<artifactId>SparkRDDWordCount01</artifactId>

<version>1.0-SNAPSHOT</version>

<properties>

<maven.compiler.source>8</maven.compiler.source>

<maven.compiler.target>8</maven.compiler.target>

</properties>

<dependencies>

<dependency>

<groupId>org.scala-lang</groupId>

<artifactId>scala-library</artifactId>

<version

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5704

5704

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?