规划旨在构建内丘县中心城区畅通高效的道路交通体系,指导城市道路交通建设。

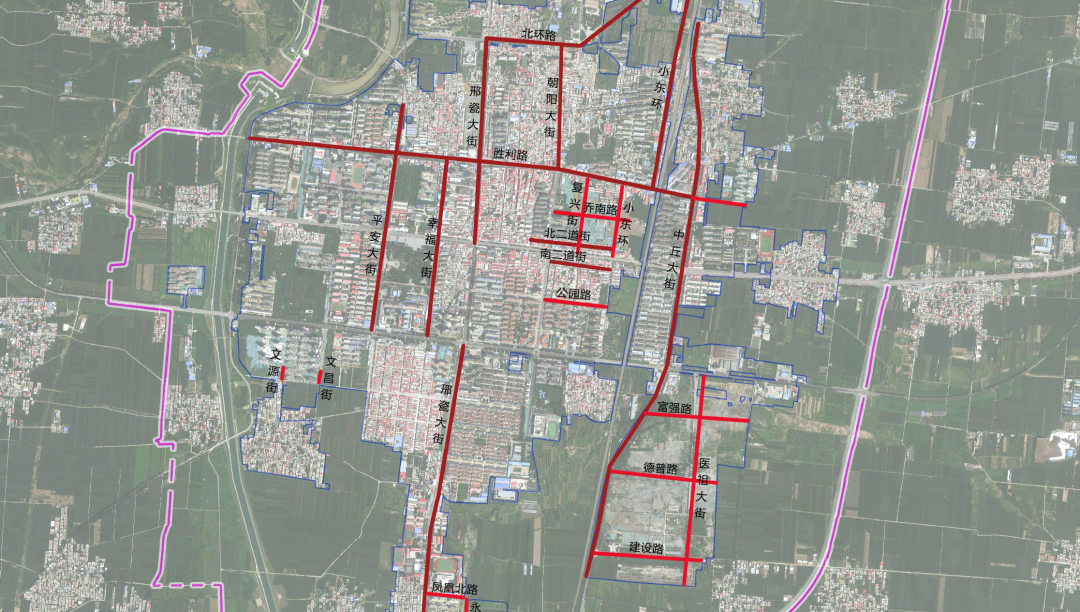

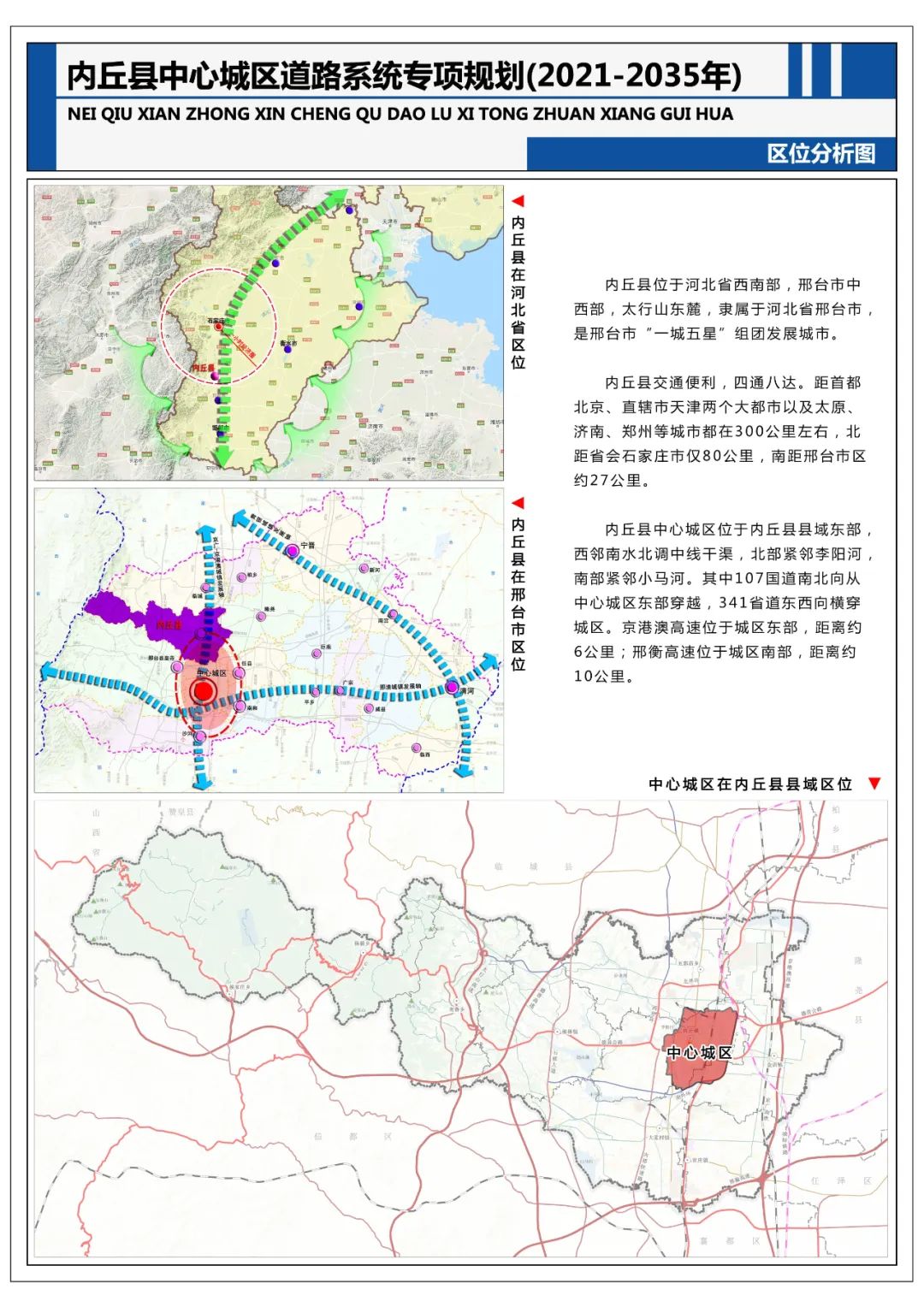

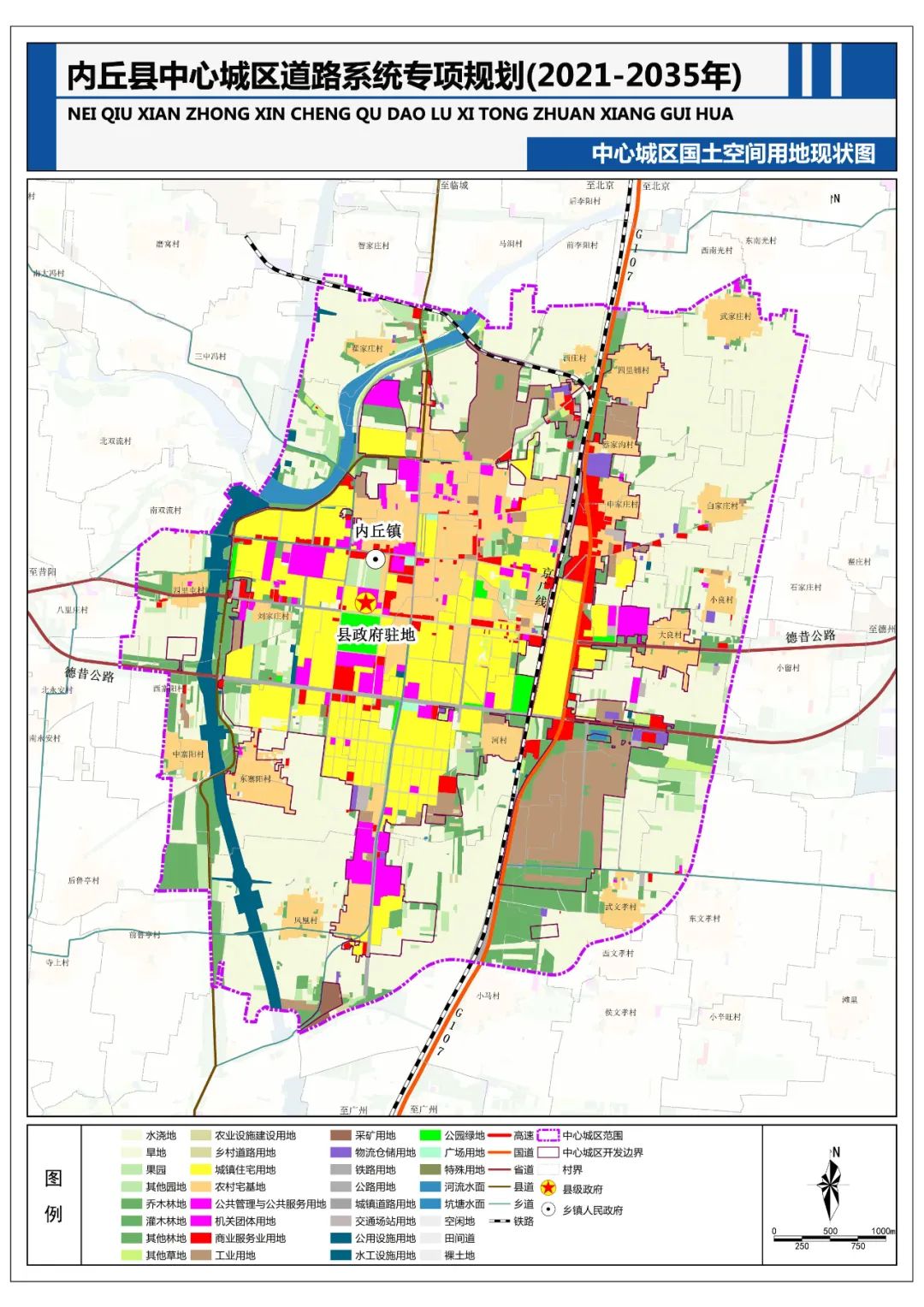

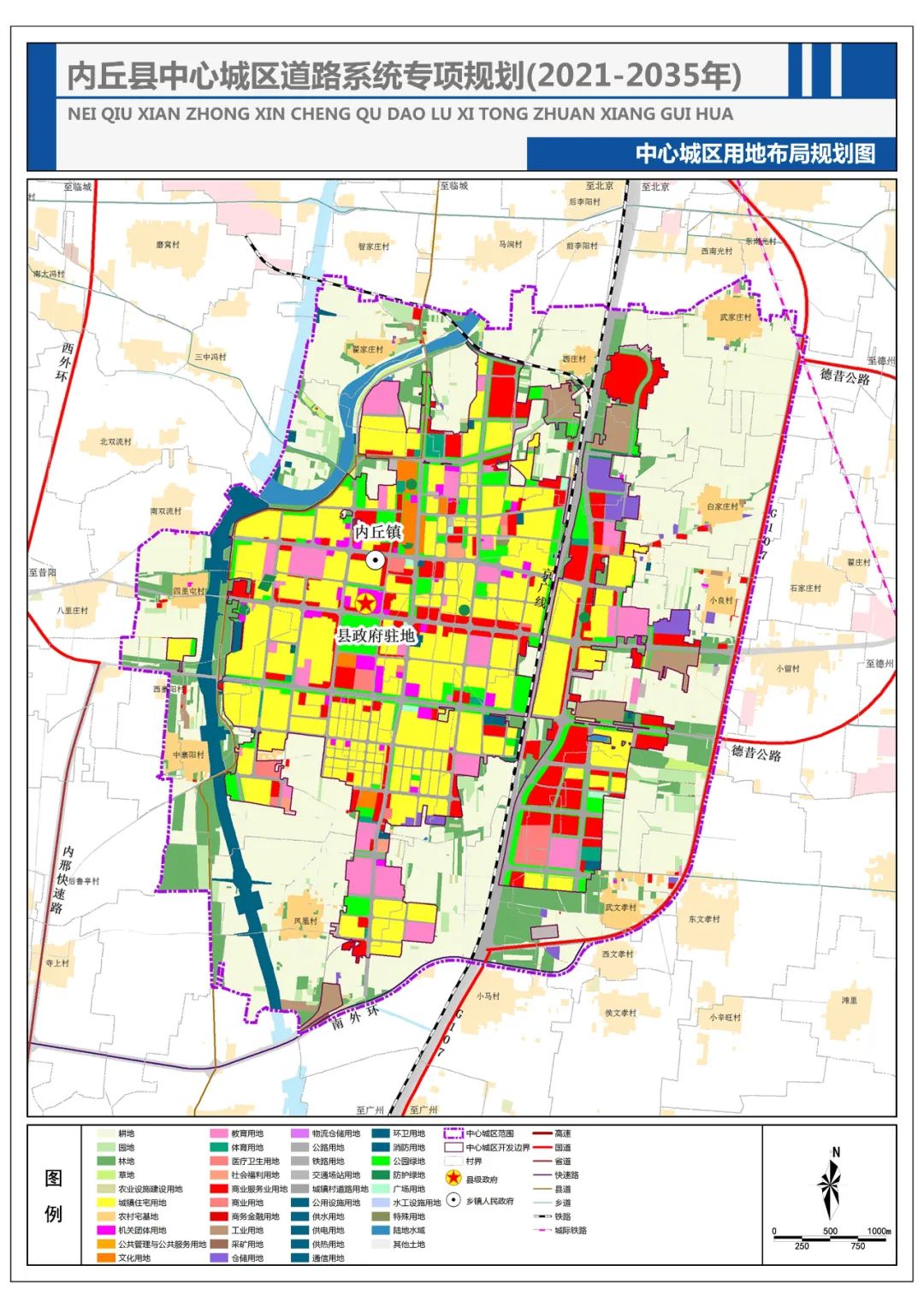

总则:依据相关法律法规和规划编制,规划期限为 2021 - 2035 年,近期至 2025 年,规划范围包括 12.48 平方千米的开发边界范围和 28.72 平方千米的主要研究范围。

道路交通发展目标与战略:目标是构筑可持续、协调、一体化的综合交通系统;战略是全面研究规划交通,立足城区特色解决交通问题。

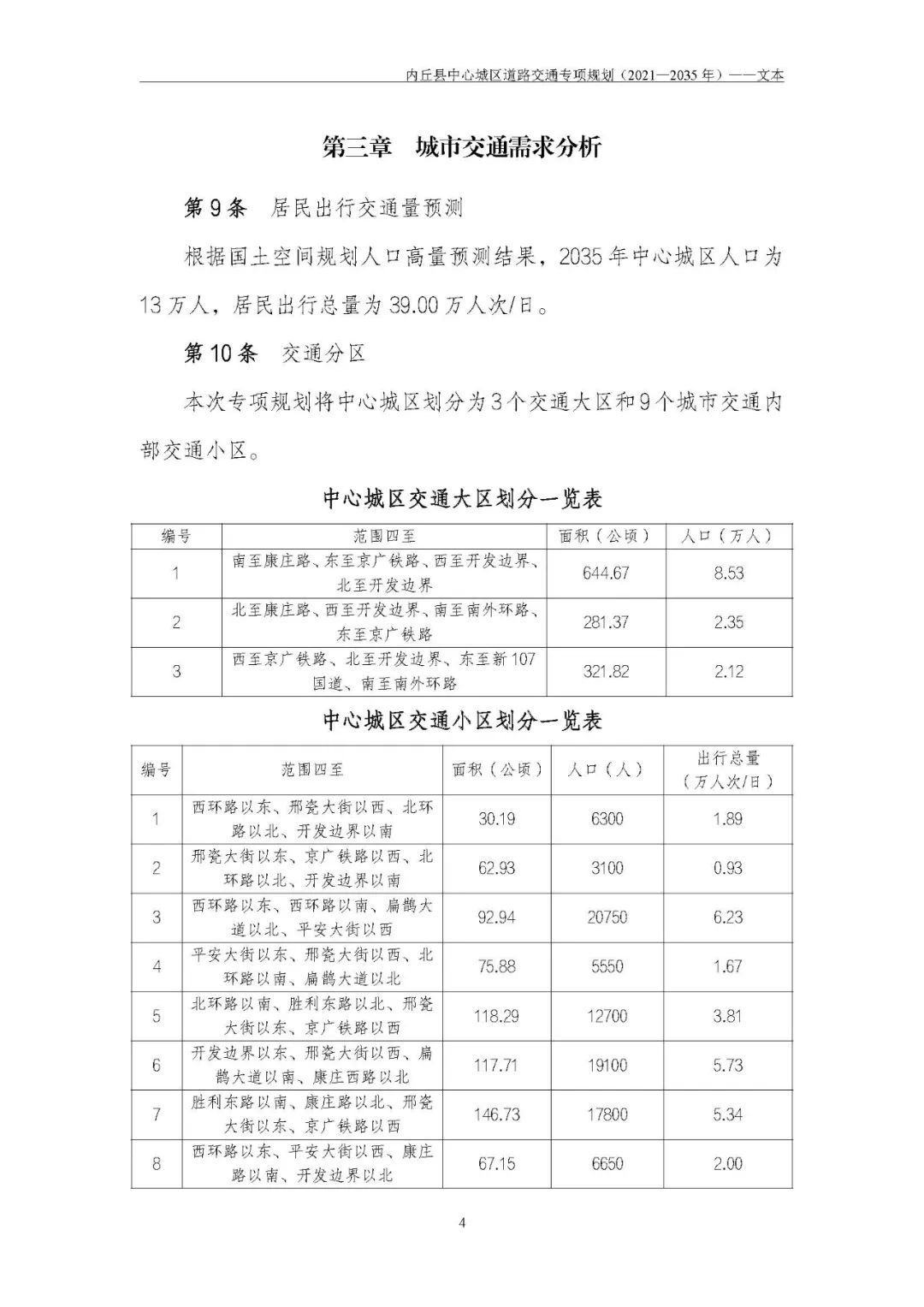

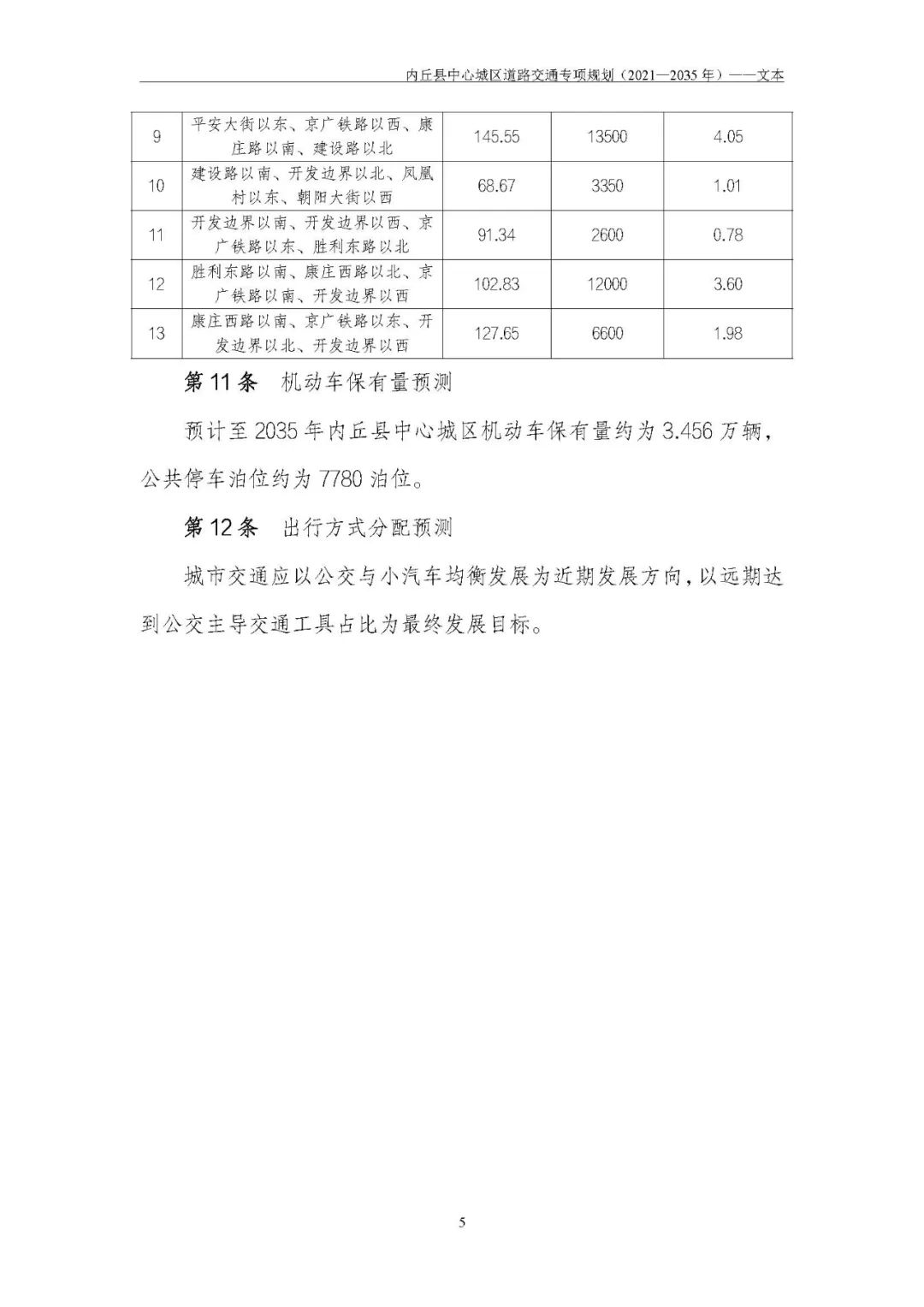

城市交通需求分析:预测 2035 年中心城区人口 13 万人,居民出行总量 39.00 万人次 / 日,机动车保有量约 3.456 万辆。将中心城区划分为 3 个交通大区和 9 个内部交通小区 ,确定公交与小汽车均衡发展的近期方向和公交主导的远期目标。

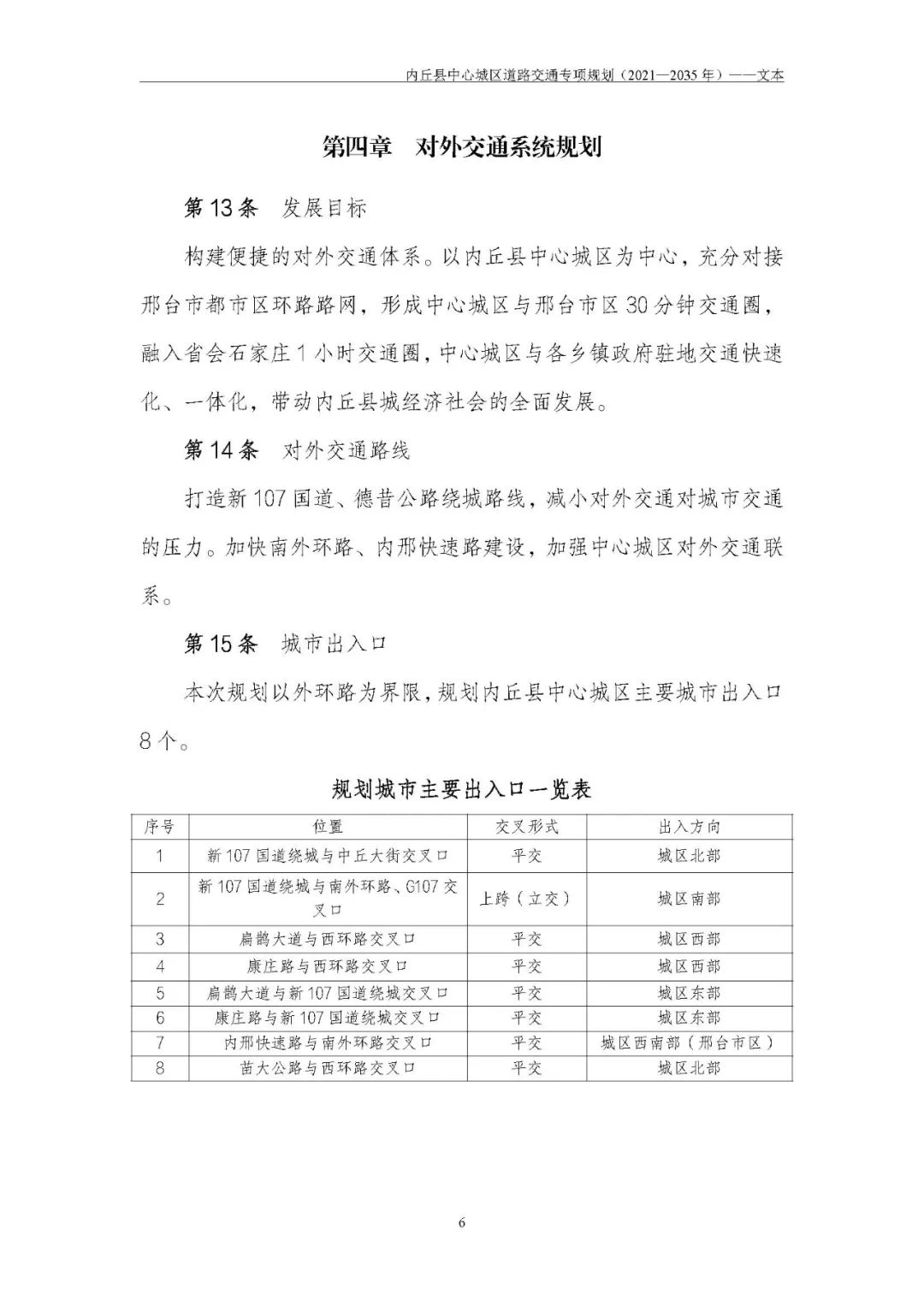

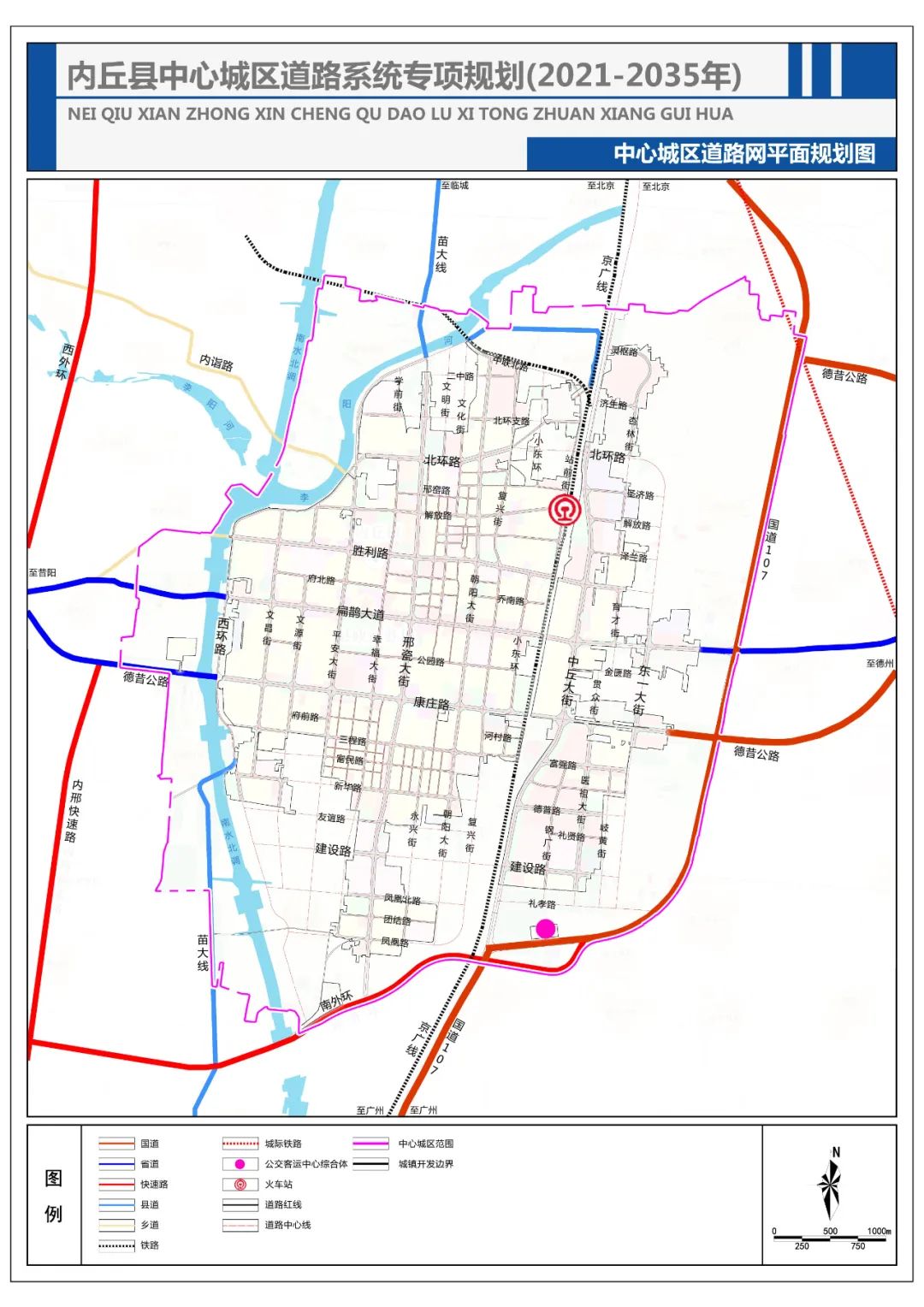

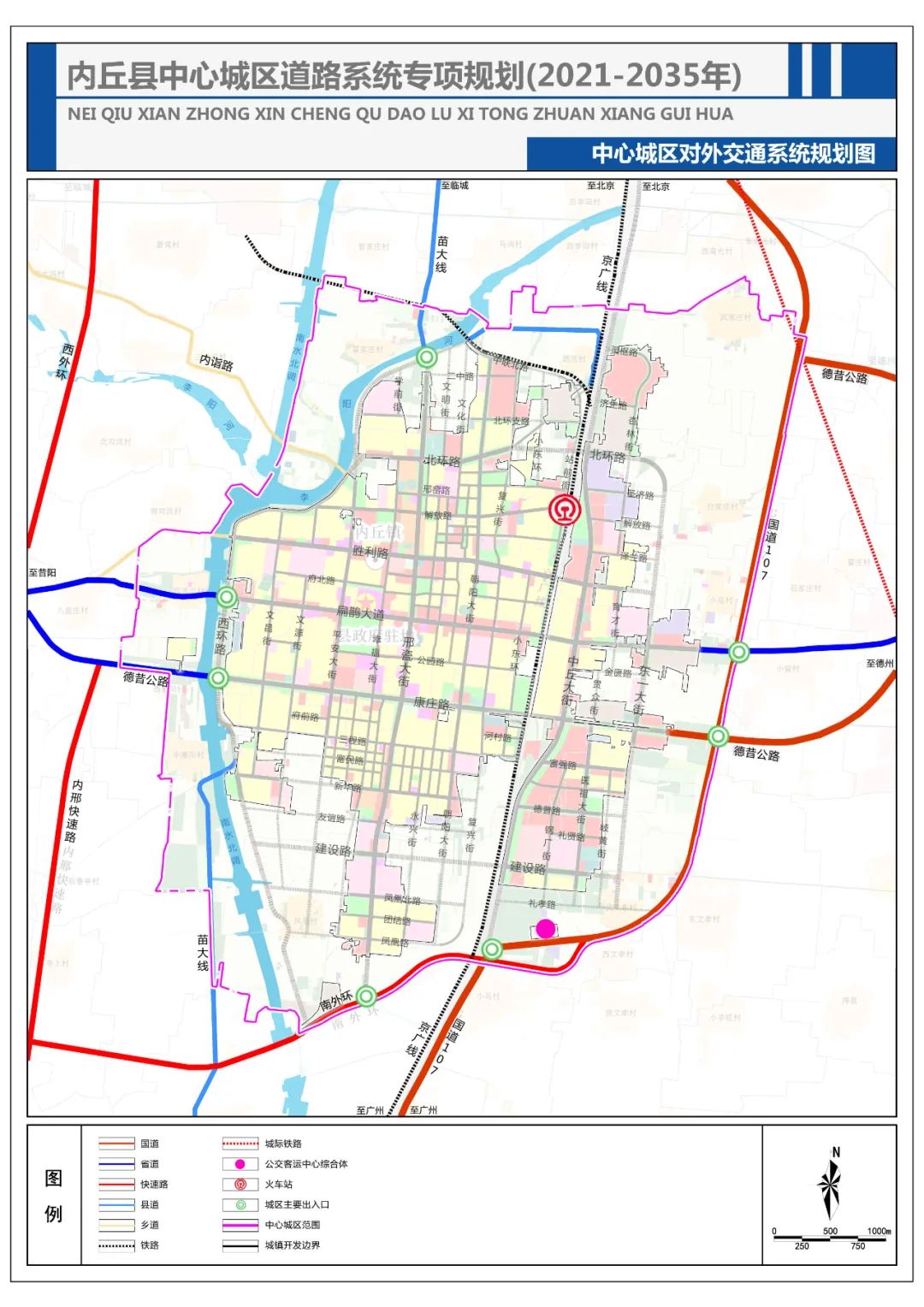

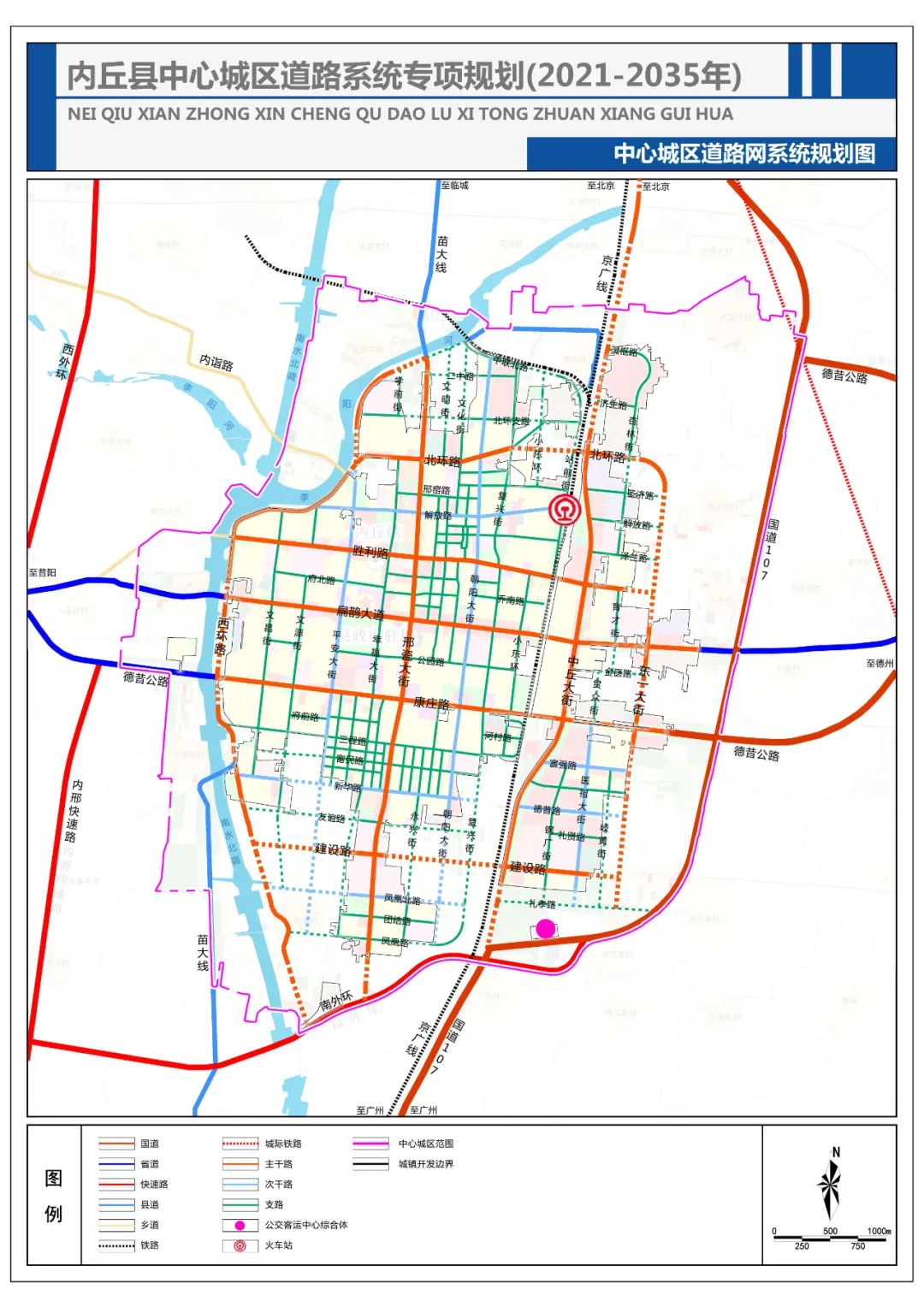

对外交通系统规划:构建便捷对外交通体系,形成与周边区域的快速交通圈。打造绕城路线,建设相关道路,规划 8 个城市主要出入口。

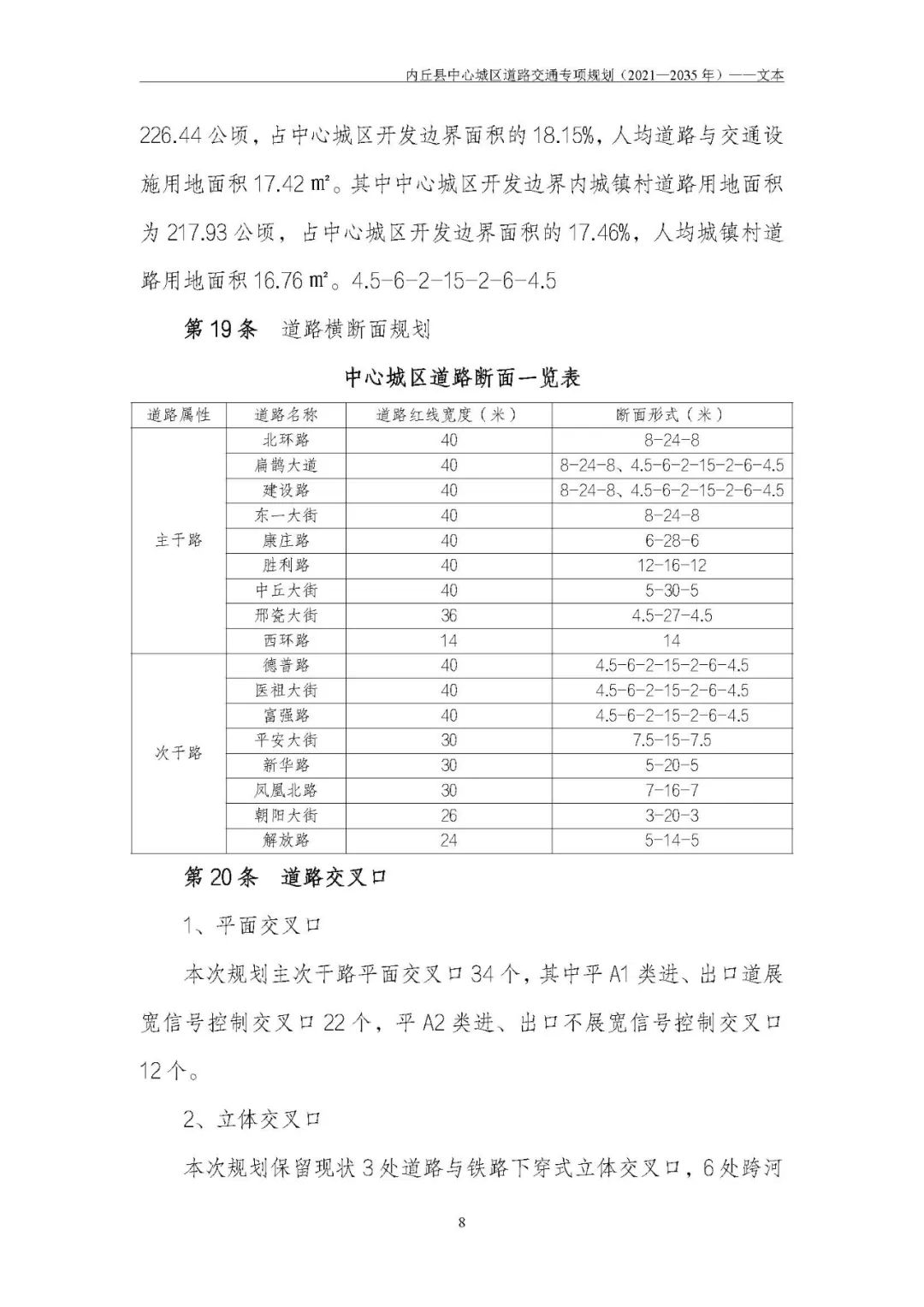

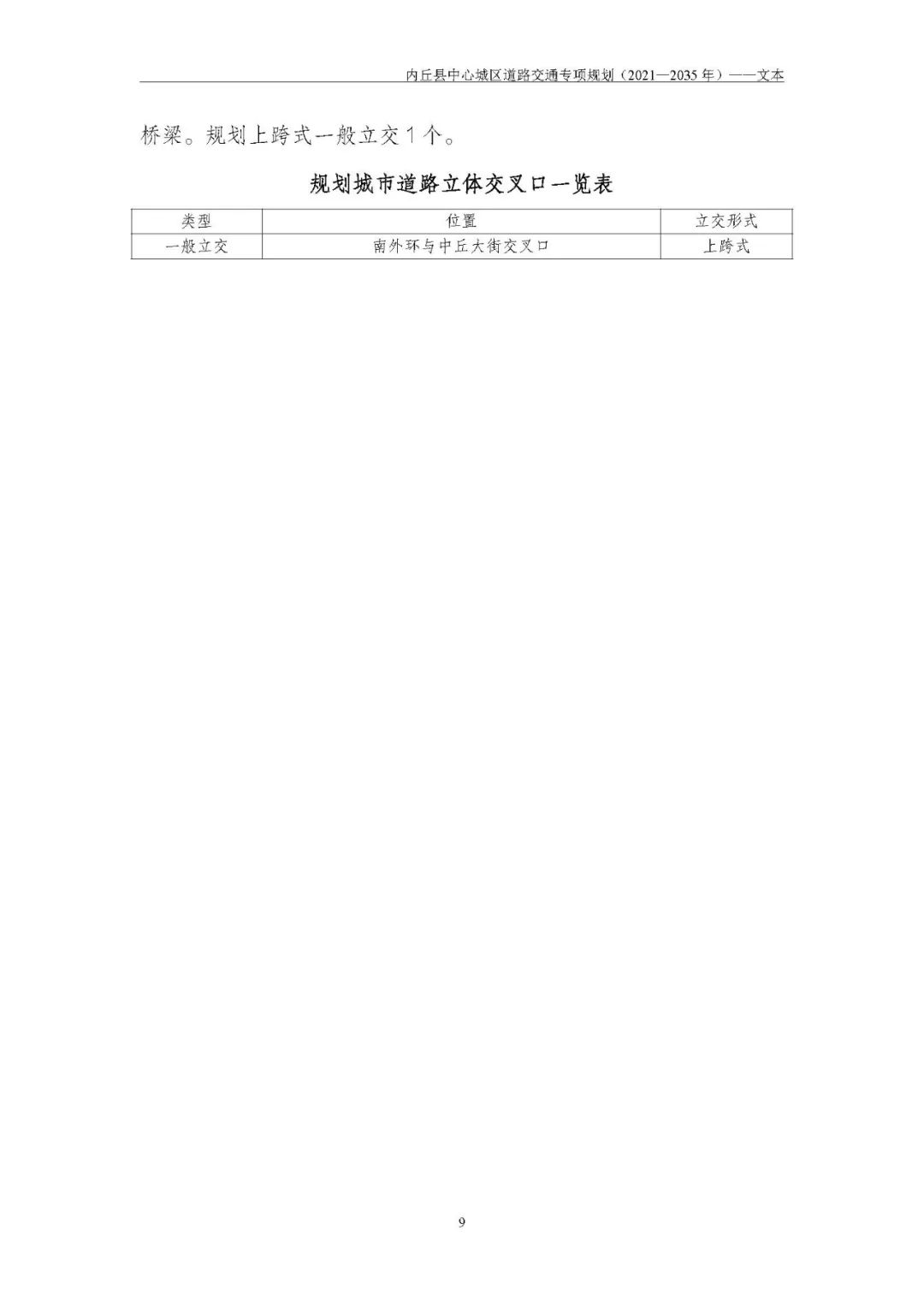

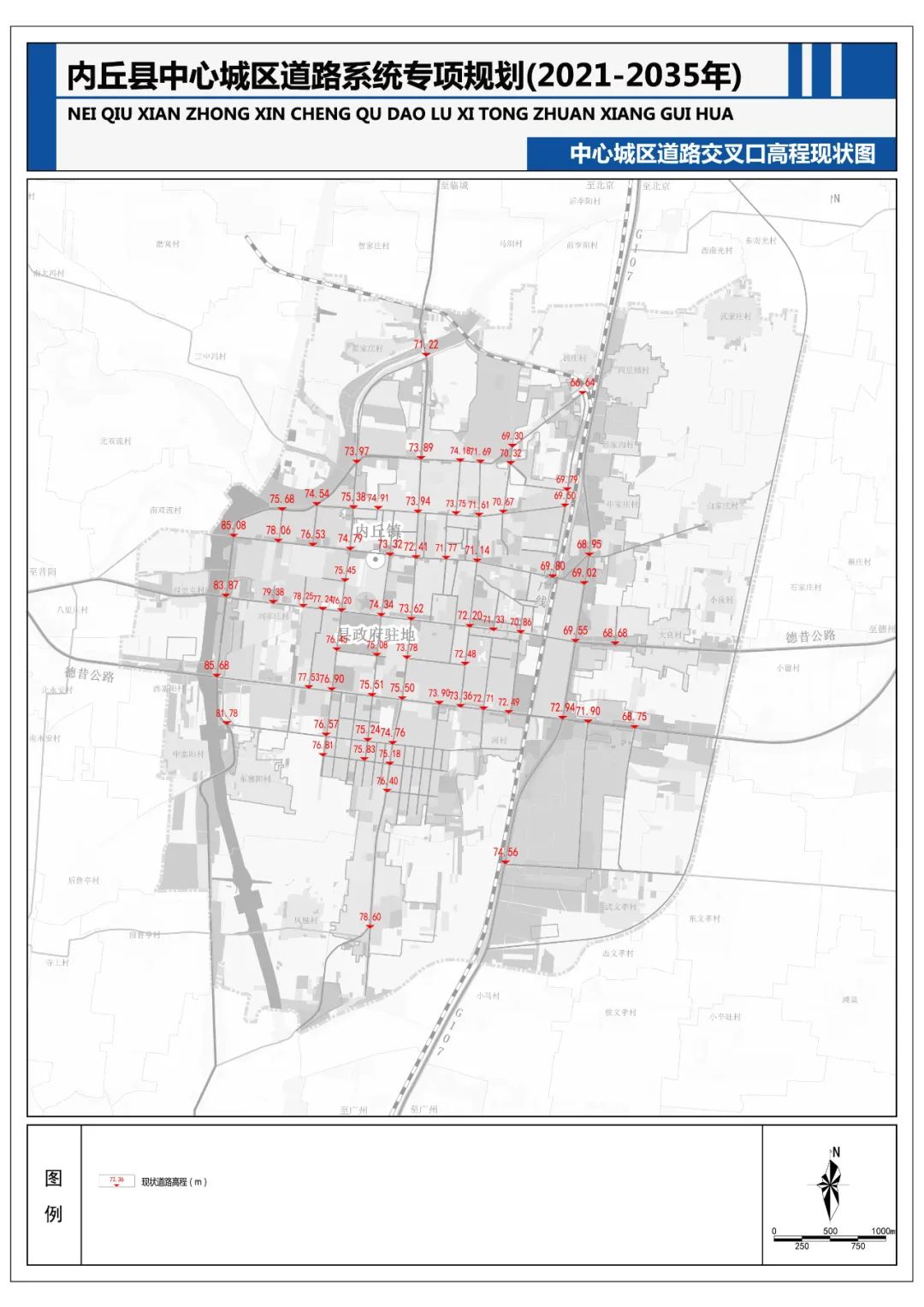

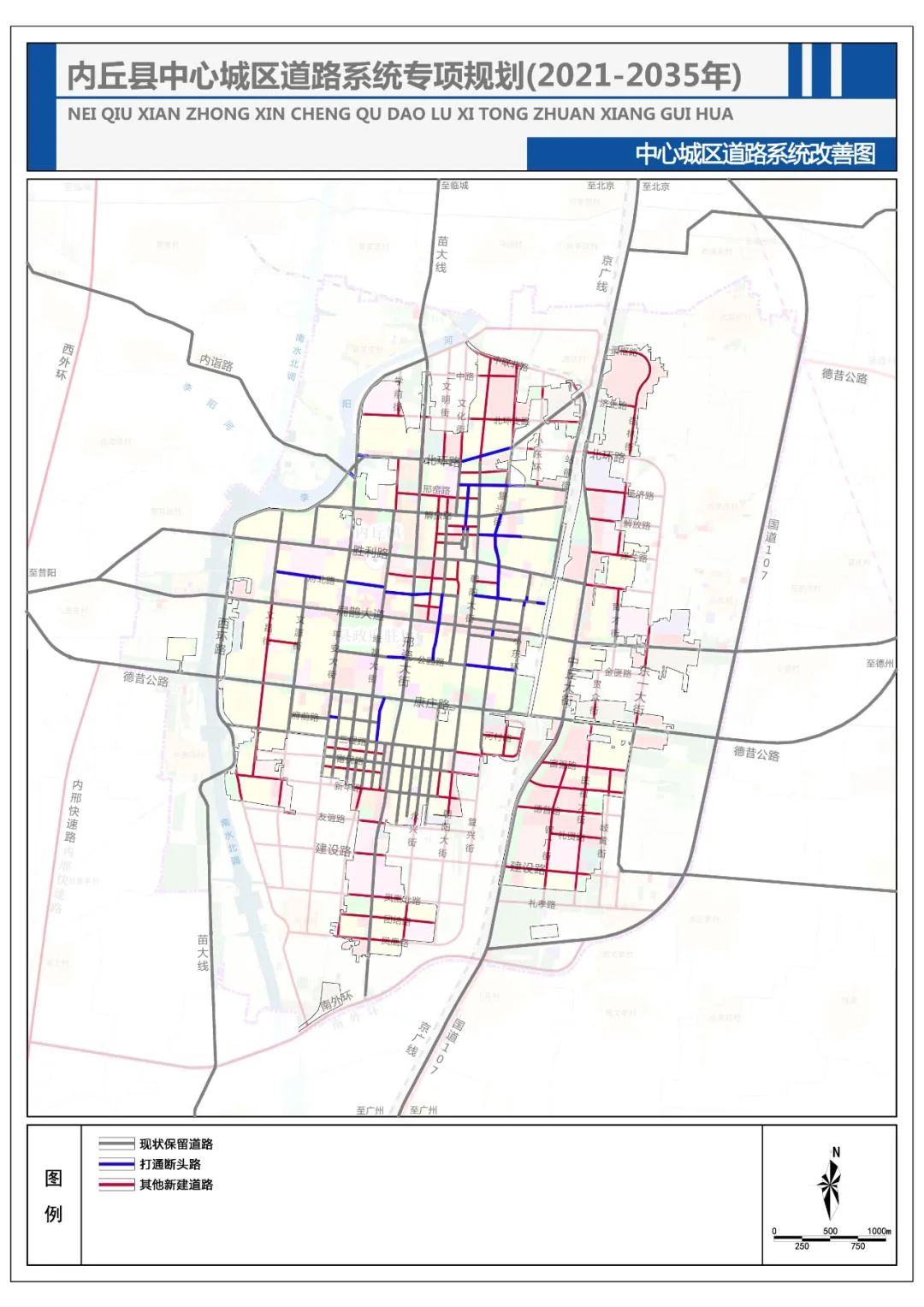

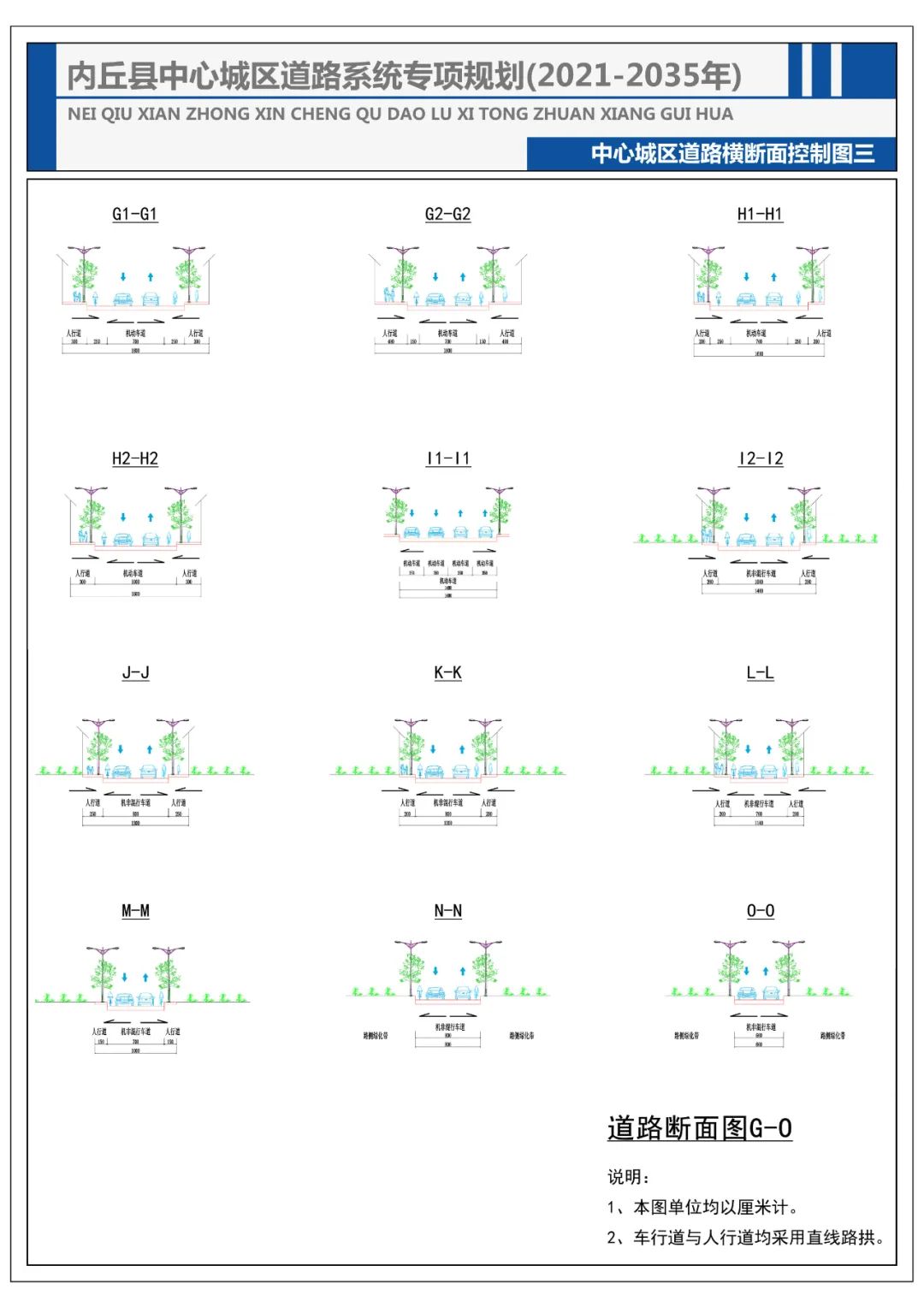

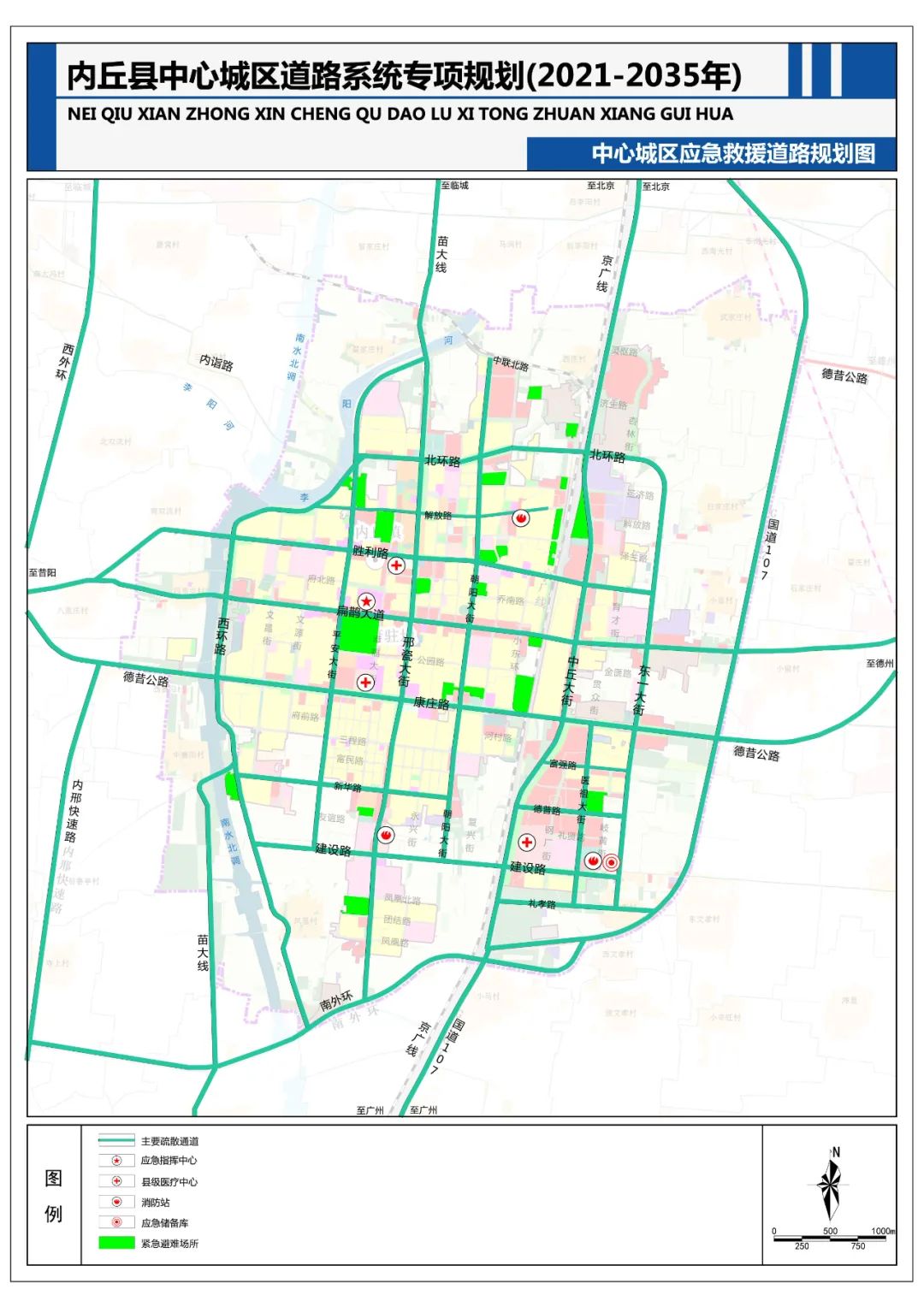

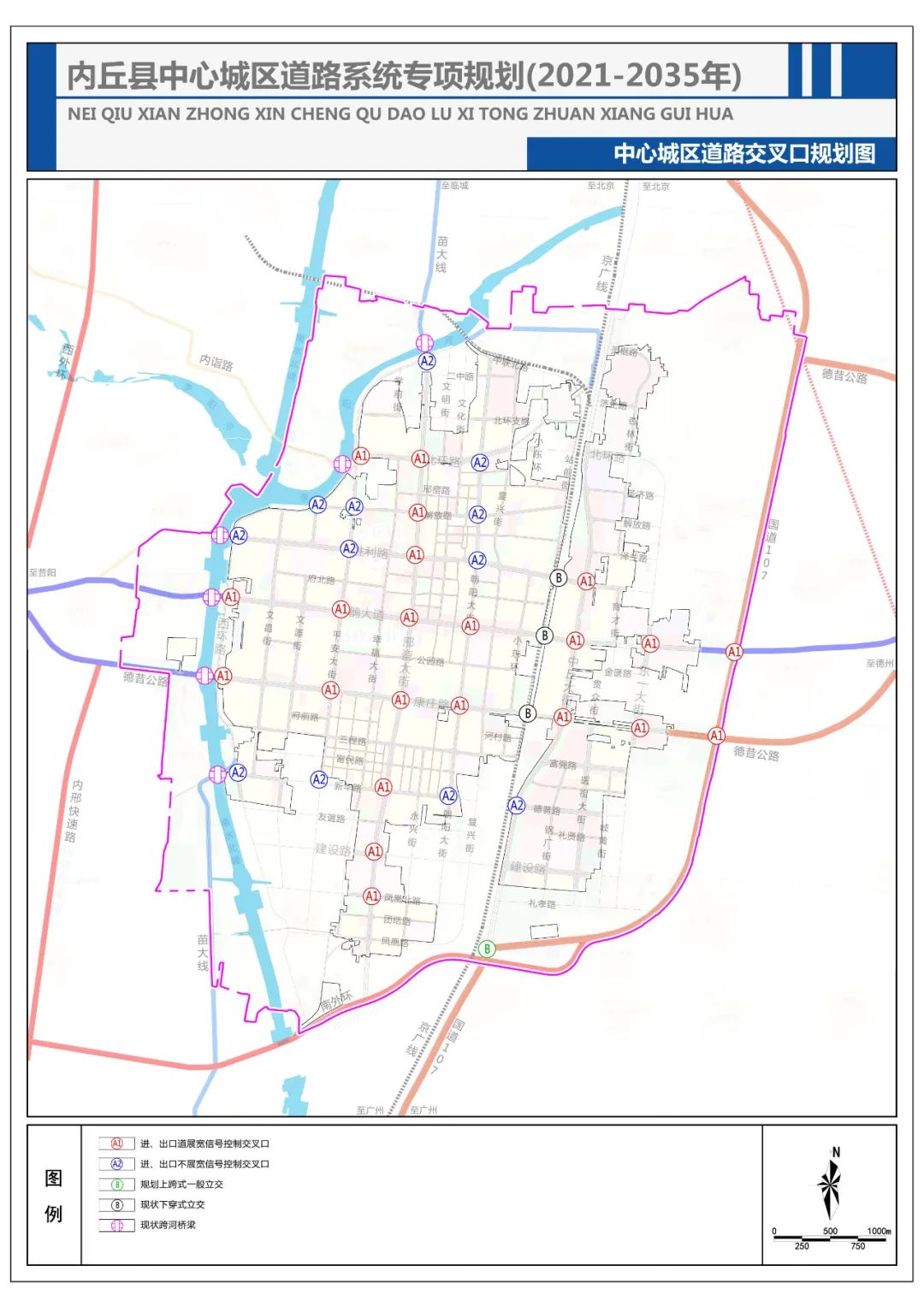

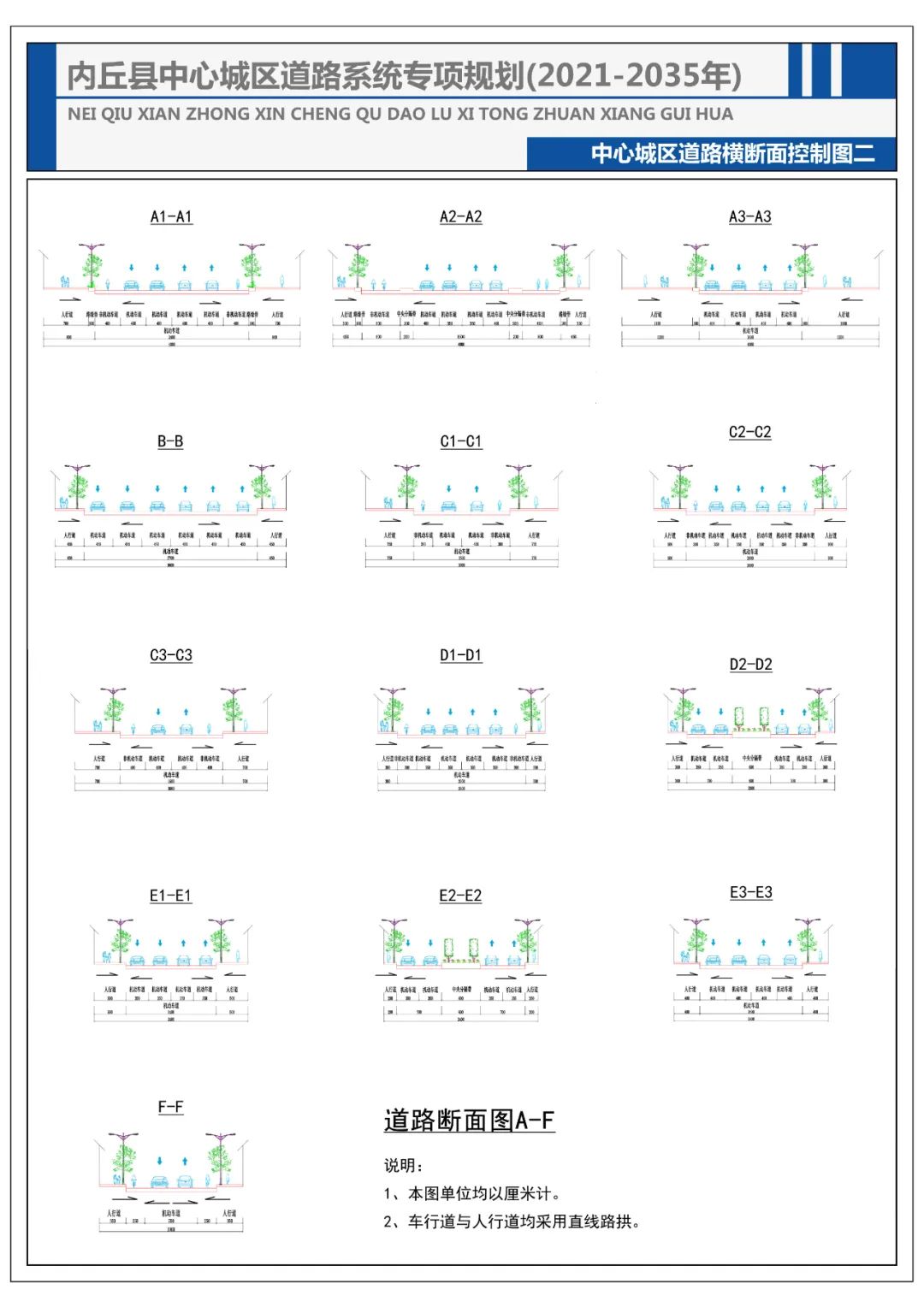

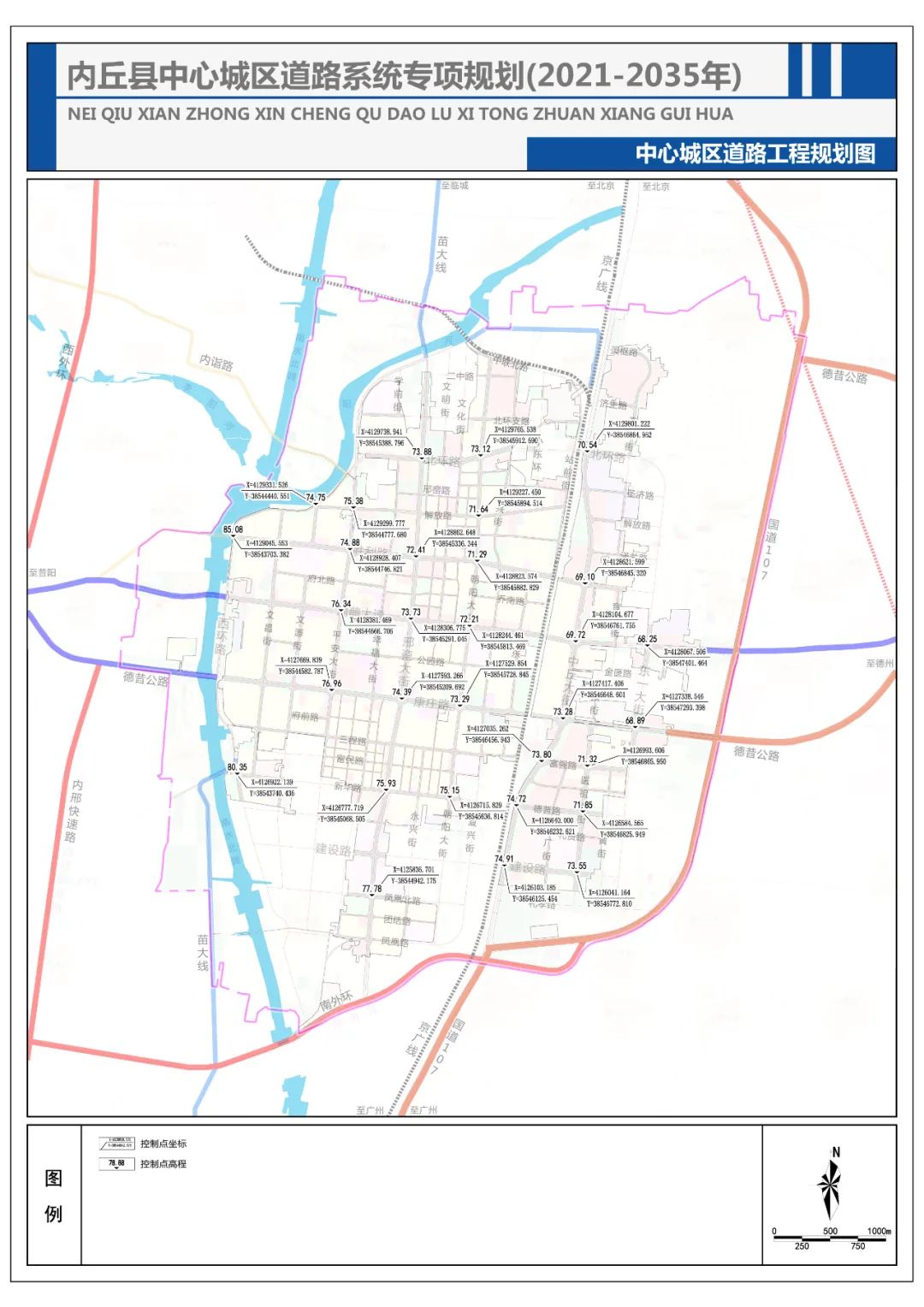

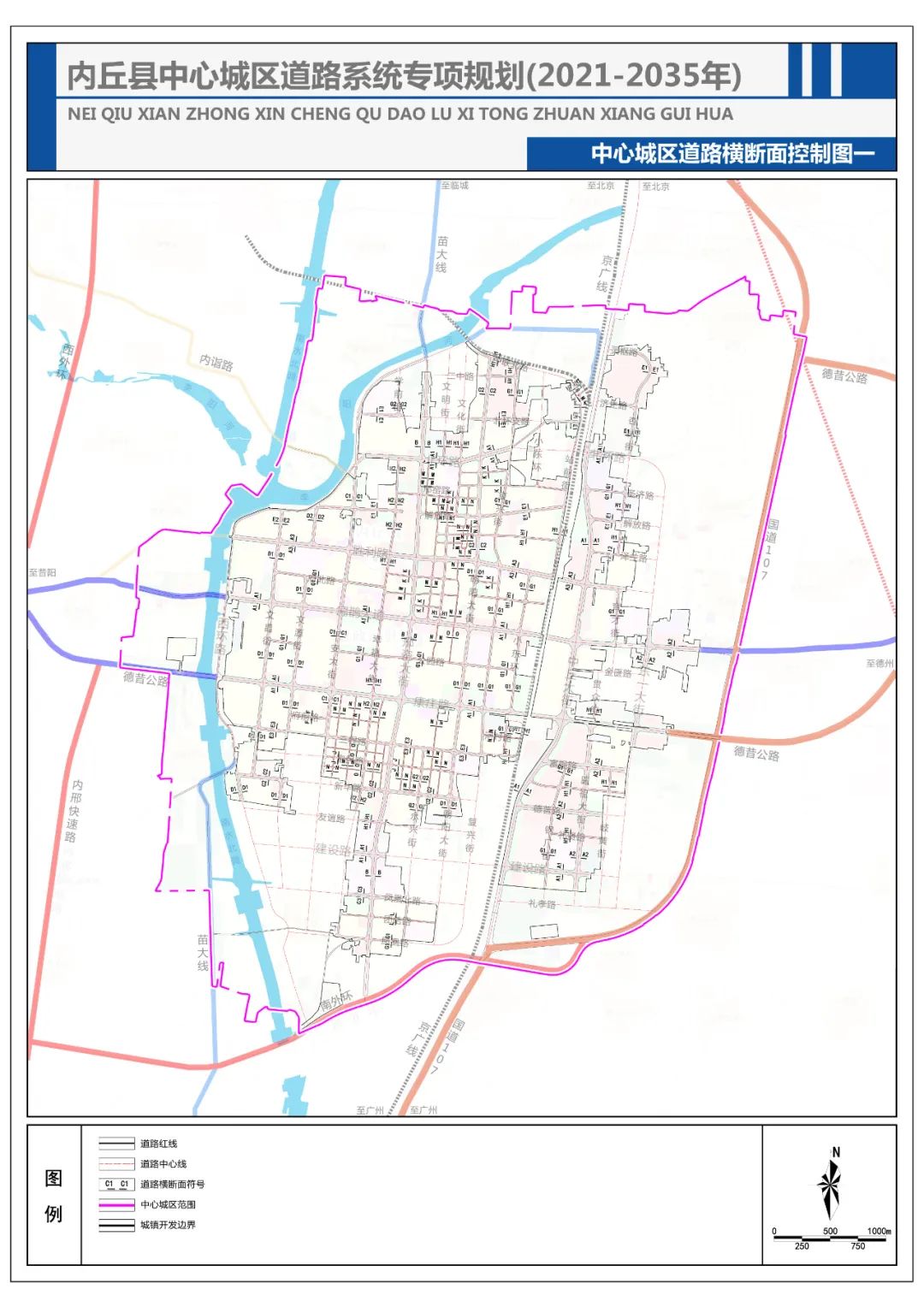

中心城区道路系统规划:优化总体规划道路系统,形成 “五横四纵” 骨架路网,规划道路控制指标、横断面和交叉口形式,新修和打通部分道路。

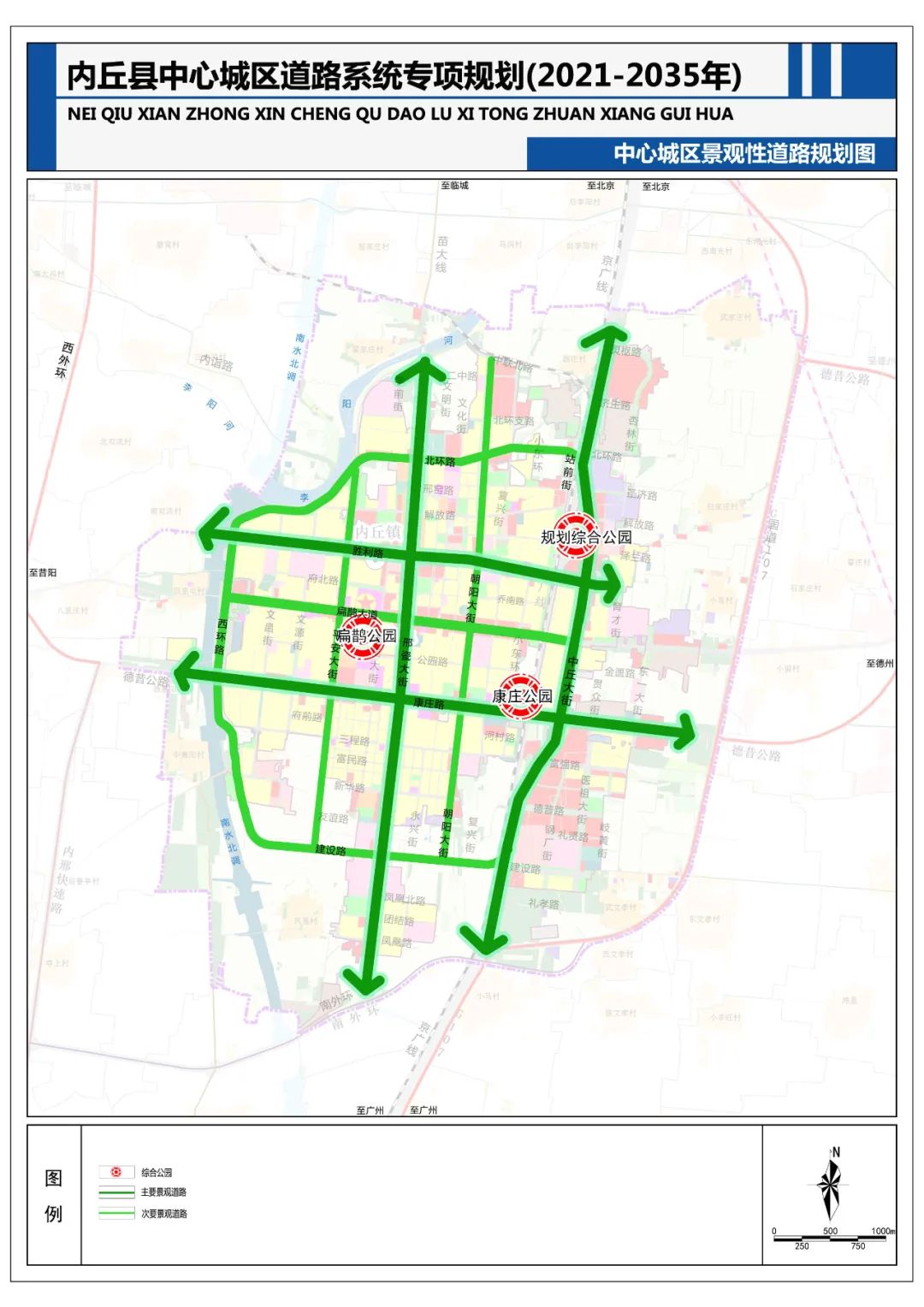

景观性道路系统规划:布局与生态用地结合,串联生态空间和公共活动空间,构建 “两横两纵” 主要和 “三横三纵” 次要景观结构。

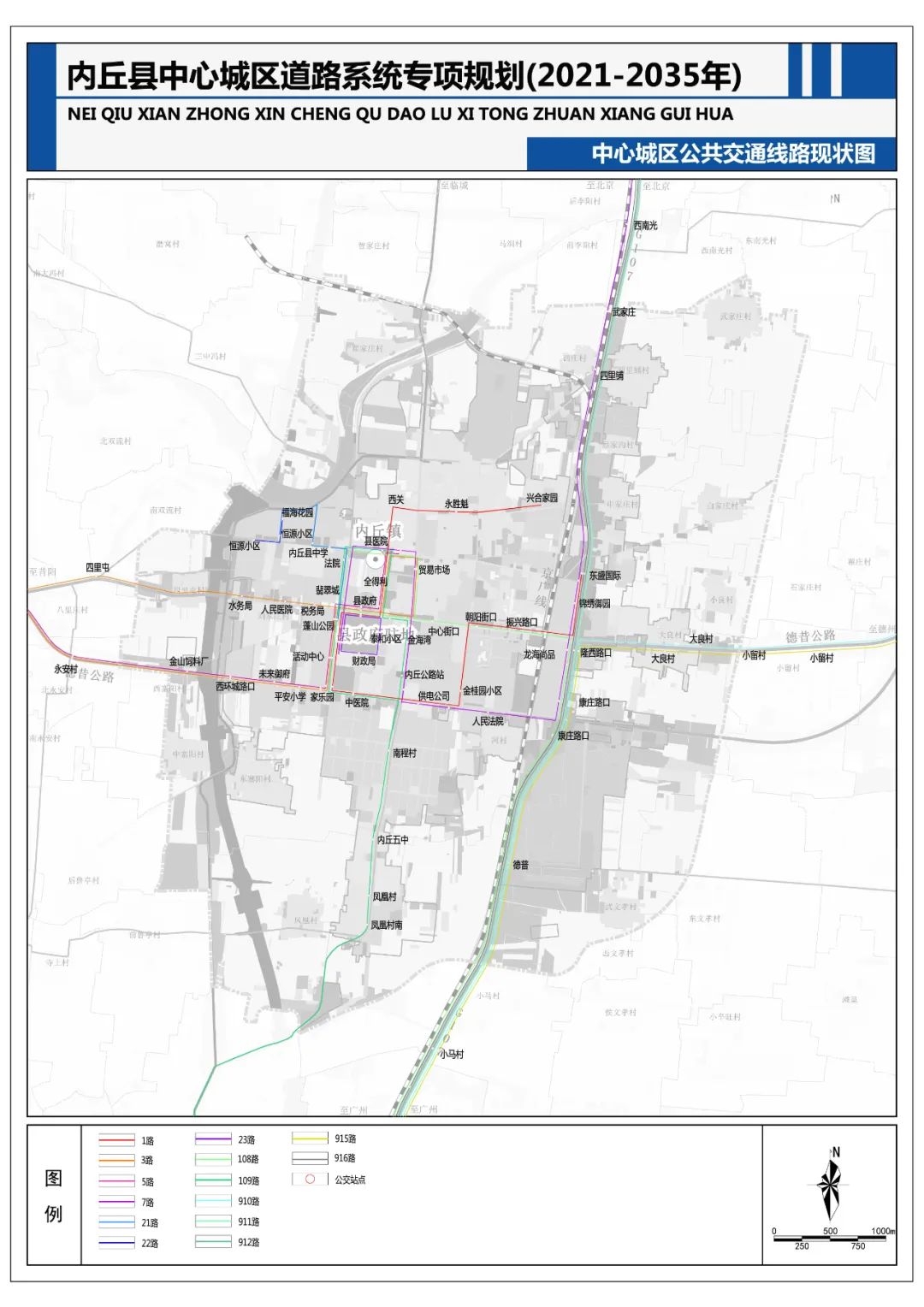

公共交通系统规划:线路分干线、普线和支线,规划站点覆盖率,新建 1 座公交客运中心综合体。

慢行系统规划:近期整改占道,远期形成完善慢行系统。规划非机动车干道,打造多种慢行区域,保障人行道和行人过街设施。

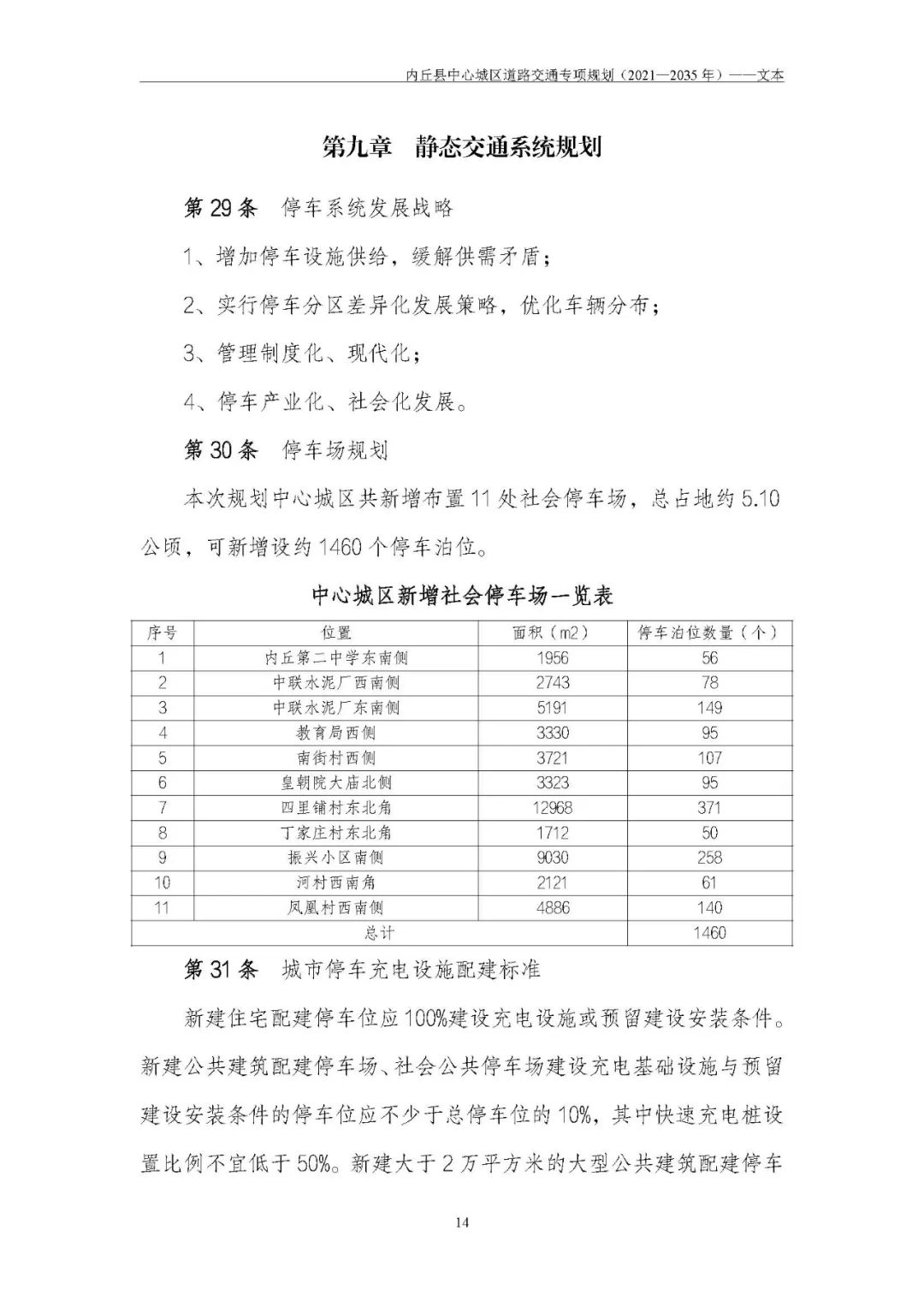

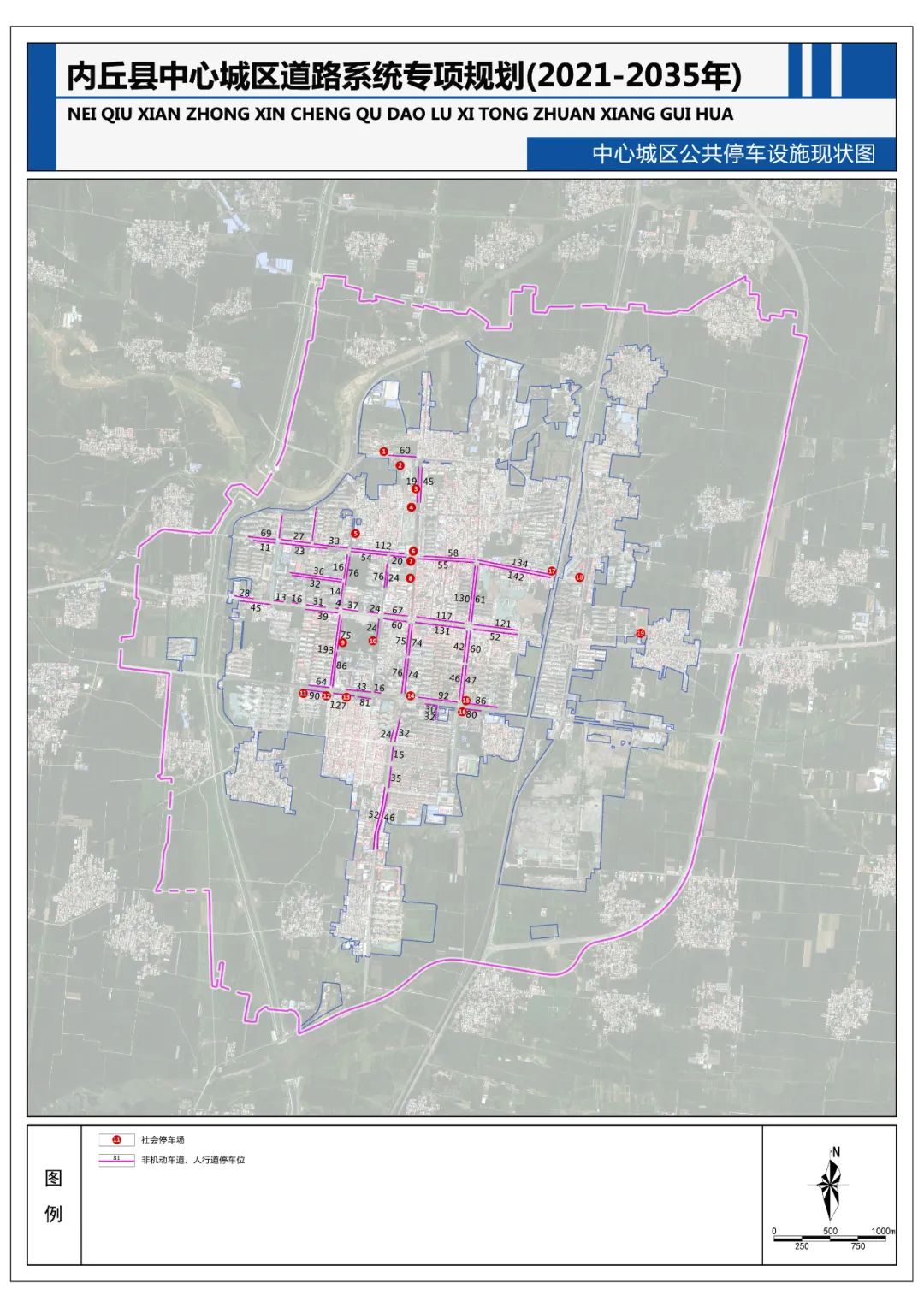

静态交通系统规划:增加停车设施供给,实行分区差异化发展,规划 11 处社会停车场,制定停车充电设施配建标准。

客货运系统组织规划:规划 1 座公交客运中心综合体,新增 9 条短途客运线路;划分货运交通线路,明确不同类型货运道路。

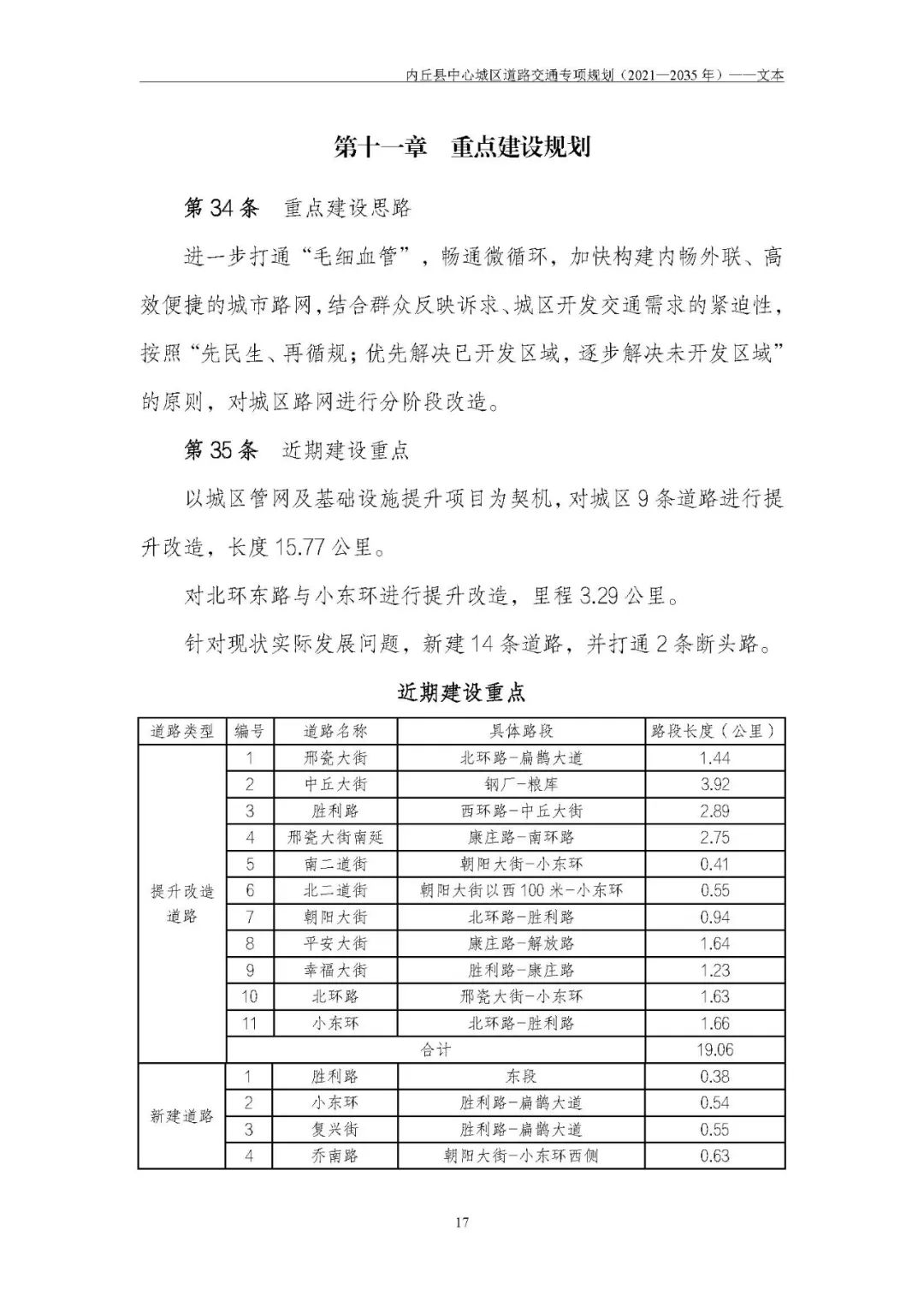

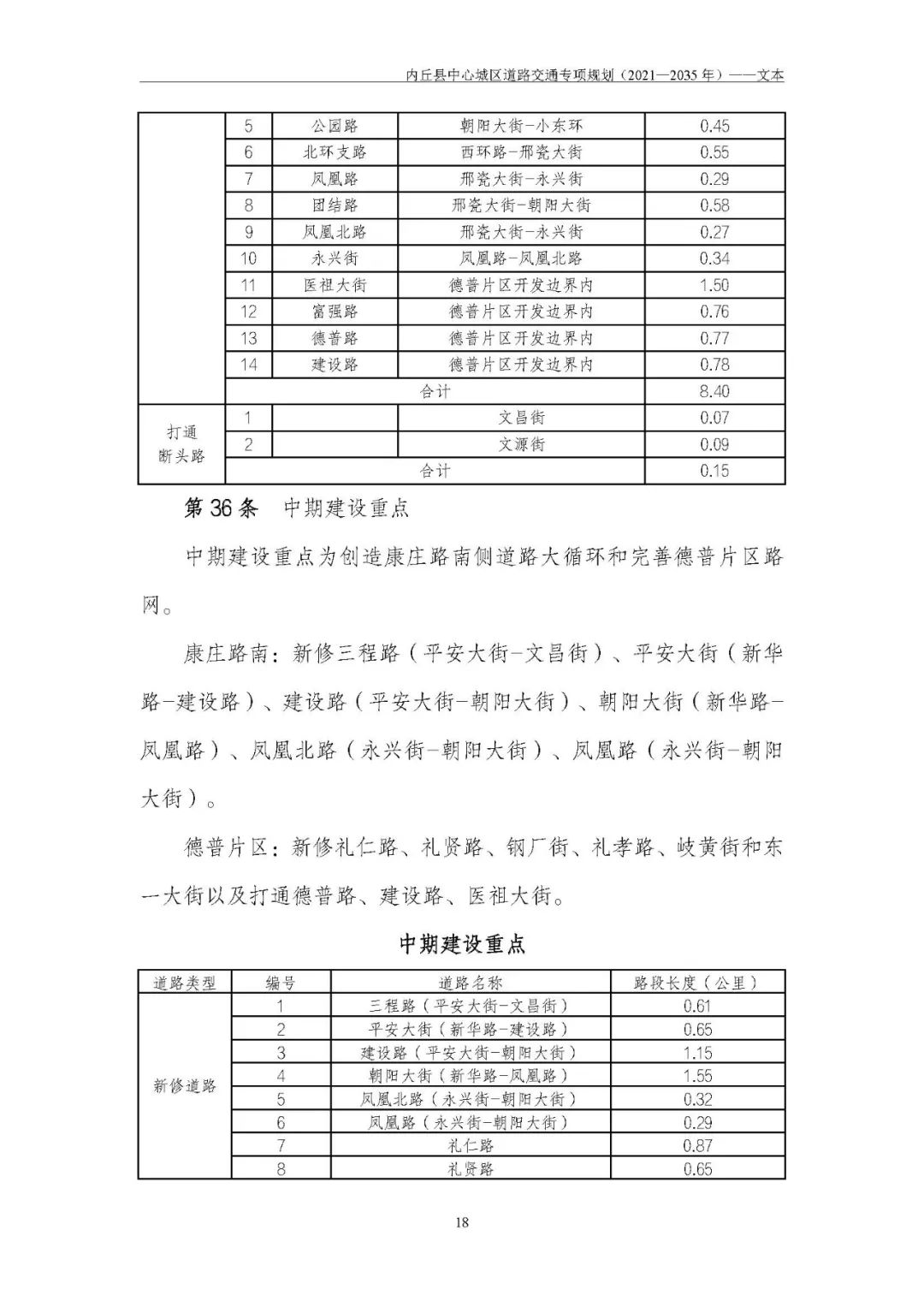

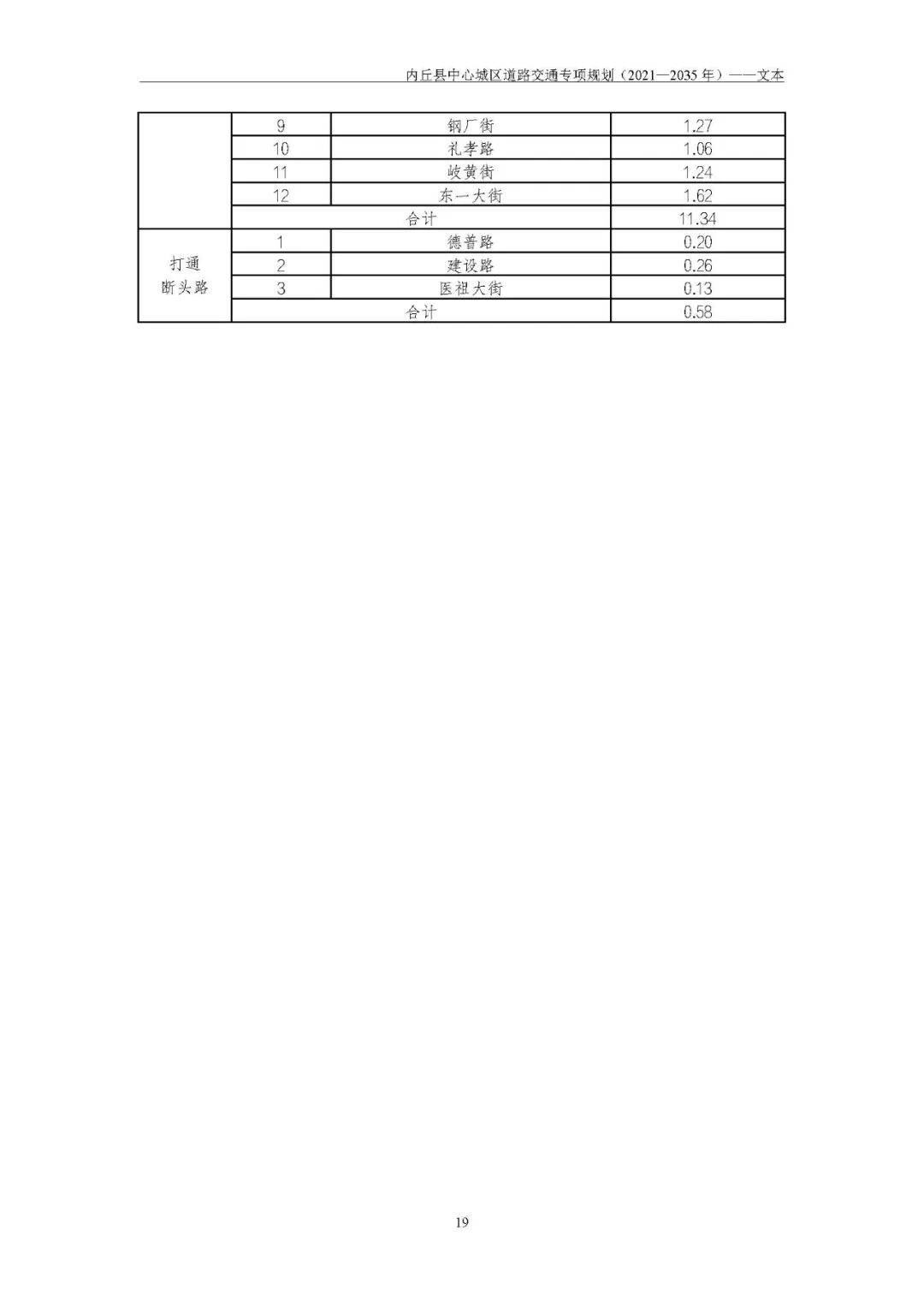

重点建设规划:按照 “先民生、再循规” 原则分阶段改造路网。近期提升改造 9 条道路,新建 14 条道路并打通 2 条断头路;中期创造康庄路南侧道路大循环,完善德普片区路网。

附则:规划包括文本、附件、图册,经批准后实施,由内丘县城市管理综合行政执法局负责解释。

后台回复“250430”,可获得下载资料的方法。

本公号使用腾讯元器(使用DeepSeek R1大模型)创建了智能交通技术AI服务,欢迎扫码进入体验(或在后台使用私信对话)。

欢迎加入智能交通技术群!扫码进入。

点击文后阅读原文,可获得下载资料的方法。

联系方式:微信号18515441838

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?