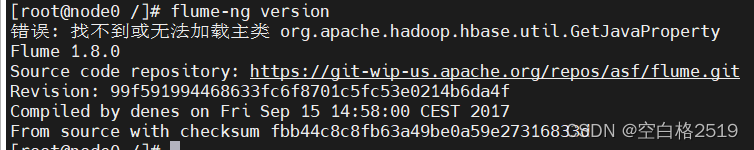

前提:flume已成功安装且已正确配置相应的环境变量

示例1

实现功能

监控指定目录,当目录有新的日志文件产生时,把日志一行一行打印到控制台。

(1)编写配置文件

创建和修改配置文件。

cd /opt/module/apache-flume-1.8.0-bin/conf

vi agent1.conf

输入以下内容。

#1、定义Agent名称、Source、Channel、Sink的名称

agent1.sources = source1

agent1.channels = channel1

agent1.sinks = sink1

#2、配置channel组件属性

agent1.channels.channel1.type = memory

#2、配置source组件属性

agent1.sources.source1.channels = channel1

agent1.sources.source1.type = spooldir

agent1.sources.source1.spoolDir = /home/flume/flumetest1

#2、配置sink组件属性

agent1.sinks.sink1.channel = channel1

agent1.sinks.sink1.type = logger

(2)启动Flume Agent

(在apache-flume-1.8.0-bin文件夹下)

bin/flume-ng agent -n agent1 -c conf -f conf/agentconf -Dflume.root.logger=INFO,console

(3)测试

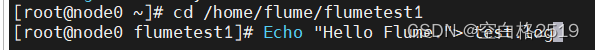

在/home/flume/flumetest1 目录下模拟生成新的日志文件(目录提前创建)

Echo "Hello Flume."> test.log

结果图如下

内容写入Channel后文件被标记,增加“.COMPLETED”的后缀。

示例2

实现功能

监控指定目录,当目录有新的文件产生时,把日志保存到HDFS中。

(1)修改配置文件

输入以下内容

#1、定义Agent名称、Source、Channel、Sink的名称

agent2.sources = source2

agent2.channels = channel2

agent2.sinks = sink2

#2、配置channel组件属性

agent2.channels.channel2.type = memory

agent2.channels.channel2.capacity = 10000

agent2.channels.channel2.transactionCapacity = 100

#2、配置source组件属性

agent2.sources.source2.channels = channel2

agent2.sources.source2.type = spooldir

agent2.sources.source2.spoolDir = /home/flume/flumetest2

#定义拦截器,为消息添加时间戳

agent2.sources.source2.interceptors = i1

agent2.sources.source2.interceptors.i1.type = org.apache.flume.interceptor.TimestampInt

erceptor$Builder

#2、配置sink组件属性

agent2.sinks.sink2.channel = channel2

agent2.sinks.sink2.type = hdfs

agent2.sinks.sink2.hdfs.path = hdfs://node0:9000/flume/%Y%m%d

agent2.sinks.sink2.hdfs.filePrefix = events-

agent2.sinks.sink2.hdfs.fileType = DataStream

#不按照条数生成文件

agent2.sinks.sink2.hdfs.rollCount = 0

#HDFS上的临时文件达到128MB时生成一个HDFS文件

agent2.sinks.sink2.hdfs.rollSize = 134217728

#HDFS上的临时文件间隔60秒时生成一个HDFS文件

agent2.sinks.sink2.hdfs.rollInterval = 60

(2)启动Flume Agent

执行以下命令

bin/flume-ng agent -n agent2 -c conf -f conf/agent2.conf -Dflume.root.logger=INFO,console

(3)测试

新开一个窗口,在/home/flume/flumeteat2 目录下模拟产生新的日志文件(事先新建目录)

echo "Hello Flume." > test12.log

(4)查看结果

hdfs dfs -lsr /flume

或者

本文仅作学习分享,参考资料已在文章结尾标明

[1]杨治明,许桂秋.Hadoop大数据技术与应用[M].北京:人民邮电出版社,2021:207-209.

207

207

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?