目录

一、PCA是什么?

PCA是主成分分析(Principal Component Analysis)的缩写。它是一种用于数据降维的技术,可以帮助找到数据中最重要的特征或模式。通过PCA,可以将高维数据集转换为低维的数据集,同时尽量保留原始数据中的信息。它通过找到数据中的主要特征或主成分来实现这一点,这些主成分是彼此不相关的线性组合。这有助于减少数据的复杂性,同时保持数据的结构特征,使得数据更易于理解和分析。

二、PCA的数学原理

现在,我们尝试将一个三维的数据降维到二维,假如我们有以下数据

| 编号 | 身高 (cm) | 体重 (kg) | 鞋码 |

|---|---|---|---|

| 1 | 180 | 75 | 10 |

| 2 | 175 | 70 | 9 |

| 3 | 185 | 90 | 11 |

| 4 | 165 | 60 | 8 |

| 5 | 170 | 65 | 9 |

-

标准化数据: 首先,对数据进行标准化处理,确保各个特征具有相似的尺度,避免因为数据尺度不同导致主成分受到影响。这里计算这些特征的平均值和标准差,然后标准化数据。

编号 身高 (标准化) 体重 (标准化) 鞋码 (标准化) 1 0.674 0.5 0.5 2 0.134 0 0 3 1.342 1.5 1.5 4 -1.206 -1 -1 5 -0.944 -0.5 0 -

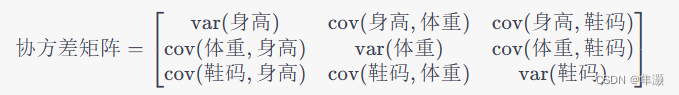

计算协方差矩阵: 确定数据的协方差矩阵,这个矩阵描述了数据中各特征之间的相关性。

-

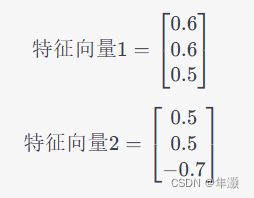

计算特征值和特征向量: 通过对协方差矩阵进行特征值分解,得到特征值和对应的特征向量。特征向量代表了数据中的主成分,而特征值表示特征向量的重要程度。

-

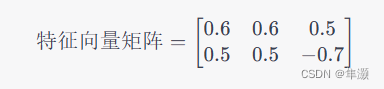

选择主成分: 特征值较大的特征向量对应的主成分包含了数据中的大部分信息。根据特征值的大小,选择最重要的特征向量,这些特征向量构成了新的特征空间。

-

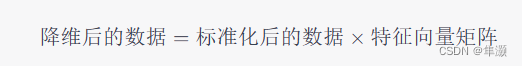

生成新的特征空间: 通过选取的特征向量构成的矩阵,将原始数据映射到新的低维空间,实现数据的降维。

三、PCA的算法实现

PCA算法的实现包括以下步骤:

-

数据标准化: 首先,对数据进行标准化处理,确保数据各个特征的尺度相似。这可以通过减去均值并除以标准差实现。

-

计算协方差矩阵: 基于标准化后的数据,计算协方差矩阵。

-

特征值分解: 对协方差矩阵进行特征值分解,得到特征值和对应的特征向量。

-

选择主成分: 根据特征值的大小,选择最重要的特征向量,它们对应的特征值较大,代表数据中的主成分。

-

生成新的特征空间: 将选择的特征向量组成的矩阵,将原始数据映射到新的低维空间,实现数据的降维。

import numpy as np # 数据标准化 data = np.array([[180, 75], [175, 70], [185, 90], [165, 60], [170, 65]]) mean = np.mean(data, axis=0) std_dev = np.std(data, axis=0) std_data = (data - mean) / std_dev # 计算协方差矩阵 cov_matrix = np.cov(std_data, rowvar=False) # 特征值分解 eigenvalues, eigenvectors = np.linalg.eig(cov_matrix) # 选择主成分 # ...(选择特征值较大对应的特征向量) # 生成新的特征空间 # ...(利用选择的特征向量将数据映射到新的低维空间)

四、PCA的应用案例

-

图像处理: 在图像处理中,PCA可用于降低图像数据的维度,从而减少噪声、压缩图像信息以及提取图像的主要特征。这在人脸识别、图像压缩和图像去噪中有所应用。

-

降维: 图像通常是高维数据,每个像素都是一个特征。PCA可以用于降低图像数据的维度,尤其在大规模图像数据集中。通过保留最重要的特征,可以减少数据的存储空间和计算成本。

-

特征提取: PCA有助于提取图像中的主要特征。通过计算协方差矩阵,找到主成分,可以提取图像中的主要结构和信息,有助于识别模式或特定特征。

-

噪声去除: 在图像中,可能存在各种类型的噪声,例如高斯噪声、椒盐噪声等。PCA能够过滤掉一些噪声,因为它会尽量保留数据中的主要变化,而将噪声数据视为次要的变化。

-

图像压缩: PCA可用于图像压缩,通过减少冗余信息,保留主要特征,从而降低图像的存储需求,同时保持图像质量。

-

-

数据压缩: PCA能够减少数据的维度,同时保留主要的数据特征,因此被广泛应用于数据压缩领域。这在减少存储空间、加快数据处理速度方面有着重要作用。

-

数据预处理: 数据需要被标准化,以确保各个特征有着相似的尺度。

-

计算协方差矩阵: 对标准化后的数据,计算协方差矩阵。

-

特征值分解: 对协方差矩阵进行特征值分解,得到特征值和对应的特征向量。

-

选择主成分: 基于特征值的大小,选择最重要的特征向量,它们对应的特征值较大,代表数据中的主成分。

-

生成新的特征空间: 使用选取的特征向量构成的矩阵,将原始数据映射到新的低维空间。

-

-

特征提取: 在机器学习领域,特征提取对模型性能有着重要影响。PCA可用于提取数据中最相关的特征,减少冗余信息,同时保留主要特征。这在降低计算成本、改善模型性能方面很有帮助。

-

金融领域: 在金融领域,PCA可用于资产组合优化、风险管理以及市场预测。通过降维和提取主要特征,帮助分析师更好地理解和预测金融市场的复杂数据。

-

生物医学领域: 在生物医学数据分析中,PCA可用于处理基因数据,识别基因表达模式,甄别疾病特征,以及处理成千上万的基因数据点。

-

信号处理: 在信号处理中,PCA可用于分离和减少信号中的噪声,提取出最重要的信号成分,改善信号的质量和可分析性。

五、PCA的优缺点

优点:

- 降维: PCA可以通过减少数据维度,提高计算效率,降低过拟合风险。

- 去冗余: 它能够去除数据中的冗余信息,提取出最重要的特征,减少噪音影响。

- 保留数据结构: 在降维的过程中,PCA尽量保留数据的结构和方差,以便更好地保留信息。

- 易于理解和实现: PCA是一个直观且易于实现的技术,基于数学原理,容易解释和应用。

缺点:

- 线性假设: PCA假设数据是线性相关的,如果数据的关系是非线性的,它可能表现不佳。

- 信息损失: 在降维的过程中,为了减少维度,可能会损失某些数据的细节信息。

- 计算开销: 对大型数据集的特征分解需要较大的计算开销,尤其是在高维数据集上。

5519

5519

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?