1.基本语法

hadoop fs 具体命令

或者

hdfs dfs 具体命令

2.命令大全

2.1.准备工作

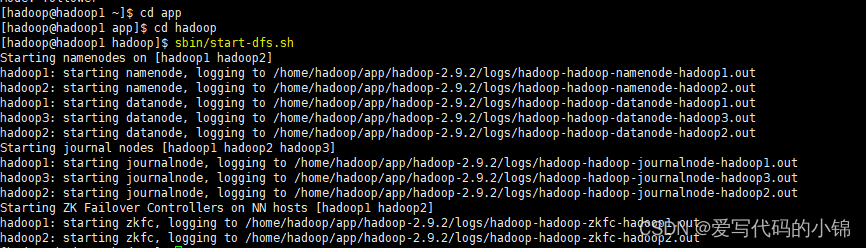

1)启动Hadoop集群

sbin/start-dfs.sh

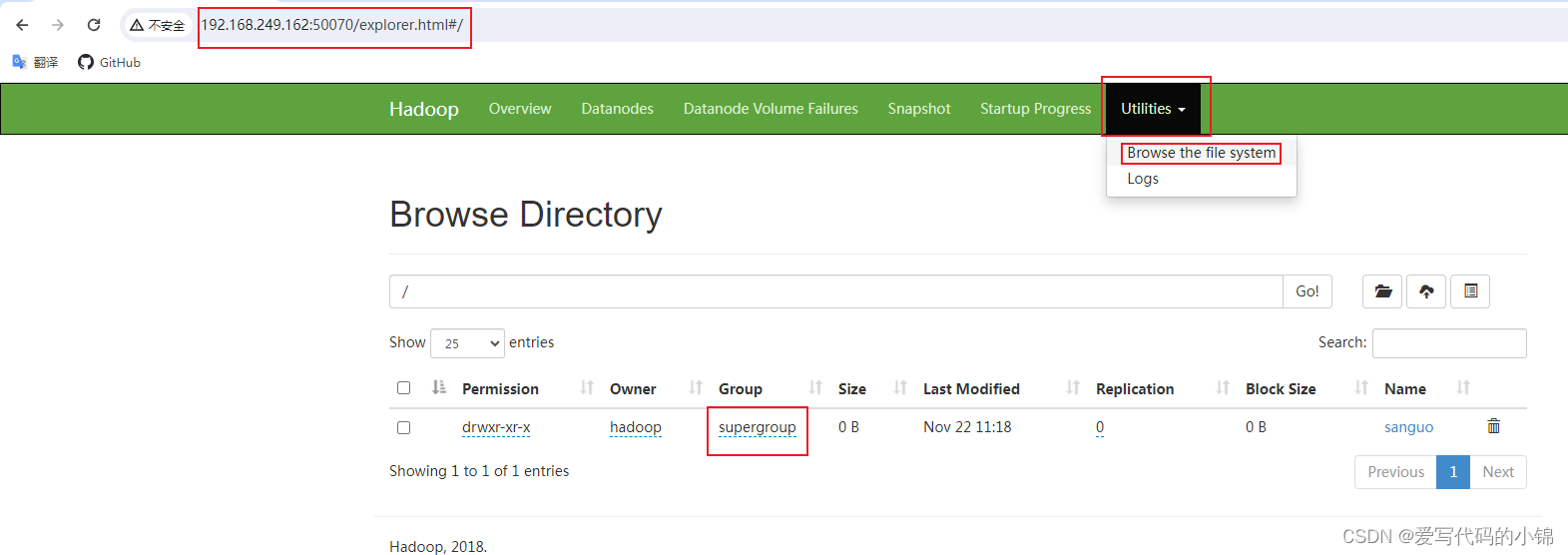

2)创建/sanguo文件夹

2)创建/sanguo文件夹

hadoop fs -mkdir /sanguo

![]()

3)查看创建的文件

2.2.上传

1)从本地剪切粘贴到HDFS

hadoop fs -moveFromLocal 本地文件路径 HDFS文件路径

[hadoop@hadoop1 jinjin]$ hadoop fs -moveFromLocal shuguo.txt /sanguo2)从本地文件系统中拷贝文件到HDFS路径去

hadoop fs -copyFromLocal 本地文件路径 HDFS文件路径

(可把copyFromLocal 替换成put目录)

hadoop fs -copyFromLocal weiguo.txt /sanguo3)追加一个文件到已经存在的文件末尾

hadoop fs -appendToFile 要追加的内容文件路径 HDFS的文件路径

hadoop fs -appendToFile liubei.txt /sanguo/shuguo.txt2.3.下载

1)从HDFS拷贝到本地

hadoop fs -copyToLocal HDFS路径 本地路径

(可把copyToLocal替换成get目录)

hadoop fs -copyToLocal /sanguo/shuguo.txt ./2.4.对HDFS的文件进行直接操作(与Linux命令一样,以下路径均为HDFS文件系统里的路径)

1)显示目录信息

hadoop fs -ls 需要查询的HDFS目录路径(/代表根目录)

[hadoop@hadoop1 jinjin]$ hadoop fs -ls /

Found 1 items

drwxr-xr-x - hadoop supergroup 0 2023-11-22 11:37 /sanguo

2)显示文件内容

hadoop fs -cat 需要查看的HDFS文件路径

[hadoop@hadoop1 jinjin]$ hadoop fs -cat /sanguo/shuguo.txt

shuguo

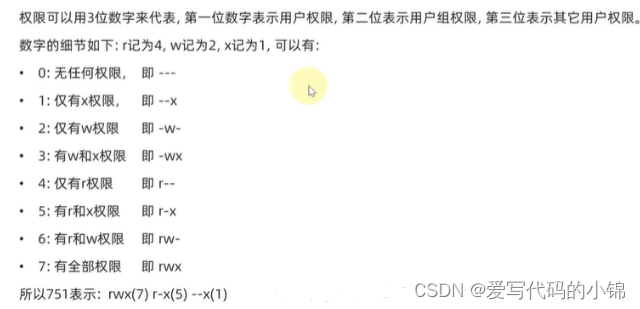

liubei3)修改文件所属权限

hadoop fs -chmod 权限 文件或文件夹路径

hadoop fs -chmod 666 /sanguo/shuguo.txt

4)创建路径

hadoop fs -mkdir 文件夹路径

[hadoop@hadoop1 jinjin]$ hadoop fs -mkdir /jinguo

[hadoop@hadoop1 jinjin]$ hadoop fs -ls /

Found 2 items

drwxr-xr-x - hadoop supergroup 0 2023-11-22 15:28 /jinguo

drwxr-xr-x - hadoop supergroup 0 2023-11-22 11:37 /sanguo

5)从HDFS的一个路径拷贝到HDFS的另一个路径

hadoop fs -cp 需要拷贝的路径 目标路径

[hadoop@hadoop1 jinjin]$ hadoop fs -cp /sanguo/shuguo.txt /jinguo

[hadoop@hadoop1 jinjin]$ hadoop fs -ls /jinguo

Found 1 items

-rw-r--r-- 3 hadoop supergroup 14 2023-11-22 15:31 /jinguo/shuguo.txt

6)在HDFS目录中移动文件

hadoop fs -mv 要移动的文件路径 目标文件路径

[hadoop@hadoop1 jinjin]$ hadoop fs -mv /sanguo/wuguo.txt /jinguo

[hadoop@hadoop1 jinjin]$ hadoop fs -ls /jinguo

Found 2 items

-rw-r--r-- 3 hadoop supergroup 14 2023-11-22 15:31 /jinguo/shuguo.txt

-rw-r--r-- 3 hadoop supergroup 6 2023-11-22 11:37 /jinguo/wuguo.txt

7)显示一个文件的末尾1kb的数据

hadoop fs -tail 文件路径

[hadoop@hadoop1 jinjin]$ hadoop fs -tail /jinguo/shuguo.txt

shuguo

liubei

8)删除文件或文件夹

hadoop fs -rm 要删除的文件或文件夹路径

[hadoop@hadoop1 jinjin]$ hadoop fs -rm /sanguo/shuguo.txt

Deleted /sanguo/shuguo.txt

[hadoop@hadoop1 jinjin]$ hadoop fs -ls /sanguo

Found 1 items

-rw-r--r-- 3 hadoop supergroup 7 2023-11-22 11:31 /sanguo/weiguo.txt9)递归删除目录及目录里面的内容

hadoop fs -rm -r 要删除的目录路径

[hadoop@hadoop1 jinjin]$ hadoop fs -rm -r /sanguo

Deleted /sanguo

10)统计文件夹的大小信息

文件夹各个文件的大小:

hadoop fs -du -h 文件夹路径

文件总大小:

hadoop fs -du -s -h 文件夹路径

20 /jinguo

[hadoop@hadoop1 jinjin]$ hadoop fs -du -h /jinguo

14 /jinguo/shuguo.txt

6 /jinguo/wuguo.txt

[hadoop@hadoop1 jinjin]$ hadoop fs -du -s -h /jinguo

20 /jinguo

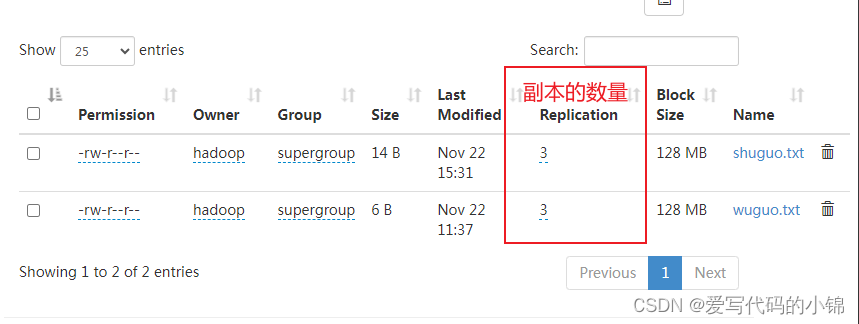

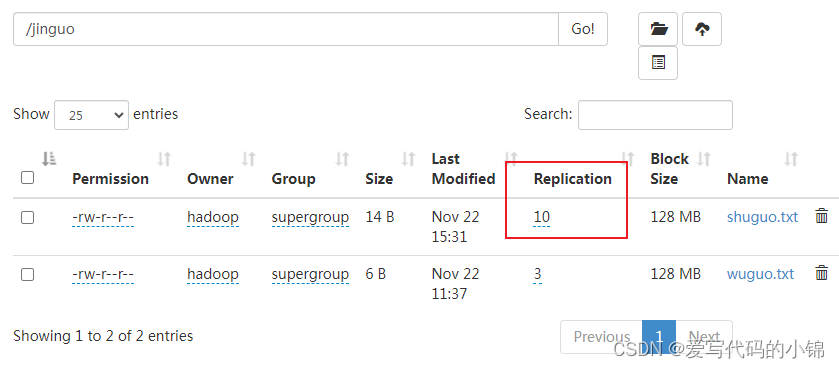

11)设置HDFS中文件的副本数量

实际上,每台hadoop节点只会有一个副本,我有3台Hadoop节点,而如果将副本数量增加到10,那么,未来增加节点,将把副本拷贝至新增加的节点上。

实际上,每台hadoop节点只会有一个副本,我有3台Hadoop节点,而如果将副本数量增加到10,那么,未来增加节点,将把副本拷贝至新增加的节点上。

hadoop fs -setrep 副本数量 文件路径

[hadoop@hadoop1 jinjin]$ hadoop fs -setrep 10 /jinguo/shuguo.txt

Replication 10 set: /jinguo/shuguo.txt

2637

2637

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?