简介

Apache Kafka是一款分布式的、去中心化的、高吞吐低延迟、订阅模式的消息队列系统。

同RabbitMQ一样,Kafka也是消息队列。不过RabbitMQ多用于后端系统,因其更加专注于消息的延迟和容错。

Kafka多用于大数据体系,因其更加专注于数据的吞吐能力。

Kafka多数都是运行在分布式(集群化)模式下,所以将以3台服务器,来完成Kafka集群的安装部署。

安装

1、确保已经安装并部署了JDK和Zookeeper服务

Kafka的运行依赖JDK环境和zookeeper,请确保已经有了JDK环境和zookeeper

2、【在node1操作】下载并上传Kafka的安装包

# 下载安装包

wget http://archive.apache.org/dist/kafka/2.4.1/kafka_2.12-2.4.1.tgz3、【node1操作】 解压

mkdir -p /export/server # 此文件夹如果不存在需先创建

# 解压

tar -zxvf kafka_2.12-2.4.1.tgz -C /export/server

# 创建软链接

ln -s /export/server/kafka_2.12-2.4.1 /export/server/kafka4、【node1操作】 修改kafka目录内的config目录内的server.properties文件

cd /export/server/kafka/config

# 指定broker的id

broker.id =1

# 指定 kafka的绑定监听地址

listeners=PLAINTEXT://node1:9092

# 指定kafka数据的位置

log.dirs=/export/server/kafka/data

# 指定zookeeper的三个节点

zookeeper.connect=node1:2181,node2:2181,node3:21815、【node1操作】 将node1的kafka复制到node2和node3

scp -r /export/server/kafka_2.12-2.4.1 node2:`pwd`/

scp -r /export/server/kafka_2.12-2.4.1 node3:`pwd`/6、【node2操作】修改kafka目录内的config目录内的server.properties文件

# 创建软连接

ln -s /export/server/kafka_2.12-2.4.1 /export/server/kafka

cd /export/server/kafka/config

# 指定broker的id

broker.id =2

# 指定 kafka的绑定监听地址

listeners=PLAINTEXT://node2:9092

# 指定kafka数据的位置

log.dirs=/export/server/kafka/data

# 指定zookeeper的三个节点

zookeeper.connect=node1:2181,node2:2181,node3:21817、【node3操作】修改kafka目录内的config目录内的server.properties文件

# 创建软连接

ln -s /export/server/kafka_2.12-2.4.1 /export/server/kafka

cd /export/server/kafka/config

# 指定broker的id

broker.id =3

# 指定 kafka的绑定监听地址

listeners=PLAINTEXT://node3:9092

# 指定kafka数据的位置

log.dirs=/export/server/kafka/data

# 指定zookeeper的三个节点

zookeeper.connect=node1:2181,node2:2181,node3:21818、启动kafka

# 请先确保zookeeper已经启动了

/export/server/zookeeper/bin/zkServer.sh start

# 方式1:前台启动,分别在node1、2、3上执行如下语句

/export/server/kafka/bin/kafka-server-start.sh /export/server/kafka/config/server.properties

# 方式2:后台启动,分别在node1、2、3执行如下语句

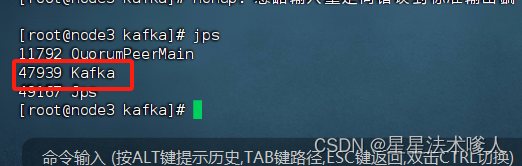

nohup /export/server/kafka/bin/kafka-server-start.sh /export/server/kafka/config/server.properties 2>&1 >> /export/server/kafka/kafka-server.log &9、验证kafka启动

jps

至此,kafka集群就安装部署完毕啦。

6231

6231

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?