本人情况:Hadoop分布式搭建,有主节点master,从节点slave01,ssh和相关映射已经弄好

问题:master节点正常启动,slave01节点datanode无法启动

解决办法:

办法1.在slave01中,手动启动datanode

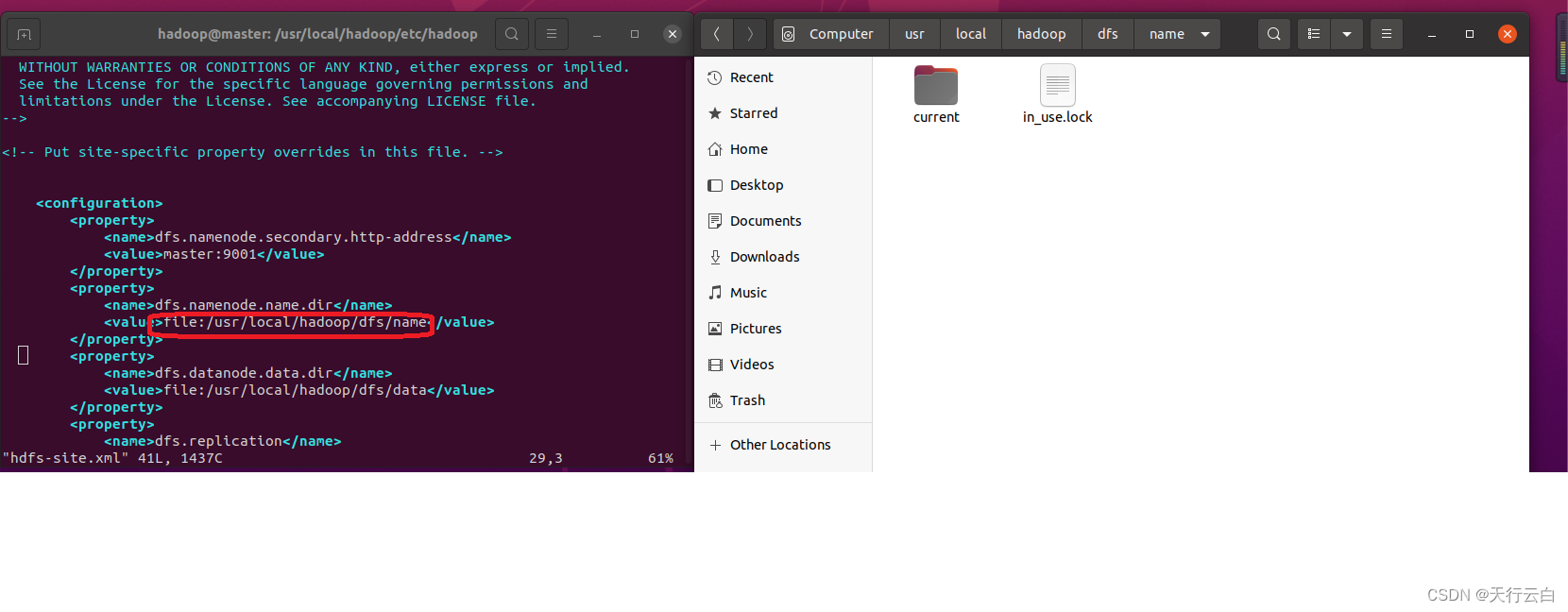

hadoop-daemon.sh start datanode办法2(推荐).删除master节点 usr/local/hadoop/dfs目录下的data和name目录,然后创建新的data,name

cd /usr/local/hadoop/dfs

rm -rf data

rm -rf name

mkdir data

mkdir name删除master节点 usr/local/hadoop目录下的logs,然后创建新的logs

cd /usr/local/hadoop

rm -rf logs

mkdir logs

最后对Hadoop初始化,请确保此时hadoop没有启动

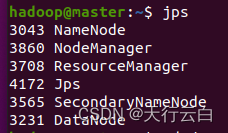

hdfs namenode -format启动hadoop,有datanode:

(若仍报错,请检查usr/local/hadoop/etc/hadoop目录下配置文件,确保文件路径正确,都可以打开)

1129

1129

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?